في أحد الأيام، قبل حوالي عشر سنوات، طلبت من صديق لي أن يمسك روبوت على شكل طفل ديناصور رأسًا على عقب. كانت لعبة إسمها "بليو" وقد اشتريتها سابقاً، وكنت متحمسة للحصول عليها لأنني لطالما أحببت الروبوتات. وكانت هذه اللعبة تحتوي على ميزات تقنية رائعة. كانت تحتوي على محركات وحساسات لمس وكذلك كاميرا بالأشعة تحت الحمراء. وأحد الأشياء التي كانت بها مستشعر للإمالة، لذا كانت تعرف الإتجاه الذي كانت توجه له. وعندما كنت تمسكها رأسًا على عقب، فإنها تبدأ بالبكاء. وخطر لي أن هذا أمر رائع، وكنت أرغب في عرضها لصديقي، فقلت له: " أمسكها من الذيل، وشاهد ماذا ستفعل". بدأنا نشاهد التصرفات الدرامية التي بدأ يصدرها هذا الروبوت المعاناة والبكاء. وبعد بضع ثوان، بدأ الأمر يسبب لي الضيق قليلًا، وقلت: "يكفي هذا حتى الآن. لنضعه على الأرض مرة أخرى". ثم قمت بالمسح على رأس الروبوت لكي يتوقف عن البكاء.

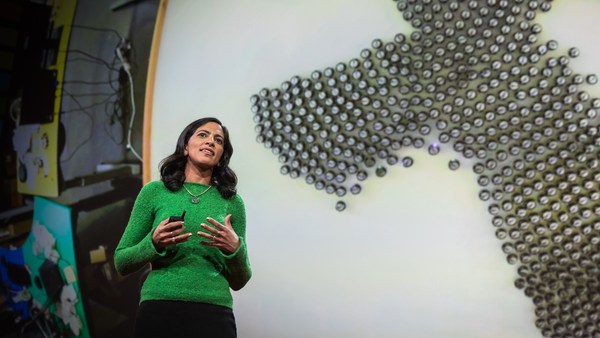

There was a day, about 10 years ago, when I asked a friend to hold a baby dinosaur robot upside down. It was this toy called a Pleo that I had ordered, and I was really excited about it because I've always loved robots. And this one has really cool technical features. It had motors and touch sensors and it had an infrared camera. And one of the things it had was a tilt sensor, so it knew what direction it was facing. And when you held it upside down, it would start to cry. And I thought this was super cool, so I was showing it off to my friend, and I said, "Oh, hold it up by the tail. See what it does." So we're watching the theatrics of this robot struggle and cry out. And after a few seconds, it starts to bother me a little, and I said, "OK, that's enough now. Let's put him back down." And then I pet the robot to make it stop crying.

كانت هذه تجربة غريبة بالنسبة لي. لم تكن لدي مشاعر أمومة كبيرة في ذلك الوقت. وقد أصبحت أمًا منذ ذلك الحين، منذ تسعة أشهر مضت، كما تعملت أن الأطفال لايحبون عندما تمسكهم رأسًا على عقب.

And that was kind of a weird experience for me. For one thing, I wasn't the most maternal person at the time. Although since then I've become a mother, nine months ago, and I've learned that babies also squirm when you hold them upside down.

(ضحك)

(Laughter)

ولكن تفاعلي مع هذا الروبوت كان مثيرًا للاهتمام لأنني كنت أعرف طريقة عمل هذا الروبوت بالصبط، وبالرغم من ذلك، شعرت أنني يجب أن أكون لطيفه معه. وقد أثارت تلك الملاحظة فضولي حيث قضيت العقد الماضي أحقق بها. لماذا عملت على مراضاة هذا الروبوت؟ أحد الأشياء التي اكتشفتها أن طريقة تعاملي مع هذه الآلة تتعدى تلك اللحظة الغريبة التي حدثت في غرفة معيشتي، حيث أننا نعيش في عالم يتزايد به الدور الذي تلعبه الروبوتات في حياتنا، لأن غريزة كهذه يمكن أن يكون لها عواقب، لأن أول شيء اكتشفته أن هذا الأمر لاينحصر بي فقط.

But my response to this robot was also interesting because I knew exactly how this machine worked, and yet I still felt compelled to be kind to it. And that observation sparked a curiosity that I've spent the past decade pursuing. Why did I comfort this robot? And one of the things I discovered was that my treatment of this machine was more than just an awkward moment in my living room, that in a world where we're increasingly integrating robots into our lives, an instinct like that might actually have consequences, because the first thing that I discovered is that it's not just me.

كتبت الواشنطن بوست تقريرًا عام 2007 أن جيش الولايات المتحدة كان يختبر روبوت لكي يقوم بتفكيك الألغام. وهو مصمم على شكل حشرة العصى المتحركة وتمشي مثلها أيضًا حيث أنها تمشي في حقل الألغام على أرجلها، وتنفجر إحدى الأرجل في كل مرة تطئ أحد الألغام، ثم تمشي على الأرجل الأخرى لكي تفجر ألغام إضافية. وقد قام العقيد المسؤول عن الإختبار بإيقافه وإلغاءه، حيث يقول أنه عمل غير إنساني أن نرى هذا الروبوت وهو يجر نفسه عبر حقل الألغام. ما الذي قد يدفع ضابط عسكري متمرس وشخص مثلي أنا ليكون لدينا ذات المشاعر للروبوتات؟

In 2007, the Washington Post reported that the United States military was testing this robot that defused land mines. And the way it worked was it was shaped like a stick insect and it would walk around a minefield on its legs, and every time it stepped on a mine, one of the legs would blow up, and it would continue on the other legs to blow up more mines. And the colonel who was in charge of this testing exercise ends up calling it off, because, he says, it's too inhumane to watch this damaged robot drag itself along the minefield. Now, what would cause a hardened military officer and someone like myself to have this response to robots?

نحن نتأثر بالثقافة المنتشرة والخيال العلمي حيث نرغب في أن نمنحها شخصية كالإنسان، لكن الأمر أعمق من هذا. من الواضح أن بنيتنا البيولوجية تدفعنا لإعطاء صفة الحياة وهدف لوجود لكل ما يتحرك في فضائنا المادي ويكون غير معتمدًا علينا. لذا يتعامل الناس مع الروبوتات وكأنها كائن حي. يتم إطلاق أسماء على الوحدات التي تتخلص من القنابل. كما يحصلون على ميداليات الشرف. وحصل بعضهم على جنازات مع تحية السلاح. وتبين الأبحاث أننا نقوم بهذا مع أبسط روبوتات الأعمال المنزلية، مثل مكنسة (رومبا) الآلية.

Well, of course, we're primed by science fiction and pop culture to really want to personify these things, but it goes a little bit deeper than that. It turns out that we're biologically hardwired to project intent and life onto any movement in our physical space that seems autonomous to us. So people will treat all sorts of robots like they're alive. These bomb-disposal units get names. They get medals of honor. They've had funerals for them with gun salutes. And research shows that we do this even with very simple household robots, like the Roomba vacuum cleaner.

(ضحك)

(Laughter)

هي عبارة عن قرص يتحرك في أرجاء الأرضية لتنظيفها، ولكن حقيقة أنها تتحرك لوحدها سيدفع الناس أن يعطوا أسماء لها ويشعرون بالضيق اتجاهها عندما تنحشر تحت إحدى الآرائك.

It's just a disc that roams around your floor to clean it, but just the fact it's moving around on its own will cause people to name the Roomba and feel bad for the Roomba when it gets stuck under the couch.

(ضحك)

(Laughter)

يمكننا تصميم روبوتات لكي تقوم بإثارة ردة الفعل هذه تحديدًا، بإستخدام الأعين والأوجه أو الحركات بحيث يكون الناس رابطًا لا شعوريًا بشكل تلقائي مع الحالة الذهنية أو النفسية. هناك مجموعة كاملة من الأبحاث تسمى التفاعل الإنساني مع الروبوتات الذي يهتم بإظهار مدى نجاح هذا الأمر. فمثلا، وجد الباحثون في جامعة ستانفورد أن الناس يكونوا غير مرتاحين إطلاقًا عندما تطلب منهم لمس أجزاء الروبوتات الخاصة.

And we can design robots specifically to evoke this response, using eyes and faces or movements that people automatically, subconsciously associate with states of mind. And there's an entire body of research called human-robot interaction that really shows how well this works. So for example, researchers at Stanford University found out that it makes people really uncomfortable when you ask them to touch a robot's private parts.

(ضحك)

(Laughter)

من هذه الدراسة ومن دراسات أخرى مشابهه، نعرف أن الناس تتجاوب مع الإشارات التي تظهر لهم من هذه الآلات التي هي أقرب ما تكون للحياة، حتى وإن كانوا يعلمون أنها ليست حية.

So from this, but from many other studies, we know, we know that people respond to the cues given to them by these lifelike machines, even if they know that they're not real.

نحن نتجه الآن لعالم توجد به الروبوتات في جميع نواحي الحياة. لم تعد تكنولوجيا الروبوتات محصورة في جدران المصانع. بل بدأنا نجدها في أماكن عملنا ومنازلنا. بدأت هذه الآلات التي تقدر أن تشعر وتتخذ قرارات مستقلة وتتعلم تتواجد في هذه الأماكن المشتركة، أعتقد أن أفضل مثال يمكن أن نقدمه لهذه الحالة هي علاقتنا مع الحيوانات. حيث بدأنا نستأنس الحيوانات منذ آلاف السنوات، دربناهم للقيام بأعمال أو ليكونوا سلاح ما أو ليكونوا رفقاء لنا. وقد عاملنا بعض هذه الحيوانات كأدوات أو بضائع على مر التاريخ، وعاملنا أنواع أخرى برقة وحنان وتم منحهم مكانة في المجتمع على أنهم رفقاء لنا. أعتقد أنه من الممكن أن نبدأ دمج الروبوتات بطرق مشابهه.

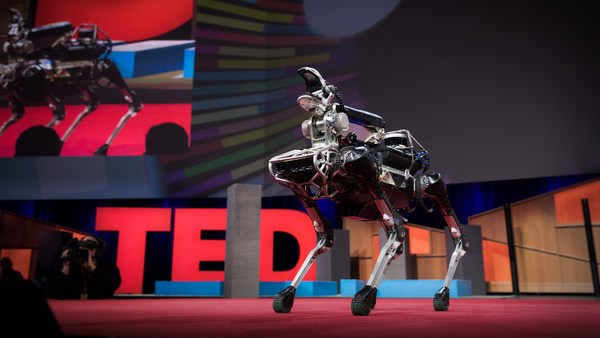

Now, we're headed towards a world where robots are everywhere. Robotic technology is moving out from behind factory walls. It's entering workplaces, households. And as these machines that can sense and make autonomous decisions and learn enter into these shared spaces, I think that maybe the best analogy we have for this is our relationship with animals. Thousands of years ago, we started to domesticate animals, and we trained them for work and weaponry and companionship. And throughout history, we've treated some animals like tools or like products, and other animals, we've treated with kindness and we've given a place in society as our companions. I think it's plausible we might start to integrate robots in similar ways.

وبالطبع، الحيوانات كائنات حية. بعكس الروبوتات. ويمكنني أن أخبركم، من خلال عملي في مجال الروبوتات، أننا بعيدين للغاية من تطوير روبوت قادر على الإحساس بأي شيء. ولكننا نمتلك أحاسيس نحوها، وهذا شيء مهم، لأننا إن كنا نحاول دمج الروبوتات في تلك الأماكن المشتركة، يتوجب علينا أن نعلم أن الناس ستتعامل معها بطريقة تختلف عن الأجهزة الأخرى، كما في بعض الحالات، مثل الجندي الذي يصبح لديه إرتباط عاطفي مع الروبوت الذي يعمل معه، والذي يمكن أن يكون أمرًا خطيرًا أو يصبح غير فعال. ولكنه قد يكون مفيدًا في حالات أخرى، أن نعزز هذا الإتصال العاطفي مع الروبوتات. بدأنا بالفعل نرى بعض حالات الإستخدام الرائعة، فمثلا، الروبوتات التي تعمل مع الأطفال المصابين بالتوحد وتشجيعهم على المشاركة بأساليب لم نكن نراها سابقًا، أو الروبوتات التي تعمل مع المدرسين لتعزيز مشاركة الأطفال معطية نتائج جديدة. وليس الأطفال فقط. تبين دراسات أولية أن الروبوتات يمكن أن تساعد الأطباء والمرضى في أماكن الرعاية الصحية.

And sure, animals are alive. Robots are not. And I can tell you, from working with roboticists, that we're pretty far away from developing robots that can feel anything. But we feel for them, and that matters, because if we're trying to integrate robots into these shared spaces, we need to understand that people will treat them differently than other devices, and that in some cases, for example, the case of a soldier who becomes emotionally attached to the robot that they work with, that can be anything from inefficient to dangerous. But in other cases, it can actually be useful to foster this emotional connection to robots. We're already seeing some great use cases, for example, robots working with autistic children to engage them in ways that we haven't seen previously, or robots working with teachers to engage kids in learning with new results. And it's not just for kids. Early studies show that robots can help doctors and patients in health care settings.

هذا روبوت (بارو) على شكل طفل الفقمة. تستخدم في دور رعاية المسنين ومع مرضى الخرف. وهي موجودة منذ فترة. وأذكر أنني كنت في حفلة من سنوات عدة، وأخبرت أحد صديقاتي عن هذا الروبوت، وكان ردة فعلها، "يا إلهي، هذا فظيع، لا أصدقك أننا نعطي المرضى روبوتات بدلًا من الرعاية البشرية". وكان هذا هو الرد المتكرر دومًا، وأعتقد أنهم مصيبين جدًا، لأن هذا الأمر سيكون مريعًا. لكن الأمر لايقتصر على ما الذي تحل الروبوتات مكانه. تستخدم هذه الروبوتات كبديل للعلاج بالحيوانات وذلك في إطار أننا لا نستطيع أن نستخدم حيوانات حقيقية ولكن يمكننا إستخدام الروبوتات، لأن الناس سيتعاملون معها كحيوان بدلًا من أن يعاملوها كآلة.

This is the PARO baby seal robot. It's used in nursing homes and with dementia patients. It's been around for a while. And I remember, years ago, being at a party and telling someone about this robot, and her response was, "Oh my gosh. That's horrible. I can't believe we're giving people robots instead of human care." And this is a really common response, and I think it's absolutely correct, because that would be terrible. But in this case, it's not what this robot replaces. What this robot replaces is animal therapy in contexts where we can't use real animals but we can use robots, because people will consistently treat them more like an animal than a device.

ملاحظة هذا الترابط العاطفي مع الروبوتات يساعدنا في التنبؤ بالتحديات لدخول هذه الآلات لمناطق أكثر حميمية في حياة الناس. مثلًا، هل من المقبول أن يقوم روبوت طفلك على شكل دب أن يسجل المحادثات الخاصة؟ هل من المقبول أن يقوم روبوت حميمي بإجراء مشتريات من خلال تطبيقات؟

Acknowledging this emotional connection to robots can also help us anticipate challenges as these devices move into more intimate areas of people's lives. For example, is it OK if your child's teddy bear robot records private conversations? Is it OK if your sex robot has compelling in-app purchases?

(ضحك)

(Laughter)

لأن وجود الروبوتات في نظام رأس مالي ينتج عنه تساؤلات حول حماية المستهلك والخصوصية.

Because robots plus capitalism equals questions around consumer protection and privacy.

وهذه ليست الأسباب الوحيدة أن يكون تعاملنا مع هذه الآلات يحظى بأهمية ما. بعد بضع سنوات من الموقف الذي اختبرته مع روبوت صغير الديناصور، قمت بإجراء ورشة عملية مع صديقي "هانيز جاسيرت". وأعطينا خمسة من هذه الروبوتات صغار الديناصور وأعطيناها لخمسة فرق. وطلبنا منهم إطلاق أسماء عليها واللعب والتفاعل معها لمدة ساعة تقريبًا. ثم قدمنا لهم مطرقة وفأس وطلبنا منهم تعذيب الروبوتات وقتلها.

And those aren't the only reasons that our behavior around these machines could matter. A few years after that first initial experience I had with this baby dinosaur robot, I did a workshop with my friend Hannes Gassert. And we took five of these baby dinosaur robots and we gave them to five teams of people. And we had them name them and play with them and interact with them for about an hour. And then we unveiled a hammer and a hatchet and we told them to torture and kill the robots.

(ضحك)

(Laughter)

وبدا الأمر دراميًا أكثر مما توقعنا، لأنه لم يقدم أحد من المشاركين على مجرد ضرب قليلًا روبوتات صغار الديناصور هذه، لذا توجب علينا الارتجال قليلًا إلى أن قلنا في مرحلة ما، "يمكنكم إنقاذ روبوت فريقكم إن قمتم بتدمير روبوت الفريق الآخر".

And this turned out to be a little more dramatic than we expected it to be, because none of the participants would even so much as strike these baby dinosaur robots, so we had to improvise a little, and at some point, we said, "OK, you can save your team's robot if you destroy another team's robot."

(ضحك)

(Laughter)

لم يفلح هذا الأمر أيضًا. لم يقدروا على فعل هذا. ولذا قلنا أخيرًا، "سوف نحطم جميع هذه الروبوتات إلا إذا قام أحدكم بضرب أحد الروبوتات بالفأس" ثم وقف أحدهم، وأخذ الفأس، وانتفضت الغرفة بكاملها حين قام بضرب الفأس على رقبة أحد الروبوتات، سادت لحظة صمت في الغرفة التي كانت خليطًا بين الجد والمزاح لهذا الروبوت الذي فقدناه.

And even that didn't work. They couldn't do it. So finally, we said, "We're going to destroy all of the robots unless someone takes a hatchet to one of them." And this guy stood up, and he took the hatchet, and the whole room winced as he brought the hatchet down on the robot's neck, and there was this half-joking, half-serious moment of silence in the room for this fallen robot.

(ضحك)

(Laughter)

كانت تلك تجربة مثيرة بحق. بالطبع، لم تكن تلك دراسة ذات قواعد كما هو واضح لكنها مهدت لأبحاث قمت بها في معهد ماساتشوستس للتكنولوجيا مع "بلاش ناندي" و"سينثيا بريزيل"، حيث أحضرنا أشخاص للمعمل لكي يحطموا "آلات سداسية الأرجل" وكانت تتحرك في كل مكان كالحشرات الحقيقية. ولذا بدلًا من أحد الأشكال اللطيفة التي قد يتعاطف الناس معها، اخترنا شيئ أكثر بساطة، ووجدنا أن الأشخاص الذين لديهم قدر أكبر من التعاطف ترددوا أكثر في ضرب تلك الألات السداسية الأرجل.

So that was a really interesting experience. Now, it wasn't a controlled study, obviously, but it did lead to some later research that I did at MIT with Palash Nandy and Cynthia Breazeal, where we had people come into the lab and smash these HEXBUGs that move around in a really lifelike way, like insects. So instead of choosing something cute that people are drawn to, we chose something more basic, and what we found was that high-empathy people would hesitate more to hit the HEXBUGS.

هذه مجرد دراسة بسيطة، ولكنها جزء ضمن بحث أكبر الذي بدأ يعطي مؤشرات أنه لربما كانت هناك علاقة ما بين ميل الناس لإظهار تعاطفهم وطريقة تصرفهم عند وجود الروبوتات. إلا أن سؤالي للمرحلة القادمة من التعامل بين الإنسان والروبوت هو ليس: "هل نتعاطف مع الروبوتات؟" بل: "هل يمكن أن تغيرالروبوتات الطريقة التي يتعاطف بها الناس؟" فمثلًا، هل هناك سبب ما يمنع طفلك من ركل روبوت على شكل كلب، ليس فقط لأنه يحترم ملكية الآخرين. ولكن لأن الطفل قد يكون أكثر قابلية لركل كلب حقيقي؟

Now this is just a little study, but it's part of a larger body of research that is starting to indicate that there may be a connection between people's tendencies for empathy and their behavior around robots. But my question for the coming era of human-robot interaction is not: "Do we empathize with robots?" It's: "Can robots change people's empathy?" Is there reason to, for example, prevent your child from kicking a robotic dog, not just out of respect for property, but because the child might be more likely to kick a real dog?

مرة أخرى، الأمر لا يقتصر على الأطفال. هو ذات السؤال الخاص بألعاب الفيديو العنيفة ولكن على مستوى جديد تمامًا هذا العنف الداخلي الذي نستخدمة بشكل أكثر حدة مقارنة بصور على شاشة ما. عندما نظهر العنف اتجاه الروبوتات، خصوصًا الروبوتات المصممة لمحاكاة مخلوقات حية، هل هذا منفذ صحي للسلوك العنيف أم أن هذا مجرد تمرين للمشاعر العدوانية؟ نحن لا نعلم إلا أن إجابة هذا السؤال قد تكون قادرة على التأثير على السلوك البشري، قد تكون قادرة على التأثير على الأنماط الإجتماعية، قد يكون لديها تأثير لإستنباط قواعد تحدد ما يمكننا وما لا يمكننا فعله مع روبوتات معينة، مشابهة لقوانين تجريم العنف نحو الحيوان. لأنه حتى وإن لم تقدر الروبوتات على الشعور، ربما كانت طريقة تعاملنا معها مهمة لنا نحن. وبغض النظر إن قمنا بتغير قوانيننا أم لا، ربما تمكنت الروبوتات من أن تعطينا فهم أفضل عن أنفسنا.

And again, it's not just kids. This is the violent video games question, but it's on a completely new level because of this visceral physicality that we respond more intensely to than to images on a screen. When we behave violently towards robots, specifically robots that are designed to mimic life, is that a healthy outlet for violent behavior or is that training our cruelty muscles? We don't know ... But the answer to this question has the potential to impact human behavior, it has the potential to impact social norms, it has the potential to inspire rules around what we can and can't do with certain robots, similar to our animal cruelty laws. Because even if robots can't feel, our behavior towards them might matter for us. And regardless of whether we end up changing our rules, robots might be able to help us come to a new understanding of ourselves.

معظم ما تعلمته خلال العشر سنوات الماضية لم يكن يتعلق بالتكنولوجيا إطلاقًا. بل كان يتعلق بعلم النفس البشري والتعاطف وكيفية التواصل مع الآخرين. لأنه عندما يكون طفل لطيفًا مع مكنسة (رومبا)، عندما يحاول جندي إنقاذ روبوت في ساحة الحرب، أو عندما ترفض مجموعة من الأشخاص أن يؤذوا روبوتات على شكل ديناصورات صغيرة، فإن هذه الروبوتات ليست فقط محركات وتروس وبرمجيات. ولكنها إنعكاس لأنسانيتنا كذلك.

Most of what I've learned over the past 10 years has not been about technology at all. It's been about human psychology and empathy and how we relate to others. Because when a child is kind to a Roomba, when a soldier tries to save a robot on the battlefield, or when a group of people refuses to harm a robotic baby dinosaur, those robots aren't just motors and gears and algorithms. They're reflections of our own humanity.

شكرًا جزيلًا.

Thank you.

(تصفيق)

(Applause)