Let me show you something.

Để tôi cho bạn xem cái này.

(Video) Girl: Okay, that's a cat sitting in a bed. The boy is petting the elephant. Those are people that are going on an airplane. That's a big airplane.

(Video) Bé gái: Okay, đó là một con mèo ngồi trên giường Đứa trẻ đang vuốt ve con voi Những người này đang chuẩn bị lên máy bay. Đó là một cái máy bay lớn.

Fei-Fei Li: This is a three-year-old child describing what she sees in a series of photos. She might still have a lot to learn about this world, but she's already an expert at one very important task: to make sense of what she sees. Our society is more technologically advanced than ever. We send people to the moon, we make phones that talk to us or customize radio stations that can play only music we like. Yet, our most advanced machines and computers still struggle at this task. So I'm here today to give you a progress report on the latest advances in our research in computer vision, one of the most frontier and potentially revolutionary technologies in computer science.

Fei Fei Li: Đây là một bé gái ba tuổi đang miêu tả những gì mà em nhìn thấy trong loạt hình. Em vẫn còn nhiều điều để khám phá về thế giới này, nhưng em hoàn toàn đã trở thành chuyên gia trong một nhiệm vụ rất quan trọng: hiểu được những thứ mà em thấy. Xã hội của chúng ta đã trở nên tiến bộ về mặt công nghệ hơn bao giờ hết. Chúng ta gửi con người lên mặt trăng, chúng ta chế tạo ra điện thoại hoăc điều chỉnh những đài phát thanh chỉ chơi loại nhạc chúng ta yêu thích. Nhưng mà, những thiết bị và máy vi tính tối tân nhất vẫn còn đang xoay xở trong nhiệm vụ này Vì thế mà tôi ở đây để báo cáo với bạn về quá trình của cải tiến mới nhất trong thí nghiệm đối với thị giác máy tính một trong những công nghệ dẫn đầu và có tiềm năng cách mạng trong khoa học máy tính.

Yes, we have prototyped cars that can drive by themselves, but without smart vision, they cannot really tell the difference between a crumpled paper bag on the road, which can be run over, and a rock that size, which should be avoided. We have made fabulous megapixel cameras, but we have not delivered sight to the blind. Drones can fly over massive land, but don't have enough vision technology to help us to track the changes of the rainforests. Security cameras are everywhere, but they do not alert us when a child is drowning in a swimming pool. Photos and videos are becoming an integral part of global life. They're being generated at a pace that's far beyond what any human, or teams of humans, could hope to view, and you and I are contributing to that at this TED. Yet our most advanced software is still struggling at understanding and managing this enormous content. So in other words, collectively as a society, we're very much blind, because our smartest machines are still blind.

Vâng, chúng ta đã có nguyên mẫu những chiếc xe lái tự động, nhưng lại thiếu đi thị giác thông minh, chúng không phân biệt được sự khác nhau giữa một cái túi giấy rách trên đường, cái có thể cán qua, và một tảng đá với cùng kích thước, mà nên tránh sang một bên. Chúng ta đã tạo nên những máy ảnh đắt đỏ hàng triệu điểm ảnh nhưng chúng ta chưa đưa ánh sáng đến cho người mù. máy bay không người lái có thể bay qua vùng đất rộng lớn, nhưng không có đủ thị giác công nghệ để giúp chúng ta theo dõi sự thay đổi của những rừng mưa nhiệt đới. Máy quay an ninh ở khắp mọi nơi, nhưng không thể báo động cho chúng ta khi một đứa trẻ đang bị chìm trong hồ bơi. Hình ảnh và những thước phim trở thành một phần thiết yếu của đời sống toàn cầu. Chúng đang được điều khiển với tốc độ vượt lên trên bất kỳ con người nào, hay nhóm người, có thể hy vọng thấy được, và bạn và tôi đang cống hiến cho điều đó ở TED này. Nhưng phần mềm tân tiến vẫn đang phải khó khăn xoay trở trong việc hiểu và quản lý nội dung khổng lồ này. Vì vậy nói cách khác, tụ chung lại như là một xã hội, chúng ta giống như bị mù, bởi vì chiếc máy thông minh nhất của chúng ta vẫn bị mù

"Why is this so hard?" you may ask. Cameras can take pictures like this one by converting lights into a two-dimensional array of numbers known as pixels, but these are just lifeless numbers. They do not carry meaning in themselves. Just like to hear is not the same as to listen, to take pictures is not the same as to see, and by seeing, we really mean understanding. In fact, it took Mother Nature 540 million years of hard work to do this task, and much of that effort went into developing the visual processing apparatus of our brains, not the eyes themselves. So vision begins with the eyes, but it truly takes place in the brain.

"Tại sao lại khó đến vậy" bạn sẽ hỏi. Máy ảnh có thể chụp được những bức thế này bằng cách chuyển đổi ánh sáng thành dãy 2 chiều những con số, được biết đến như điểm ảnh, nhưng chúng giống như những con số chết. Chúng không mang bất kỳ ý nghĩa nào cả. Giống như nghe thì không phải là thưởng thức, chụp ảnh không giống như nhìn thấy và với việc nhìn thấy, chúng tôi thực sự muốn nói là hiểu được. Trong thực tế, mẹ thiên nhiên phải mất 540 triệu năm cật lực mới làm được điều này, và hầu hết nỗ lực đó để đi đến việc phát triển quá trình của não bộ chúng ta, không chỉ mỗi đôi mắt. Vì thế mà cái nhìn bắt đầu với đôi mắt, nhưng thật sự diễn ra trong não bộ.

So for 15 years now, starting from my Ph.D. at Caltech and then leading Stanford's Vision Lab, I've been working with my mentors, collaborators and students to teach computers to see. Our research field is called computer vision and machine learning. It's part of the general field of artificial intelligence. So ultimately, we want to teach the machines to see just like we do: naming objects, identifying people, inferring 3D geometry of things, understanding relations, emotions, actions and intentions. You and I weave together entire stories of people, places and things the moment we lay our gaze on them.

Vì thế mà 15 năm qua, bắt đầu với luận án tiến sĩ của tôi tại Caltech và sau đó là hướng dẫn phòng thí nghiệm Thị giác ở Stanford, tôi đã làm việc với cố vấn, đối tác và sinh viên để dạy cho máy tính cách nhìn. Lĩnh vực nghiên cứu của chúng tôi gọi là thị giác máy tính và máy móc học hỏi. Nó là một phần của lĩnh vực chung - trí thông minh nhân tạo. Nên một cách tối ưu nhất, chúng tôi muốn dạy cho máy móc thấy được như chúng ta: kể tên đồ vật, nhận diện con người, những đồ vật 3D tương tự, hiểu được những mối quan hệ, tình cảm, hành động và cả dự định. Bạn và tôi cùng nhau dệt nên toàn bộ câu chuyện về con người -nơi chốn -đồ vật. giây phút mà chúng ta nhìn thấy chúng.

The first step towards this goal is to teach a computer to see objects, the building block of the visual world. In its simplest terms, imagine this teaching process as showing the computers some training images of a particular object, let's say cats, and designing a model that learns from these training images. How hard can this be? After all, a cat is just a collection of shapes and colors, and this is what we did in the early days of object modeling. We'd tell the computer algorithm in a mathematical language that a cat has a round face, a chubby body, two pointy ears, and a long tail, and that looked all fine. But what about this cat? (Laughter) It's all curled up. Now you have to add another shape and viewpoint to the object model. But what if cats are hidden? What about these silly cats? Now you get my point. Even something as simple as a household pet can present an infinite number of variations to the object model, and that's just one object.

Bước đầu tiên đạt được mục tiêu này là dạy cho máy tính nhìn những đồ vật, những block nhà của thế giới thị giác. Nói một cách đơn giản nhất, tưởng tượng quá trình dạy học này bằng cách chỉ cho máy tính một vài bức ảnh rèn luyện của những vậy cụ thể, ở đây là con mèo. và thiết kế một hình mẫu học được từ những bức ảnh rèn luyện này. Khó như thế nào nhỉ? Nói cho cùng, một con mèo là tổ hợp của hình dạng và màu sắc, và đây là cái mà chúng tôi đã làm ở thời kỳ đầu của việc tạo lập vật thể. Chúng tôi nói cho máy vi tính thuật toán dưới dạng ngôn ngữ toán học rằng con mèo có mặt tròn, một thân hình mũm mĩm, 2 tai nhọn, và một cái đuôi dài, và cái đó nhìn có vẻ ổn. Nhưng với con mèo này thì sao? (Tiếng cười) toàn là những đường cong lên. Bây giờ bạn lại có một hình dạng và góc nhìn khác đến vật thể khác. Nhưng nếu như con mèo bị ẩn đi thì sao? Thế còn những con mèo ngố này ? Bây giờ bạn đã hiểu ý của tôi rồi đó. Thậm chí thứ đơn giản như một vật nuôi trong nhà cũng có thể mang một con số vô tận những thay đổi đối với một vật thể mẫu, và nó mới chỉ là một vật thể mà thôi.

So about eight years ago, a very simple and profound observation changed my thinking. No one tells a child how to see, especially in the early years. They learn this through real-world experiences and examples. If you consider a child's eyes as a pair of biological cameras, they take one picture about every 200 milliseconds, the average time an eye movement is made. So by age three, a child would have seen hundreds of millions of pictures of the real world. That's a lot of training examples. So instead of focusing solely on better and better algorithms, my insight was to give the algorithms the kind of training data that a child was given through experiences in both quantity and quality.

Vì vậy mà khoảng 8 năm trước, một sự quan sát đơn giản và sâu sắc đã thay đổi suy nghĩ của tôi. Không ai nói cho một đứa trẻ biết chúng phải nhìn như thế nào, đặc biệt là trong những năm đầu đời. Chúng học hỏi qua những trãi nghiệm thế giới thực và qua những ví dụ. Nếu như bạn xem xét đôi mắt của một đứa trẻ như một cặp máy quay phim sinh học chúng chụp một ảnh trong mỗi 200 mili giây khoảng thời gian trung bình một cử động mắt được thực hiện. Vì vậy mà đến ba tuổi, một đứa trẻ có thể đã nhìn hàng triệu những bức ảnh của thế giới thực. Đó là rất nhiều những ví dụ rèn luyện. Nên thay vì chú trọng vào mỗi việc làm cho thuật toán ngày một tốt hơn ý định của tôi là cho những thuật toán một dạng rèn luyện dữ liệu mà một đứa trẻ có được nhờ kinh nghiệm về cả lượng cả chất.

Once we know this, we knew we needed to collect a data set that has far more images than we have ever had before, perhaps thousands of times more, and together with Professor Kai Li at Princeton University, we launched the ImageNet project in 2007. Luckily, we didn't have to mount a camera on our head and wait for many years. We went to the Internet, the biggest treasure trove of pictures that humans have ever created. We downloaded nearly a billion images and used crowdsourcing technology like the Amazon Mechanical Turk platform to help us to label these images. At its peak, ImageNet was one of the biggest employers of the Amazon Mechanical Turk workers: together, almost 50,000 workers from 167 countries around the world helped us to clean, sort and label nearly a billion candidate images. That was how much effort it took to capture even a fraction of the imagery a child's mind takes in in the early developmental years.

Một khi chúng tôi nhận ra điều này, chúng tôi biết mình cần phải thu thập một cơ sở dữ liệu có nhiều hình ảnh hơn những gì mà chúng tôi đã từng có trước đây, thậm chí là gấp hàng ngàn lần nữa, và cùng với giáo sư Kai Li ở đại học Princeton, chúng tôi triển khai dự án ImageNet vào năm 2007. May mắn thay, chúng tôi không cần phải gắn camera trên đâu và đợi chờ nhiều năm nữa. Chúng tôi lên mạng, nguồn tài nguyên ảnh lớn nhất mà con người đã từng tạo ra. Chúng tôi tải xuống gần một triệu bức và sử dụng công nghệ nguồn đám đông như nền tảng Amazon Mechanical Tuck để giúp chúng tôi phân loại những hình ảnh này. Vào đỉnh điểm, ImageNet là một trong số những ông chủ lớn nhất của những nhân viên Amazon Mechanical Turk cùng nhau, gần 50000 nhân viên từ 167 quốc gia trên thế giới giúp chúng tôi dọn dẹp, sắp xếp và phân loại gần một triệu tấm ảnh ứng viên. Đó mới thấy phải mất rất nhiều nổ lực để nắm bắt được thậm chí chỉ là một mảnh hình ảnh của trí óc trẻ con trong những năm tháng phát triển đầu đời

In hindsight, this idea of using big data to train computer algorithms may seem obvious now, but back in 2007, it was not so obvious. We were fairly alone on this journey for quite a while. Some very friendly colleagues advised me to do something more useful for my tenure, and we were constantly struggling for research funding. Once, I even joked to my graduate students that I would just reopen my dry cleaner's shop to fund ImageNet. After all, that's how I funded my college years.

Trong nhận thức muộn màng, ý tưởng sử dụng dữ liệu lớn để hướng dẫn một thuật toán vi tính có thể hiển nhiên vào lúc này, nhưng trở lại năm 2007, nó không hiển nhiên như vậy. Chúng tôi gần như là đơn độc trên hành trình này trong một thời gian dài. Một vài đồng nghiệp thân thiện khuyên tôi làm cái gì khác có lợi hơn cho chức vụ, và chúng tôi liên tục phải xoay xở tìm nguồn tài trợ cho dự án. Một lần, tôi đùa với những học viên cao học của mình tôi sẽ mở lại shop giặt là để tài trợ cho ImageNet Dù gì, thì đó là cách mà tôi trang trải cho những năm tháng đại học của mình.

So we carried on. In 2009, the ImageNet project delivered a database of 15 million images across 22,000 classes of objects and things organized by everyday English words. In both quantity and quality, this was an unprecedented scale. As an example, in the case of cats, we have more than 62,000 cats of all kinds of looks and poses and across all species of domestic and wild cats. We were thrilled to have put together ImageNet, and we wanted the whole research world to benefit from it, so in the TED fashion, we opened up the entire data set to the worldwide research community for free. (Applause)

Vì thế mà chúng tôi tiếp tục. Năm 2009, dự án ImageNet chuyển tải một cơ sở dữ liệu của 15 triệu tấm ảnh trong 22000 lớp đối tượng và đồ vật được tổ chức theo từng từ tiếng Anh thông dụng. Về cả số lượng và chất lượng, đây là một quy mô chưa từng có Lấy ví dụ, trong trường hợp của mèo, chúng tôi có hơn 62000 con mèo đủ mọi loại hình dạng và kiểu dáng và trong tất cả những loài mèo nhà hay mèo hoang. Chúng tôi hứng khởi để cùng nhau xây dựng nên ImageNet, và chúng tôi muốn cả thế giới nghiên cứu được hưởng lợi từ nó, vì vậy mà ở TED, chúng tôi mở toàn bộ hệ thống dữ liệu cho cộng đồng nghiên cứu quốc tế miễn phí (vỗ tay)

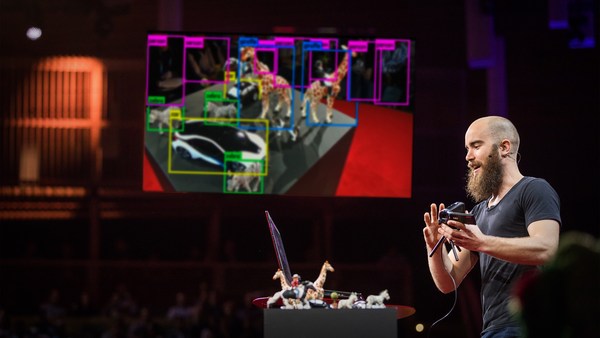

Now that we have the data to nourish our computer brain, we're ready to come back to the algorithms themselves. As it turned out, the wealth of information provided by ImageNet was a perfect match to a particular class of machine learning algorithms called convolutional neural network, pioneered by Kunihiko Fukushima, Geoff Hinton, and Yann LeCun back in the 1970s and '80s. Just like the brain consists of billions of highly connected neurons, a basic operating unit in a neural network is a neuron-like node. It takes input from other nodes and sends output to others. Moreover, these hundreds of thousands or even millions of nodes are organized in hierarchical layers, also similar to the brain. In a typical neural network we use to train our object recognition model, it has 24 million nodes, 140 million parameters, and 15 billion connections. That's an enormous model. Powered by the massive data from ImageNet and the modern CPUs and GPUs to train such a humongous model, the convolutional neural network blossomed in a way that no one expected. It became the winning architecture to generate exciting new results in object recognition. This is a computer telling us this picture contains a cat and where the cat is. Of course there are more things than cats, so here's a computer algorithm telling us the picture contains a boy and a teddy bear; a dog, a person, and a small kite in the background; or a picture of very busy things like a man, a skateboard, railings, a lampost, and so on. Sometimes, when the computer is not so confident about what it sees, we have taught it to be smart enough to give us a safe answer instead of committing too much, just like we would do, but other times our computer algorithm is remarkable at telling us what exactly the objects are, like the make, model, year of the cars.

Bây giờ chúng ta đã có dữ liệu để nuôi sống não bộ máy tính của chúng ta, chúng ta đã sẵn sàng quay trở lại với những thuật toán . Vì hóa ra là, sự dồi dào của những nguồn thông tin bởi ImageNet là một sự kết hợp hoàn hảo cho việc học những thuật toán của máy tính gọi là mạng lưới nơ ron đan chéo, tiên phong bởi Kunihiko Fukushima, Geoff Hinton, và Yann LeCun từ những năm 1970 và 1980 Giống như não bộ, nó bao gồm hàng triệu những nơ ron kết nối chặt chẽ với nhau, một đơn vị cơ bản trong mạng lưới neron là những nút giống như neron Cần phải có dữ liệu đầu vào từ nút này và gửi dữ liệu đầu ra cho nút khác. Hơn nữa, hàng trăm ngàn hoặc thậm chí hàng triệu nút được sắp xếp trong những lớp trật tự, cũng gần giống như não bộ. Trong mạng lưới điển hình chúng tôi dùng để huấn luyện những mẫu nhận diện vật thể có 24 triệu nút, 140 triệu thông số, và 15 tỉ liên kết. Đó là một mẫu cực kỳ lớn. Hỗ trợ bởi dữ liệu khổng lồ từ ImageNet và những CPUs và GPUs hiện đại để huấn luyện cho một mẫu cực lớn. mạng lưới những nơ ron đan chéo phát triển đến mức không ai có thể dự đoán được. Nó trở thành kiến trúc được dùng để điều hành những kết quả mới xuất hiện trong nhận diện vật thể. Đây là một chiếc máy tính nói với chúng ta rằng bức hình này bao gồm một con mèo và nơi mà con mèo đang ở. Dĩ nhiên là còn nhiều thứ hơn là con mèo, nên đây là một thuật toán nói với chúng ta rằng bức hình này bao gồm một đứa trẻ và một con gấu teddy; một con chó, một người, và một con diều nhỏ ở phía sau; hay một bức tranh của những thứ lộn xộn như một người, một tấm ván trượt, tay vịn, một cái đèn đường, vân vân. Đôi lúc, khi chiếc máy vi tính không chắc về những gì mà nó thấy, chúng tôi đã dạy nó trở nên thông minh đủ để cho chúng ta một câu trả lời an toàn thay vì phụ thuộc quá nhiều, giống như cách mà chúng ta sẽ làm, nhưng những lần khác những thuật toán thật sự ấn tượng với chúng tôi khi nói ra chính xác những đặc tính của đối tượng, như là xuất xứ, hiệu, năm sản xuất của những chiếc xe.

We applied this algorithm to millions of Google Street View images across hundreds of American cities, and we have learned something really interesting: first, it confirmed our common wisdom that car prices correlate very well with household incomes. But surprisingly, car prices also correlate well with crime rates in cities, or voting patterns by zip codes.

Chúng tôi ứng dụng thuật toán này cho hàng triệu ảnh chụp đường phố trên Google qua hàng trăm thành phố của Mỹ, và chúng tôi đã nhận ra nhiều thứ rất thú vị: đầu tiên, nó xác nhận sự hiểu biết chung của chúng ta giá cả của những chiếc xe rất liên quan với thu nhập của hộ gia đình. Nhưng bất ngờ là, giá của xe cũng tương ứng với mức độ tội phạm trong những thành phố , hoặc tỉ lệ bầu phiếu theo mã vùng.

So wait a minute. Is that it? Has the computer already matched or even surpassed human capabilities? Not so fast. So far, we have just taught the computer to see objects. This is like a small child learning to utter a few nouns. It's an incredible accomplishment, but it's only the first step. Soon, another developmental milestone will be hit, and children begin to communicate in sentences. So instead of saying this is a cat in the picture, you already heard the little girl telling us this is a cat lying on a bed.

Đợi một chút, có phải là vậy không? Phải chăng máy vi tính thực sự đã đạt được hay thậm chí vượt qua khả năng con người? Không nhanh vậy đâu. Cho tới nay, chúng ta mới chỉ dạy cho máy vi tính nhìn thấy những vật thể. Cái này giống như một đứa trẻ học cách bật ra một vài danh từ. Đó là một thành tựu đáng kinh ngạc, nhưng nó mới chỉ là bước đầu tiên. Nhanh thôi, những cột mốc phát triển khác sẽ đạt được, và trẻ em bắt đầu giao tiếp bằng những câu. Vì vậy thay vì nói đây là một con mèo trong bức tranh, bạn thật sự đã nghe đứa trẻ nhỏ nói rằng đây là một con mèo nằm trên một cái giường

So to teach a computer to see a picture and generate sentences, the marriage between big data and machine learning algorithm has to take another step. Now, the computer has to learn from both pictures as well as natural language sentences generated by humans. Just like the brain integrates vision and language, we developed a model that connects parts of visual things like visual snippets with words and phrases in sentences.

Vì thế mà dạy một chiếc máy tính nhìn một ảnh và cấu thành những câu nói, sự liên kết giữa những dữ liệu lớn và thuật toán phải tiếp tục những bước tiếp theo. Bây giờ, chiếc máy tính phải học cả những hình ảnh lẫn ngôn ngữ câu tự nhiên được tạo lập bởi con người. Giống như não bộ kết hợp giữa cái nhìn và ngôn ngữ, chúng tôi phát triển một hình mẫu liên kết những phần của những vật thể giống như những mẩu thông tin có thể trông thấy được với những từ ngữ và cụm từ trong câu.

About four months ago, we finally tied all this together and produced one of the first computer vision models that is capable of generating a human-like sentence when it sees a picture for the first time. Now, I'm ready to show you what the computer says when it sees the picture that the little girl saw at the beginning of this talk.

Khoảng 4 tháng trước, chúng tôi cuối cùng cũng liên kết chúng lại với nhau và tạo ra một trong những hình mẫu máy tính có thị giác đầu tiên có khả năng tạo ra một câu giống như con người khi nó thấy một bức ảnh lần đầu tiên. Bây giờ, tôi sẵn sàng cho bạn thấy điều mà máy vi tính nói khi nó trông thấy bức ảnh mà cô gái nhỏ đã thấy ở phần mở đầu của bài nói này.

(Video) Computer: A man is standing next to an elephant. A large airplane sitting on top of an airport runway.

(Video) Máy vi tính: Một người đàn ông đang đứng cạnh một con voi. Một máy bay lớn đậu phía trên một đường băng sân bay.

FFL: Of course, we're still working hard to improve our algorithms, and it still has a lot to learn. (Applause)

FFL: Dĩ nhiên, chúng tôi vẫn đang làm việc chăm chỉ để phát triển những thuật toán, và vẫn còn rất nhiều thứ để học (vỗ tay)

And the computer still makes mistakes.

Và máy tính vẫn còn mắc nhiều lỗi.

(Video) Computer: A cat lying on a bed in a blanket.

(Video) Máy tinh: một con mèo đang nằm trong chăn trên một cái giường

FFL: So of course, when it sees too many cats, it thinks everything might look like a cat.

FFL: Nên đương nhiên, khi nó nhìn thấy quá nhiều mèo nó sẽ nghĩ mọi thứ có thể nhìn giống như một con mèo.

(Video) Computer: A young boy is holding a baseball bat. (Laughter)

Máy tính: Một chàng trai trẻ đang cầm một cái vợt bóng chày (cười lớn)

FFL: Or, if it hasn't seen a toothbrush, it confuses it with a baseball bat.

FFL: Nếu nó chưa bao giờ thấy bàn chải, nó sẽ nhầm lẫn với một cái vợt bóng chày

(Video) Computer: A man riding a horse down a street next to a building. (Laughter)

Máy tính: Người đàn ông đang cưỡi ngựa xuống một con đường gần một tòa nhà. (cười lớn)

FFL: We haven't taught Art 101 to the computers.

FFL: Chúng tôi chưa dạy môn nghệ thuật cơ bản cho máy tính

(Video) Computer: A zebra standing in a field of grass.

Máy tính: Một con ngựa vằn đang đứng trên một bãi cỏ.

FFL: And it hasn't learned to appreciate the stunning beauty of nature like you and I do.

FFL: Và nó chưa được học để trân trọng vẻ đẹp tuyệt mỹ của thiên nhiên như tôi và bạn.

So it has been a long journey. To get from age zero to three was hard. The real challenge is to go from three to 13 and far beyond. Let me remind you with this picture of the boy and the cake again. So far, we have taught the computer to see objects or even tell us a simple story when seeing a picture.

Vì thế nó là một hành trình dài. Để đi từ 0 tuổi đến 3 tuổi là đã khó. Thử thách thực sự là đi từ 3 đến 13 tuổi và còn xa hơn nữa. Để tôi nhắc cho bạn bức ảnh này về một bé trai và chiếc bánh một lần nữa. Trước đó, chúng ta đã dạy máy tính nhìn thấy những vật thể hoặc kể một câu chuyện đơn giản khi nhìn thấy một bức ảnh.

(Video) Computer: A person sitting at a table with a cake.

Máy tính: Một người ngồi trên một cái bàn với một cái bánh.

FFL: But there's so much more to this picture than just a person and a cake. What the computer doesn't see is that this is a special Italian cake that's only served during Easter time. The boy is wearing his favorite t-shirt given to him as a gift by his father after a trip to Sydney, and you and I can all tell how happy he is and what's exactly on his mind at that moment.

FFL: Nhưng còn rất nhiều thứ về bức ảnh này hơn là chỉ một người và một cái bánh. Điều mà máy tính không thấy được đây là một chiếc bánh kiếu Ý rất đặc biệt chỉ ăn vào dịp Phục Sinh. Thằng bé đang mặc chiếc áo thun yêu thích của nó trao cho cậu như một món quà của bố cậu sau một chuyến đi đến Sydney. và bạn và tôi có thể thấy được cậu bé trông vui đến thế nào và điều thực sự trong tâm trí của nó vào lúc đó.

This is my son Leo. On my quest for visual intelligence, I think of Leo constantly and the future world he will live in. When machines can see, doctors and nurses will have extra pairs of tireless eyes to help them to diagnose and take care of patients. Cars will run smarter and safer on the road. Robots, not just humans, will help us to brave the disaster zones to save the trapped and wounded. We will discover new species, better materials, and explore unseen frontiers with the help of the machines.

Đây là con trai tôi Leo. Trong khi nghiên cứu về trí thông minh hình ảnh, tôi không ngừng nghĩ về Leo và tương lai mà nó sẽ sống. Khi những chiếc máy có thể nhìn, bác sĩ và y tá sẽ có thêm những đôi mắt không mệt mỏi để giúp họ chẩn đoán và chăm sóc bệnh nhân. Những chiếc xe sẽ chạy nhanh hơn và an toàn hơn trên đường. Robots, không chỉ con người, giúp chúng ta đến với khu vực bị thiên tai để cứu những người mắc kẹt và thương vong. Và chúng ta sẽ khám phá ra những loài mới, vật liệu tốt hơn, và khám phá những biên giới chưa tưng thấy với sự giúp đỡ của máy móc.

Little by little, we're giving sight to the machines. First, we teach them to see. Then, they help us to see better. For the first time, human eyes won't be the only ones pondering and exploring our world. We will not only use the machines for their intelligence, we will also collaborate with them in ways that we cannot even imagine.

Từng chút từng chút một, chúng ta cho máy móc thị giác. Đầu tiên, chúng ta dạy chúng cách nhìn. Sau đó, chúng sẽ giúp chúng ta nhìn rõ hơn. Lần đầu tiên, đôi mắt của con người không còn là thứ duy nhất nghĩ ngợi và khám phá thế giới này. Chúng ta sẽ không chỉ sử dụng máy móc nhờ sự thông minh của chúng, chúng ta còn có thể hợp tác với chúng theo những cách không thể tưởng tượng nỗi.

This is my quest: to give computers visual intelligence and to create a better future for Leo and for the world.

Đây là mong muốn của tôi: cho máy tính sự thông minh thị giác và tạo ra một tương lai tốt hơn cho Leo và cho thế giới.

Thank you.

Cám ơn.

(Applause)

(vỗ tay)