Let me show you something.

Дозвольте вам дещо показати.

(Video) Girl: Okay, that's a cat sitting in a bed. The boy is petting the elephant. Those are people that are going on an airplane. That's a big airplane.

(Відео) Дівчинка: Так, це кіт, який сидить на ліжку. Хлопчик гладить слона. Ті люди сідають в літак. Літак дуже великий.

Fei-Fei Li: This is a three-year-old child describing what she sees in a series of photos. She might still have a lot to learn about this world, but she's already an expert at one very important task: to make sense of what she sees. Our society is more technologically advanced than ever. We send people to the moon, we make phones that talk to us or customize radio stations that can play only music we like. Yet, our most advanced machines and computers still struggle at this task. So I'm here today to give you a progress report on the latest advances in our research in computer vision, one of the most frontier and potentially revolutionary technologies in computer science.

Фей-Фей Лі: Це трирічна дитина, яка описує те, що бачить на фотографіях. Ще багато чого їй треба вивчити про цей світ, проте вже зараз їй під силу одне дуже важливе завдання: вона розуміє, що вона бачить. Наше суспільство найбільш технологічно розвинене, ніж будь-коли. Ми відправляємо людей на місяць, ми створюємо телефони, які говорять, ми налаштовуємо радіостанції так, щоб вони грали лише нашу улюблену музику. Проте наші найбільш передові механізми і комп'ютери все ще не можуть впоратися з цим завданням. Сьогодні я тут, щоб розповісти вам про найостанніші досягнення у наших дослідженнях комп'ютерного розпізнавання об'єктів, однієї з найбільш передових і потенційно революційних технологій в комп'ютерній науці.

Yes, we have prototyped cars that can drive by themselves, but without smart vision, they cannot really tell the difference between a crumpled paper bag on the road, which can be run over, and a rock that size, which should be avoided. We have made fabulous megapixel cameras, but we have not delivered sight to the blind. Drones can fly over massive land, but don't have enough vision technology to help us to track the changes of the rainforests. Security cameras are everywhere, but they do not alert us when a child is drowning in a swimming pool. Photos and videos are becoming an integral part of global life. They're being generated at a pace that's far beyond what any human, or teams of humans, could hope to view, and you and I are contributing to that at this TED. Yet our most advanced software is still struggling at understanding and managing this enormous content. So in other words, collectively as a society, we're very much blind, because our smartest machines are still blind.

Так, ми розробили прототипи машин, які можуть самостійно рухатися, але без розумного розпізнавання, для них не буде різниці між зім'ятим пакетом на дорозі, по якому можна проїхати, і камінням такого розміру, що його краще об'їхати. Ми створили неймовірні мегапіксельні фотокамери, але ми не навчили сліпих бачити. Безпілотні літаки можуть літати на величезні відстані, але не мають достатніх розпізнавальних технологій, щоб допомогти нам прослідкувати за змінами в тропічних лісах. Ми скрізь маємо камери відеоспостереження, але вони не попереджають нас, коли дитина тоне в басейні. Фото та відео стали невід'ємними частинами глобального життя. Вони накопичуються з такою швидкістю, що людина або група людей не можуть навіть сподіватися на те, щоб переглянути їх усі, і ми з вами робимо свій внесок у це на TED сьогодні. Проте наші найпередовіші програми все ще намагаються навчитися керувати цією численною базою даних. Іншими словами, ми всі як суспільство залишаємося достатньо сліпими, оскільки наші найрозумніші машини все ще сліпі.

"Why is this so hard?" you may ask. Cameras can take pictures like this one by converting lights into a two-dimensional array of numbers known as pixels, but these are just lifeless numbers. They do not carry meaning in themselves. Just like to hear is not the same as to listen, to take pictures is not the same as to see, and by seeing, we really mean understanding. In fact, it took Mother Nature 540 million years of hard work to do this task, and much of that effort went into developing the visual processing apparatus of our brains, not the eyes themselves. So vision begins with the eyes, but it truly takes place in the brain.

Ви можете запитати: "Чому це так важко?" Камери роблять знімки, такі як ось цей, шляхом перетворення світла на двовимірну сукупність цифр, відомих як пікселі, але це лише мертві цифри. Вони самі по собі не несуть значення. Так само, як слухати не одне й те саме, що чути, робити фото не одне й те саме, що бачити, а під баченням ми маємо на увазі розуміння. Насправді, матері природі знадобилося 540 млн. років важкої роботи, щоб впоратися з цим завданням, і більшість з її зусиль було спрямовано на розвиток в нашому мозку органу з обробки візуальної інформації, і це не лише очі. Бачення розпочинається з очей, але насправді відбувається в мозку.

So for 15 years now, starting from my Ph.D. at Caltech and then leading Stanford's Vision Lab, I've been working with my mentors, collaborators and students to teach computers to see. Our research field is called computer vision and machine learning. It's part of the general field of artificial intelligence. So ultimately, we want to teach the machines to see just like we do: naming objects, identifying people, inferring 3D geometry of things, understanding relations, emotions, actions and intentions. You and I weave together entire stories of people, places and things the moment we lay our gaze on them.

Вже 15 років, починаючи з отримання докторського ступеня в Калтех і потім, очоливши Стенфордську лабораторію Vision Lab, я працюю з моїми наставниками, співробітниками і студентами, щоб навчити комп'ютери бачити. Наша сфера дослідження називається комп'ютерне бачення та машинне навчання, що є складовою частиною сфери штучного інтелекту. Тож, в кінцевому рахунку, ми хочемо навчити машини бачити так само, як ми: називати об'єкти, розпізнавати людей, виводити 3D геометрію речей, розуміти стосунки, емоції, дії та наміри. Ми з вами складаємо цілі історії про людей, місця та речі, лише глянувши на них.

The first step towards this goal is to teach a computer to see objects, the building block of the visual world. In its simplest terms, imagine this teaching process as showing the computers some training images of a particular object, let's say cats, and designing a model that learns from these training images. How hard can this be? After all, a cat is just a collection of shapes and colors, and this is what we did in the early days of object modeling. We'd tell the computer algorithm in a mathematical language that a cat has a round face, a chubby body, two pointy ears, and a long tail, and that looked all fine. But what about this cat? (Laughter) It's all curled up. Now you have to add another shape and viewpoint to the object model. But what if cats are hidden? What about these silly cats? Now you get my point. Even something as simple as a household pet can present an infinite number of variations to the object model, and that's just one object.

Перший крок до досягнення цієї мети - навчити комп'ютер бачити об'єкти, будівельні блоки нашого візуального світу. Простими словами, уявіть цей процес навчання, як демонстрацію комп'ютерам певних тренувальних зображень конкретних об'єктів, скажімо, котів, і розробку моделей, які б навчалися, споглядаючи ці зображення. Наскільки це може бути складно? Адже кіт - це всього лише сукупність форм і кольорів, і раніше саме так ми і підходили до моделювання об'єкту. Ми задавали комп'ютеру алгоритм математичною мовою, що кіт має круглу морду, пухке тіло, два загострених вуха і довгого хвоста, і цього було достатньо. Але як щодо цього кота? (Сміх) Він увесь вигнутий. Тож потрібно додати іншу форму та іншу перспективу до моделі об'єкта. Але що як кіт сховався? Як щодо цих грайливих котів? Ви мене зрозуміли. Навіть така проста річ, як домашня тварина може привнести до моделі об'єкту численну кількість варіацій, а це ж лише один об'єкт.

So about eight years ago, a very simple and profound observation changed my thinking. No one tells a child how to see, especially in the early years. They learn this through real-world experiences and examples. If you consider a child's eyes as a pair of biological cameras, they take one picture about every 200 milliseconds, the average time an eye movement is made. So by age three, a child would have seen hundreds of millions of pictures of the real world. That's a lot of training examples. So instead of focusing solely on better and better algorithms, my insight was to give the algorithms the kind of training data that a child was given through experiences in both quantity and quality.

Майже вісім років тому, дуже просте і глибоке спостереження змінило напрям моїх думок. Ніхто не говорить дитині, як треба бачити, особливо у перші роки. Вони навчаються цьому через досвід та на прикладах з реального світу. Якщо розглядати очі дитини як пару біологічних камер, вони сприймають одне зображення приблизно кожних 200 мілісекунд, середній час для руху ока. Тож до трирічного віку дитина побачить сотні мільйонів зображень реального світу. Це дуже багато учбових прикладів. Тож, замість того, щоб зосереджуватися виключно на покращенні алгоритмів, мій здогад полягає в тому, щоб дати алгоритмам певний вид тренувальних даних, кількісно і якісно схожих на ті, які дитина отримує через досвід.

Once we know this, we knew we needed to collect a data set that has far more images than we have ever had before, perhaps thousands of times more, and together with Professor Kai Li at Princeton University, we launched the ImageNet project in 2007. Luckily, we didn't have to mount a camera on our head and wait for many years. We went to the Internet, the biggest treasure trove of pictures that humans have ever created. We downloaded nearly a billion images and used crowdsourcing technology like the Amazon Mechanical Turk platform to help us to label these images. At its peak, ImageNet was one of the biggest employers of the Amazon Mechanical Turk workers: together, almost 50,000 workers from 167 countries around the world helped us to clean, sort and label nearly a billion candidate images. That was how much effort it took to capture even a fraction of the imagery a child's mind takes in in the early developmental years.

Як тільки ми це зрозуміли, нам необхідно було зібрати сукупність даних, яка включатиме в себе значно більше зображень, ніж ми мали до цього, можливо, в тисячі разів більше. Разом з професором з Прінстонського університету Кай Лі ми заснували проект ImageNet у 2007 році. На щастя, нам не довелося встановлювати камери на голови і чекати протягом багатьох років. Ми звернулися до Інтернету, найбільшої колекції зображень за всю історію людства. Ми завантажили близько мільярда зображень і за допомогою такої платформи краудсорсингу, як Amazon Mechanical Turk, ми дали назву кожному зображенню. На своєму піку ImageNet була одним з найбільших роботодавців для працівників на Amazon Mechanical Turk: разом майже 50 000 працівників з 167 країн світу допомагали нам чистити, сортувати та називати майже мільярд зображень-кандидатів. От скільки знадобилося зусиль, щоб охопити хоча б частину зображень, які дитячий мозок сприймає у перші роки життя.

In hindsight, this idea of using big data to train computer algorithms may seem obvious now, but back in 2007, it was not so obvious. We were fairly alone on this journey for quite a while. Some very friendly colleagues advised me to do something more useful for my tenure, and we were constantly struggling for research funding. Once, I even joked to my graduate students that I would just reopen my dry cleaner's shop to fund ImageNet. After all, that's how I funded my college years.

Зараз ця ідея щодо використання великої кількості даних для навчання комп'ютерних алгоритмів, може адаватися очевидною. Але у 2007 вона не була настільки очевидною. Певний час ми були абсолютно самотніми на цьому шляху. Деякі дружні колеги радили мені робити щось більш корисне на моїй посаді, і ми постійно намагалися знайти фінансування для нашого дослідження. Якось я навіть пожартувала перед моїми випускниками, що я б знову відкрила свою хімчистку, аби фінансувати ImageNet. Саме так я заробляла гроші, навчаючись в коледжі.

So we carried on. In 2009, the ImageNet project delivered a database of 15 million images across 22,000 classes of objects and things organized by everyday English words. In both quantity and quality, this was an unprecedented scale. As an example, in the case of cats, we have more than 62,000 cats of all kinds of looks and poses and across all species of domestic and wild cats. We were thrilled to have put together ImageNet, and we wanted the whole research world to benefit from it, so in the TED fashion, we opened up the entire data set to the worldwide research community for free. (Applause)

Тож ми продовжували. У 2009 проект ImageNet мав базу даних у 15 мільйонів зображень з 22 000 класів об'єктів і речей, впорядкованих щоденними англійськими словами. Кількісно і якісно це був безпрецедентний масштаб. Для прикладу, у випадку з котами ми мали більше 62 000 котів з усіма видами зовнішності і в усіх позах, а також усіх порід, як домашніх, так і диких. Ми були у захваті від досягнення ImageNet, і хотіли, щоб увесь науковий світ мав користь з цього, тож, за зразком TED, ми відкрили усі дані для усього наукового світу безкоштовно. (Оплески)

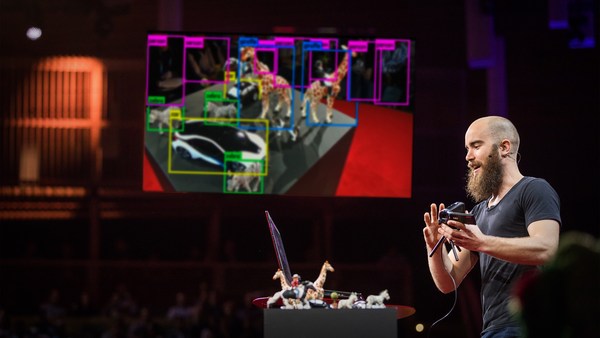

Now that we have the data to nourish our computer brain, we're ready to come back to the algorithms themselves. As it turned out, the wealth of information provided by ImageNet was a perfect match to a particular class of machine learning algorithms called convolutional neural network, pioneered by Kunihiko Fukushima, Geoff Hinton, and Yann LeCun back in the 1970s and '80s. Just like the brain consists of billions of highly connected neurons, a basic operating unit in a neural network is a neuron-like node. It takes input from other nodes and sends output to others. Moreover, these hundreds of thousands or even millions of nodes are organized in hierarchical layers, also similar to the brain. In a typical neural network we use to train our object recognition model, it has 24 million nodes, 140 million parameters, and 15 billion connections. That's an enormous model. Powered by the massive data from ImageNet and the modern CPUs and GPUs to train such a humongous model, the convolutional neural network blossomed in a way that no one expected. It became the winning architecture to generate exciting new results in object recognition. This is a computer telling us this picture contains a cat and where the cat is. Of course there are more things than cats, so here's a computer algorithm telling us the picture contains a boy and a teddy bear; a dog, a person, and a small kite in the background; or a picture of very busy things like a man, a skateboard, railings, a lampost, and so on. Sometimes, when the computer is not so confident about what it sees, we have taught it to be smart enough to give us a safe answer instead of committing too much, just like we would do, but other times our computer algorithm is remarkable at telling us what exactly the objects are, like the make, model, year of the cars.

Наразі, маючи дані для наповнення мозку комп'ютера, ми готові повернутися до алгоритмів. Виявилося, що та велика кількість інформації, отримана з ImageNet, ідеально підходить для конкретного класу навчальних алгоритмів для машин, який називається "згорнутою нейронною мережею", що була розроблена Куніхіко Фукушімою, Геоффом Гінтоном та Янном Лекуном у 1970 - 80-х роках. Подібно до мозку, який складається з мільйонів поєднаних нейронів, базова операційна одиниця в нейронній мережі складається з нейроноподібних вузлів. Вона приймає інформацію від одних вузлів і передає її до інших. Більше того, ці сотні тисяч, або навіть мільйони вузлів організовані в ієрархічні шари, так само, як і мозок. Типова нейронна мережа, яку ми використовуємо для тренування нашої моделі розпізнавання об'єкту, має 24 мільйони вузлів, 140 мільйонів параметрів і 15 мільярдів зв'язків. Це величезна модель. Оснащена великою кількістю даних з ImageNet і сучасними процесорами, для тренування такої гігантської моделі, згорнута нейронна мережа продемонструвала неочікувані результати. ЇЇ виграшна архітектура демонструє неймовірні нові результати у розпізнаванні об'єкта. Це комп'ютер говорить нам, що на фото є кіт і де саме кіт знаходиться. Звичайно, на фото є й інші речі, окрім котів, тож комп'ютерний алгоритм каже нам, що на фото є хлопець і плюшевий ведмедик; собака, людина і маленький паперовий змій на задньому плані; або фото, на якому багато всього: чоловік, скейтборд, огорожа, ліхтарний стовп і так далі. У випадках, коли комп'ютер не впевнений у тому, що він бачить, ми навчили його бути достатньо розумним і давати припущення, а не брати на себе забагато, як і ми самі зробили б. Проте у інших випадках алгоритм нашого комп'ютера з вражаючою точністю називає об'єкти, такі як марка, модель та рік випуску машин.

We applied this algorithm to millions of Google Street View images across hundreds of American cities, and we have learned something really interesting: first, it confirmed our common wisdom that car prices correlate very well with household incomes. But surprisingly, car prices also correlate well with crime rates in cities, or voting patterns by zip codes.

Застосувавши цей алгоритм до мільйонів зображень Google Street View, які включають сотні американських міст, ми виявили дещо дуже цікаве: по-перше, він підтвердив відому істину про те, що ціни на машини залежать від прибутків домашніх господарств. Але неочікувано виявилося, що ціни на машини також корелюються з рівнем злочинності в містах, і навіть з моделлю голосування в різних штатах.

So wait a minute. Is that it? Has the computer already matched or even surpassed human capabilities? Not so fast. So far, we have just taught the computer to see objects. This is like a small child learning to utter a few nouns. It's an incredible accomplishment, but it's only the first step. Soon, another developmental milestone will be hit, and children begin to communicate in sentences. So instead of saying this is a cat in the picture, you already heard the little girl telling us this is a cat lying on a bed.

Зачекайте хвилинку. Чи це вже воно? Чи комп'ютер вже досяг чи навіть перевищив людські можливості? Не так швидко. Наразі ми навчили комп'ютер бачити об'єкти. Так само, як немовля вчиться вимовляти слова. Це неймовірне досягнення, але це лише перший крок. Згодом буде досягнуто наступний етап розвитку, коли діти починають спілкуватися за допомогою речень. Замість того, щоб сказати, що на фото є кіт, маленька дівчинка каже нам, що є кіт, який лежить на ліжку.

So to teach a computer to see a picture and generate sentences, the marriage between big data and machine learning algorithm has to take another step. Now, the computer has to learn from both pictures as well as natural language sentences generated by humans. Just like the brain integrates vision and language, we developed a model that connects parts of visual things like visual snippets with words and phrases in sentences.

Щоб навчити комп'ютер бачити фото і формулювати речення, тісний союз між величезною кількістю даних та навчальним алгоритмом для машин повинен запрацювати на новому рівні. Зараз комп'ютер повинен навчатися, використовуючи як фото, так і речення природної мови, за допомогою яких спілкуються люди. Подібно до того, як мозок поєднує бачення та мову, ми розробили модель, яка поєднує частини візуальних речей, таких як візуальні фрагменти, зі словами та фразами у реченнях.

About four months ago, we finally tied all this together and produced one of the first computer vision models that is capable of generating a human-like sentence when it sees a picture for the first time. Now, I'm ready to show you what the computer says when it sees the picture that the little girl saw at the beginning of this talk.

Близько 4 місяців тому, ми нарешті поєднали усе це докупи і створили одну з перших моделей комп'ютерного розпізнавання, яка здатна створювати подібні до людських речення, коли бачить фото вперше. Зараз я продемонструю вам, що говорить комп'ютер, коли бачить фото, які описувала маленька дівчинка на початку моєї доповіді.

(Video) Computer: A man is standing next to an elephant. A large airplane sitting on top of an airport runway.

(Відео) Комп'ютер: Чоловік стоїть поряд зі слоном. Великий літак стоїть на злітно-посадковій смузі.

FFL: Of course, we're still working hard to improve our algorithms, and it still has a lot to learn. (Applause)

ФФЛ: Звичайно, ми продовжуємо наполегливо працювати над удосконаленням алгоритмів, і йому ще треба багато чого навчитися. (Оплески)

And the computer still makes mistakes.

Комп'ютер все ще допускає помилки.

(Video) Computer: A cat lying on a bed in a blanket.

(Відео) Комп'ютер: Кіт лежить на ліжку в ковдрі.

FFL: So of course, when it sees too many cats, it thinks everything might look like a cat.

ФФЛ: Звичайно, коли він бачить дуже багато котів, він вважає, що все має виглядати, як кіт.

(Video) Computer: A young boy is holding a baseball bat. (Laughter)

(Відео) Комп'ютер: Хлопець тримає бейсбольну біту. (Сміх)

FFL: Or, if it hasn't seen a toothbrush, it confuses it with a baseball bat.

ФФЛ: Або, якщо він не бачив зубну щітку, він переплутає її з бейсбольною битою.

(Video) Computer: A man riding a horse down a street next to a building. (Laughter)

(Відео) Комп'ютер: Чоловік їде на коні по вулиці біля будинку. (Сміх)

FFL: We haven't taught Art 101 to the computers.

ФФЛ: Ми не вчили комп'ютери розуміти мистецтво.

(Video) Computer: A zebra standing in a field of grass.

(Відео) Комп'ютер: Зебра стоїть на полі, вкритому травою.

FFL: And it hasn't learned to appreciate the stunning beauty of nature like you and I do.

ФФЛ: Він не навчився цінувати надзвичайну красу природи, як це робимо ми з вами.

So it has been a long journey. To get from age zero to three was hard. The real challenge is to go from three to 13 and far beyond. Let me remind you with this picture of the boy and the cake again. So far, we have taught the computer to see objects or even tell us a simple story when seeing a picture.

Ми пройшли довгий шлях. Було важко дістатися від 0 до 3 років. Але справжній виклик - це пройти від 3 років до 13 і далі. Дозвольте мені нагадати вам це фото з хлопчиком і пирогом. Ми вже навчили комп'ютер бачити об'єкти і навіть розповідати прості історії про те, що він бачить на фото.

(Video) Computer: A person sitting at a table with a cake.

(Відео) Комп'ютер: Людина сидить за столом з пирогом.

FFL: But there's so much more to this picture than just a person and a cake. What the computer doesn't see is that this is a special Italian cake that's only served during Easter time. The boy is wearing his favorite t-shirt given to him as a gift by his father after a trip to Sydney, and you and I can all tell how happy he is and what's exactly on his mind at that moment.

ФФЛ: Але на фото присутні значно більше об'єктів, ніж лише людина і пиріг. Повз увагу комп'ютера проходить те, що це спеціальний італійський пиріг, який їдять виключно на Паску. Хлопець одягнутий у свою улюблену футболку, яку йому батько привіз із Сіднею. Ми з вами можемо сказати, наскільки він щасливий і що саме у нього на думці в цей момент.

This is my son Leo. On my quest for visual intelligence, I think of Leo constantly and the future world he will live in. When machines can see, doctors and nurses will have extra pairs of tireless eyes to help them to diagnose and take care of patients. Cars will run smarter and safer on the road. Robots, not just humans, will help us to brave the disaster zones to save the trapped and wounded. We will discover new species, better materials, and explore unseen frontiers with the help of the machines.

Це мій син Лео. У моїх пошуках візуального інтелекту я постійно думаю про Лео і майбутній світ, у якому йому доведеться жити. Коли машини зможуть бачити, лікарі та медсестри отримають додаткові пари невтомних очей, які допомагатимуть їм у діагностуванні та догляді за хворими. Машини їздитимуть обачніше і безпечніше на дорогах. Роботи, а не лише люди, допомагатимуть у зонах катастроф рятувати поранених людей. За допомогою машин ми відкриємо нові види, кращі матеріали і дослідимо небачені нові можливості.

Little by little, we're giving sight to the machines. First, we teach them to see. Then, they help us to see better. For the first time, human eyes won't be the only ones pondering and exploring our world. We will not only use the machines for their intelligence, we will also collaborate with them in ways that we cannot even imagine.

Потроху ми даємо машинам зір. Спочатку ми вчимо їх бачити. Потім вони допоможуть нам бачити краще. Вперше людські очі вже не єдині, що можуть спостерігати і досліджувати наш світ. Ми не лише будемо використовувати інтелект машин, ми також будемо співпрацювати з ними різними неймовірними способами.

This is my quest: to give computers visual intelligence and to create a better future for Leo and for the world.

Я бачу своє завдання у тому, щоб надати комп'ютерам візуальний інтелект і створити краще майбутнє для Лео і для світу.

Thank you.

Дякую

(Applause)

(Оплески)