Let me show you something.

Позвольте вам кое-что показать.

(Video) Girl: Okay, that's a cat sitting in a bed. The boy is petting the elephant. Those are people that are going on an airplane. That's a big airplane.

(Видео) Девочка: Кот сидит на кровати. Мальчик гладит слона. Люди садятся в самолёт. Это большой самолёт.

Fei-Fei Li: This is a three-year-old child describing what she sees in a series of photos. She might still have a lot to learn about this world, but she's already an expert at one very important task: to make sense of what she sees. Our society is more technologically advanced than ever. We send people to the moon, we make phones that talk to us or customize radio stations that can play only music we like. Yet, our most advanced machines and computers still struggle at this task. So I'm here today to give you a progress report on the latest advances in our research in computer vision, one of the most frontier and potentially revolutionary technologies in computer science.

Фей-Фей Ли: Трёхлетняя девочка описывает то, что она видит на фотографиях. Ей предстоит ещё много узнать об этом мире, но она уже довольно искусно справляется с очень важной задачей: она осознаёт то, что видит. Наше общество технологически развито больше, чем когда-либо. Мы отправляем людей на Луну, создаём телефоны, которые говорят с нами, и настраиваем радиостанции, чтобы слушать только такую музыку, которая нам нравится. Но эта задача всё ещё не под силу нашим самым продвинутым механизмам и компьютерам. Сегодня я выступлю перед вами с докладом о наших последних достижениях в области машинного зрения, одной из самых передовых и потенциально революционных технологий в области компьютерных наук.

Yes, we have prototyped cars that can drive by themselves, but without smart vision, they cannot really tell the difference between a crumpled paper bag on the road, which can be run over, and a rock that size, which should be avoided. We have made fabulous megapixel cameras, but we have not delivered sight to the blind. Drones can fly over massive land, but don't have enough vision technology to help us to track the changes of the rainforests. Security cameras are everywhere, but they do not alert us when a child is drowning in a swimming pool. Photos and videos are becoming an integral part of global life. They're being generated at a pace that's far beyond what any human, or teams of humans, could hope to view, and you and I are contributing to that at this TED. Yet our most advanced software is still struggling at understanding and managing this enormous content. So in other words, collectively as a society, we're very much blind, because our smartest machines are still blind.

Да, мы создали прототипы беспилотных автомобилей, но без компьютерного зрения они не смогут отличить на дороге бумажный пакет, по которому можно проехать, от камня похожего размера, который стоит объехать. Мы создали замечательные мегапиксельные камеры, но не смогли вернуть зрение слепым. Беспилотные аппараты могут преодолевать огромные расстояния, но не обладают достаточной технологией зрения, чтобы помочь нам отслеживать динамику вырубки тропических лесов. Повсюду находятся камеры видеонаблюдения, но они не могут предупредить нас о тонущем в бассейне ребёнке. Фотографии и видеоролики становятся неотъемлемой частью нашей жизни. Они накапливаются с такой скоростью, что их все невозможно просмотреть ни одному человеку, ни группе людей. Мы, участники TED, тоже этому поспособствовали. Нашему самому продвинутому программному обеспечению не под силу воспринимать этот огромный массив данных и управлять им. Иначе говоря, коллективно наше общество слепо, потому что наши самые умные машины всё ещё не умеют видеть.

"Why is this so hard?" you may ask. Cameras can take pictures like this one by converting lights into a two-dimensional array of numbers known as pixels, but these are just lifeless numbers. They do not carry meaning in themselves. Just like to hear is not the same as to listen, to take pictures is not the same as to see, and by seeing, we really mean understanding. In fact, it took Mother Nature 540 million years of hard work to do this task, and much of that effort went into developing the visual processing apparatus of our brains, not the eyes themselves. So vision begins with the eyes, but it truly takes place in the brain.

«Почему же это так сложно?» — спросите вы. Фотокамеры могут делать вот такие фотографии, преобразовывая свет в двухмерную числовую последовательность, известную как «пиксели». Но это просто числа. Они не несут в себе никакого смысла. Так же, как «слышать» — не то же самое, что «слушать», «делать» фотографии — не то же самое, что «видеть» их, а под «видеть», конечно же, имеется в виду «понимать». Природе пришлось усердно трудиться в течение 540 миллионов лет, чтобы решить эту задачу, и многие из этих усилий были направлены на создание аппарата обработки визуальных данных в нашем мозге, а не глаз как таковых. Зрение начинается с глаз, но фактически происходит в мозге.

So for 15 years now, starting from my Ph.D. at Caltech and then leading Stanford's Vision Lab, I've been working with my mentors, collaborators and students to teach computers to see. Our research field is called computer vision and machine learning. It's part of the general field of artificial intelligence. So ultimately, we want to teach the machines to see just like we do: naming objects, identifying people, inferring 3D geometry of things, understanding relations, emotions, actions and intentions. You and I weave together entire stories of people, places and things the moment we lay our gaze on them.

В течение вот уже 15 лет, начиная с аспирантуры в Калтехе, а затем возглавляя стэнфордскую лабораторию зрения, я работаю вместе с наставниками, коллегами и студентами, обучая компьютеры видеть. Сфера наших исследований — машинное зрение и обучение машин. Это часть области под названием искусственный интеллект. Наша главная задача — научить машины видеть, так как это можем мы: называть объекты, узнавать людей, использовать трёхмерную геометрию вещей, понимать отношения, эмоции, действия и намерения. Мы можем создавать целые истории о людях, местах, вещах — стоит нам только на них взглянуть.

The first step towards this goal is to teach a computer to see objects, the building block of the visual world. In its simplest terms, imagine this teaching process as showing the computers some training images of a particular object, let's say cats, and designing a model that learns from these training images. How hard can this be? After all, a cat is just a collection of shapes and colors, and this is what we did in the early days of object modeling. We'd tell the computer algorithm in a mathematical language that a cat has a round face, a chubby body, two pointy ears, and a long tail, and that looked all fine. But what about this cat? (Laughter) It's all curled up. Now you have to add another shape and viewpoint to the object model. But what if cats are hidden? What about these silly cats? Now you get my point. Even something as simple as a household pet can present an infinite number of variations to the object model, and that's just one object.

Первый шаг к этой цели — научить машины видеть объекты, стандартные элементы визуального мира. Простыми словами, процесс обучения — это демонстрация компьютеру некоторых обучающих изображений определённых объектов, например, кошек, и разработка модели, которая обучается на основе данных изображений. Насколько это может быть сложным? Кошка — это просто набор очертаний и цветов, и именно этим мы занимались на заре моделирования объектов. Посредством математического алгоритма мы сообщали компьютеру, что у кошки круглая морда, пухленькое тело, два острых уха и длинный хвост, и этого было достаточно. А как насчёт этого кота? (Смех) Он изогнут непонятно как. Нужно добавить ещё одну форму и точку обзора в модель. А если кот прячется? Как насчёт этих смешных котов? Теперь вы меня понимаете. Даже простой домашний питомец может представлять бесконечное число вариаций в модели объекта, а это всего лишь один объект.

So about eight years ago, a very simple and profound observation changed my thinking. No one tells a child how to see, especially in the early years. They learn this through real-world experiences and examples. If you consider a child's eyes as a pair of biological cameras, they take one picture about every 200 milliseconds, the average time an eye movement is made. So by age three, a child would have seen hundreds of millions of pictures of the real world. That's a lot of training examples. So instead of focusing solely on better and better algorithms, my insight was to give the algorithms the kind of training data that a child was given through experiences in both quantity and quality.

Где-то восемь лет назад простое, но значительное наблюдение изменило ход моих мыслей. Никто не говорит ребёнку, как надо видеть, особенно в ранние годы жизни. Он учится этому на реальных примерах. Если предположить, что глаза ребёнка — это пара биологических камер, то они делают один снимок каждые 200 миллисекунд, — среднее время движения глазного яблока. К трём годам ребёнок уже увидит сотни миллионов изображений окружающего мира. Это очень много обучающих примеров. И вместо того, чтобы улучшать алгоритмы, я предложила предоставить этим алгоритмам такую же обучающую информацию, которую через опыт получает ребёнок, в таком же количестве и качестве.

Once we know this, we knew we needed to collect a data set that has far more images than we have ever had before, perhaps thousands of times more, and together with Professor Kai Li at Princeton University, we launched the ImageNet project in 2007. Luckily, we didn't have to mount a camera on our head and wait for many years. We went to the Internet, the biggest treasure trove of pictures that humans have ever created. We downloaded nearly a billion images and used crowdsourcing technology like the Amazon Mechanical Turk platform to help us to label these images. At its peak, ImageNet was one of the biggest employers of the Amazon Mechanical Turk workers: together, almost 50,000 workers from 167 countries around the world helped us to clean, sort and label nearly a billion candidate images. That was how much effort it took to capture even a fraction of the imagery a child's mind takes in in the early developmental years.

Как только мы это осознали, мы поняли, что нам нужно было собрать базу данных, содержащую намного больше изображений, чем когда-либо ранее, возможно, в тысячи раз больше. В 2007 году я и профессор Кай Ли из Принстонского университета запустили проект ImageNet. К счастью, нам не пришлось устанавливать камеру себе на голову и ждать много лет. Мы использовали интернет — кладезь изображений, самую большую из созданных человечеством. Мы скачали почти миллиард изображений и для их описания применили краудсорсинг-платформу Amazon Mechanical Turk. На пике активности ImageNet была одним из самых популярных работодателей для сотрудников Amazon Mechanical Turk: порядка 50 000 работников из 167 стран мира помогли нам привести в порядок, отсортировать и описать почти миллиард изображений-кандидатов. Вот сколько потребовалось усилий, чтобы охватить лишь малую часть той базы изображений, которую создаёт мозг ребёнка в ранние годы развития.

In hindsight, this idea of using big data to train computer algorithms may seem obvious now, but back in 2007, it was not so obvious. We were fairly alone on this journey for quite a while. Some very friendly colleagues advised me to do something more useful for my tenure, and we were constantly struggling for research funding. Once, I even joked to my graduate students that I would just reopen my dry cleaner's shop to fund ImageNet. After all, that's how I funded my college years.

Оглядываясь назад, идея использования большого архива данных для обучения компьютеров сейчас может показаться очевидной, но в 2007 году это было далеко не так. Долгое время у нас совсем не было единомышленников. Некоторые дружелюбные коллеги советовали мне заняться более полезным делом, и нам никогда не хватало денег на исследования. Однажды я даже пошутила со своими студентами, что я снова открою свою химчистку, чтобы профинансировать ImageNet. В конце концов, именно с её помощью я оплатила обучение в университете.

So we carried on. In 2009, the ImageNet project delivered a database of 15 million images across 22,000 classes of objects and things organized by everyday English words. In both quantity and quality, this was an unprecedented scale. As an example, in the case of cats, we have more than 62,000 cats of all kinds of looks and poses and across all species of domestic and wild cats. We were thrilled to have put together ImageNet, and we wanted the whole research world to benefit from it, so in the TED fashion, we opened up the entire data set to the worldwide research community for free. (Applause)

И мы продолжили работать. В 2009 году проект ImageNet собрал базу из 15 миллионов изображений, 22 тысяч классов объектов и предметов, упорядоченных при помощи повседневных английских слов. Как количественно, так и качественно это был беспрецедентный по размеру проект. Например, в случае с котами в базе содержится более 62 000 котов разных пород, в разных позах, всех видов, как домашних, так и диких. Мы были на седьмом небе от счастья, когда база ImageNet была готова. Мы хотели, чтобы она принесла пользу всему научному сообществу. И мы, как и TED, открыли бесплатный неограниченный доступ к базе данных для всего мирового научного сообщества. (Аплодисменты)

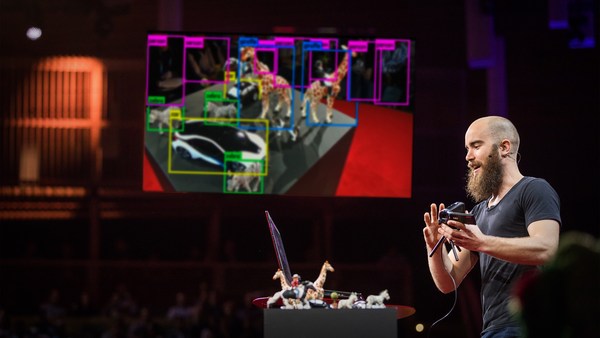

Now that we have the data to nourish our computer brain, we're ready to come back to the algorithms themselves. As it turned out, the wealth of information provided by ImageNet was a perfect match to a particular class of machine learning algorithms called convolutional neural network, pioneered by Kunihiko Fukushima, Geoff Hinton, and Yann LeCun back in the 1970s and '80s. Just like the brain consists of billions of highly connected neurons, a basic operating unit in a neural network is a neuron-like node. It takes input from other nodes and sends output to others. Moreover, these hundreds of thousands or even millions of nodes are organized in hierarchical layers, also similar to the brain. In a typical neural network we use to train our object recognition model, it has 24 million nodes, 140 million parameters, and 15 billion connections. That's an enormous model. Powered by the massive data from ImageNet and the modern CPUs and GPUs to train such a humongous model, the convolutional neural network blossomed in a way that no one expected. It became the winning architecture to generate exciting new results in object recognition. This is a computer telling us this picture contains a cat and where the cat is. Of course there are more things than cats, so here's a computer algorithm telling us the picture contains a boy and a teddy bear; a dog, a person, and a small kite in the background; or a picture of very busy things like a man, a skateboard, railings, a lampost, and so on. Sometimes, when the computer is not so confident about what it sees, we have taught it to be smart enough to give us a safe answer instead of committing too much, just like we would do, but other times our computer algorithm is remarkable at telling us what exactly the objects are, like the make, model, year of the cars.

Сейчас, когда у нас есть база данных, чтобы питать наш компьютерный мозг, мы готовы вернуться к алгоритмам. Как оказалось, база данных, предоставленная ImageNet, точно подходила для определённого класса алгоритмов обучения машин, который называется свёрточная нейронная сеть, начало которому положили Кунихико Фукушима, Джефф Хинтон и Ян ЛеКун ещё в 1970-е и 80-е годы. Так же как и в мозге, состоящем из миллиардов взаимосвязанных нейронов, простейшей операционной единицей нейронной сети является нейроподобный узел. Он принимает входные данные от одних узлов и отправляет выходные данные другим. Более того, сотни тысяч или даже миллионы таких узлов упорядочены по иерархическим уровням, также по аналогии с человеческим мозгом. В обычной нейронной сети, которую мы используем для обучения нашей модели распознавания, содержится 24 миллиона узлов, 140 миллионов параметров и 15 миллиардов связей. Эта модель огромна. Функционирующая на основе базы ImageNet при помощи современных микропроцессоров для обучения этой огромной модели, свёрточная нейронная сеть превзошла все ожидания. Она позволила создать эффективную систему для получения новых многообещающих результатов в распознавании объектов. Вот компьютер, который говорит нам, что на картинке есть кот и где этот кот находится. Конечно, на картинках не только коты. Вот компьютер, который сообщает нам, что на фото мальчик и плюшевый мишка, собака, человек, и маленький воздушный змей на заднем фоне. Или фотография с большим количеством объектов: мужчина, скейтборд, перила, фонарь и т.д. Когда компьютер не уверен в том, что он видит, он обучен действовать по-умному и давать нам наиболее безопасный ответ, без неоправданных рисков, что именно и сделал бы человек. Но бывает и так, что наш алгоритм совершенно безошибочно сообщает нам, какие объекты он видит. Например, марку, модель и год выпуска автомобиля.

We applied this algorithm to millions of Google Street View images across hundreds of American cities, and we have learned something really interesting: first, it confirmed our common wisdom that car prices correlate very well with household incomes. But surprisingly, car prices also correlate well with crime rates in cities, or voting patterns by zip codes.

Мы применили этот алгоритм к миллионам фотографий на Google Street View из сотен американских городов и получили очень интересные результаты. Во-первых, они подтвердили известный факт, что стоимость автомобиля зависит от дохода семьи. Но, к удивлению, цены на автомобили также зависят от уровня преступности в городах или даже модели голосования в разных штатах.

So wait a minute. Is that it? Has the computer already matched or even surpassed human capabilities? Not so fast. So far, we have just taught the computer to see objects. This is like a small child learning to utter a few nouns. It's an incredible accomplishment, but it's only the first step. Soon, another developmental milestone will be hit, and children begin to communicate in sentences. So instead of saying this is a cat in the picture, you already heard the little girl telling us this is a cat lying on a bed.

Минутку. Это свершилось? Компьютеры догнали или даже превзошли человеческие возможности? Не тут-то было. Пока мы научили компьютеры только видеть объекты. Это сродни тому, как маленький ребёнок учится произносить несколько слов. Это невероятное достижение, но это всего лишь первый шаг. Вскоре будет пройден новый этап развития, и ребёнок сможет составлять из слов предложения. И вместо того чтобы сказать, что на картинке кошка, маленькая девочка скажет, что кошка лежит на кровати.

So to teach a computer to see a picture and generate sentences, the marriage between big data and machine learning algorithm has to take another step. Now, the computer has to learn from both pictures as well as natural language sentences generated by humans. Just like the brain integrates vision and language, we developed a model that connects parts of visual things like visual snippets with words and phrases in sentences.

Для того чтобы научить компьютер видеть картинку и составлять предложения, связь между большой базой данных и алгоритмом обучения машин должна выйти на новый уровень. Теперь компьютер должен учиться не только по фотографиям, но и на основе предложений естественного языка, составляемых человеком. Отталкиваясь от факта, что мозг объединяет зрение и язык, мы разработали модель, соединяющую части визуальной картины, как маленькие фрагменты, со словами и фразами в предложениях.

About four months ago, we finally tied all this together and produced one of the first computer vision models that is capable of generating a human-like sentence when it sees a picture for the first time. Now, I'm ready to show you what the computer says when it sees the picture that the little girl saw at the beginning of this talk.

Около четырёх месяцев назад мы привели всё это к общему знаменателю и создали одну из первых моделей компьютерного зрения, способную, подобно человеку, создавать предложения после просмотра фотографии в первый раз. Сейчас я покажу вам, что говорит компьютер, когда видит фотографию, которую описывала девочка в начале этого доклада.

(Video) Computer: A man is standing next to an elephant. A large airplane sitting on top of an airport runway.

(Видео) Компьютер: Рядом со слоном стоит мужчина. Большой самолёт находится на взлётно-посадочной полосе аэропорта.

FFL: Of course, we're still working hard to improve our algorithms, and it still has a lot to learn. (Applause)

ФФЛ: Конечно, мы продолжаем усердно работать над улучшением нашего алгоритма, и ему предстоит ещё многому научиться. (Аплодисменты)

And the computer still makes mistakes.

Компьютер всё ещё допускает ошибки.

(Video) Computer: A cat lying on a bed in a blanket.

(Видео) Компьютер: Кот лежит на кровати в одеяле.

FFL: So of course, when it sees too many cats, it thinks everything might look like a cat.

ФФЛ: Конечно, когда он видит слишком много котов, он считает, что всё остальное тоже выглядит как кот.

(Video) Computer: A young boy is holding a baseball bat. (Laughter)

(Видео) Компьютер: Мальчик держит бейсбольную биту. (Смех)

FFL: Or, if it hasn't seen a toothbrush, it confuses it with a baseball bat.

ФФЛ: Если он не видел зубной щётки, он принимает её за бейсбольную биту.

(Video) Computer: A man riding a horse down a street next to a building. (Laughter)

(Видео) Компьютер: Мужчина едет верхом по улице рядом со зданием. (Смех)

FFL: We haven't taught Art 101 to the computers.

ФФЛ: Мы не обучили компьютер основам искусства.

(Video) Computer: A zebra standing in a field of grass.

(Видео) Компьютер: Зебра стоит на поле с травой.

FFL: And it hasn't learned to appreciate the stunning beauty of nature like you and I do.

ФФЛ: Он также ещё не может оценить красоту природы так, как это можем мы с вами.

So it has been a long journey. To get from age zero to three was hard. The real challenge is to go from three to 13 and far beyond. Let me remind you with this picture of the boy and the cake again. So far, we have taught the computer to see objects or even tell us a simple story when seeing a picture.

Это длительный процесс. Дорасти до трёх лет было трудно. Ещё сложнее — от трёх до тринадцати и так далее. Позвольте вам снова показать фотографию мальчика с тортом. Компьютер уже умеет видеть предметы и даже вкратце рассказывать историю о том, что изображено на фотографии.

(Video) Computer: A person sitting at a table with a cake.

(Видео) Компьютер: Человек сидит за столом с тортом.

FFL: But there's so much more to this picture than just a person and a cake. What the computer doesn't see is that this is a special Italian cake that's only served during Easter time. The boy is wearing his favorite t-shirt given to him as a gift by his father after a trip to Sydney, and you and I can all tell how happy he is and what's exactly on his mind at that moment.

ФФЛ: На этой фотографии изображено гораздо больше, чем просто человек и торт. Компьютер не видит, что это особый итальянский торт, который пекут только во время Пасхи. На мальчике надета его любимая футболка, которую ему подарил отец после поездки в Сидней. И невооружённым глазом видно, как счастлив мальчик и о чём именно он думает в этот момент.

This is my son Leo. On my quest for visual intelligence, I think of Leo constantly and the future world he will live in. When machines can see, doctors and nurses will have extra pairs of tireless eyes to help them to diagnose and take care of patients. Cars will run smarter and safer on the road. Robots, not just humans, will help us to brave the disaster zones to save the trapped and wounded. We will discover new species, better materials, and explore unseen frontiers with the help of the machines.

Это мой сын Лео. В моих поисках визуального интеллекта я постоянно думаю о Лео и о том мире, в котором он будет жить. Когда машины будут способны видеть, доктора и медсёстры обзаведутся дополнительной парой неустающих глаз для диагностики заболеваний и ухода за пациентами. Машины на дорогах станут умнее и безопаснее. Не только люди, но и роботы смогут оказывать помощь в зонах бедствий и спасать людей из-под завалов. С помощью машин мы откроем новые виды животных и растений, усовершенствуем материалы и расширим границы своей деятельности.

Little by little, we're giving sight to the machines. First, we teach them to see. Then, they help us to see better. For the first time, human eyes won't be the only ones pondering and exploring our world. We will not only use the machines for their intelligence, we will also collaborate with them in ways that we cannot even imagine.

Постепенно машины обретут зрение. Сначала мы научим их видеть. Затем они помогут видеть лучше нам самим. Впервые человек будет осваивать и осознавать мир посредством не только своих, но и компьютерных глаз. Мы будем не только использовать машины благодаря их интеллекту, но и работать совместно с ними так, как никто и не мог вообразить.

This is my quest: to give computers visual intelligence and to create a better future for Leo and for the world.

Это моя задача: дать машинам визуальный интеллект и создать лучшее будущее для Лео и всего мира.

Thank you.

Спасибо.

(Applause)

(Аплодисменты)