Let me show you something.

Deixem-me lhes mostrar algo.

(Video) Girl: Okay, that's a cat sitting in a bed. The boy is petting the elephant. Those are people that are going on an airplane. That's a big airplane.

(Vídeo) Garota: Certo, isso é um gato sentado sobre a cama. O garoto está acariciando o elefante. Aquelas são pessoas que estão entrando num avião. É um avião grande!

Fei-Fei Li: This is a three-year-old child describing what she sees in a series of photos. She might still have a lot to learn about this world, but she's already an expert at one very important task: to make sense of what she sees. Our society is more technologically advanced than ever. We send people to the moon, we make phones that talk to us or customize radio stations that can play only music we like. Yet, our most advanced machines and computers still struggle at this task. So I'm here today to give you a progress report on the latest advances in our research in computer vision, one of the most frontier and potentially revolutionary technologies in computer science.

Fei-Fei Li: Esta é uma criança de três anos de idade descrevendo o que vê numa série de fotos. Ela ainda tem muito o que aprender sobre este mundo, mas já é uma especialista numa importante tarefa: dar sentido ao que vê. Nossa sociedade está mais tecnologicamente avançada do que nunca. Mandamos pessoas para a Lua, fazemos telefones que falam conosco ou personalizamos estações de rádio para tocar só as músicas de que gostamos. No entanto, nossas máquinas mais avançadas e computadores ainda lutam para realizar esta tarefa. Então, estou aqui hoje para dar um relatório do progresso sobre os últimos avanços em nossa pesquisa em visão computacional, uma das tecnologias mais inovadoras e potencialmente revolucionárias na ciência da computação.

Yes, we have prototyped cars that can drive by themselves, but without smart vision, they cannot really tell the difference between a crumpled paper bag on the road, which can be run over, and a rock that size, which should be avoided. We have made fabulous megapixel cameras, but we have not delivered sight to the blind. Drones can fly over massive land, but don't have enough vision technology to help us to track the changes of the rainforests. Security cameras are everywhere, but they do not alert us when a child is drowning in a swimming pool. Photos and videos are becoming an integral part of global life. They're being generated at a pace that's far beyond what any human, or teams of humans, could hope to view, and you and I are contributing to that at this TED. Yet our most advanced software is still struggling at understanding and managing this enormous content. So in other words, collectively as a society, we're very much blind, because our smartest machines are still blind.

Sim, temos protótipos de carros que podem dirigir sozinhos, mas sem uma visão inteligente, não conseguem notar a diferença entre um saco de papel amassado na estrada, que pode ser atropelado, e uma pedra daquele tamanho, que deve ser evitada. Fizemos câmeras incríveis de megapixel, mas não demos visão aos cegos. Os "drones" podem voar sobre a terra firme, mas não têm a tecnologia de visão suficiente para nos ajudar a rastrear as mudanças das florestas tropicais. As câmeras de segurança estão em toda parte, mas não nos alertam quando uma criança está se afogando numa piscina. Fotos e vídeos estão se tornando partes integrais da vida global. Estão sendo gerados a um ritmo muito além do que qualquer humano, -- ou grupos de seres humanos -- poderia esperar ver. E vocês e eu estamos contribuindo para isto nesta palestra TED. No entanto, nosso software mais avançado ainda tem dificuldade para compreender e administrar este conteúdo enorme. Então, em outras palavras, coletivamente como sociedade, somos muito cegos, porque nossas máquinas mais inteligentes ainda são cegas.

"Why is this so hard?" you may ask. Cameras can take pictures like this one by converting lights into a two-dimensional array of numbers known as pixels, but these are just lifeless numbers. They do not carry meaning in themselves. Just like to hear is not the same as to listen, to take pictures is not the same as to see, and by seeing, we really mean understanding. In fact, it took Mother Nature 540 million years of hard work to do this task, and much of that effort went into developing the visual processing apparatus of our brains, not the eyes themselves. So vision begins with the eyes, but it truly takes place in the brain.

"Por que isto é tão difícil?", vocês podem perguntar. As câmeras podem tirar fotos como esta, convertendo luzes numa matriz bidimensional de números conhecida como pixels, mas estes são apenas números sem vida, não carregam significado em si mesmos. Assim como ouvir não é o mesmo que escutar, tirar fotos não é o mesmo que ver, e por ver, queremos dizer, compreender. Na verdade, a mãe natureza levou 540 milhões de anos de trabalho pesado para realizar esta tarefa, e muito deste esforço foi para desenvolver o aparelho de processamento visual do nosso cérebro, não os olhos em si. Então, a visão começa com os olhos, mas acontece de fato no cérebro.

So for 15 years now, starting from my Ph.D. at Caltech and then leading Stanford's Vision Lab, I've been working with my mentors, collaborators and students to teach computers to see. Our research field is called computer vision and machine learning. It's part of the general field of artificial intelligence. So ultimately, we want to teach the machines to see just like we do: naming objects, identifying people, inferring 3D geometry of things, understanding relations, emotions, actions and intentions. You and I weave together entire stories of people, places and things the moment we lay our gaze on them.

Então, por 15 anos, começando com o meu doutorado na Caltech e depois liderando o Stanford's Vision Lab, venho trabalhando com os meus mentores, colaboradores e alunos para ensinar os computadores a ver. Nosso campo de pesquisa chama-se visão computacional e aprendizado de máquina. É parte do campo geral da inteligência artificial. Basicamente, queremos ensinar as máquinas a ver como nós: nomear objetos, identificar pessoas, perceber a geometria 3D das coisas, compreender relações, emoções, ações e intenções. Nós tecemos juntos histórias completas das pessoas, lugares e coisas no momento em que os vemos.

The first step towards this goal is to teach a computer to see objects, the building block of the visual world. In its simplest terms, imagine this teaching process as showing the computers some training images of a particular object, let's say cats, and designing a model that learns from these training images. How hard can this be? After all, a cat is just a collection of shapes and colors, and this is what we did in the early days of object modeling. We'd tell the computer algorithm in a mathematical language that a cat has a round face, a chubby body, two pointy ears, and a long tail, and that looked all fine. But what about this cat? (Laughter) It's all curled up. Now you have to add another shape and viewpoint to the object model. But what if cats are hidden? What about these silly cats? Now you get my point. Even something as simple as a household pet can present an infinite number of variations to the object model, and that's just one object.

O primeiro passo rumo a este objetivo, é ensinar um computador a ver objetos, o bloco de construção do mundo visual. De modo bem simples, imaginem este processo de ensino como mostrar aos computadores algumas imagens de treinamento de um objeto em particular, digamos gatos, e projetar um modelo que aprenda a partir destas imagens de treinamento. Qual é a dificuldade disto? Afinal de contas, um gato é apenas uma coleção de forma e cores, e foi o que fizemos nos primeiro dias de modelagem de objetos. Falamos ao algoritmo computacional, numa linguagem matemática, que um gato tem o rosto arredondado, corpo gordinho, duas orelhas pontudas e uma cauda longa, e parecia tudo bem. Mas, e este gato? (Risos) Ele está todo torto. Agora é preciso adicionar outra forma e outro ponto de vista ao objeto modelo. Mas, e se os gatos estiverem escondidos? E estes gatos bobos? Agora vocês sabem do que estou falando. Mesmo algo simples, como um animal doméstico, pode apresentar um número infinito de variações ao objeto modelo, e isto é só um objeto.

So about eight years ago, a very simple and profound observation changed my thinking. No one tells a child how to see, especially in the early years. They learn this through real-world experiences and examples. If you consider a child's eyes as a pair of biological cameras, they take one picture about every 200 milliseconds, the average time an eye movement is made. So by age three, a child would have seen hundreds of millions of pictures of the real world. That's a lot of training examples. So instead of focusing solely on better and better algorithms, my insight was to give the algorithms the kind of training data that a child was given through experiences in both quantity and quality.

Então, há oito anos, uma observação bem simples e profunda mudou o meu pensamento. Ninguém diz a uma criança como ver, especialmente nos primeiros anos. Elas aprendem através das experiências e exemplos do mundo real. Se considerarmos os olhos de uma criança como um par de câmeras biológicas, eles tiram uma foto a cada 200 milissegundos, o tempo médio em que o movimento do olho é feito. Então, aos três anos, uma criança terá visto centenas de milhões de fotos do mundo real. São muitos exemplos de treinamento. Então, em vez de focar somente algoritmos melhores, minha ideia foi dar-lhes os tipos de dados de treinamento que uma criança obtém através das experiências, tanto em quantidade quanto em qualidade.

Once we know this, we knew we needed to collect a data set that has far more images than we have ever had before, perhaps thousands of times more, and together with Professor Kai Li at Princeton University, we launched the ImageNet project in 2007. Luckily, we didn't have to mount a camera on our head and wait for many years. We went to the Internet, the biggest treasure trove of pictures that humans have ever created. We downloaded nearly a billion images and used crowdsourcing technology like the Amazon Mechanical Turk platform to help us to label these images. At its peak, ImageNet was one of the biggest employers of the Amazon Mechanical Turk workers: together, almost 50,000 workers from 167 countries around the world helped us to clean, sort and label nearly a billion candidate images. That was how much effort it took to capture even a fraction of the imagery a child's mind takes in in the early developmental years.

Uma vez compreendendo isso, sabíamos que precisávamos coletar um conjunto de dados que tivesse mais imagens do que tínhamos antes, talvez milhares de vezes mais, e juntamente com o professor Kai Li, da Universidade de Princeton, lançamos o projeto ImageNet em 2007. Felizmente, não tínhamos que colocar uma câmera em nossas cabeças e esperar por vários anos. Fomos à internet, o maior tesouro de imagens que os humanos já criaram. Baixamos aproximadamente um bilhão de imagens e usamos tecnologia de "crowdsourcing", como a plataforma Amazon Mechanical Turk, para nos ajudar a classificar essas imagens. No seu auge, o ImageNet foi um dos maiores empregadores de trabalhadores da Amazon Mechanical Turk. Juntos, quase 50 mil trabalhadores de 167 países do mundo, nos ajudaram a limpar, separar e classificar aproximadamente um bilhão de candidatas a imagens. Esse foi o tamanho do empenho para capturar até mesmo uma fração das imagens que a mente de uma criança capta nos primeiros anos de desenvolvimento.

In hindsight, this idea of using big data to train computer algorithms may seem obvious now, but back in 2007, it was not so obvious. We were fairly alone on this journey for quite a while. Some very friendly colleagues advised me to do something more useful for my tenure, and we were constantly struggling for research funding. Once, I even joked to my graduate students that I would just reopen my dry cleaner's shop to fund ImageNet. After all, that's how I funded my college years.

Em retrospecto, esta ideia de usar dados extensos para treinar os algoritmos computacionais pode parecer óbvia agora, mas em 2007, não era tão óbvia assim. Estivemos praticamente sós nessa jornada por um bom tempo. Alguns colegas próximos me aconselharam a fazer algo mais útil pelo meu mandato, e lutávamos constantemente para conseguir financiamento para a pesquisa. Uma vez, eu brinquei com os meus alunos de graduação que iria reabrir minha loja de lavagem a seco para financiar o ImageNet. Afinal de contas, foi assim que financiei minha faculdade.

So we carried on. In 2009, the ImageNet project delivered a database of 15 million images across 22,000 classes of objects and things organized by everyday English words. In both quantity and quality, this was an unprecedented scale. As an example, in the case of cats, we have more than 62,000 cats of all kinds of looks and poses and across all species of domestic and wild cats. We were thrilled to have put together ImageNet, and we wanted the whole research world to benefit from it, so in the TED fashion, we opened up the entire data set to the worldwide research community for free. (Applause)

Então seguimos em frente. Em 2009, o projeto ImageNet entregou um banco de dados de 15 milhões de imagens, entre 22 mil classes de objetos e coisas, organizadas pelas palavras cotidianas em inglês. Tanto em quantidade quanto em qualidade, isso foi uma escala sem precedentes. Como exemplo, no caso dos gatos, temos mais de 62 mil gatos de todos os aspectos e poses; e todas as espécies de gatos domésticos e selvagens. Ficamos muito felizes em criar o ImageNet e queríamos que todo o mundo das pesquisas se beneficiasse com ele. Assim, à moda TED, abrimos todo o conjunto de dados para a comunidade mundial de pesquisa gratuitamente. (Aplausos)

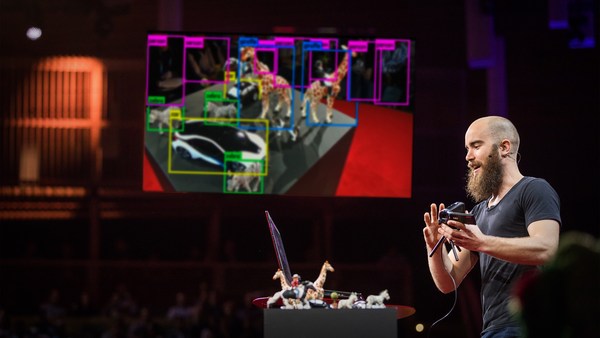

Now that we have the data to nourish our computer brain, we're ready to come back to the algorithms themselves. As it turned out, the wealth of information provided by ImageNet was a perfect match to a particular class of machine learning algorithms called convolutional neural network, pioneered by Kunihiko Fukushima, Geoff Hinton, and Yann LeCun back in the 1970s and '80s. Just like the brain consists of billions of highly connected neurons, a basic operating unit in a neural network is a neuron-like node. It takes input from other nodes and sends output to others. Moreover, these hundreds of thousands or even millions of nodes are organized in hierarchical layers, also similar to the brain. In a typical neural network we use to train our object recognition model, it has 24 million nodes, 140 million parameters, and 15 billion connections. That's an enormous model. Powered by the massive data from ImageNet and the modern CPUs and GPUs to train such a humongous model, the convolutional neural network blossomed in a way that no one expected. It became the winning architecture to generate exciting new results in object recognition. This is a computer telling us this picture contains a cat and where the cat is. Of course there are more things than cats, so here's a computer algorithm telling us the picture contains a boy and a teddy bear; a dog, a person, and a small kite in the background; or a picture of very busy things like a man, a skateboard, railings, a lampost, and so on. Sometimes, when the computer is not so confident about what it sees, we have taught it to be smart enough to give us a safe answer instead of committing too much, just like we would do, but other times our computer algorithm is remarkable at telling us what exactly the objects are, like the make, model, year of the cars.

Agora que temos os dados para alimentar o cérebro do nosso computador, estamos prontos para retornar aos algoritmos em si. Como se viu, a riqueza de informações fornecidas pelo ImageNet foi um ajuste perfeito para uma classe de algoritmos de aprendizado de máquina chamada "rede neural convolucional", iniciada por Kunihiko Fukushima, Geoff Hinton e Yann LeCun nos anos 1970 e 1980. Assim como o cérebro é composto de bilhões de neurônios altamente conectados, uma unidade operacional básica numa rede neural é como um nó neuronal. Ela obtém informações de outros nós e envia dados para outros. Além disso, essas centenas de milhares, ou mesmo milhões de nós, são organizadas em camadas hierárquicas, parecidas com o cérebro. Numa rede neural que usamos para treinar nosso modelo de reconhecimento de objetos há 24 milhões de nós, 140 milhões de parâmetros e 15 bilhões de conexões. É um modelo enorme. Alimentada pelos dados consideráveis do ImageNet e os modernos CPUs e GPUs para treinar um modelo colossal, a rede neural convolucional floresceu de um modo que ninguém esperava. Tornou-se a arquitetura vencedora para gerar novos resultados animadores em reconhecimento de objetos. Isto é um computador nos dizendo que esta foto contém um gato e onde ele está. É claro que há mais coisas além de gatos. Aqui está um algoritmo computacional nos dizendo que a foto contém um garoto e um urso de pelúcia; um cão, uma pessoa e uma pequena pipa ao fundo; ou uma foto com muitas informações como um homem, um skate, corrimãos, um poste de luz, e assim por diante. Às vezes, quando o computador não tem certeza do que vê, (Risos) nós o ensinamos a ser inteligente o bastante para nos dar uma resposta segura em vez de ficar deduzindo muito, como nós faríamos. Mas outras vezes, nosso algoritmo computacional é notável aos nos dizer exatamente o que são os objetos, como a marca, o modelo e o ano dos carros.

We applied this algorithm to millions of Google Street View images across hundreds of American cities, and we have learned something really interesting: first, it confirmed our common wisdom that car prices correlate very well with household incomes. But surprisingly, car prices also correlate well with crime rates in cities, or voting patterns by zip codes.

Nós cruzamos esse algoritmo com milhões de imagens do Google Street View em centenas de cidades americanas e descobrimos algo muito interessante: primeiro, confirmou-se a nossa sabedoria popular de que preços de carros estão relacionados ao rendimento das famílias. Mas surpreendentemente, o preço dos carros também se relaciona com as taxas de crimes nas cidades, ou padrões de votos pelo CEPs.

So wait a minute. Is that it? Has the computer already matched or even surpassed human capabilities? Not so fast. So far, we have just taught the computer to see objects. This is like a small child learning to utter a few nouns. It's an incredible accomplishment, but it's only the first step. Soon, another developmental milestone will be hit, and children begin to communicate in sentences. So instead of saying this is a cat in the picture, you already heard the little girl telling us this is a cat lying on a bed.

Espere um pouco. É isso mesmo? Os computadores já igualaram ou mesmo superaram as capacidades humanas? Não tão rápido. Até agora, apenas ensinamos os computadores a ver objetos. É como uma criancinha aprendendo a pronunciar algumas palavras. É um feito incrível, mas é apenas o primeiro passo. Em breve, outro marco de desenvolvimento será atingido, e as crianças começam a se comunicar por meio de frases. Então, em vez de dizer que isto é um gato na foto, vocês ouviram a garotinha nos dizendo que isto é um gato deitado na cama.

So to teach a computer to see a picture and generate sentences, the marriage between big data and machine learning algorithm has to take another step. Now, the computer has to learn from both pictures as well as natural language sentences generated by humans. Just like the brain integrates vision and language, we developed a model that connects parts of visual things like visual snippets with words and phrases in sentences.

Então, para ensinar um computador a ver uma foto e criar frases, o casamento entre os dados e o algoritmo de aprendizado de máquina deve dar outro passo. Agora, o computador tem que aprender tanto com as fotos quanto com as frases em linguagem natural geradas por humanos. Assim como o cérebro integra visão e linguagem, nós desenvolvemos um modelo que conecta partes de coisas visuais, como fragmentos visuais, com palavras e ideias em frases.

About four months ago, we finally tied all this together and produced one of the first computer vision models that is capable of generating a human-like sentence when it sees a picture for the first time. Now, I'm ready to show you what the computer says when it sees the picture that the little girl saw at the beginning of this talk.

Há uns quatro meses, finalmente juntamos tudo isso, e produzimos um dos primeiros modelos de visão computacional capaz de gerar frases do jeito humano quando vê uma foto pela primeira vez. Agora, vou mostrar o que o computador diz quando vê a foto que a garotinha viu, no início desta palestra.

(Video) Computer: A man is standing next to an elephant. A large airplane sitting on top of an airport runway.

(Vídeo) Computador: Um homem está em pé, próximo a um elefante. Um grande avião sentado em cima de uma pista de aeroporto.

FFL: Of course, we're still working hard to improve our algorithms, and it still has a lot to learn. (Applause)

FFL: Claro, estamos trabalhando com afinco para melhorar nossos algoritmos, e ele ainda tem muito o que aprender. (Aplausos)

And the computer still makes mistakes.

E o computador ainda comete erros.

(Video) Computer: A cat lying on a bed in a blanket.

(Vídeo) Computador: Um gato deitado numa cama com um cobertor. (Risos)

FFL: So of course, when it sees too many cats, it thinks everything might look like a cat.

FFL: É claro, quando ele vê muitos gatos, ele acha que tudo se parece com um gato.

(Video) Computer: A young boy is holding a baseball bat. (Laughter)

(Vídeo) Computador: Um garoto está segurando um taco de beisebol. (Risos)

FFL: Or, if it hasn't seen a toothbrush, it confuses it with a baseball bat.

FFL: Se nunca viu uma escova de dentes, ele a confunde com um taco de beisebol.

(Video) Computer: A man riding a horse down a street next to a building. (Laughter)

(Vídeo) Computador: Um homem monta um cavalo na rua, próximo a um edifício. (Risos)

FFL: We haven't taught Art 101 to the computers.

FFL: Não ensinamos Arte 101 aos computadores.

(Video) Computer: A zebra standing in a field of grass.

(Vídeo) Computador: Uma zebra num campo gramado.

FFL: And it hasn't learned to appreciate the stunning beauty of nature like you and I do.

FFL: E ele não aprendeu a apreciar a deslumbrante beleza da natureza como nós apreciamos.

So it has been a long journey. To get from age zero to three was hard. The real challenge is to go from three to 13 and far beyond. Let me remind you with this picture of the boy and the cake again. So far, we have taught the computer to see objects or even tell us a simple story when seeing a picture.

Tem sido uma longa jornada. Ir da idade zero a três foi difícil. O verdadeiro desafio é ir dos 3 aos 13 e além disso. Vejam esta foto do garoto com o bolo novamente. Até então, ensinamos o computador a ver objetos ou mesmo contar-nos uma simples história quando vê uma foto.

(Video) Computer: A person sitting at a table with a cake.

(Vídeo) Computador: Uma pessoa sentada à mesa com um bolo.

FFL: But there's so much more to this picture than just a person and a cake. What the computer doesn't see is that this is a special Italian cake that's only served during Easter time. The boy is wearing his favorite t-shirt given to him as a gift by his father after a trip to Sydney, and you and I can all tell how happy he is and what's exactly on his mind at that moment.

FFL: Mas há muito mais nesta foto do que apenas uma pessoa e um bolo. O que o computador não vê é que esta é uma colomba que é servida apenas durante a Páscoa. O garoto está vestindo a sua camiseta preferida, que lhe foi dada de presente pelo pai após uma viagem a Sydney. E nós podemos ver a felicidade dele, e o que está se passando em sua mente exatamente naquele momento.

This is my son Leo. On my quest for visual intelligence, I think of Leo constantly and the future world he will live in. When machines can see, doctors and nurses will have extra pairs of tireless eyes to help them to diagnose and take care of patients. Cars will run smarter and safer on the road. Robots, not just humans, will help us to brave the disaster zones to save the trapped and wounded. We will discover new species, better materials, and explore unseen frontiers with the help of the machines.

Este é o meu filho Leo. Em minha busca pela inteligência visual, penso nele constantemente e no mundo futuro em que ele viverá. Quando as máquinas puderem ver, médicos e enfermeiros terão pares extras de olhos incansáveis para ajudá-los a diagnosticar e cuidar de pacientes. Os carros funcionarão de forma mais inteligente e segura nas estradas. Robôs, não apenas seres humanos, nos ajudarão a realizar buscas em áreas de desastres e a salvar pessoas soterradas e feridas. Descobriremos novas espécies, materiais melhores e exploraremos lugares que não podemos ver com a ajuda das máquinas.

Little by little, we're giving sight to the machines. First, we teach them to see. Then, they help us to see better. For the first time, human eyes won't be the only ones pondering and exploring our world. We will not only use the machines for their intelligence, we will also collaborate with them in ways that we cannot even imagine.

Pouco a pouco, estamos dando visão às máquinas. Primeiro, as ensinamos a ver, então elas nos ajudam a ver melhor. Pela primeira vez, os olhos humanos não serão os únicos ponderando e explorando nosso mundo. Não usaremos as máquinas apenas pela sua inteligência; colaboraremos também com elas de uma maneira que nem sequer imaginamos.

This is my quest: to give computers visual intelligence and to create a better future for Leo and for the world.

Esta é a minha busca: dar aos computadores inteligência visual e criar um futuro melhor para o Leo e para o mundo.

Thank you.

Obrigada.

(Applause)

(Aplausos)