Let me show you something.

Pokażę wam coś.

(Video) Girl: Okay, that's a cat sitting in a bed. The boy is petting the elephant. Those are people that are going on an airplane. That's a big airplane.

(Wideo) Dziewczynka: To jest kot siedzący na łóżku. Chłopiec głaszcze słonia. To są ludzie idący do samolotu. Samolot jest duży.

Fei-Fei Li: This is a three-year-old child describing what she sees in a series of photos. She might still have a lot to learn about this world, but she's already an expert at one very important task: to make sense of what she sees. Our society is more technologically advanced than ever. We send people to the moon, we make phones that talk to us or customize radio stations that can play only music we like. Yet, our most advanced machines and computers still struggle at this task. So I'm here today to give you a progress report on the latest advances in our research in computer vision, one of the most frontier and potentially revolutionary technologies in computer science.

Fei-Fei Li: Tak trzyletnie dziecko opisuje, co widzi na zdjęciach. Wielu rzeczy musi się jeszcze nauczyć, ale w jednej dziedzinie jest już ekspertem: rozumie, co widzi. Technicznie nasze społeczeństwo jest zaawansowane bardziej niż kiedykolwiek. Wysyłamy ludzi na Księżyc, tworzymy telefony, które rozmawiają z nami i potrafimy sprawić, żeby stacja radiowa, grała tylko naszą ulubioną muzykę. A jednak nawet najbardziej zaawansowane komputery ciągle nie mogą sobie poradzić z tym zadaniem. Dzisiaj chciałabym opowiedzieć o ostatnich osiągnięciach w dziedzinie widzenia komputerowego, jednej z najbardziej pionierskich i potencjalnie rewolucyjnych technologii w informatyce.

Yes, we have prototyped cars that can drive by themselves, but without smart vision, they cannot really tell the difference between a crumpled paper bag on the road, which can be run over, and a rock that size, which should be avoided. We have made fabulous megapixel cameras, but we have not delivered sight to the blind. Drones can fly over massive land, but don't have enough vision technology to help us to track the changes of the rainforests. Security cameras are everywhere, but they do not alert us when a child is drowning in a swimming pool. Photos and videos are becoming an integral part of global life. They're being generated at a pace that's far beyond what any human, or teams of humans, could hope to view, and you and I are contributing to that at this TED. Yet our most advanced software is still struggling at understanding and managing this enormous content. So in other words, collectively as a society, we're very much blind, because our smartest machines are still blind.

Istnieje już prototyp samochodu, który jeździ sam, ale bez umiejętności rozpoznawania obrazu nie umie odróżnić zmiętej papierowej torby, po której można przejechać, od podobnej wielkości kamienia, który trzeba ominąć. Istnieją aparaty fotograficzne o bardzo dużej rozdzielczości, ale nadal nie wiadomo, jak przywrócić wzrok niewidomym. Drony mogą latać na dużych przestrzeniach, ale nadal nie istnieje technologia, która pomogłaby śledzić zmiany w lasach deszczowych. Kamery przemysłowe są wszędzie, ale nie potrafią nas ostrzec, jeśli dziecko topi się w basenie. Zdjęcia i filmy video stały się integralną częścią naszego życia. Ilość materiału, który powstaje, przekracza możliwości odbiorcze pojedynczego człowieka, a nawet grupy ludzi. Podczas TED dokładamy do tego swoją cegiełkę. Najbardziej zaawansowane oprogramowanie nadal nie umie sobie poradzić ze zrozumieniem i zarządzaniem tak ogromną ilością danych. Innymi słowy jako społeczeństwo jesteśmy niewidomi, bo nasze najmądrzejsze maszyny wciąż nie widzą.

"Why is this so hard?" you may ask. Cameras can take pictures like this one by converting lights into a two-dimensional array of numbers known as pixels, but these are just lifeless numbers. They do not carry meaning in themselves. Just like to hear is not the same as to listen, to take pictures is not the same as to see, and by seeing, we really mean understanding. In fact, it took Mother Nature 540 million years of hard work to do this task, and much of that effort went into developing the visual processing apparatus of our brains, not the eyes themselves. So vision begins with the eyes, but it truly takes place in the brain.

"Co w tym trudnego?" moglibyście zapytać. Aparaty potrafią zrobić zdjęcie, przekształcając światło w dwuwymiarowy szereg liczb, czyli w piksele. Ale są to tylko liczby. Nie niosą ze sobą znaczenia. Słyszeć, to nie to samo co słuchać, a robić zdjęcia, to nie to samo co widzieć. Mówiąc o widzeniu, mam na myśli rozumienie. Zrealizowanie tego zadania zajęło Matce Naturze 540 milionów lat ciężkiej pracy, a większość tego wysiłku włożyła w rozwój części mózgu odpowiedzialnej za przetwarzanie wizualne, a nie w rozwój oczu. Widzenie rozpoczyna się w oczach, ale tak naprawdę odbywa się w mózgu.

So for 15 years now, starting from my Ph.D. at Caltech and then leading Stanford's Vision Lab, I've been working with my mentors, collaborators and students to teach computers to see. Our research field is called computer vision and machine learning. It's part of the general field of artificial intelligence. So ultimately, we want to teach the machines to see just like we do: naming objects, identifying people, inferring 3D geometry of things, understanding relations, emotions, actions and intentions. You and I weave together entire stories of people, places and things the moment we lay our gaze on them.

Od 15 lat, zaczynając od doktoratu w Caltech, przez prowadzenie Stanford Vision Lab, pracowałam z moimi mentorami, współpracownikami i studentami nad nauczeniem komputerów widzenia. Pole naszych badań to widzenie komputerowe i systemy uczące się. Jest to część sztucznej inteligencji. Chcemy, żeby maszyny widziały tak, jak my, potrafiły nazwać rzeczy, rozpoznać ludzi, wskazać ich położenie w przestrzeni, żeby rozumiały relacje, emocje, działania i intencje. Potrafimy opowiedzieć historię o ludziach, miejscach czy rzeczach w momencie, kiedy na nie spojrzymy.

The first step towards this goal is to teach a computer to see objects, the building block of the visual world. In its simplest terms, imagine this teaching process as showing the computers some training images of a particular object, let's say cats, and designing a model that learns from these training images. How hard can this be? After all, a cat is just a collection of shapes and colors, and this is what we did in the early days of object modeling. We'd tell the computer algorithm in a mathematical language that a cat has a round face, a chubby body, two pointy ears, and a long tail, and that looked all fine. But what about this cat? (Laughter) It's all curled up. Now you have to add another shape and viewpoint to the object model. But what if cats are hidden? What about these silly cats? Now you get my point. Even something as simple as a household pet can present an infinite number of variations to the object model, and that's just one object.

Żeby osiągnąć ten cel, trzeba nauczyć komputer widzenia rzeczy, klocków, z których składa się świat. Wyobraźcie sobie ten proces uczenia jako pokazywanie komputerom zdjęć konkretnych obiektów, na przykład kotów, i tworzenie modelu na podstawie tych obrazów. Czy to takie trudne? W końcu kot to tylko zbiór kształtów i kolorów. Tak właśnie traktowaliśmy obrazy na początku modelowania obiektowego. Używając języka matematyki, mówiliśmy algorytmowi komputerowemu, że kot ma okrągłą głowę, puchate ciało, szpiczaste uszy i długi ogon, i to brzmiało całkiem dobrze. Ale co zrobić z takim kotem? (Śmiech) On jest cały poskręcany. Teraz trzeba by dodać nowy kształt i punkt widzenia do modelu obiektu. A jeśli koty będą schowane? Co zrobić z takimi kotami? Teraz rozumiecie. Nawet coś tak banalnego, jak zwierzę domowe może dostarczyć nieskończenie wielu wersji modelowi obiektu, a to nadal tylko jeden obiekt.

So about eight years ago, a very simple and profound observation changed my thinking. No one tells a child how to see, especially in the early years. They learn this through real-world experiences and examples. If you consider a child's eyes as a pair of biological cameras, they take one picture about every 200 milliseconds, the average time an eye movement is made. So by age three, a child would have seen hundreds of millions of pictures of the real world. That's a lot of training examples. So instead of focusing solely on better and better algorithms, my insight was to give the algorithms the kind of training data that a child was given through experiences in both quantity and quality.

Osiem lat temu proste spostrzeżenie zmieniło mój sposób myślenia. Nikt nie mówi dziecku, jak ma widzieć, szczególnie we wczesnym dzieciństwie. Dzieci uczą się tego przez doświadczanie świata. Jeśli potraktować dziecięce oczy jako parę biologicznych aparatów, to robią one zdjęcie co 200 milisekund, co jest średnim czasem ruchu oka. Zanim skończy 3 lata, dziecko może zobaczyć setki milionów obrazów realnego świata. To bardzo dużo przykładów. Zamiast skupiać się wyłącznie na ulepszaniu algorytmów, wolałam podać im dane treningowe podobne do tych, które otrzymuje małe dziecko poznające świat, zarówno pod względem ilościowym, jak i jakościowym.

Once we know this, we knew we needed to collect a data set that has far more images than we have ever had before, perhaps thousands of times more, and together with Professor Kai Li at Princeton University, we launched the ImageNet project in 2007. Luckily, we didn't have to mount a camera on our head and wait for many years. We went to the Internet, the biggest treasure trove of pictures that humans have ever created. We downloaded nearly a billion images and used crowdsourcing technology like the Amazon Mechanical Turk platform to help us to label these images. At its peak, ImageNet was one of the biggest employers of the Amazon Mechanical Turk workers: together, almost 50,000 workers from 167 countries around the world helped us to clean, sort and label nearly a billion candidate images. That was how much effort it took to capture even a fraction of the imagery a child's mind takes in in the early developmental years.

Kiedy się na to zdecydowaliśmy, wiedzieliśmy, że musimy zebrać dużo więcej zdjęć, niż mieliśmy dotąd, może nawet tysiące razy więcej. W związku z tym razem z profesorem Kai Li z uniwersytetu Princeton w 2007 r. uruchomiliśmy projekt ImageNet. Na szczęście nie musieliśmy montować aparatu na głowie i czekać wiele lat. Skorzystaliśmy z Internetu, największej skarbnicy zdjęć, jaką człowiek kiedykolwiek stworzył. Pobraliśmy blisko miliard zdjęć i użyliśmy crowdsourcingowej platformy Amazon Mechanical Turk, żeby je opisać. W szczytowym okresie ImageNet zatrudniał najwięcej pracowników na Amazon Mechanical Turk: razem prawie 50 000 osób ze 167 krajów pomagało nam posegregować i opisać prawie miliard zdjęć. Tak wiele wysiłku kosztowało uchwycenie zaledwie ułamka zbioru obrazów, które dziecięcy mózg przyswaja we wczesnych latach rozwoju.

In hindsight, this idea of using big data to train computer algorithms may seem obvious now, but back in 2007, it was not so obvious. We were fairly alone on this journey for quite a while. Some very friendly colleagues advised me to do something more useful for my tenure, and we were constantly struggling for research funding. Once, I even joked to my graduate students that I would just reopen my dry cleaner's shop to fund ImageNet. After all, that's how I funded my college years.

Pomysł użycia dużej ilości danych do uczenia algorytmu komputerowego, może wydawać się teraz oczywisty, ale w 2007 roku taki nie był. Przez dłuższy czas byliśmy w tej podróży sami. Kilku kolegów radziło mi nawet, żebym zrobiła coś bardziej użytecznego i ciągle zmagaliśmy się z brakiem funduszy. Zdarzyło mi się nawet żartować z moimi studentami, że otworzę znowu pralnię, żeby sfinansować ImageNet. Jakby nie było, tak właśnie sfinansowałam swoje studia.

So we carried on. In 2009, the ImageNet project delivered a database of 15 million images across 22,000 classes of objects and things organized by everyday English words. In both quantity and quality, this was an unprecedented scale. As an example, in the case of cats, we have more than 62,000 cats of all kinds of looks and poses and across all species of domestic and wild cats. We were thrilled to have put together ImageNet, and we wanted the whole research world to benefit from it, so in the TED fashion, we opened up the entire data set to the worldwide research community for free. (Applause)

Kontynuowaliśmy. W 2009 roku ImageNet miał już bazę 15 milionów zdjęć skategoryzowanych w 22 000 klas obiektów i rzeczy oznaczonych angielskimi słowami. Zarówno pod względem ilości, jak i jakości ta baza była unikalna. Na przykład mieliśmy ponad 62 000 zdjęć kotów wszystkich rodzajów, w różnych pozach kotów domowych i dzikich, z najróżniejszych gatunków. Byliśmy tak podekscytowani stworzeniem ImageNet, że chcieliśmy, aby cały naukowy świat mógł z tego projektu korzystać, więc, podobnie jak TED, udostępniliśmy wszystkie dane za darmo. (Brawa)

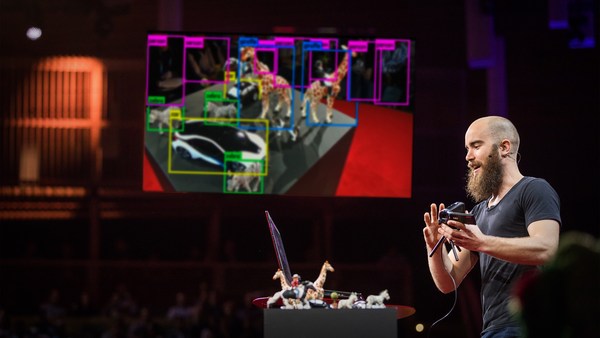

Now that we have the data to nourish our computer brain, we're ready to come back to the algorithms themselves. As it turned out, the wealth of information provided by ImageNet was a perfect match to a particular class of machine learning algorithms called convolutional neural network, pioneered by Kunihiko Fukushima, Geoff Hinton, and Yann LeCun back in the 1970s and '80s. Just like the brain consists of billions of highly connected neurons, a basic operating unit in a neural network is a neuron-like node. It takes input from other nodes and sends output to others. Moreover, these hundreds of thousands or even millions of nodes are organized in hierarchical layers, also similar to the brain. In a typical neural network we use to train our object recognition model, it has 24 million nodes, 140 million parameters, and 15 billion connections. That's an enormous model. Powered by the massive data from ImageNet and the modern CPUs and GPUs to train such a humongous model, the convolutional neural network blossomed in a way that no one expected. It became the winning architecture to generate exciting new results in object recognition. This is a computer telling us this picture contains a cat and where the cat is. Of course there are more things than cats, so here's a computer algorithm telling us the picture contains a boy and a teddy bear; a dog, a person, and a small kite in the background; or a picture of very busy things like a man, a skateboard, railings, a lampost, and so on. Sometimes, when the computer is not so confident about what it sees, we have taught it to be smart enough to give us a safe answer instead of committing too much, just like we would do, but other times our computer algorithm is remarkable at telling us what exactly the objects are, like the make, model, year of the cars.

Mając dane do zasilenia komputerowego mózgu, byliśmy gotowi wrócić do algorytmów. Jak się okazało, bogactwo informacji dostarczonych przez ImageNet doskonale odpowiadało konkretnej klasie algorytmów systemów uczących się, a konkretnie sieciom neuronowym zapoczątkowanym przez Kunihiko Fukushimę, Geoffa Hintona oraz Yanna LeCuna w latach 70. i 80. Podobnie jak mózg składa się z miliardów połączonych ze sobą komórek nerwowych, podstawową jednostką operacyjną w sieci neuronowej jest węzeł przypominający taki neuron. Pobiera on dane wejściowe z innych węzłów i przekazuje innym dane wyjściowe. Co więcej te miliony węzłów są zorganizowane w hierarchiczne warstwy, podobnie jak mózg. W sieci neuronowej, której użyliśmy były 24 miliony węzłów, 140 milionów parametrów, i 15 miliardów połączeń. To jest olbrzymi model. Zasilona wielką ilością danych z ImageNet, działająca dzięki nowoczesnym procesorom CPU i GPU sieć neuronowa rozwinęła się w sposób, którego nikt się nie spodziewał. Stała się najlepszą architekturą do osiągnięcia fascynujących rezultatów w dziedzinie rozpoznawania obrazów. Ten komputer mówi, że na obrazku jest kot, i gdzie ten kot się znajduje. Oczywiście koty to nie wszystko, więc tutaj komputer mówi, że zdjęcie pokazuje chłopca i pluszowego misia; psa, osobę i mały latawiec w tle; albo zdjęcie pełne obiektów takich jak mężczyzna, deskorolka, poręcz, latarnia. Czasami, jeśli komputer nie jest pewien tego, co widzi, nauczyliśmy go udzielać wymijających odpowiedzi, takich, jakich udzieliłby człowiek. Ale są też przypadki, kiedy algorytm potrafi nad wyraz precyzyjnie określić, jakie obiekty znajdują się na zdjęciu, podając markę, model i rok produkcji samochodu.

We applied this algorithm to millions of Google Street View images across hundreds of American cities, and we have learned something really interesting: first, it confirmed our common wisdom that car prices correlate very well with household incomes. But surprisingly, car prices also correlate well with crime rates in cities, or voting patterns by zip codes.

Zastosowaliśmy ten algorytm do milionów zdjęć z Google Street View powstałych w setkach amerykańskich miast i odkryliśmy coś interesującego. Po pierwsze potwierdził się popularny pogląd dotyczący relacji cen samochodów i dochodu gospodarstw domowych. Co zaskakujące, okazało się, że ceny samochodów wiążą się też ze skalą przestępczości w miastach, czy schematami głosowania.

So wait a minute. Is that it? Has the computer already matched or even surpassed human capabilities? Not so fast. So far, we have just taught the computer to see objects. This is like a small child learning to utter a few nouns. It's an incredible accomplishment, but it's only the first step. Soon, another developmental milestone will be hit, and children begin to communicate in sentences. So instead of saying this is a cat in the picture, you already heard the little girl telling us this is a cat lying on a bed.

Ale zaraz, czy to już wszystko? Czy komputer dorównał właśnie ludzkim możliwościom, a może nawet je przekroczył? Nie tak szybko. Na razie komputer nauczył się widzieć przedmioty. Można go porównać do małego dziecka, które nauczyło się pierwszych słów. To niesamowite osiągnięcie, ale to tylko pierwszy krok. Wkrótce kolejny milowy krok i dziecko nauczy się tworzyć zdania. Dziewczyna z początku prelekcji nie mówi, że na zdjęciu jest kot, tylko że kot leży na łóżku.

So to teach a computer to see a picture and generate sentences, the marriage between big data and machine learning algorithm has to take another step. Now, the computer has to learn from both pictures as well as natural language sentences generated by humans. Just like the brain integrates vision and language, we developed a model that connects parts of visual things like visual snippets with words and phrases in sentences.

Żeby nauczyć komputer patrzenia na zdjęcia i tworzenia zdań, połączenie danych i algorytmu systemów uczących się musi posunąć się dalej. Teraz komputer musi uczyć się zarówno ze zdjęć, jak i ze zdań tworzonych przez ludzi. Tak, jak mózg łączy wizję i język, rozwinęliśmy model, który łączy fragmenty rzeczy, jak elementy wizualne, z wyrazami i określeniami w zdaniach.

About four months ago, we finally tied all this together and produced one of the first computer vision models that is capable of generating a human-like sentence when it sees a picture for the first time. Now, I'm ready to show you what the computer says when it sees the picture that the little girl saw at the beginning of this talk.

Cztery miesiące temu w końcu połączyliśmy to wszystko razem i stworzyliśmy jeden z pierwszych modeli widzenia komputerowego, który umie tworzyć zdania na temat pierwszy raz widzianego zdjęcia. Pokażę wam, co komputer powiedział, kiedy zobaczył zdjęcia, które widziała dziewczynka z początku tej prelekcji.

(Video) Computer: A man is standing next to an elephant. A large airplane sitting on top of an airport runway.

(Wideo) Komputer: Człowiek stoi obok słonia. Duży samolot na pasie startowym.

FFL: Of course, we're still working hard to improve our algorithms, and it still has a lot to learn. (Applause)

FFL: Oczywiście ciągle pracujemy nad poprawieniem naszych algorytmów i one muszą się jeszcze sporo nauczyć. (Brawa)

And the computer still makes mistakes.

Komputer nadal popełnia błędy.

(Video) Computer: A cat lying on a bed in a blanket.

(Wideo) Komputer: Kot na łóżku zawinięty w koc.

FFL: So of course, when it sees too many cats, it thinks everything might look like a cat.

FFL: Jeśli widział zbyt wiele kotów, wszystko zaczyna mu przypominać kota.

(Video) Computer: A young boy is holding a baseball bat. (Laughter)

(Wideo) Komputer: Chłopczyk trzyma kij baseballowy. (Śmiech)

FFL: Or, if it hasn't seen a toothbrush, it confuses it with a baseball bat.

FFL: Jeśli nie widział szczoteczki do zębów,

(Video) Computer: A man riding a horse down a street next to a building. (Laughter)

myli ją z kijem baseballowym. (Wideo) Komputer: Mężczyzna jadący konno po ulicy obok budynku.

FFL: We haven't taught Art 101 to the computers.

(Śmiech)

FFL: Nie nauczyliśmy jeszcze komputera podstaw sztuki.

(Video) Computer: A zebra standing in a field of grass.

(Wideo) Komputer: Zebra na pastwisku.

FFL: And it hasn't learned to appreciate the stunning beauty of nature like you and I do.

FFL: Nie umie też doceniać piękna natury, jak my.

So it has been a long journey. To get from age zero to three was hard. The real challenge is to go from three to 13 and far beyond. Let me remind you with this picture of the boy and the cake again. So far, we have taught the computer to see objects or even tell us a simple story when seeing a picture.

To była długa droga. Przejście od wieku zero do 3 lat było trudne. Ale prawdziwym wyzwaniem jest przejście od 3 lat do 13 i dalej. Pozwólcie, że przypomnę wam zdjęcie chłopca z tortem. Dotąd uczyliśmy komputer dostrzegać przedmioty, a nawet opowiedzieć krótką historię na podstawie zdjęcia.

(Video) Computer: A person sitting at a table with a cake.

(Wideo) Komputer: Osoba przy stole z tortem

FFL: But there's so much more to this picture than just a person and a cake. What the computer doesn't see is that this is a special Italian cake that's only served during Easter time. The boy is wearing his favorite t-shirt given to him as a gift by his father after a trip to Sydney, and you and I can all tell how happy he is and what's exactly on his mind at that moment.

FFL: Ale na tym zdjęciu widać dużo więcej, niż tylko osobę i tort. Komputer nie widzi, że ten tort to włoski przysmak, serwowany tylko na Wielkanoc. Chłopiec ma na sobie ulubioną koszulkę, którą dziadek przywiózł mu z Sydney. Widać, jak bardzo jest w tym momencie szczęśliwy i co mu właśnie chodzi po głowie.

This is my son Leo. On my quest for visual intelligence, I think of Leo constantly and the future world he will live in. When machines can see, doctors and nurses will have extra pairs of tireless eyes to help them to diagnose and take care of patients. Cars will run smarter and safer on the road. Robots, not just humans, will help us to brave the disaster zones to save the trapped and wounded. We will discover new species, better materials, and explore unseen frontiers with the help of the machines.

To mój syn, Leo. Podczas zmagań z wizualną inteligencją myślę bez przerwy o Leo i o przyszłym świecie, w którym będzie żył. W którym maszyny będą umiały widzieć, lekarze i pielęgniarki będą mieli dodatkową parę niezmęczonych oczu, które będą pomagać w leczeniu pacjentów. Samochody będą bezpieczniejsze. Roboty, nie tylko ludzie, będą pomagać w poszukiwaniu rannych na obszarach dotkniętych przez katastrofy. Odkryjemy nowe gatunki, lepsze materiały i przekroczymy nieznane dotąd granice dzięki pomocy maszyn.

Little by little, we're giving sight to the machines. First, we teach them to see. Then, they help us to see better. For the first time, human eyes won't be the only ones pondering and exploring our world. We will not only use the machines for their intelligence, we will also collaborate with them in ways that we cannot even imagine.

Powoli dajemy wzrok maszynom. Najpierw uczymy je widzieć. Potem one pomogą nam lepiej widzieć. Po raz pierwszy ludzkie oczy nie będą jedynymi, które odkrywają świat. Będziemy używać maszyn nie tylko dla ich inteligencji. Naszą współpracę z nimi trudno sobie teraz wyobrazić.

This is my quest: to give computers visual intelligence and to create a better future for Leo and for the world.

To moje zadanie: dać komputerom wizualną inteligencję i stworzyć lepszą przyszłość dla Leo i dla świata.

Thank you.

Dziękuję.

(Applause)

(Brawa)