Let me show you something.

Ik laat je wat zien.

(Video) Girl: Okay, that's a cat sitting in a bed. The boy is petting the elephant. Those are people that are going on an airplane. That's a big airplane.

(Video) Meisje: Oké, dat is een poes die in bed zit. De jongen verzorgt de olifant. Dat zijn mensen die met het vliegtuig gaan. Dat is een groot vliegtuig.

Fei-Fei Li: This is a three-year-old child describing what she sees in a series of photos. She might still have a lot to learn about this world, but she's already an expert at one very important task: to make sense of what she sees. Our society is more technologically advanced than ever. We send people to the moon, we make phones that talk to us or customize radio stations that can play only music we like. Yet, our most advanced machines and computers still struggle at this task. So I'm here today to give you a progress report on the latest advances in our research in computer vision, one of the most frontier and potentially revolutionary technologies in computer science.

Fei-Fei Li: Dit is een kind van drie dat beschrijft wat het ziet op een serie foto's. Het moet nog veel leren over de wereld, maar het is nu al een expert in iets heel belangrijks: iets zinnigs maken van wat het ziet. Onze maatschappij is technologisch verder dan ooit. We sturen mensen naar de maan, maken telefoons die tegen ons praten, of stellen radiozenders samen, die alleen muziek uitzenden die we mooi vinden. Toch worstelen onze geavanceerde machines en computers met deze taak. Ik ben hier vandaag om je de voortgang te laten zien van de recentste ontwikkelingen in ons onderzoek naar computervisie, een van de meest grensverleggende en mogelijk revolutionaire technologieën in de computerwetenschap.

Yes, we have prototyped cars that can drive by themselves, but without smart vision, they cannot really tell the difference between a crumpled paper bag on the road, which can be run over, and a rock that size, which should be avoided. We have made fabulous megapixel cameras, but we have not delivered sight to the blind. Drones can fly over massive land, but don't have enough vision technology to help us to track the changes of the rainforests. Security cameras are everywhere, but they do not alert us when a child is drowning in a swimming pool. Photos and videos are becoming an integral part of global life. They're being generated at a pace that's far beyond what any human, or teams of humans, could hope to view, and you and I are contributing to that at this TED. Yet our most advanced software is still struggling at understanding and managing this enormous content. So in other words, collectively as a society, we're very much blind, because our smartest machines are still blind.

Ja, we hebben prototypes van auto's die zelf kunnen rijden, maar zonder slim zicht, zien ze het verschil niet tussen een verfrommelde papieren zak op de weg, waar je overheen kan rijden, en een evengrote kei, waar je omheen moet rijden. We hebben geweldige megapixelcamera's gemaakt, maar we kunnen blinden nog niet laten zien. Drones kunnen grote afstanden vliegen, maar hun visie-technologie schiet tekort om veranderingen te helpen opsporen in het regenwoud. Er zijn overal veiligheidscamera's, maar die waarschuwen ons niet als een kind verdrinkt in een zwembad. Foto's en filmpjes zijn deel van ons leven geworden. Ze verschijnen sneller dan welk mens, of welk team mensen ooit kan bekijken, en jullie en ik dragen daaraan bij op deze TED. Onze meest geavanceerde software heeft nog steeds moeite met het begrijpen van deze enorme hoeveelheid gegevens. Met andere woorden, we zijn met z'n allen heel erg blind, omdat onze slimste machines ook nog blind zijn.

"Why is this so hard?" you may ask. Cameras can take pictures like this one by converting lights into a two-dimensional array of numbers known as pixels, but these are just lifeless numbers. They do not carry meaning in themselves. Just like to hear is not the same as to listen, to take pictures is not the same as to see, and by seeing, we really mean understanding. In fact, it took Mother Nature 540 million years of hard work to do this task, and much of that effort went into developing the visual processing apparatus of our brains, not the eyes themselves. So vision begins with the eyes, but it truly takes place in the brain.

Je zal je afvragen waarom het zo moeilijk is. Camera's kunnen dit soort foto's nemen door licht om te zetten naar een 2-dimensionale serie getallen, bekend als pixels. Maar dit zijn slechts levenloze getallen. Ze hebben zelf geen betekenis. Horen is niet hetzelfde als luisteren. Foto's nemen is niet hetzelfde als zien. En met zien bedoelen we echt begrijpen. Het kostte Moeder Natuur 540 miljoen jaar hard werken om dit te doen. Veel van die inspanning ging zitten in het ontwikkelen van het verwerkingsgedeelte in ons brein. Niet de ogen zelf. Gezichtsvermogen begint bij de ogen, maar het gebeurt in feite in de hersenen.

So for 15 years now, starting from my Ph.D. at Caltech and then leading Stanford's Vision Lab, I've been working with my mentors, collaborators and students to teach computers to see. Our research field is called computer vision and machine learning. It's part of the general field of artificial intelligence. So ultimately, we want to teach the machines to see just like we do: naming objects, identifying people, inferring 3D geometry of things, understanding relations, emotions, actions and intentions. You and I weave together entire stories of people, places and things the moment we lay our gaze on them.

Al 15 jaar, vanaf mijn promoveren aan Caltech, en later, toen ik de leiding had van het Stanford Vision Lab, werk ik samen met mijn mentoren, medewerkers en studenten om computers te leren zien. Ons onderzoeksgebied heet computervisie en machine-leren. Het is onderdeel van het algemene gebied van kunstmatige intelligentie. Uiteindelijk willen we de machines aanleren wat wijzelf ook doen: voorwerpen benoemen, mensen herkennen, ruimtelijke vormen afleiden, het begrijpen van verhoudingen, emoties, acties en bedoelingen. Jullie en ik maken complete verhalen van mensen, plaatsen en dingen, op het moment dat we ernaar kijken.

The first step towards this goal is to teach a computer to see objects, the building block of the visual world. In its simplest terms, imagine this teaching process as showing the computers some training images of a particular object, let's say cats, and designing a model that learns from these training images. How hard can this be? After all, a cat is just a collection of shapes and colors, and this is what we did in the early days of object modeling. We'd tell the computer algorithm in a mathematical language that a cat has a round face, a chubby body, two pointy ears, and a long tail, and that looked all fine. But what about this cat? (Laughter) It's all curled up. Now you have to add another shape and viewpoint to the object model. But what if cats are hidden? What about these silly cats? Now you get my point. Even something as simple as a household pet can present an infinite number of variations to the object model, and that's just one object.

Eerst moeten we de computer leren voorwerpen te zien, de bouwsteen van de visuele wereld. Heel simpel gezegd: stel je dit leerproces voor als het aan de computer laten zien van oefenplaatjes van bepaalde voorwerpen, bijvoorbeeld katten, en ontwerp een model dat leert van deze oefenplaatjes. Hoe moeilijk is dat? Een kat is tenslotte alleen maar een verzameling vormen en kleuren. En dit deden we in het begintijd van het modelleren van voorwerpen. We moesten de computer algoritmes leren in een wiskundige taal, dat een kat een ronde kop heeft, een mollig lijf, twee puntoren en een lange staart. En dat leek goed te gaan. Maar deze kat dan? (Gelach) Die ligt helemaal opgekruld. Nu moet je nog een vorm en gezichtspunt toevoegen aan je model. Maar als katten zijn verstopt? Deze grappige katten bijvoorbeeld. (Gelach) Nu ga je het snappen. Zelf iets simpels als een huisdier kan zorgen voor ontelbaar veel variaties van het model. Dat is nog maar één voorwerp.

So about eight years ago, a very simple and profound observation changed my thinking. No one tells a child how to see, especially in the early years. They learn this through real-world experiences and examples. If you consider a child's eyes as a pair of biological cameras, they take one picture about every 200 milliseconds, the average time an eye movement is made. So by age three, a child would have seen hundreds of millions of pictures of the real world. That's a lot of training examples. So instead of focusing solely on better and better algorithms, my insight was to give the algorithms the kind of training data that a child was given through experiences in both quantity and quality.

Acht jaar geleden veranderde een simpele en grondige observatie mijn denken. Niemand vertelt aan een kind hoe het moet kijken. Zeker niet in de eerste jaren. Ze leren het via ervaringen en voorbeelden uit het echte leven. Bekijk de ogen van kinderen eens als een paar biologische camera's. Ze nemen elke 200 milliseconden een foto, de gemiddelde tijd van een oogbeweging. Als het drie is, heeft een kind honderden miljoenen beelden gezien van de echte wereld. Dat zijn heel wat oefenvoorbeelden. In plaats van je alleen te richten op steeds betere algoritmes, zag ik in dat je de algoritmes de oefengegevens moest geven dat een kind ook krijgt door ervaring. Zowel qua kwantiteit als kwaliteit.

Once we know this, we knew we needed to collect a data set that has far more images than we have ever had before, perhaps thousands of times more, and together with Professor Kai Li at Princeton University, we launched the ImageNet project in 2007. Luckily, we didn't have to mount a camera on our head and wait for many years. We went to the Internet, the biggest treasure trove of pictures that humans have ever created. We downloaded nearly a billion images and used crowdsourcing technology like the Amazon Mechanical Turk platform to help us to label these images. At its peak, ImageNet was one of the biggest employers of the Amazon Mechanical Turk workers: together, almost 50,000 workers from 167 countries around the world helped us to clean, sort and label nearly a billion candidate images. That was how much effort it took to capture even a fraction of the imagery a child's mind takes in in the early developmental years.

Toen we dat wisten, wisten we dat we een verzameling gegevens moesten maken die veel meer plaatjes bevat dan wij ooit hebben gehad. Misschien wel duizenden keren meer. Samen met professor Kai Li aan de Princeton Universiteit, lanceerden we in 2007 het ImageNet-project. Gelukkig hoefden we geen camera op ons hoofd te zetten en jaren te wachten. We gingen het internet op, de grootste schat aan plaatjes die de mens ooit heeft gemaakt. We downloadden meer dan een miljard plaatjes en gebruikten crowdsourcing, zoals met de Amazon Mechanische Turk om ons de plaatjes te helpen kenmerken. Op zijn hoogtepunt was ImageNet een van de grootste werkgevers voor de Amazon Mechanische Turk-werknemers: In totaal bijna 50.000 mensen uit 167 landen van de wereld hielpen ons met het opschonen, sorteren en markeren van bijna een miljard mogelijk bruikbare plaatjes. Zoveel moeite kostte het om slechts een fractie van de beelden te verwerken dat een kind opneemt in zijn eerste jaren.

In hindsight, this idea of using big data to train computer algorithms may seem obvious now, but back in 2007, it was not so obvious. We were fairly alone on this journey for quite a while. Some very friendly colleagues advised me to do something more useful for my tenure, and we were constantly struggling for research funding. Once, I even joked to my graduate students that I would just reopen my dry cleaner's shop to fund ImageNet. After all, that's how I funded my college years.

Achteraf gezien lijkt dit idee om big data te gebruiken om computeralgoritmes te trainen, nogal logisch, maar in 2007 was dat niet zo. We stonden best lang alleen op deze weg. Een paar vriendelijke collega's raadden me aan wat nuttigers te gaan doen, en we hadden veel moeite om onderzoeksgeld bij elkaar te krijgen. Ik grapte een keer naar mijn studenten dat ik mijn stomerij zou heropenen om ImageNet te sponsoren. Zo bekostigde ik immers ook mijn studie.

So we carried on. In 2009, the ImageNet project delivered a database of 15 million images across 22,000 classes of objects and things organized by everyday English words. In both quantity and quality, this was an unprecedented scale. As an example, in the case of cats, we have more than 62,000 cats of all kinds of looks and poses and across all species of domestic and wild cats. We were thrilled to have put together ImageNet, and we wanted the whole research world to benefit from it, so in the TED fashion, we opened up the entire data set to the worldwide research community for free. (Applause)

We gingen dus door. In 2009 leverde het ImageNet-project een database op met 15 miljoen plaatjes in 22.000 categorieën van voorwerpen en dingen ingedeeld met alledaagse Engelse woorden. Zowel qua kwantiteit als kwaliteit, was dit een ongekende schaal. We hebben bijvoorbeeld in het geval van de katten, meer dan 62.000 katten in allerlei posities en houdingen en allerlei soorten wilde en huiskatten. We waren enthousiast toen we ImageNet in elkaar hadden gezet en we wilden dat de hele onderzoekswereld er plezier van had. Dus volgens de TED-methode stelden we gratis de hele verzameling beschikbaar aan de wereldwijde onderzoeksgemeenschap. (Applaus)

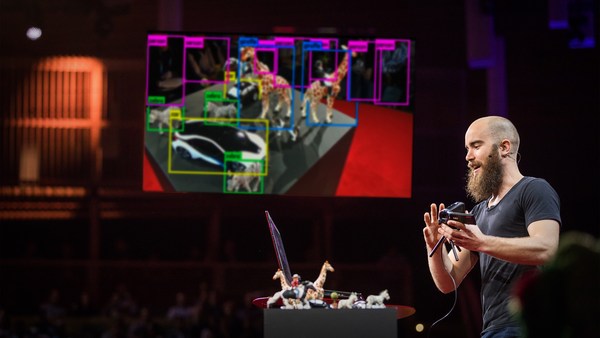

Now that we have the data to nourish our computer brain, we're ready to come back to the algorithms themselves. As it turned out, the wealth of information provided by ImageNet was a perfect match to a particular class of machine learning algorithms called convolutional neural network, pioneered by Kunihiko Fukushima, Geoff Hinton, and Yann LeCun back in the 1970s and '80s. Just like the brain consists of billions of highly connected neurons, a basic operating unit in a neural network is a neuron-like node. It takes input from other nodes and sends output to others. Moreover, these hundreds of thousands or even millions of nodes are organized in hierarchical layers, also similar to the brain. In a typical neural network we use to train our object recognition model, it has 24 million nodes, 140 million parameters, and 15 billion connections. That's an enormous model. Powered by the massive data from ImageNet and the modern CPUs and GPUs to train such a humongous model, the convolutional neural network blossomed in a way that no one expected. It became the winning architecture to generate exciting new results in object recognition. This is a computer telling us this picture contains a cat and where the cat is. Of course there are more things than cats, so here's a computer algorithm telling us the picture contains a boy and a teddy bear; a dog, a person, and a small kite in the background; or a picture of very busy things like a man, a skateboard, railings, a lampost, and so on. Sometimes, when the computer is not so confident about what it sees, we have taught it to be smart enough to give us a safe answer instead of committing too much, just like we would do, but other times our computer algorithm is remarkable at telling us what exactly the objects are, like the make, model, year of the cars.

Nu we de gegevens hebben om het computerbrein te voeden, kunnen we terugkomen op de algoritmes zelf. Het bleek dat de overdadige informatie die ImageNet gaf, precies paste bij een speciaal soort algoritme voor machineleren. die convolutioneel neuraal netwerk heet, het eerst aangepakt door Kunihiko Fukushima, Geoff Hinton en Yann LeCun, in de jaren zeventig en tachtig. Net als in de hersenen, die bestaan uit miljarden goedverbonden neuronen, is de basiseenheid van een neuraal netwerk een neuronenachtig knooppunt. Het ontvangt input van andere knooppunten en stuurt output naar andere. Deze honderdduizenden, of zelfs miljoenen knooppunten zijn bovendien in hiërarchische lagen georganiseerd. Ook weer net als in de hersenen. In een neuraal netwerk dat we gebruiken om voorwerpherkenning te trainen, zitten 24 miljoen knooppunten, 140 miljoen parameters, en 15 miljard verbindingen. Dat is een gigantisch model. Mogelijk gemaakt door de enorme hoeveelheid gegevens van IMageNet en moderne processoren om zo'n gigantisch model te trainen, kwam het convolutioneel neuraal netwerk tot bloei, op een manier die niemand had verwacht. Het werd de architectuur die de meeste opwindende nieuwe resultaten leverde op het gebied van voorwerpherkenning. Dit is een computer die ons vertelt dat op deze foto een kat staat en waar de kat is. Er zijn natuurlijk meer dingen dan katten. Hier is een computeralgoritme dat zegt dat op deze foto een jongen met teddybeer staat, een hond, een persoon en een vliegertje op de achtergrond, of een foto met veel dingen, zoals een man, een skateboard, een hek, een lantaarnpaal, enzovoort. Soms, als de computer het niet helemaal zeker weet, hebben we hem geleerd slim genoeg te zijn om een veilig antwoord te geven in plaats van te veel prijs te geven, wat wij ook zouden doen. Op andere momenten is het opmerkelijk wat het computeralgoritme ons vertelt welke voorwerpen het precies zijn, zoals merk, model en bouwjaar van de auto.

We applied this algorithm to millions of Google Street View images across hundreds of American cities, and we have learned something really interesting: first, it confirmed our common wisdom that car prices correlate very well with household incomes. But surprisingly, car prices also correlate well with crime rates in cities, or voting patterns by zip codes.

We pasten dit algoritme toe op miljoenen Google Street View-beelden dwars door honderden Amerikaanse steden, en we bemerkten iets interessants: ten eerste bevestigde het ons vermoeden dat autoprijzen gelijk op gaan met gezinsinkomens. Verrassend is echter, dat autoprijzen ook gelijk op gaan met de misdaadcijfers in de steden, of het stemgedrag met de postcode.

So wait a minute. Is that it? Has the computer already matched or even surpassed human capabilities? Not so fast. So far, we have just taught the computer to see objects. This is like a small child learning to utter a few nouns. It's an incredible accomplishment, but it's only the first step. Soon, another developmental milestone will be hit, and children begin to communicate in sentences. So instead of saying this is a cat in the picture, you already heard the little girl telling us this is a cat lying on a bed.

Wacht even, is dat het? Is de computer al net zo goed als de mens of zelfs al beter? Niet zo snel. Tot nu toe hebben we de computer alleen geleerd voorwerpen te bekijken. Net als een kind leren een paar zelfstandige naamwoorden te zeggen. Een ongelooflijke prestatie, maar pas de eerste stap. Er zal vlot een volgende mijlpaal gehaald worden: het kind zal beginnen te communiceren in zinnen. In plaats van te zeggen dat het een kat is op het plaatje, heb je het meisje al horen zeggen dat de kat op een bed ligt.

So to teach a computer to see a picture and generate sentences, the marriage between big data and machine learning algorithm has to take another step. Now, the computer has to learn from both pictures as well as natural language sentences generated by humans. Just like the brain integrates vision and language, we developed a model that connects parts of visual things like visual snippets with words and phrases in sentences.

Om een computer dus te leren om een plaatje te zien en zinnen te maken, moet het huwelijk tussen big data en machineleren de volgende stap nemen. De computer moet zowel leren van plaatjes als van zinnen in natuurlijke taal, voortgebracht door mensen. Net zoals de hersenen die beeld en taal integreren, hebben we een model ontwikkeld dat delen van zichtbare dingen, visuele fragmenten, verbindt met woorden en zinsdelen.

About four months ago, we finally tied all this together and produced one of the first computer vision models that is capable of generating a human-like sentence when it sees a picture for the first time. Now, I'm ready to show you what the computer says when it sees the picture that the little girl saw at the beginning of this talk.

Ongeveer vier maanden geleden voegden we dit allemaal samen en maakten een van de eerste computervisie-modellen dat in staat is mensentaalachtige zinnen te maken als het voor de eerste keer een plaatje ziet. Ik ben zover dat ik wil laten zien wat de computer zegt als die het plaatje ziet van het meisje dat je aan het begin van de talk hebt gezien.

(Video) Computer: A man is standing next to an elephant. A large airplane sitting on top of an airport runway.

(Video) Computer: Een man staat naast de olifant. Een groot vliegtuig staat op een startbaan.

FFL: Of course, we're still working hard to improve our algorithms, and it still has a lot to learn. (Applause)

FFL: Natuurlijk werken we hard aan het verbeteren van de algoritmes en er moet nog veel geleerd worden. (Applaus)

And the computer still makes mistakes.

De computer maakt nog steeds fouten.

(Video) Computer: A cat lying on a bed in a blanket.

(Video) Computer: Een kat ligt op een bed in een laken.

FFL: So of course, when it sees too many cats, it thinks everything might look like a cat.

FFL: Als hij te veel katten ziet, kan hij gaan denken dat alles een kat is.

(Video) Computer: A young boy is holding a baseball bat. (Laughter)

(Video) Computer: Een jongetje heeft een honkbalknuppel vast. (Gelach)

FFL: Or, if it hasn't seen a toothbrush, it confuses it with a baseball bat.

FFL: Als hij nog nooit een tandenborstel heeft gezien, raakt hij in de war.

(Video) Computer: A man riding a horse down a street next to a building. (Laughter)

(Video) Computer: Een man rijdt paard door een straat langs een gebouw. (Gelach)

FFL: We haven't taught Art 101 to the computers.

FFL: We hebben Art 101 nog niet aan de computer geleerd.

(Video) Computer: A zebra standing in a field of grass.

(Video) Computer: Een zebra staat in een grasveld.

FFL: And it hasn't learned to appreciate the stunning beauty of nature like you and I do.

FFL: Het heeft nog niet geleerd de prachtige natuur te waarderen, zoals jullie en ik doen.

So it has been a long journey. To get from age zero to three was hard. The real challenge is to go from three to 13 and far beyond. Let me remind you with this picture of the boy and the cake again. So far, we have taught the computer to see objects or even tell us a simple story when seeing a picture.

De weg is dus lang. Het viel niet mee om van nul naar drie jaar te komen Van drie tot 13 jaar of verder, is helemaal een grote uitdaging. Denk nog even aan dit plaatje van de jongen en de taart. Tot nu toe hebben we de computer geleerd om voorwerpen te zien of zelfs een simpel verhaaltje te vertellen bij het zien van een plaatje.

(Video) Computer: A person sitting at a table with a cake.

(Video) Computer: Een persoon zit aan tafel met een taart.

FFL: But there's so much more to this picture than just a person and a cake. What the computer doesn't see is that this is a special Italian cake that's only served during Easter time. The boy is wearing his favorite t-shirt given to him as a gift by his father after a trip to Sydney, and you and I can all tell how happy he is and what's exactly on his mind at that moment.

FFL: Maar er zit meer aan vast dan alleen een persoon en een taart. De computer ziet niet dat dit een speciale Italiaanse taart is die alleen met Pasen wordt gegeten. De jongen draagt zijn lievelingsshirt die hij heeft gekregen van zijn vader na een reis naar Sydney, en iedereen ziet hoe blij hij is en waar hij precies aan denkt op dat moment.

This is my son Leo. On my quest for visual intelligence, I think of Leo constantly and the future world he will live in. When machines can see, doctors and nurses will have extra pairs of tireless eyes to help them to diagnose and take care of patients. Cars will run smarter and safer on the road. Robots, not just humans, will help us to brave the disaster zones to save the trapped and wounded. We will discover new species, better materials, and explore unseen frontiers with the help of the machines.

Dit is mijn zoon Leo. Bij mijn zoektocht naar visuele intelligentie denk ik steeds aan Leo en aan zijn toekomstige wereld. Als machines kunnen zien, zullen doktoren en verpleegsters een extra paar onvermoeibare ogen hebben om te helpen bij de diagnose en om voor de patiënten te zorgen. Auto's zullen slimmer en veiliger over de weg rijden.. Robots, niet alleen mensen, zullen ons helpen rampplekken te betreden om ingeslotenen en gewonden te redden. We zullen nieuwe soorten ontdekken en betere materialen, en ongeziene gebieden verkennen met behulp van machines.

Little by little, we're giving sight to the machines. First, we teach them to see. Then, they help us to see better. For the first time, human eyes won't be the only ones pondering and exploring our world. We will not only use the machines for their intelligence, we will also collaborate with them in ways that we cannot even imagine.

Beetje bij beetje geven we machines gezichtsvermogen. Eerst leren we ze te kijken. Daarna helpen ze ons bij het kijken. Voor het eerst zijn menselijke ogen niet de enige die over de wereld nadenken en haar verkennen. We gaan de machines niet alleen vanwege hun intelligentie gebruiken, en gaan met ze samenwerken op manieren die we ons niet kunnen voorstellen.

This is my quest: to give computers visual intelligence and to create a better future for Leo and for the world.

Dit is mijn zoektocht: computers visuele intelligentie geven en een betere toekomst geven aan Leo en aan de wereld.

Thank you.

Dank je wel.

(Applause)

(Applaus)