Let me show you something.

Lasciate che vi mostri qualcosa.

(Video) Girl: Okay, that's a cat sitting in a bed. The boy is petting the elephant. Those are people that are going on an airplane. That's a big airplane.

<i>Ok, è un gatto seduto sul letto.</i> <i>Il ragazzo sta accarezzando l'elefante.</i> <i>Sono persone che salgono su un aereo.</i> <i>È un grande aereo.</i>

Fei-Fei Li: This is a three-year-old child describing what she sees in a series of photos. She might still have a lot to learn about this world, but she's already an expert at one very important task: to make sense of what she sees. Our society is more technologically advanced than ever. We send people to the moon, we make phones that talk to us or customize radio stations that can play only music we like. Yet, our most advanced machines and computers still struggle at this task. So I'm here today to give you a progress report on the latest advances in our research in computer vision, one of the most frontier and potentially revolutionary technologies in computer science.

È una bambina di tre anni che descrive ciò che vede nelle foto. Anche se ha ancora tanto da imparare, è già un'esperta in un compito importante: capire ciò che vede. La tecnologia nella nostra società è più sviluppata che mai. Mandiamo persone sulla Luna, creiamo cellulari che ci parlano o personalizziamo le stazioni radio per ascoltare la musica che ci piace. Eppure, i computer e i dispositivi più avanzati non sono ancora in grado di svolgere questo compito. Oggi vi mostrerò un rapporto di avanzamento sui progressi della nostra ricerca sulla visione artificiale, una delle tecnologie informatiche più rivoluzionarie.

Yes, we have prototyped cars that can drive by themselves, but without smart vision, they cannot really tell the difference between a crumpled paper bag on the road, which can be run over, and a rock that size, which should be avoided. We have made fabulous megapixel cameras, but we have not delivered sight to the blind. Drones can fly over massive land, but don't have enough vision technology to help us to track the changes of the rainforests. Security cameras are everywhere, but they do not alert us when a child is drowning in a swimming pool. Photos and videos are becoming an integral part of global life. They're being generated at a pace that's far beyond what any human, or teams of humans, could hope to view, and you and I are contributing to that at this TED. Yet our most advanced software is still struggling at understanding and managing this enormous content. So in other words, collectively as a society, we're very much blind, because our smartest machines are still blind.

Sì, abbiamo prototipi di auto che si guidano da sole, ma senza la smart vision, non riescono a distinguere fra un sacchetto spiegazzato sulla strada che può essere investito e una pietra che sarebbe da evitare. <i>Abbiamo creato favolose fotocamere con megapixel,</i> <i>ma non abbiamo ancora ridato la vista ai ciechi.</i> <i>I droni volano su grandi parti di terra,</i> <i>ma la loro tecnologia visiva non basta</i> <i>a monitorare le variazioni delle foreste pluviali.</i> Ci sono telecamere a circuito chiuso ovunque, che però non ci avvertono quando un bambino sta affogando in una piscina. Video e foto stanno diventando parte integrante della vita globale. Sono generati a un ritmo più veloce di quello che ogni uomo o gruppi di uomini spera di poter avere, e vi contribuiamo in questo TED. Eppure il nostro software più avanzato non riesce ancora a capire e amministrare quest'enorme contenuto. In altri termini collettivamente siamo una società di ciechi perché le nostre macchine più intelligenti sono ancora cieche.

"Why is this so hard?" you may ask. Cameras can take pictures like this one by converting lights into a two-dimensional array of numbers known as pixels, but these are just lifeless numbers. They do not carry meaning in themselves. Just like to hear is not the same as to listen, to take pictures is not the same as to see, and by seeing, we really mean understanding. In fact, it took Mother Nature 540 million years of hard work to do this task, and much of that effort went into developing the visual processing apparatus of our brains, not the eyes themselves. So vision begins with the eyes, but it truly takes place in the brain.

Vi chiederete perché sia così difficile. <i>Le fotocamere scattano foto come questa,</i> <i>trasformando le luci in una matrice bidimensionale di numeri,</i> <i>i pixels,</i> <i>però sono solo numeri senza vita.</i> Non hanno alcun significato di per sé. Proprio come udire non è come ascoltare, scattare foto non è come vedere, e con vedere intendiamo capire. <i>In effetti, ci sono voluti 540 milioni anni di duro lavoro a Madre Natura</i> <i>per completare questo compito,</i> <i>e gran parte di questo sforzo</i> <i>è andato allo sviluppo dell'elaborazione ottica del cervello,</i> <i>non agli occhi.</i> <i>Quindi la visione inizia con gli occhi,</i> <i>ma in realtà avviene nel cervello.</i>

So for 15 years now, starting from my Ph.D. at Caltech and then leading Stanford's Vision Lab, I've been working with my mentors, collaborators and students to teach computers to see. Our research field is called computer vision and machine learning. It's part of the general field of artificial intelligence. So ultimately, we want to teach the machines to see just like we do: naming objects, identifying people, inferring 3D geometry of things, understanding relations, emotions, actions and intentions. You and I weave together entire stories of people, places and things the moment we lay our gaze on them.

Dunque da 15 anni, prima con il Ph.D al Caltech e poi a capo del Vision Lab di Stanford, <i>lavoro con i miei mentori, collaboratori e studenti</i> per insegnare ai computer a vedere. Il campo di ricerca si chiama visione artificiale e apprendimento automatico. Fa parte del campo generale dell'intelligenza artificiale. Allora in sostanza, vogliamo insegnare alle macchine a vedere proprio come noi: <i>indicare cose, riconoscere persone, dedurre la geometria 3D degli oggetti,</i> <i>comprendere relazioni, emozioni, azioni e intenzioni.</i> Tessiamo intere storie di persone, luoghi e cose quando fissiamo lo sguardo su di loro.

The first step towards this goal is to teach a computer to see objects, the building block of the visual world. In its simplest terms, imagine this teaching process as showing the computers some training images of a particular object, let's say cats, and designing a model that learns from these training images. How hard can this be? After all, a cat is just a collection of shapes and colors, and this is what we did in the early days of object modeling. We'd tell the computer algorithm in a mathematical language that a cat has a round face, a chubby body, two pointy ears, and a long tail, and that looked all fine. But what about this cat? (Laughter) It's all curled up. Now you have to add another shape and viewpoint to the object model. But what if cats are hidden? What about these silly cats? Now you get my point. Even something as simple as a household pet can present an infinite number of variations to the object model, and that's just one object.

Il primo passo verso questo scopo è insegnare a un computer a vedere cose, il mattone del mondo visivo. <i>In parole povere immaginate questo processo d'insegnamento</i> come mostrare ai computer immagini di un oggetto specifico, come gatti, <i>e creare un modello che impara da queste immagini.</i> <i>Quanto può essere difficile?</i> <i>Dopotutto, un gatto è solo un insieme di forme e colori,</i> <i>e l'abbiamo fatto nella prima fase di realizzazione dei modelli.</i> Abbiamo detto all'algoritmo con un linguaggio matematico che un gatto ha una faccia tonda, un corpo paffuto, due orecchie a punta e una coda lunga, e fin qui tutto ok. <i>Ma che dire di questo gatto?</i> <i>(Risate)</i> <i>È tutto accartocciato.</i> <i>Ora si deve aggiungere un'altra forma e punto di vista al modello.</i> <i>Ma se i gatti sono nascosti?</i> <i>Che dire di questi gatti sciocchi?</i> Ora mi capite. Anche qualcosa di semplice come un animale domestico può presentare un numero infinito di variazioni, ed è un oggetto solo.

So about eight years ago, a very simple and profound observation changed my thinking. No one tells a child how to see, especially in the early years. They learn this through real-world experiences and examples. If you consider a child's eyes as a pair of biological cameras, they take one picture about every 200 milliseconds, the average time an eye movement is made. So by age three, a child would have seen hundreds of millions of pictures of the real world. That's a lot of training examples. So instead of focusing solely on better and better algorithms, my insight was to give the algorithms the kind of training data that a child was given through experiences in both quantity and quality.

Allora otto anni fa, un'osservazione molto semplice e profonda ha cambiato il mio parere. Nessuno dice a un bambino come vedere, soprattutto nei primi anni. Lo imparano con esperienze e esempi del mondo reale. <i>Se considerate gli occhi di un bambino</i> <i>come un paio di fotocamere biologiche,</i> <i>scattano una foto ogni 200 millisecondi,</i> <i>il tempo medio di un movimento dell'occhio.</i> Dunque entro i 3 anni, un bambino vede centinaia di migliaia di immagini del mondo reale. Questi sono tanti esempi d'insegnamento. Così invece di concentrarci solo su algoritmi sempre migliori, la mia idea era dare agli algoritmi dati d'insegnamento come quelli che un bambino ottiene con le esperienze con la stessa qualità e quantità.

Once we know this, we knew we needed to collect a data set that has far more images than we have ever had before, perhaps thousands of times more, and together with Professor Kai Li at Princeton University, we launched the ImageNet project in 2007. Luckily, we didn't have to mount a camera on our head and wait for many years. We went to the Internet, the biggest treasure trove of pictures that humans have ever created. We downloaded nearly a billion images and used crowdsourcing technology like the Amazon Mechanical Turk platform to help us to label these images. At its peak, ImageNet was one of the biggest employers of the Amazon Mechanical Turk workers: together, almost 50,000 workers from 167 countries around the world helped us to clean, sort and label nearly a billion candidate images. That was how much effort it took to capture even a fraction of the imagery a child's mind takes in in the early developmental years.

Una volta capito questo, dovevamo accumulare un set di dati che aveva più immagini che mai, forse migliaia di volte di più, e con il Professore Kai Li dell'Università di Princeton, abbiamo lanciato il progetto ImageNet nel 2007. Per fortuna non abbiamo dovuto montare una videocamera in testa e aspettare tanti anni. Siamo andati su Internet, il più grande tesoro d'immagini che gli uomini abbiano mai creato. Abbiamo scaricato quasi un miliardo d'immagini e usato il crowdsourcing come Amazon Mechanical Turk per aiutarci a etichettarle. <i>Al suo culumine ImageNet era uno dei maggiori datori di lavoro</i> <i>di Amazon Mechanical Turk:</i> insieme, quasi 50.000 dipendenti di 167 paesi in tutto il mondo ci hanno aiutato a pulire, smistare e etichettare quasi un miliardo di aspiranti immagini. Ecco lo sforzo che c'è voluto a catturare persino una frazione delle immagini della mente infantile nei primi anni di sviluppo.

In hindsight, this idea of using big data to train computer algorithms may seem obvious now, but back in 2007, it was not so obvious. We were fairly alone on this journey for quite a while. Some very friendly colleagues advised me to do something more useful for my tenure, and we were constantly struggling for research funding. Once, I even joked to my graduate students that I would just reopen my dry cleaner's shop to fund ImageNet. After all, that's how I funded my college years.

A cose fatte l'idea di usare Big Data per addestrare algoritmi informatici forse oggi sembra ovvia, però nel 2007 non lo era così tanto. Per un bel po' siamo stati soli in questo viaggio. Dei colleghi mi hanno consigliato di fare qualcosa di più utile all'incarico e avevamo di continuo difficoltà con il finanziamento. Una volta ho scherzato con i miei studenti dicendo che avrei riaperto la lavanderia per finanziare ImageNet. Alla fine in questo modo ho finanziato i miei anni al college.

So we carried on. In 2009, the ImageNet project delivered a database of 15 million images across 22,000 classes of objects and things organized by everyday English words. In both quantity and quality, this was an unprecedented scale. As an example, in the case of cats, we have more than 62,000 cats of all kinds of looks and poses and across all species of domestic and wild cats. We were thrilled to have put together ImageNet, and we wanted the whole research world to benefit from it, so in the TED fashion, we opened up the entire data set to the worldwide research community for free. (Applause)

Allora abbiamo continuato. <i>Nel 2009 ImageNet project ha consegnato</i> <i>un database di 15 milioni d'immagini</i> <i>in 22.000 categorie di oggetti e cose</i> organizzate in parole di uso quotidiano. Sia in quantità sia in qualità era una scala senza precedenti. <i>Per esempio, nel caso dei gatti,</i> <i>abbiamo più di 62.000 gatti</i> <i>di tutti i tipi di aspetto e pose</i> <i>e in tutte le specie di gatti domestici e selvatici.</i> Eravamo emozionati per il completamento di ImageNet, e volevamo che tutto il mondo di ricerca ne beneficiasse, così come TED abbiamo aperto gratis tutto il set di dati alla comunità di ricerca mondiale. (Applausi)

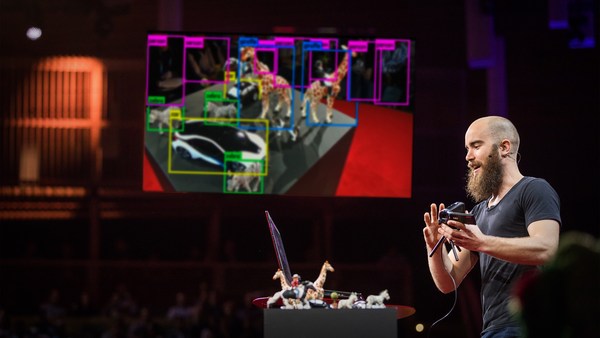

Now that we have the data to nourish our computer brain, we're ready to come back to the algorithms themselves. As it turned out, the wealth of information provided by ImageNet was a perfect match to a particular class of machine learning algorithms called convolutional neural network, pioneered by Kunihiko Fukushima, Geoff Hinton, and Yann LeCun back in the 1970s and '80s. Just like the brain consists of billions of highly connected neurons, a basic operating unit in a neural network is a neuron-like node. It takes input from other nodes and sends output to others. Moreover, these hundreds of thousands or even millions of nodes are organized in hierarchical layers, also similar to the brain. In a typical neural network we use to train our object recognition model, it has 24 million nodes, 140 million parameters, and 15 billion connections. That's an enormous model. Powered by the massive data from ImageNet and the modern CPUs and GPUs to train such a humongous model, the convolutional neural network blossomed in a way that no one expected. It became the winning architecture to generate exciting new results in object recognition. This is a computer telling us this picture contains a cat and where the cat is. Of course there are more things than cats, so here's a computer algorithm telling us the picture contains a boy and a teddy bear; a dog, a person, and a small kite in the background; or a picture of very busy things like a man, a skateboard, railings, a lampost, and so on. Sometimes, when the computer is not so confident about what it sees, we have taught it to be smart enough to give us a safe answer instead of committing too much, just like we would do, but other times our computer algorithm is remarkable at telling us what exactly the objects are, like the make, model, year of the cars.

Ora grazie ai dati per nutrire il cervello del nostro computer siamo pronti a ritornare agli algoritmi. Infatti, la ricchezza d'informazioni di ImageNet <i>era perfetta per una particolare classe di algoritmi di apprendimento automatico</i> <i>chiamata rete neurale,</i> innovazione di Kunihiko Fukushima, Geoff Hinton e Yann LeCun negli anni '70 e '80. <i>Proprio come il cervello è fatto di miliardi di neuroni ben collegati,</i> <i>un'unità operativa elementare in una rete neurale</i> <i>è un nodo tipo neurone.</i> <i>Prende input di altri nodi</i> <i>e invia output a altri.</i> <i>Inoltre quelle centinaia di migliaia o persino milioni di nodi</i> <i>sono organizzate in strati gerarchici,</i> anche simili al cervello. In una tipica rete neurale usata per addestrare il modello di riconoscimento ci sono 24 milioni di nodi, 140 milioni di parametri e 15 miliardi di connessioni. È un modello enorme. Alimentata dai dati di ImageNet e dalle moderne CPU e GPU per addestrare un modello così immenso, la rete neurale convoluzionale è sbocciata in un modo che nessuno si aspettava. È diventata l'architettura vincente <i>che genera risultati eclatanti nel riconoscimento degli oggetti.</i> <i>Questo è un computer che ci dice</i> <i>che in questa foto c'è un gatto</i> <i>e dov'è il gatto.</i> <i>Certo ci sono anche altre cose oltre ai gatti</i> <i>quindi ecco un algoritmo informatico che ci dice</i> <i>che nella foto ci sono un ragazzo e un orsacchiotto;</i> <i>un cane, una persona e un aquilone sullo sfondo;</i> <i>o una foto di molte cose curiose</i> <i>come un uomo, uno skateboard, ringhiere, un lampione e così via.</i> <i>A volte quando il computer non è tanto sicuro di quello che vede,</i> <i>gli insegnamo a essere abbastanza intelligente</i> <i>da darci una risposta sicura invece d'impegnarsi troppo,</i> <i>proprio come faremmo noi,</i> <i>ma altre volte gli algoritmi ci dicono in modo eccezionale</i> <i>esattamente che oggetti sono,</i> <i>come tipo, modello, anno delle macchine.</i>

We applied this algorithm to millions of Google Street View images across hundreds of American cities, and we have learned something really interesting: first, it confirmed our common wisdom that car prices correlate very well with household incomes. But surprisingly, car prices also correlate well with crime rates in cities, or voting patterns by zip codes.

<i>Abbiamo applicato questi algoritmi a tante immagini di Google Street View</i> in centinaia di città americane e abbiamo imparato una cosa molto interessante: primo, ha confermato il nostro sapere comune che i prezzi delle auto sono legati molto bene <i>ai redditi familiari.</i> <i>Ma stupisce che i prezzi delle auto siano legati bene anche</i> <i>al tasso di criminalità nelle città,</i> <i>o agli schemi di votazione con codici postali.</i>

So wait a minute. Is that it? Has the computer already matched or even surpassed human capabilities? Not so fast. So far, we have just taught the computer to see objects. This is like a small child learning to utter a few nouns. It's an incredible accomplishment, but it's only the first step. Soon, another developmental milestone will be hit, and children begin to communicate in sentences. So instead of saying this is a cat in the picture, you already heard the little girl telling us this is a cat lying on a bed.

Allora aspettate. Ce l'abbiamo fatta? Il computer ha già le stesse capacità dell'uomo o perfino migliori? Non ancora. Finora abbiamo insegnato ai computer a vedere oggetti. È come un bambino piccolo che impara a pronunciare alcuni sostantivi. È un risultato incredibile, ma è solo il primo passo. Presto raggiungeremo un'altra pietra miliare dello sviluppo e i bambini inizieranno a comunicare con frasi. Allora invece di dire che c'è un gatto nella foto, avete sentito la ragazzina dire che è un gatto sdraiato sul letto.

So to teach a computer to see a picture and generate sentences, the marriage between big data and machine learning algorithm has to take another step. Now, the computer has to learn from both pictures as well as natural language sentences generated by humans. Just like the brain integrates vision and language, we developed a model that connects parts of visual things like visual snippets with words and phrases in sentences.

Quindi per insegnare al computer a vedere una foto e generare frasi, il connubio fra Big Data e algoritmo di apprendimento automatico deve fare un altro passo. Ora il computer deve imparare sia dalle foto che dalle frasi naturali generate dagli uomini. <i>Proprio come il cervello integra lingua e visione,</i> <i>abbiamo sviluppato un modello che collega parti di oggetti ottici</i> <i>come frammenti ottici</i> <i>a parole e espressioni nelle frasi.</i>

About four months ago, we finally tied all this together and produced one of the first computer vision models that is capable of generating a human-like sentence when it sees a picture for the first time. Now, I'm ready to show you what the computer says when it sees the picture that the little girl saw at the beginning of this talk.

<i>Circa quattro mesi fa,</i> <i>abbiamo finalmente provato tutto insieme</i> <i>e prodotto uno dei primi modelli di visione artificiale</i> <i>capace di generare una frase tipo quella umana</i> <i>quando vede una foto per la prima volta.</i> Ora sono pronta a mostrarvi cosa dice il computer quando vede la foto che la ragazzina ha visto all'inizio di questa conferenza.

(Video) Computer: A man is standing next to an elephant. A large airplane sitting on top of an airport runway.

<i>Un uomo in piedi vicino a un elefante.</i> <i>Un grande aereo sulla pista di un aeroporto.</i>

FFL: Of course, we're still working hard to improve our algorithms, and it still has a lot to learn. (Applause)

<i>Certo, lavoriamo duro per migliorare i nostri algoritmi</i> e ci sono ancora molte cose da imparare. (Applausi)

And the computer still makes mistakes.

E il computer fa ancora errori.

(Video) Computer: A cat lying on a bed in a blanket.

<i>Un gatto sdraiato a letto con una coperta.</i>

FFL: So of course, when it sees too many cats, it thinks everything might look like a cat.

<i>Quindi quando vede troppi gatti,</i> <i>crede che tutto somigli a un gatto.</i>

(Video) Computer: A young boy is holding a baseball bat. (Laughter)

<i>Un ragazzino con una mazza da baseball.</i> (Risate)

FFL: Or, if it hasn't seen a toothbrush, it confuses it with a baseball bat.

<i>Se non ha mai visto uno spazzolino lo confonde con una mazza da baseball.</i>

(Video) Computer: A man riding a horse down a street next to a building. (Laughter)

<i>Un uomo a cavallo in una strada vicino a un edificio.</i> <i>(Risate)</i>

FFL: We haven't taught Art 101 to the computers.

Non abbiamo insegnato l'Art. 101 ai computer.

(Video) Computer: A zebra standing in a field of grass.

<i>Una zebra in una prateria.</i>

FFL: And it hasn't learned to appreciate the stunning beauty of nature like you and I do.

<i>E non ha imparato a apprezzare la magnifica bellezza della natura</i> <i>come me e voi.</i>

So it has been a long journey. To get from age zero to three was hard. The real challenge is to go from three to 13 and far beyond. Let me remind you with this picture of the boy and the cake again. So far, we have taught the computer to see objects or even tell us a simple story when seeing a picture.

Quindi è un lungo vaggio. Andare dall'età zero all'età tre era faticoso. La vera sfida è andare da 3 a 13 e più lontano. Ripensate alla foto del bambino con la torta. <i>Finora abbiamo insegnato al computer a vedere oggetti</i> <i>o a raccontarci una semplice storia quando vede un'immagine.</i>

(Video) Computer: A person sitting at a table with a cake.

<i>Una persona seduta a tavola con una torta.</i>

FFL: But there's so much more to this picture than just a person and a cake. What the computer doesn't see is that this is a special Italian cake that's only served during Easter time. The boy is wearing his favorite t-shirt given to him as a gift by his father after a trip to Sydney, and you and I can all tell how happy he is and what's exactly on his mind at that moment.

<i>Ma c'è molto di più in questa foto</i> <i>di una persona con una torta.</i> <i>Ciò che il computer non vede è che è una torta italiana speciale</i> <i>che si serve solo a Pasqua.</i> <i>Il bambino indossa la sua t-shirt preferita</i> <i>regalatagli dal padre dopo un viaggio a Sidney,</i> e possiamo notare quanto sia felice e cosa c'è di preciso nella sua mente in quel momento.

This is my son Leo. On my quest for visual intelligence, I think of Leo constantly and the future world he will live in. When machines can see, doctors and nurses will have extra pairs of tireless eyes to help them to diagnose and take care of patients. Cars will run smarter and safer on the road. Robots, not just humans, will help us to brave the disaster zones to save the trapped and wounded. We will discover new species, better materials, and explore unseen frontiers with the help of the machines.

Questo è mio figlio Leo. Nella mia ricerca dell'intelligenza ottica, penso a Leo di continuo e al mondo futuro in cui vivrà. <i>Quando le macchine potranno vedere,</i> <i>i medici e gli infermieri avranno un paio extra di occhi instancabili</i> <i>a aiutarli con diagnosi e cura dei pazienti.</i> <i>Le auto saranno più intelligenti e sicure sulla strada.</i> <i>I robot, non solo gli umani,</i> <i>ci aiuteranno a salvare persone intrappolate e ferite.</i> <i>Scopriremo nuove specie, materiali migliori,</i> <i>e esploreremo frontiere invisibili con l'aiuto delle macchine.</i>

Little by little, we're giving sight to the machines. First, we teach them to see. Then, they help us to see better. For the first time, human eyes won't be the only ones pondering and exploring our world. We will not only use the machines for their intelligence, we will also collaborate with them in ways that we cannot even imagine.

Un po' alla volta diamo la vista alle macchine. In primo luogo le insegnamo a vedere. Poi ci aiutano a vedere meglio. Per la prima volta gli occhi umani non saranno i soli a meditare e esplorare il nostro mondo. Useremo le macchine non solo per la loro intelligenza, ma collaboreremo anche con loro in modi che neanche immaginiamo.

This is my quest: to give computers visual intelligence and to create a better future for Leo and for the world.

Questa è la mia ricerca: dare ai computer intelligenza ottica e creare un futuro migliore per Leo e per il mondo.

Thank you.

Grazie.

(Applause)

(Applausi)