Let me show you something.

Engedjék meg, hogy mutassak önöknek valamit.

(Video) Girl: Okay, that's a cat sitting in a bed. The boy is petting the elephant. Those are people that are going on an airplane. That's a big airplane.

(Videó) Kislány: Oké, az egy macska, amely egy ágyon ül. A fiú cirógatja az elefántot. Azok az emberek mennek egy repülőgéphez. Az egy nagy repülőgép.

Fei-Fei Li: This is a three-year-old child describing what she sees in a series of photos. She might still have a lot to learn about this world, but she's already an expert at one very important task: to make sense of what she sees. Our society is more technologically advanced than ever. We send people to the moon, we make phones that talk to us or customize radio stations that can play only music we like. Yet, our most advanced machines and computers still struggle at this task. So I'm here today to give you a progress report on the latest advances in our research in computer vision, one of the most frontier and potentially revolutionary technologies in computer science.

Fei-Fei Li: Ez egy hároméves gyermek leírása arról, amit egy sor fotón lát. Lehet, hogy sokat kell még tanulnia a világról, de már szakértője egy nagyon fontos feladatnak: annak, hogy megértse, amit lát. Társadalmunk technológiailag fejlettebb, mint valaha. Embereket küldünk a Holdra, telefonokat készítünk, melyek beszélnek, vagy rádióállomásokat állítunk be a saját zenei ízlésünknek megfelelően. Mégis a legfejlettebb gépeink és számítógépeink csak küszködnek ezzel a feladattal. Azért vagyok ma itt, hogy jelentést adjak önöknek a számítógépes képfelismerés legújabb kutatási eredményeiről, a számítástechnika egyik valószínűleg legforradalmibb technológiai területéről.

Yes, we have prototyped cars that can drive by themselves, but without smart vision, they cannot really tell the difference between a crumpled paper bag on the road, which can be run over, and a rock that size, which should be avoided. We have made fabulous megapixel cameras, but we have not delivered sight to the blind. Drones can fly over massive land, but don't have enough vision technology to help us to track the changes of the rainforests. Security cameras are everywhere, but they do not alert us when a child is drowning in a swimming pool. Photos and videos are becoming an integral part of global life. They're being generated at a pace that's far beyond what any human, or teams of humans, could hope to view, and you and I are contributing to that at this TED. Yet our most advanced software is still struggling at understanding and managing this enormous content. So in other words, collectively as a society, we're very much blind, because our smartest machines are still blind.

Igen, vannak olyan prototípus autóink, amelyek képesek önmagukat vezetni, de tökéletes látás nélkül, nem tudnak igazán megkülönböztetni egy összegyűrt papírtasakot az úton, amelyen áthajthatunk, egy ugyanolyan méretű kődarabtól, amelyet el kellene kerülni. Mesés megapixeles kameráink vannak, de nem segítünk látni a vakoknak. A drónok képesek hatalmas területeket berepülni, de nincs megfelelő látási technológiájuk ahhoz, hogy segítsenek nyomon követni az esőerdők változásait. Biztonsági kamerák vannak mindenhol, de nem figyelmeztetnek minket, amikor egy gyerek beleesik az úszómedencébe. A fotók és videók szerves részévé váltak az életnek. Olyan ütemben keletkeznek, ami messze túl van azon, amit az ember vagy embercsoportok remélhetnének látni. Önök és én ezen a TED-en most közreműködhetünk ebben. Még a legfejlettebb szoftvereink is csak küzdenek ennek a hatalmas tartalomnak a megértésével és kezelésével. Más szavakkal, együttesen, egy közösségként szinte teljesen vakok vagyunk, mert a legokosabb gépeink még vakok.

"Why is this so hard?" you may ask. Cameras can take pictures like this one by converting lights into a two-dimensional array of numbers known as pixels, but these are just lifeless numbers. They do not carry meaning in themselves. Just like to hear is not the same as to listen, to take pictures is not the same as to see, and by seeing, we really mean understanding. In fact, it took Mother Nature 540 million years of hard work to do this task, and much of that effort went into developing the visual processing apparatus of our brains, not the eyes themselves. So vision begins with the eyes, but it truly takes place in the brain.

"Miért olyan nehéz ez?" - kérdezhetik. A kamerák képesek ilyen képeket készíteni, a fényeket kétdimenziós számsorokba konvertálják, az úgynevezett pixelekbe, de ezek csak élettelen számok. Ezek nem hordoznak magukban jelentést. Éppen úgy, ahogy nem ugyanaz a hallani, mint a hallgatni, képet készíteni sem ugyanaz, mint látni, és a látás alatt tulajdonképpen a megértést értjük. Valójában, az Anyatermészet kemény munkát végez 540 millió éve, ennek a feladatnak az elvégzésével, és rengeteg fáradozásba került az agyunk vizuális feldolgozással foglalkozó részének a kifejlesztése, nem a szemek maguk. A látás a szemekkel kezdődik, de valójában az agyban megy végbe.

So for 15 years now, starting from my Ph.D. at Caltech and then leading Stanford's Vision Lab, I've been working with my mentors, collaborators and students to teach computers to see. Our research field is called computer vision and machine learning. It's part of the general field of artificial intelligence. So ultimately, we want to teach the machines to see just like we do: naming objects, identifying people, inferring 3D geometry of things, understanding relations, emotions, actions and intentions. You and I weave together entire stories of people, places and things the moment we lay our gaze on them.

15 éve már, hogy a Caltechnél a Ph.D-mtől kezdve, majd a Stanford Látóképeséggel foglalkozó laborját vezetve, a mentoraimmal, munkatársaimmal és tanítványaimmal azon dolgozom, hogy megtanítsam a számítógépeket látni. Kutatási területünk a számítógépes látás és gépi tanulás. Ez a mesterséges intelligencia tudományának a része. Végső soron meg akarjuk tanítani a gépeket úgy látni, ahogy mi látunk: tárgyak megnevezése, emberek azonosítása, következtetés a tárgyak 3D-s alakjára, a kapcsolatok, érzések, tevékenységek és szándékok megértése. Önök és én egész történeteket szövünk együtt emberekről, helyekről és dolgokról abban a pillanatban, amikor rájuk pillantunk.

The first step towards this goal is to teach a computer to see objects, the building block of the visual world. In its simplest terms, imagine this teaching process as showing the computers some training images of a particular object, let's say cats, and designing a model that learns from these training images. How hard can this be? After all, a cat is just a collection of shapes and colors, and this is what we did in the early days of object modeling. We'd tell the computer algorithm in a mathematical language that a cat has a round face, a chubby body, two pointy ears, and a long tail, and that looked all fine. But what about this cat? (Laughter) It's all curled up. Now you have to add another shape and viewpoint to the object model. But what if cats are hidden? What about these silly cats? Now you get my point. Even something as simple as a household pet can present an infinite number of variations to the object model, and that's just one object.

Az első lépés a cél felé, hogy megtanítjuk a számítógépeket a tárgyakat, a képi világ építőköveit látni. A legegyszerűbben kifejezve, képzeljék el ennek a tanításnak a folyamatát: mutatunk a számítógépeknek néhány gyakorló képet egy bizonyos dologról, mondjuk a macskákról és tervezünk egy modellt, amely tanul ezekből a gyakorló képekből. Milyen nehéz lehet ez? Végül is, egy macska csak színek és formák gyűjteménye, és ez az, amit a dolgok modellezésének első napjaiban csináltunk. Matematikai nyelven mondtuk el a számítógépes algoritmusnak, hogy egy macskának egy kerek arca, pufók teste, két hegyes füle és egy hosszú farka van, és úgy tűnt, hogy minden rendben. De mit szólnak ehhez a macskához? (Nevetés) Ez teljesen ki van csavarodva. Most hozzá kell tenniük egy egész más formát és nézőpontot a dolog modelljéhez. De mi van, ha a macskák elbújnak? Mit szólnak ezekhez a bolond macskákhoz? Elmondom a véleményemet. Még ha valami olyan egyszerű is, mint egy háziállat, végtelen sok modellvariációt képes felvonultatni, és ez csak egyetlen objektum.

So about eight years ago, a very simple and profound observation changed my thinking. No one tells a child how to see, especially in the early years. They learn this through real-world experiences and examples. If you consider a child's eyes as a pair of biological cameras, they take one picture about every 200 milliseconds, the average time an eye movement is made. So by age three, a child would have seen hundreds of millions of pictures of the real world. That's a lot of training examples. So instead of focusing solely on better and better algorithms, my insight was to give the algorithms the kind of training data that a child was given through experiences in both quantity and quality.

Így kb. 8 évvel ezelőtt egy nagyon és mély megfigyelés megváltoztatta a gondolkodásomat. Senki nem mondja meg egy gyermeknek, hogy hogyan lásson, különösen az első években. A valós világ tapasztalatain és példáin keresztül tanulják ezt meg. Ha egy gyermek szemeit egy pár biológiai kamerának tekintjük, ezek körülbelül 200 ezredmásod- percenként készítenek egy képet, ez az átlagos időtartama egy szemmozdulatnak. Így hároméves korára egy gyermek több száz millió képet lát a valós világról. Az rengeteg gyakorló példa. Így a kizárólag az egyre jobb algoritmusokra koncentrálás helyett, úgy éreztem, hogy az adatok begyakorlására alkalmas algoritmusokat kellene adnom, ahogy egy gyermeknek, a tapasztalatokon keresztül minőségben és mennyiségben egyaránt.

Once we know this, we knew we needed to collect a data set that has far more images than we have ever had before, perhaps thousands of times more, and together with Professor Kai Li at Princeton University, we launched the ImageNet project in 2007. Luckily, we didn't have to mount a camera on our head and wait for many years. We went to the Internet, the biggest treasure trove of pictures that humans have ever created. We downloaded nearly a billion images and used crowdsourcing technology like the Amazon Mechanical Turk platform to help us to label these images. At its peak, ImageNet was one of the biggest employers of the Amazon Mechanical Turk workers: together, almost 50,000 workers from 167 countries around the world helped us to clean, sort and label nearly a billion candidate images. That was how much effort it took to capture even a fraction of the imagery a child's mind takes in in the early developmental years.

Amint ezt felismertük, rögtön tudtuk, hogy gyűjtenünk kell egy adathalmazt, ami sokkal több képet fog tartalmazni, mint amennyivel valaha is rendelkeztünk, talán több ezerszer többet, és Kai Li professzorral közösen a Princeton Egyetemen, 2007-ben elindítottuk az ImageNet projektet. Szerencsére nem kellett egy kamerát szerelnünk a fejünkre, és évekig várni. Felmentünk az Internetre, a képek legnagyobb tárházára, amit az emberek valaha létrehoztak. Majdnem egymilliárd képet töltöttünk le és az Amazon Mechanical Turk crowdsourcing technológiát használva felcímkéztük ezeket a képeket. A csúcson az ImageNet volt a Mechanical Turk egyik legnagyobb foglalkoztatója: együttesen, majdnem 50 000 dolgozó a világ 167 országából segített nekünk kitisztítani, rendszerezni és felcímkézni majdnem egymilliárd kijelölt képet. Ilyen sok erőfeszítésbe került csak egy töredékét rögzíteni annak a képanyagnak, amit egy gyermek agya a fejlődésének első éveiben befogad.

In hindsight, this idea of using big data to train computer algorithms may seem obvious now, but back in 2007, it was not so obvious. We were fairly alone on this journey for quite a while. Some very friendly colleagues advised me to do something more useful for my tenure, and we were constantly struggling for research funding. Once, I even joked to my graduate students that I would just reopen my dry cleaner's shop to fund ImageNet. After all, that's how I funded my college years.

Utólag a "big data" használatának az ötlete a számítógépes algoritmusok tanítására már nyilvánvalónak tűnhet, de 2007-ben ez nem volt olyan kézenfekvő. Meglehetősen egyedül voltunk ezen az úton egy jó darabig. Néhány kedves kollégám azt tanácsolta, hogy hasznosabb dologgal töltsem az időmet és állandóan harcoltunk a kutatási támogatásért. Egyszer még azt is mondtam viccesen a végzős diákjaimnak, hogy újranyitnám a ruhatisztító boltomat, hogy az ImageNet-et támogassam. Végül is, így finanszíroztam a főiskolai éveimet.

So we carried on. In 2009, the ImageNet project delivered a database of 15 million images across 22,000 classes of objects and things organized by everyday English words. In both quantity and quality, this was an unprecedented scale. As an example, in the case of cats, we have more than 62,000 cats of all kinds of looks and poses and across all species of domestic and wild cats. We were thrilled to have put together ImageNet, and we wanted the whole research world to benefit from it, so in the TED fashion, we opened up the entire data set to the worldwide research community for free. (Applause)

Tehát folytattuk. 2009-ben az ImageNet egy 15 millió képből álló adatbázist adott át, az objektumokat és dolgokat 22 000 osztályba sorolva, mindennapos angol szavak szerint elrendezve. Minőségben és mennyiségben egyaránt példátlan méretű. Például a macskák esetében, több mint 62 000 képünk volt mindenféle külsejű és pózoló minden fajta házi- és vadmacskákról. Le voltunk nyűgözve, hogy együtt létrehoztuk az ImageNet-et, és azt akartuk, hogy az egész kutatási világ profitáljon ebből, így a TED módszerével hozzáférhetővé tettük az egész adatállományt. az egész világ kutató közösségének, ingyenesen. (Taps)

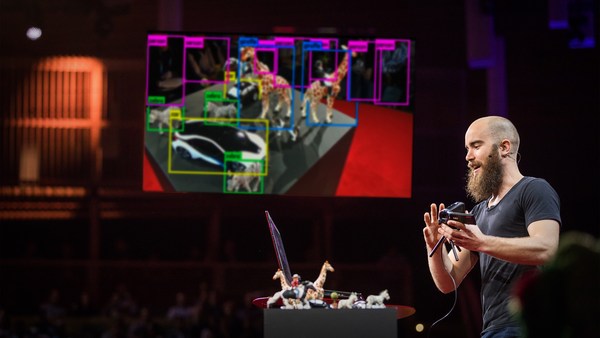

Now that we have the data to nourish our computer brain, we're ready to come back to the algorithms themselves. As it turned out, the wealth of information provided by ImageNet was a perfect match to a particular class of machine learning algorithms called convolutional neural network, pioneered by Kunihiko Fukushima, Geoff Hinton, and Yann LeCun back in the 1970s and '80s. Just like the brain consists of billions of highly connected neurons, a basic operating unit in a neural network is a neuron-like node. It takes input from other nodes and sends output to others. Moreover, these hundreds of thousands or even millions of nodes are organized in hierarchical layers, also similar to the brain. In a typical neural network we use to train our object recognition model, it has 24 million nodes, 140 million parameters, and 15 billion connections. That's an enormous model. Powered by the massive data from ImageNet and the modern CPUs and GPUs to train such a humongous model, the convolutional neural network blossomed in a way that no one expected. It became the winning architecture to generate exciting new results in object recognition. This is a computer telling us this picture contains a cat and where the cat is. Of course there are more things than cats, so here's a computer algorithm telling us the picture contains a boy and a teddy bear; a dog, a person, and a small kite in the background; or a picture of very busy things like a man, a skateboard, railings, a lampost, and so on. Sometimes, when the computer is not so confident about what it sees, we have taught it to be smart enough to give us a safe answer instead of committing too much, just like we would do, but other times our computer algorithm is remarkable at telling us what exactly the objects are, like the make, model, year of the cars.

Most, hogy már vannak adataink, amit betápláljunk a számítógépeink agyába, készen állunk arra, hogy visszatérjünk magukhoz az algoritmusokhoz. Mint kiderült, az ImageNet által biztosított információ értéke tökéletesen illeszkedett a gépi tanulási algoritmusok egy bizonyos osztályához, amit konvolúciós neurális hálónak hívunk, és aminek Kunihiko Fukushima, Geoff Hinton és Yann LeCun voltak az úttörői régen az 1970-es és '80-as években. Ahogyan az agyban egymáshoz szorosan kapcsolódó idegsejtek milliárdjai vannak, ugyanúgy egy neurális háló operációs alapegysége egy neuronszerű csomópont. Ez bemenő adatokat fogad más csomópontoktól és kimenő adatokat küld a többinek. Ezen kívül, ez a több százezer vagy akár több millió csomópont hierarchikus rétegekbe szerveződött, az agyhoz hasonlóan. A tárgyfelismerési modellünk tanítására használt tipikus hálózat 24 millió csomópontot, 140 millió paramétert és 15 milliárd kapcsolatot tartalmaz. Ez egy hatalmas modell. E hatalmas modell tanításához használt óriási ImageNet-es adatmennyiségnek, valamint a modern processzoroknak köszönhetően a konvolúciós neurális háló senki által nem remélt iramban fejlődött. Ez lett a nyerő architektúra, ami izgalmas új eredményeket hozott az objektumfelismerésben. Ez egy számítógép, amely megmondja nekünk, hogy ezen a képen egy macska látható és hogy a macska hol van. Természetesen ott nem csak macskák vannak, ezért itt van egy számítógépes algoritmus, ami megmondja, hogy a képen egy fiú és egy teddy maci is van; egy kutya, egy ember, és egy kicsi papírsárkány a háttérben; vagy nagyon mozgalmas dolgoknak egy képe mint egy férfi, egy gördeszka, korlátok, egy lámpaoszlop és így tovább. Néha, amikor a számítógép nem biztos benne, hogy mit lát, megtanítottuk arra, hogy kellő biztonsággal válaszoljon, anélkül, hogy túl határozott lenne, éppúgy, ahogy mi tennénk Máskor viszont az algoritmusunk figyelemre méltó pontossággal közli. hogy milyen tárgyakat lát, mint az autók gyártmánya, modellje, évjárata.

We applied this algorithm to millions of Google Street View images across hundreds of American cities, and we have learned something really interesting: first, it confirmed our common wisdom that car prices correlate very well with household incomes. But surprisingly, car prices also correlate well with crime rates in cities, or voting patterns by zip codes.

Ezt az algoritmust alkalmaztuk a Google több millió utcaképére amerikai városok százairól és valami igazán érdekeset tapasztaltunk: először is, alátámasztotta a mindennapi bölcsességünket, hogy a kocsiárak nagyon szoros összefüggésben vannak a háztartási jövedelmekkel. De meglepő módon, szoros összefüggésben vannak a bűnözési rátával a városokban, valamint az irányítószámok szerinti szavazási mintákkal.

So wait a minute. Is that it? Has the computer already matched or even surpassed human capabilities? Not so fast. So far, we have just taught the computer to see objects. This is like a small child learning to utter a few nouns. It's an incredible accomplishment, but it's only the first step. Soon, another developmental milestone will be hit, and children begin to communicate in sentences. So instead of saying this is a cat in the picture, you already heard the little girl telling us this is a cat lying on a bed.

Na, álljunk csak meg egy percre!. Mi történik itt? A számítógép már elérte vagy még felül is múlta az emberi képességeket? Azért csak lassan a testtel! Mindeddig, csak azt tanítottuk meg a számítógépeknek, hogy lássák a tárgyakat. Ez olyan, mint amikor egy kis gyermek megtanul kimondani néhány főnevet. Ez egy hihetetlen teljesítmény, de csak az első lépés. Nemsokára elérünk a fejlődés egy másik mérföldkövéhez, és a gyerekek elkezdenek mondatokban kommunikálni. Így ahelyett, hogy "ez egy macska a képen", már azt hallották a kislánytól, hogy "egy macska fekszik egy ágyon".

So to teach a computer to see a picture and generate sentences, the marriage between big data and machine learning algorithm has to take another step. Now, the computer has to learn from both pictures as well as natural language sentences generated by humans. Just like the brain integrates vision and language, we developed a model that connects parts of visual things like visual snippets with words and phrases in sentences.

Ahhoz, hogy egy számítógépet megtanítsunk képeket látni és mondatokat alkotni, a big data technika és a gépi tanulási algoritmusok együttesének eggyel tovább kell lépnie. A számítógépnek képesnek kell lennie mind képekből, mind pedig emberek által alkotott természetes nyelvi mondatokból tanulni. Annak mintájára, ahogy az agy egyesíti a látást a nyelvvel, kifejlesztettünk egy modellt, ami összekapcsolja a látható dolgok részeit vizuális töredékekként, szavakkal és kifejezésekkel a mondatokban.

About four months ago, we finally tied all this together and produced one of the first computer vision models that is capable of generating a human-like sentence when it sees a picture for the first time. Now, I'm ready to show you what the computer says when it sees the picture that the little girl saw at the beginning of this talk.

Körülbelül négy hónappal ezelőtt végül mindezt összekötöttük és megalkottuk az első számítógép látómodellek egyikét, amely képes létrehozni egy emberihez hasonló mondatot, amikor először lát egy képet. Nos, készen állok bemutatni önöknek, hogy mit mond a számítógép, amikor látja a képet amit a kislány látott az előadás elején.

(Video) Computer: A man is standing next to an elephant. A large airplane sitting on top of an airport runway.

(Video) Számítógép: Egy férfi áll egy elefánt mellett. Egy nagy repülőgép ül egy reptéri kifutópálya tetején.

FFL: Of course, we're still working hard to improve our algorithms, and it still has a lot to learn. (Applause)

FFL: Természetesen még sokat kell dolgoznunk az algoritmusunk fejlesztésén, és ez még sokat fog tanulni. (Taps)

And the computer still makes mistakes.

A számítógép még követ el hibákat.

(Video) Computer: A cat lying on a bed in a blanket.

(Videó) Számítógép: Egy macska fekszik egy ágyon egy takaróban.

FFL: So of course, when it sees too many cats, it thinks everything might look like a cat.

FFL: Így természetesen, amikor túl sok macskát lát, azt gondolja, hogy minden hasonlít egy macskára.

(Video) Computer: A young boy is holding a baseball bat. (Laughter)

(Videó) Számítógép: Egy fiatal fiú tart egy baseball ütőt. (Nevetés)

FFL: Or, if it hasn't seen a toothbrush, it confuses it with a baseball bat.

FFL: Vagy, ha ez még nem látott fogkefét, összetéveszti egy baseballütővel.

(Video) Computer: A man riding a horse down a street next to a building. (Laughter)

(Videó) Számítógép: Egy férfi lovagol lenn az utcán egy épület mellett. (Nevetés)

FFL: We haven't taught Art 101 to the computers.

FFL: Még nem tanítottunk meg a művészet alapjait a számítógépeknek.

(Video) Computer: A zebra standing in a field of grass.

(Videó) Számítógép: Egy zebra áll egy füves mezőn.

FFL: And it hasn't learned to appreciate the stunning beauty of nature like you and I do.

FFL: És ez nem tanulta meg értékelni a természet lenyűgöző szépségét mint önök és én.

So it has been a long journey. To get from age zero to three was hard. The real challenge is to go from three to 13 and far beyond. Let me remind you with this picture of the boy and the cake again. So far, we have taught the computer to see objects or even tell us a simple story when seeing a picture.

Nos, ez egy hosszú út volt. Nehéz volt eljutni a nullától a három éves korig. Az igazi kihívás a háromtól a tizenháromig jutni és annak a határain is túl. Hadd emlékeztessem önöket a fiúnak és a tortának erre képére. Mindez idáig, megtanítottuk a számítógépet a tárgyakat látni vagy még egyszerű történeteket mondani nekünk, mikor egy meglát egy képet.

(Video) Computer: A person sitting at a table with a cake.

(Videó) Számítógép: Egy ember ül egy asztalnál egy tortával.

FFL: But there's so much more to this picture than just a person and a cake. What the computer doesn't see is that this is a special Italian cake that's only served during Easter time. The boy is wearing his favorite t-shirt given to him as a gift by his father after a trip to Sydney, and you and I can all tell how happy he is and what's exactly on his mind at that moment.

FFL: Azonban sokkal több látható ezen a képen, nemcsak egy ember és egy torta. Amit a számítógép nem lát az az, hogy ez egy különleges olasz torta, amit csak Húsvétkor szolgálnak fel. A fiú a kedvenc pólóját viseli, amit apukájától kapott ajándékba egy Sydney-i kirándulás után, és hogy önök és én mindannyian meg látjuk, hogy milyen boldog, és hogy pontosan mi járt a fejében abban a pillanatban.

This is my son Leo. On my quest for visual intelligence, I think of Leo constantly and the future world he will live in. When machines can see, doctors and nurses will have extra pairs of tireless eyes to help them to diagnose and take care of patients. Cars will run smarter and safer on the road. Robots, not just humans, will help us to brave the disaster zones to save the trapped and wounded. We will discover new species, better materials, and explore unseen frontiers with the help of the machines.

Ez a fiam Leo. A vizuális megértés utáni kutatásom során állandóan Leora gondolok, és a jövőbeni világra, amiben élni fog. Amikor a gépek képesek lesznek látni, az orvosoknak és az ápolóknak lesz egy plusz fáradhatatlan szempárjuk, amely segíteni fog a diagnózisban és a betegeket ellátásában. Az autók intelligensebben és biztonságosabban fognak haladni az úton. A robotok, nem csak az emberek, segíteni fognak nekünk katasztrófák helyszínén a csapdába esettek és sérültek mentésében. Új fajokat, jobb anyagokat fogunk felfedezni, és felfedezünk ismeretlen határterületeket a gépek segítségével.

Little by little, we're giving sight to the machines. First, we teach them to see. Then, they help us to see better. For the first time, human eyes won't be the only ones pondering and exploring our world. We will not only use the machines for their intelligence, we will also collaborate with them in ways that we cannot even imagine.

Lassanként, látóképességet adunk a gépeknek. Először megtanítjuk őket látni. Azután ők segítenek nekünk jobban látni. Első alkalommal, nem az emberi szemek lesznek az egyetlenek, melyek elmerengenek és felfedezik a világot. Nem csak az intelligenciájukért fogjuk használni a gépeket, olyan módon is együtt fogunk működni velük, amit még el sem tudunk képzelni.

This is my quest: to give computers visual intelligence and to create a better future for Leo and for the world.

Ez az én küldetésem: vizuális intelligenciát adni a számítógépeknek, és egy jobb jövőt teremteni Leo és világ számára.

Thank you.

Köszönöm.

(Applause)

(Taps)