Let me show you something.

Je vais vous montrer quelque chose.

(Video) Girl: Okay, that's a cat sitting in a bed. The boy is petting the elephant. Those are people that are going on an airplane. That's a big airplane.

(Enfant) C'est un chat assis sur un lit. Le garçon caresse l'éléphant. Des gens montent dans un avion. C'est un gros avion.

Fei-Fei Li: This is a three-year-old child describing what she sees in a series of photos. She might still have a lot to learn about this world, but she's already an expert at one very important task: to make sense of what she sees. Our society is more technologically advanced than ever. We send people to the moon, we make phones that talk to us or customize radio stations that can play only music we like. Yet, our most advanced machines and computers still struggle at this task. So I'm here today to give you a progress report on the latest advances in our research in computer vision, one of the most frontier and potentially revolutionary technologies in computer science.

(Fei-Fei Li) C'est une enfant de 3 ans qui décrit ce qu'elle voit sur des photos. Elle a peut-être encore beaucoup à apprendre, mais elle est déjà experte dans un domaine très important : comprendre ce qu'elle voit. Notre société est technologiquement plus avancée que jamais. On envoie des gens sur la Lune, on fait des téléphones qui nous parlent, on a des stations de radio qui ne passent que ce qu'on aime. Pourtant, les machines et les ordinateurs les plus avancés ont toujours du mal à faire ça. Alors aujourd'hui je vais vous expliquer où nous en sommes, nos dernières recherches sur la vision par ordinateur, l'une des technologies les plus novatrices et potentiellement révolutionnaires en informatique.

Yes, we have prototyped cars that can drive by themselves, but without smart vision, they cannot really tell the difference between a crumpled paper bag on the road, which can be run over, and a rock that size, which should be avoided. We have made fabulous megapixel cameras, but we have not delivered sight to the blind. Drones can fly over massive land, but don't have enough vision technology to help us to track the changes of the rainforests. Security cameras are everywhere, but they do not alert us when a child is drowning in a swimming pool. Photos and videos are becoming an integral part of global life. They're being generated at a pace that's far beyond what any human, or teams of humans, could hope to view, and you and I are contributing to that at this TED. Yet our most advanced software is still struggling at understanding and managing this enormous content. So in other words, collectively as a society, we're very much blind, because our smartest machines are still blind.

Oui, nous avons des prototypes de voitures qui conduisent toutes seules, mais sans la vision intelligente, elles ne font pas la différence entre un sac de papier roulé en boule, que l'on peut écraser, et une pierre qu'il faut éviter. Nous fabriquons des appareils photo à mégapixels incroyables, mais nous n'avons pas donné la vue aux aveugles. Les drones peuvent parcourir de grandes distances mais la technologie n'est pas assez avancée pour suivre l'évolution des forêts tropicales. Il y a des caméras de sécurité partout, mais elles ne savent pas nous alerter quand un enfant se noie dans une piscine. La photo et la vidéo font partie de notre vie. Elles sont générées tellement vite qu'aucun humain ou groupe d'humains ne peut tout voir, Vous et moi, nous y contribuons, avec cette conférence TED. Pourtant nos programmes les plus avancés ont du mal à comprendre et à gérer cet énorme contenu. En d'autres termes, nous, la société, sommes vraiment aveugles, parce que nos plus intelligentes machines sont encore aveugles.

"Why is this so hard?" you may ask. Cameras can take pictures like this one by converting lights into a two-dimensional array of numbers known as pixels, but these are just lifeless numbers. They do not carry meaning in themselves. Just like to hear is not the same as to listen, to take pictures is not the same as to see, and by seeing, we really mean understanding. In fact, it took Mother Nature 540 million years of hard work to do this task, and much of that effort went into developing the visual processing apparatus of our brains, not the eyes themselves. So vision begins with the eyes, but it truly takes place in the brain.

« Pourquoi est-ce si difficile ? », pourriez-vous demander. Un appareil peut prendre une photo comme celle-ci, il convertit la lumière en tableaux bidimensionnels que l'on nomme pixels, mais ce ne sont que des nombres sans vie. Par eux-mêmes, ils ne signifient rien. Tout comme entendre n'est pas la même chose qu'écouter, prendre une photo, ce n'est pas comme voir, et par « voir », entendez « comprendre ». En fait, Mère Nature a travaillé dur 540 millions d'années pour accomplir cette tâche, et le plus gros de cet effort a été le développement de l'appareil qui produit la vision dans notre cerveau, pas les yeux. La vision commence avec les yeux, mais tout se passe en fait dans le cerveau.

So for 15 years now, starting from my Ph.D. at Caltech and then leading Stanford's Vision Lab, I've been working with my mentors, collaborators and students to teach computers to see. Our research field is called computer vision and machine learning. It's part of the general field of artificial intelligence. So ultimately, we want to teach the machines to see just like we do: naming objects, identifying people, inferring 3D geometry of things, understanding relations, emotions, actions and intentions. You and I weave together entire stories of people, places and things the moment we lay our gaze on them.

Depuis maintenant 15 ans, d'abord en thèse à Caltech puis à la tête du Vision Lab à Stanford, je travaille avec mes mentors, collaborateurs et étudiants pour apprendre la vision aux ordinateurs. Il s'agit de vision par ordinateur et d'apprentissage machine. C'est un pan de la recherche sur l'intelligence artificielle. Le but est d'enseigner aux machines à voir comme nous : nommer des objets, identifier des gens, déduire des formes géométriques 3D, comprendre les relations, les émotions, les actions et les intentions. Nous tissons constamment des histoires de gens, d'endroits, de choses dès que nous posons les yeux dessus.

The first step towards this goal is to teach a computer to see objects, the building block of the visual world. In its simplest terms, imagine this teaching process as showing the computers some training images of a particular object, let's say cats, and designing a model that learns from these training images. How hard can this be? After all, a cat is just a collection of shapes and colors, and this is what we did in the early days of object modeling. We'd tell the computer algorithm in a mathematical language that a cat has a round face, a chubby body, two pointy ears, and a long tail, and that looked all fine. But what about this cat? (Laughter) It's all curled up. Now you have to add another shape and viewpoint to the object model. But what if cats are hidden? What about these silly cats? Now you get my point. Even something as simple as a household pet can present an infinite number of variations to the object model, and that's just one object.

Le premier pas est d'apprendre à l'ordinateur à voir des objets, c'est l'élément de base du monde visuel. Pour parler simplement, imaginez que ce processus d'apprentissage consiste à montrer à l'ordinateur des images d'un certain objet, par exemple des chats, puis concevoir un modèle qui puisse apprendre avec ces images. Ça ne doit pas être bien difficile ! Après tout, un chat est un ensemble de formes et de couleurs. Au début de la modélisation objet, c'est ce que nous avons fait. On rentrait un algorithme en langage mathématique pour dire que le chat a un visage rond, un corps un peu dodu, deux oreilles pointues et une longue queue et tout allait bien. Mais que fait-on pour celui-ci ? (Rires) Il est tout retourné. Alors il faut ajouter d'autres formes et points de vue au modèle objet. Et si le chat est caché ? Et ces drôles de chats-là ? Vous voyez ce que je veux dire. Quelque chose d'aussi simple qu'un animal domestique présente une infinité de variations du modèle objet. Et ça n'est qu'un seul objet.

So about eight years ago, a very simple and profound observation changed my thinking. No one tells a child how to see, especially in the early years. They learn this through real-world experiences and examples. If you consider a child's eyes as a pair of biological cameras, they take one picture about every 200 milliseconds, the average time an eye movement is made. So by age three, a child would have seen hundreds of millions of pictures of the real world. That's a lot of training examples. So instead of focusing solely on better and better algorithms, my insight was to give the algorithms the kind of training data that a child was given through experiences in both quantity and quality.

Il y a environ 8 ans, une réflexion toute simple mais profonde a changé ma manière de penser. Personne ne dit à un enfant comment voir, surtout dans les premières années. Il apprend par l'expérience, par des exemples quotidiens. Pensez aux yeux d'un enfant comme à deux appareils photo biologiques qui prennent une photo chaque 200 millisecondes, la durée moyenne du mouvement de l’œil. A 3 ans, un enfant a vu des centaines de millions de photos du monde réel. Ça nous fait beaucoup d'exemples. Alors plutôt que se concentrer sur l'amélioration des algorithmes, mon idée a été de former les algorithmes avec le genre de données qu'un enfant reçoit par l'expérience tant en quantité qu'en qualité

Once we know this, we knew we needed to collect a data set that has far more images than we have ever had before, perhaps thousands of times more, and together with Professor Kai Li at Princeton University, we launched the ImageNet project in 2007. Luckily, we didn't have to mount a camera on our head and wait for many years. We went to the Internet, the biggest treasure trove of pictures that humans have ever created. We downloaded nearly a billion images and used crowdsourcing technology like the Amazon Mechanical Turk platform to help us to label these images. At its peak, ImageNet was one of the biggest employers of the Amazon Mechanical Turk workers: together, almost 50,000 workers from 167 countries around the world helped us to clean, sort and label nearly a billion candidate images. That was how much effort it took to capture even a fraction of the imagery a child's mind takes in in the early developmental years.

Une fois que nous avons compris ça, nous savions qu'il fallait collecter un ensemble de données qui contienne bien plus d'images que jamais auparavant, peut-être des milliers de fois plus. Avec le professeur Kai Li de l'Université de Princeton, nous avons donc lancé le projet ImageNet en 2007. Heureusement, ce n'était pas la peine de se mettre une caméra sur la tête et d'attendre plusieurs années. Nous sommes allés sur Internet, la plus grande mine de photos que l'humain ait jamais créée. Nous avons téléchargé près d'un milliard d'images. Des technologies de crowdsourcing comme le Turc Mécanique d'Amazon nous ont aidés à cataloguer les images. A son plus haut, ImageNet a été l'un des plus gros employeurs du Turc Mécanique d'Amazon : près de 50 000 employés dans 167 pays nous ont aidés à nettoyer, trier, étiqueter presque un milliard d'images. C'est vous dire l'effort entrepris pour capturer une fraction des images qu'un enfant stocke pendant ses premières années.

In hindsight, this idea of using big data to train computer algorithms may seem obvious now, but back in 2007, it was not so obvious. We were fairly alone on this journey for quite a while. Some very friendly colleagues advised me to do something more useful for my tenure, and we were constantly struggling for research funding. Once, I even joked to my graduate students that I would just reopen my dry cleaner's shop to fund ImageNet. After all, that's how I funded my college years.

Aujourd'hui, cette idée d'utiliser ces masses de données pour construire des algorithmes peut paraître évidente, mais pas en 2007. Pendant longtemps, nous étions bien seuls. Des collègues me conseillaient de trouver autre chose pour devenir titulaire, et c'était une bataille constante pour trouver des crédits de recherche. Je disais en plaisantant à mes étudiants que je pourrais reprendre ma laverie pour financer ImageNet. Après tout, j'avais financé mes études grâce à elle.

So we carried on. In 2009, the ImageNet project delivered a database of 15 million images across 22,000 classes of objects and things organized by everyday English words. In both quantity and quality, this was an unprecedented scale. As an example, in the case of cats, we have more than 62,000 cats of all kinds of looks and poses and across all species of domestic and wild cats. We were thrilled to have put together ImageNet, and we wanted the whole research world to benefit from it, so in the TED fashion, we opened up the entire data set to the worldwide research community for free. (Applause)

Mais nous avons continué. En 2009, le projet ImageNet avait une base de données de 15 millions d'images, 22 000 classes d'objets et de choses organisées avec des mots d'anglais du quotidien. Tant en quantité qu'en qualité, une telle échelle de grandeur était une première. Par exemple, les chats, nous avons plus de 62 000 chats, toutes sortes d'apparences et de poses, toutes les espèces, domestiques et sauvages. C'était formidable d'avoir bâti ImageNet, et nous voulions en faire profiter le monde de la recherche. Alors, à la manière de TED, nous avons donné l'accès aux données à la recherche, gratuitement et dans le monde entier. (Applaudissements)

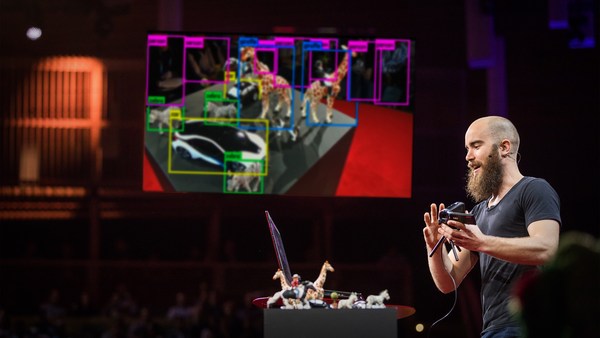

Now that we have the data to nourish our computer brain, we're ready to come back to the algorithms themselves. As it turned out, the wealth of information provided by ImageNet was a perfect match to a particular class of machine learning algorithms called convolutional neural network, pioneered by Kunihiko Fukushima, Geoff Hinton, and Yann LeCun back in the 1970s and '80s. Just like the brain consists of billions of highly connected neurons, a basic operating unit in a neural network is a neuron-like node. It takes input from other nodes and sends output to others. Moreover, these hundreds of thousands or even millions of nodes are organized in hierarchical layers, also similar to the brain. In a typical neural network we use to train our object recognition model, it has 24 million nodes, 140 million parameters, and 15 billion connections. That's an enormous model. Powered by the massive data from ImageNet and the modern CPUs and GPUs to train such a humongous model, the convolutional neural network blossomed in a way that no one expected. It became the winning architecture to generate exciting new results in object recognition. This is a computer telling us this picture contains a cat and where the cat is. Of course there are more things than cats, so here's a computer algorithm telling us the picture contains a boy and a teddy bear; a dog, a person, and a small kite in the background; or a picture of very busy things like a man, a skateboard, railings, a lampost, and so on. Sometimes, when the computer is not so confident about what it sees, we have taught it to be smart enough to give us a safe answer instead of committing too much, just like we would do, but other times our computer algorithm is remarkable at telling us what exactly the objects are, like the make, model, year of the cars.

Maintenant que nous avons les données pour nourrir notre cerveau informatique, nous pouvons revenir sur les algorithmes. Il se trouve que la manne d'informations désormais dans ImageNet allait parfaitement avec un certain type d'algorithmes, le réseau de neurones à convolution, développé par Kunihiko Fukushima, Geoff Hinton et Yann LeCun dans les années 1970 et 80. Tout comme le cerveau est composé de milliards de neurones connectés, l'unité de base d'un réseau neuronal est le nœud de type neurone. Il reçoit des informations d'autres nœuds et en envoie à d'autres. De plus, ces centaines de milliers voire millions de nœuds sont organisés en couches hiérarchiques, similaires au cerveau. Dans le réseau neuronal classique que nous utilisons, il y a 24 millions de nœuds, 140 millions de paramètres, et 15 milliards de connexions. C'est un modèle énorme. Avec la puissance des données d'ImageNet et les processeurs modernes pour traiter cet énorme modèle, le réseau de neurones à convolution s'est transformé de manière inattendue. Il est devenu l'architecture idéale pour générer des résultats fabuleux en reconnaissance d'objets. Ceci est un ordinateur qui nous dit que la photo contient un chat et où est ce chat. Bien sûr, il y a autre chose que des chats. Ici un algorithme nous dit que la photo contient un garçon et un ours en peluche, un chien, une personne, et un cerf-volant en arrière-plan. Ici, beaucoup d'activités avec un homme, un skateboard, une rampe, un lampadaire, etc. Parfois l'ordinateur n'est pas trop sûr, nous lui avons appris à être assez intelligent pour donner une réponse sûre, sans trop s'engager, c'est ce que nous ferions. D'autres fois, l'algorithme a la capacité incroyable de nous dire exactement ce qu'est l'objet : marque, modèle, année d'une voiture.

We applied this algorithm to millions of Google Street View images across hundreds of American cities, and we have learned something really interesting: first, it confirmed our common wisdom that car prices correlate very well with household incomes. But surprisingly, car prices also correlate well with crime rates in cities, or voting patterns by zip codes.

Nous avons utilisé cet algorithme sur des millions d'images Google Street View, dans des centaines de villes américaines, et nous avons découvert quelque chose de très intéressant. D'abord, il a été confirmé que le prix des voitures et le revenu des foyers sont liés. Mais, étonnamment, le prix des voitures et le taux de crimes dans les villes sont également liés, même chose avec la répartition géographique des votes.

So wait a minute. Is that it? Has the computer already matched or even surpassed human capabilities? Not so fast. So far, we have just taught the computer to see objects. This is like a small child learning to utter a few nouns. It's an incredible accomplishment, but it's only the first step. Soon, another developmental milestone will be hit, and children begin to communicate in sentences. So instead of saying this is a cat in the picture, you already heard the little girl telling us this is a cat lying on a bed.

Attendez un peu... c'est tout ? Est-ce que l'ordinateur atteint, voire surpasse, les capacités humaines ? Pas si vite. Jusque là, nous avons appris aux ordinateurs à voir des objets, comme un jeune enfant apprend à prononcer quelques noms. C'est déjà incroyable, mais ce n'est que la première étape. Bientôt, nous atteindrons un autre niveau, l'enfant commence à faire des phrases. Au lieu de dire que c'est un chat sur la photo, comme nous l'a dit la petite fille tout à l'heure.

So to teach a computer to see a picture and generate sentences, the marriage between big data and machine learning algorithm has to take another step. Now, the computer has to learn from both pictures as well as natural language sentences generated by humans. Just like the brain integrates vision and language, we developed a model that connects parts of visual things like visual snippets with words and phrases in sentences.

Pour apprendre à l'ordinateur à générer des phrases à partir d'une photo, le mariage entre les données et l'algorithme d'apprentissage doit franchir une autre étape. L'ordinateur doit apprendre à partir des photos, en utilisant des phrases en langage naturel générée par l'être humain. Tout comme le cerveau combine vision et langage, notre modèle connecte les parties de choses visuelles, des petits bouts visuels, avec des mots ou groupes de mots, pour en faire des phrases.

About four months ago, we finally tied all this together and produced one of the first computer vision models that is capable of generating a human-like sentence when it sees a picture for the first time. Now, I'm ready to show you what the computer says when it sees the picture that the little girl saw at the beginning of this talk.

Il y a environ 4 mois, nous avons enfin réussi à créer l'un des premiers modèles de vision artificielle capagle de générer une phrase comme un être humain qui découvre une image. Aujourd'hui, je suis prête à vous montrer ce que dit l'ordinateur quand il voit la photo que la petite fille voyait tout à l'heure.

(Video) Computer: A man is standing next to an elephant. A large airplane sitting on top of an airport runway.

(Vidéo) L'ordinateur : Un homme est debout à coté d'un éléphant. Un grand avion est assis sur une piste d'aéroport.

FFL: Of course, we're still working hard to improve our algorithms, and it still has a lot to learn. (Applause)

FFL : Bien sûr, il y a encore beaucoup de travail sur les algorithmes, l'ordinateur a encore beaucoup à apprendre, (Applaudissements)

And the computer still makes mistakes.

et il fait encore des erreurs.

(Video) Computer: A cat lying on a bed in a blanket.

(Vidéo) Ordinateur : un chat est couché sur un lit dans une couverture.

FFL: So of course, when it sees too many cats, it thinks everything might look like a cat.

FFL : Bien sûr, s'il voit trop de chats, il pense que tout est peut-être un chat.

(Video) Computer: A young boy is holding a baseball bat. (Laughter)

(Vidéo) Ordinateur : un garçon tient une batte de base-ball. (Rires)

FFL: Or, if it hasn't seen a toothbrush, it confuses it with a baseball bat.

FFL : Ou alors, s'il n'a jamais vu de brosse à dents, elle devient une batte.

(Video) Computer: A man riding a horse down a street next to a building. (Laughter)

(Vidéo) Ordinateur : Un homme se promène à cheval près d'un bâtiment. (Rires)

FFL: We haven't taught Art 101 to the computers.

Nous n'avons pas enseigné l'histoire de l'art à l'ordinateur.

(Video) Computer: A zebra standing in a field of grass.

(Vidéo) L'ordinateur : Un zèbre se trouve dans un pré.

FFL: And it hasn't learned to appreciate the stunning beauty of nature like you and I do.

FFL : Et il ne sait pas apprécier la beauté de la nature comme vous et moi.

So it has been a long journey. To get from age zero to three was hard. The real challenge is to go from three to 13 and far beyond. Let me remind you with this picture of the boy and the cake again. So far, we have taught the computer to see objects or even tell us a simple story when seeing a picture.

Ça a donc été un long voyage. Aller de 0 à 3 ans a été difficile. Le vrai défi est d'aller de 3 à 13 et bien au-delà. Revoici l'image du garçon avec le gâteau. Jusque là, nous avons appris à l'ordinateur à voir des objets ou à créer une petite histoire d'après une photo.

(Video) Computer: A person sitting at a table with a cake.

(Vidéo) L'ordinateur : Une personne assise à une table avec un gâteau.

FFL: But there's so much more to this picture than just a person and a cake. What the computer doesn't see is that this is a special Italian cake that's only served during Easter time. The boy is wearing his favorite t-shirt given to him as a gift by his father after a trip to Sydney, and you and I can all tell how happy he is and what's exactly on his mind at that moment.

FFL : Mais il y a beaucoup plus qu'une personne et un gâteau. Ce que l'ordinateur ne voit pas est que c'est un gâteau italien spécial servi uniquement à Pâques. Le garçon porte son t-shirt préféré, celui que lui a offert son père après un voyage à Sydney, et vous et moi voyons bien à quel point il est heureux et ce qu'il pense à ce moment.

This is my son Leo. On my quest for visual intelligence, I think of Leo constantly and the future world he will live in. When machines can see, doctors and nurses will have extra pairs of tireless eyes to help them to diagnose and take care of patients. Cars will run smarter and safer on the road. Robots, not just humans, will help us to brave the disaster zones to save the trapped and wounded. We will discover new species, better materials, and explore unseen frontiers with the help of the machines.

C'est mon fils Léo. Au cours de ma quête de l'intelligence visuelle, Léo était constamment dans mes pensées ainsi que le monde dans lequel il vivra. Quand les machines pourront voir, les médecins et infirmières auront une paire d'yeux infatigables en plus pour les aider au diagnostic et au soin des patients. Les voitures seront plus intelligentes et plus sûres. Des robots, pas seulement des humains, nous aideront à sauver des vies dans des zones sinistrées. Nous découvrirons de nouvelles espèces, de meilleurs matériaux, nous explorerons d'autres frontières, avec l'aide des machines.

Little by little, we're giving sight to the machines. First, we teach them to see. Then, they help us to see better. For the first time, human eyes won't be the only ones pondering and exploring our world. We will not only use the machines for their intelligence, we will also collaborate with them in ways that we cannot even imagine.

Petit à petit, nous donnons la vue aux machines. D'abord nous leur apprenons à voir. Puis c'est elles qui nous aident à mieux voir. Pour la première fois, les yeux humains ne seront pas les seuls à questionner et explorer notre monde. En plus d'utiliser les machines pour leur intelligence, nous collaborerons avec elles de manière inédite.

This is my quest: to give computers visual intelligence and to create a better future for Leo and for the world.

C'est ma quête : donner aux ordinateurs l'intelligence visuelle et créer un meilleur avenir pour Léo et pour le monde.

Thank you.

Merci.

(Applause)

(Applaudissements)