Let me show you something.

Les mostraré algo.

(Video) Girl: Okay, that's a cat sitting in a bed. The boy is petting the elephant. Those are people that are going on an airplane. That's a big airplane.

(Video) Niña: Eso es un gato sentado en una cama. El niño está acariciando al elefante. Esas son personas que van en un avión. Ese es un avión grande.

Fei-Fei Li: This is a three-year-old child describing what she sees in a series of photos. She might still have a lot to learn about this world, but she's already an expert at one very important task: to make sense of what she sees. Our society is more technologically advanced than ever. We send people to the moon, we make phones that talk to us or customize radio stations that can play only music we like. Yet, our most advanced machines and computers still struggle at this task. So I'm here today to give you a progress report on the latest advances in our research in computer vision, one of the most frontier and potentially revolutionary technologies in computer science.

Fei-Fei Li: Así describe una niña de 3 años lo que ve en una serie de fotos. Tal vez le falta mucho por aprender sobre este mundo, pero ya es experta en algo importante: entender lo que ve. Tecnológicamente, nuestra sociedad está más avanzada que nunca. Enviamos personas a la luna, nuestros teléfonos nos hablan o personalizan radios para reproducir solo la música que nos gusta. Sin embargo, nuestras máquinas y computadoras más avanzadas aún tienen problemas en ese aspecto. Hoy estoy aquí para darles un reporte de nuestros últimos avances en visión artificial, una de las tecnologías potencialmente más revolucionarias en la ciencia de la computación.

Yes, we have prototyped cars that can drive by themselves, but without smart vision, they cannot really tell the difference between a crumpled paper bag on the road, which can be run over, and a rock that size, which should be avoided. We have made fabulous megapixel cameras, but we have not delivered sight to the blind. Drones can fly over massive land, but don't have enough vision technology to help us to track the changes of the rainforests. Security cameras are everywhere, but they do not alert us when a child is drowning in a swimming pool. Photos and videos are becoming an integral part of global life. They're being generated at a pace that's far beyond what any human, or teams of humans, could hope to view, and you and I are contributing to that at this TED. Yet our most advanced software is still struggling at understanding and managing this enormous content. So in other words, collectively as a society, we're very much blind, because our smartest machines are still blind.

Es cierto, hemos inventado autos que conducen solos, pero sin una visión inteligente, realmente no pueden distinguir entre una bolsa arrugada de papel en el camino, que puede uno pisar, y una roca del mismo tamaño, que debemos evitar. Hemos creado fabulosas cámaras de muchos megapíxeles, pero aún no podemos devolverle la vista a un ciego. Los drones pueden volar sobre grandes superficies de tierra, pero no tienen tecnología de visión suficiente para ayudarnos a monitorear los cambios en los bosques tropicales. Hay cámaras de seguridad en todas partes, pero no nos alertan cuando un niño se está ahogando en una piscina. Las fotos y los videos se están volviendo parte integral de la vida global. Se generan a un ritmo mucho mayor de lo que cualquier humano, o equipo de humanos, podría ver, y Uds. y yo contribuimos a eso en este TED. Aun así, nuestro software más avanzado tiene problemas para entender y gestionar este enorme contenido. En otras palabras, colectivamente como una sociedad, somos muy ciegos, porque nuestras máquinas más inteligentes aún son ciegas.

"Why is this so hard?" you may ask. Cameras can take pictures like this one by converting lights into a two-dimensional array of numbers known as pixels, but these are just lifeless numbers. They do not carry meaning in themselves. Just like to hear is not the same as to listen, to take pictures is not the same as to see, and by seeing, we really mean understanding. In fact, it took Mother Nature 540 million years of hard work to do this task, and much of that effort went into developing the visual processing apparatus of our brains, not the eyes themselves. So vision begins with the eyes, but it truly takes place in the brain.

Se preguntarán: "¿Por qué es tan difícil?" Las cámaras pueden tomar fotos como esta convirtiendo luz en matrices numéricas bidimensionales conocidas como pixeles, pero estos son solo números vacíos. En sí mismos no tienen significado. Al igual que oír no es lo mismo que escuchar, tomar fotografías no es lo mismo que ver; y solo viendo podemos realmente entender. De hecho, le tomó a la Madre Naturaleza 540 millones de años de arduo trabajo lograr esta tarea, y mucho de ese esfuerzo consistió en desarrollar el sistema de procesamiento visual en el cerebro, no los ojos en sí. La visión empieza en los ojos, pero, en realidad, ocurre en nuestro cerebro.

So for 15 years now, starting from my Ph.D. at Caltech and then leading Stanford's Vision Lab, I've been working with my mentors, collaborators and students to teach computers to see. Our research field is called computer vision and machine learning. It's part of the general field of artificial intelligence. So ultimately, we want to teach the machines to see just like we do: naming objects, identifying people, inferring 3D geometry of things, understanding relations, emotions, actions and intentions. You and I weave together entire stories of people, places and things the moment we lay our gaze on them.

Durante 15 años, empezando desde mi doctorado en Caltech y luego al frente del laboratorio Stanford Vision Lab, he trabajado con mis mentores, colaboradores y estudiantes para enseñar a las computadoras a ver. Nuestro campo de investigación se llama "visión artificial y aprendizaje automático". Es parte del campo de la inteligencia artificial. Queremos enseñar a las máquinas a ver tal como nosotros lo hacemos: nombrar objetos, identificar personas, inferir la geometría 3D de las cosas, entender relaciones, emociones, acciones e intenciones. Nosotros tejemos historias completas de la gente, los lugares y las cosas simplemente con mirarlas.

The first step towards this goal is to teach a computer to see objects, the building block of the visual world. In its simplest terms, imagine this teaching process as showing the computers some training images of a particular object, let's say cats, and designing a model that learns from these training images. How hard can this be? After all, a cat is just a collection of shapes and colors, and this is what we did in the early days of object modeling. We'd tell the computer algorithm in a mathematical language that a cat has a round face, a chubby body, two pointy ears, and a long tail, and that looked all fine. But what about this cat? (Laughter) It's all curled up. Now you have to add another shape and viewpoint to the object model. But what if cats are hidden? What about these silly cats? Now you get my point. Even something as simple as a household pet can present an infinite number of variations to the object model, and that's just one object.

El primer paso hacia esta meta es enseñar a una computadora a ver objetos, la unidad básica del mundo visual. En términos más simples, imaginen este proceso mostrando a las computadoras algunas imágenes de entrenamiento de un objeto en particular, digamos gatos, y diseñar un modelo que aprenda de estas imágenes. ¿Qué tan difícil puede ser esto? A fin de cuentas, un gato es solo un conjunto de formas y colores, y eso fue lo que hacíamos en los inicios de la modelización de objetos. Decíamos al algoritmo de la computadora en un lenguaje matemático que un gato tiene cara redonda, cuerpo regordete, dos orejas puntiagudas y cola larga, y así quedaba bien. Pero ¿qué me dicen de este gato? (Risas) Está todo retorcido. Se debe agregar otra figura y otra perspectiva al modelo del objeto. ¿Y si los gatos están escondidos? ¿Qué tal estos gatos tontos? Ahora entienden mi idea. Incluso algo tan simple como una mascota puede tener un número infinito de variaciones en el modelo del objeto, y eso es solo un objeto.

So about eight years ago, a very simple and profound observation changed my thinking. No one tells a child how to see, especially in the early years. They learn this through real-world experiences and examples. If you consider a child's eyes as a pair of biological cameras, they take one picture about every 200 milliseconds, the average time an eye movement is made. So by age three, a child would have seen hundreds of millions of pictures of the real world. That's a lot of training examples. So instead of focusing solely on better and better algorithms, my insight was to give the algorithms the kind of training data that a child was given through experiences in both quantity and quality.

Así que hace unos 8 años, una observación simple y profunda cambió mi perspectiva. Nadie le dice al niño cómo ver, menos aún en los primeros años. Ellos aprenden a través de ejemplos y experiencias del mundo real. Si consideramos los ojos de un niño como un par de cámaras biológicas, toman una foto cada 200 milisegundos, el tiempo promedio en que el ojo hace un movimiento. Entonces, a los 3 años un niño ha visto cientos de millones de fotografías del mundo real. Esos son muchos ejemplares de entrenamiento. Así que en lugar de enfocarnos solo en mejorar los algoritmos, mi intención fue dotar a los algoritmos con los datos de entrenamiento que un niño adquiere con la experiencia tanto en cantidad como en calidad.

Once we know this, we knew we needed to collect a data set that has far more images than we have ever had before, perhaps thousands of times more, and together with Professor Kai Li at Princeton University, we launched the ImageNet project in 2007. Luckily, we didn't have to mount a camera on our head and wait for many years. We went to the Internet, the biggest treasure trove of pictures that humans have ever created. We downloaded nearly a billion images and used crowdsourcing technology like the Amazon Mechanical Turk platform to help us to label these images. At its peak, ImageNet was one of the biggest employers of the Amazon Mechanical Turk workers: together, almost 50,000 workers from 167 countries around the world helped us to clean, sort and label nearly a billion candidate images. That was how much effort it took to capture even a fraction of the imagery a child's mind takes in in the early developmental years.

Al conocer esto supimos que necesitábamos recolectar muchas más imágenes que nunca, tal vez miles de veces más; y junto con el profesor Kai Li en la Universidad de Princeton, lanzamos el proyecto ImageNet en 2007. Por suerte, no tuvimos que ponernos una cámara en la cabeza y esperar muchos años. Entramos a Internet, el banco de imágenes más grande creado por la humanidad. Descargamos casi 1000 millones de imágenes y usamos tecnología de crowdsourcing como la plataforma Amazon Mechanical Turk para etiquetar estas imágenes. En su mejor momento, ImageNet fue uno de los empleadores más importantes de trabajadores en Amazon Mechanical Turk: Casi 50 000 trabajadores de 167 países del mundo nos ayudaron a limpiar, separar y etiquetar casi 1000 millones de imágenes candidatas. Se necesitó todo ese esfuerzo para capturar apenas una fracción de todas las imágenes que un niño asimila en sus primeros años de desarrollo.

In hindsight, this idea of using big data to train computer algorithms may seem obvious now, but back in 2007, it was not so obvious. We were fairly alone on this journey for quite a while. Some very friendly colleagues advised me to do something more useful for my tenure, and we were constantly struggling for research funding. Once, I even joked to my graduate students that I would just reopen my dry cleaner's shop to fund ImageNet. After all, that's how I funded my college years.

Viendo en retrospectiva, esta idea de usar muchos datos para entrenar algoritmos puede parecer obvia ahora. Sin embargo, en 2007 no era tan evidente. Estuvimos solos en este viaje por un buen rato. Algunos colegas me sugerían hacer algo más útil para mi cátedra, y con frecuencia teníamos problemas para conseguir financiamiento. Incluso llegué a decir a mis alumnos, como broma, que tendría que reabrir mi tintorería para financiar ImageNet. Después de todo, así fue como financié mis años de universidad.

So we carried on. In 2009, the ImageNet project delivered a database of 15 million images across 22,000 classes of objects and things organized by everyday English words. In both quantity and quality, this was an unprecedented scale. As an example, in the case of cats, we have more than 62,000 cats of all kinds of looks and poses and across all species of domestic and wild cats. We were thrilled to have put together ImageNet, and we wanted the whole research world to benefit from it, so in the TED fashion, we opened up the entire data set to the worldwide research community for free. (Applause)

Seguimos adelante. En 2009, el proyecto ImageNet juntó una base de datos con 15 millones de imágenes de 22 000 tipos de objetos organizados por palabra en inglés de uso cotidiano. En cantidad y calidad, tuvieron una escala sin precedentes. Por ejemplo, en el caso de los gatos, tenemos más de 62 000 gatos con todo tipo de apariencias y poses y todo tipo de gatos domésticos y salvajes. Estábamos entusiasmados por haber creado ImageNet y queríamos que todo el mundo de la investigación se beneficiara, así que, al estilo TED, abrimos toda la base de datos a la comunidad mundial de investigadores de forma gratuita. (Aplausos)

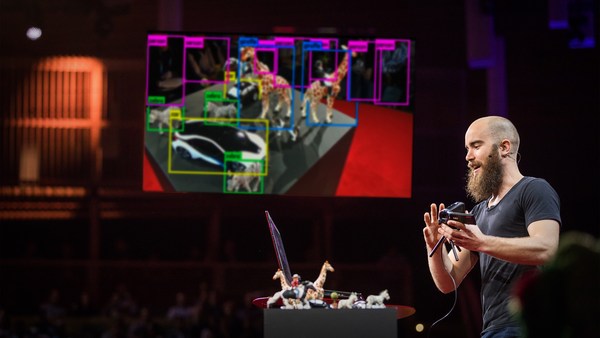

Now that we have the data to nourish our computer brain, we're ready to come back to the algorithms themselves. As it turned out, the wealth of information provided by ImageNet was a perfect match to a particular class of machine learning algorithms called convolutional neural network, pioneered by Kunihiko Fukushima, Geoff Hinton, and Yann LeCun back in the 1970s and '80s. Just like the brain consists of billions of highly connected neurons, a basic operating unit in a neural network is a neuron-like node. It takes input from other nodes and sends output to others. Moreover, these hundreds of thousands or even millions of nodes are organized in hierarchical layers, also similar to the brain. In a typical neural network we use to train our object recognition model, it has 24 million nodes, 140 million parameters, and 15 billion connections. That's an enormous model. Powered by the massive data from ImageNet and the modern CPUs and GPUs to train such a humongous model, the convolutional neural network blossomed in a way that no one expected. It became the winning architecture to generate exciting new results in object recognition. This is a computer telling us this picture contains a cat and where the cat is. Of course there are more things than cats, so here's a computer algorithm telling us the picture contains a boy and a teddy bear; a dog, a person, and a small kite in the background; or a picture of very busy things like a man, a skateboard, railings, a lampost, and so on. Sometimes, when the computer is not so confident about what it sees, we have taught it to be smart enough to give us a safe answer instead of committing too much, just like we would do, but other times our computer algorithm is remarkable at telling us what exactly the objects are, like the make, model, year of the cars.

Ahora que tenemos los datos para nutrir el cerebro de nuestra computadora, estamos listos para volver a los algoritmos. La abundancia de información aportada por ImageNet fue el complemento perfecto para un tipo particular de algoritmos de aprendizaje automático llamado red neuronal convolucional, ideado por Kunihiko Fukushima, Geoff Hinton y Yann LeCun en los años 70 y 80. Como el cerebro que tiene miles de millones de neuronas muy bien conectadas, la unidad operativa fundamental en una red neuronal es un nodo con forma de neurona. Toma datos de otros nodos los procesa y los manda a otros nodos. Además, estos cientos de miles o incluso millones de nodos se organizan en capas jerárquicas, algo parecido al cerebro. En una red neuronal típica que usamos para entrenar nuestro modelo de reconocimiento de objetos hay 24 millones de nodos, 140 millones de parámetros y 15 000 millones de conexiones. Es un modelo enorme. Alimentado por la información masiva de ImageNet y las CPUs y GPUs modernas que entrenan este inmenso modelo, la red neuronal convolucional tuvo un éxito inesperado. Se volvió la ingeniería ganadora para generar nuevos y emocionantes resultados en reconocimiento de objetos. Esta es una computadora que nos dice que la foto tiene un gato y dónde está el gato. Desde luego hay más cosas aparte de los gatos así que hay un algoritmo informático que nos dice que hay un niño y un oso de peluche en la foto; un perro, una persona y un papalote al fondo; o una foto de cosas muy ocupadas como un hombre, una patineta, un barandal, una lámpara etc. A veces, cuando la computadora no está segura de lo que ve, le hemos enseñado a darnos una respuesta segura en lugar de comprometer su respuesta, tal como lo haríamos nosotros. Pero otras veces nuestro algoritmo informático es muy acertado al decirnos qué son los objetos exactamente, como la marca, modelo y año de los coches.

We applied this algorithm to millions of Google Street View images across hundreds of American cities, and we have learned something really interesting: first, it confirmed our common wisdom that car prices correlate very well with household incomes. But surprisingly, car prices also correlate well with crime rates in cities, or voting patterns by zip codes.

Aplicamos este algoritmo a millones de imágenes de Google Street View de cientos de ciudades de Estados Unidos y hemos aprendido algo muy interesante: primero, confirmó nuestra idea de que los precios de los autos se relacionan bien con los ingresos del hogar. Pero sorprendentemente, los precios de los autos se relacionan también con las tasas de criminalidad en la ciudades o los patrones de votación por código postal.

So wait a minute. Is that it? Has the computer already matched or even surpassed human capabilities? Not so fast. So far, we have just taught the computer to see objects. This is like a small child learning to utter a few nouns. It's an incredible accomplishment, but it's only the first step. Soon, another developmental milestone will be hit, and children begin to communicate in sentences. So instead of saying this is a cat in the picture, you already heard the little girl telling us this is a cat lying on a bed.

Un minuto. ¿Eso es todo? ¿Acaso la computadora ya sobrepasó las capacidades humanas? No tan rápido. Hasta ahora solo hemos enseñado a la computadora a ver objetos. Es como un niño pequeño que aprende a decir palabras. Es un logro increíble, pero es apenas el primer paso. Pronto daremos otro paso y los niños empiezan a comunicarse con frases. Así que en lugar de decir que hay un gato en la foto, la niña ya dice que el gato está sobre la cama.

So to teach a computer to see a picture and generate sentences, the marriage between big data and machine learning algorithm has to take another step. Now, the computer has to learn from both pictures as well as natural language sentences generated by humans. Just like the brain integrates vision and language, we developed a model that connects parts of visual things like visual snippets with words and phrases in sentences.

Así que para enseñar a una computadora a ver una foto y generar frases la conjunción de mucha información y el algoritmo de aprendizaje automático debe dar otro paso. Ahora, la computadora tiene que aprender de fotografías así como de frases en lenguaje natural generado por humanos. De la forma en que el cerebro integra visión y lenguaje, desarrollamos un modelo que conecta partes de cosas visuales como fragmentos visuales con palabras y frases en oraciones.

About four months ago, we finally tied all this together and produced one of the first computer vision models that is capable of generating a human-like sentence when it sees a picture for the first time. Now, I'm ready to show you what the computer says when it sees the picture that the little girl saw at the beginning of this talk.

Hace unos 4 meses finalmente juntamos todo esto y produjimos uno de los primeros modelos de visión artificial que puede generar frases como las de un humano cuando ve una foto por primera vez. Ahora estoy lista para mostrarles lo que dice la computadora cuando ve la fotografía que la niña vio al inicio de esta charla.

(Video) Computer: A man is standing next to an elephant. A large airplane sitting on top of an airport runway.

(Video) Computadora: Un hombre está junto a un elefante. Un avión grande está encima de una pista de aeropuerto.

FFL: Of course, we're still working hard to improve our algorithms, and it still has a lot to learn. (Applause)

FFL: Desde luego, seguimos trabajando para mejorar los algoritmos y aún tiene mucho que aprender. (Aplausos)

And the computer still makes mistakes.

Y la computadora aún comete errores.

(Video) Computer: A cat lying on a bed in a blanket.

(Video) Computadora: Un gato recostado en la cama en una sábana.

FFL: So of course, when it sees too many cats, it thinks everything might look like a cat.

FFL: Y cuando ha visto demasiados gatos, cree que todo lo que ve parece un gato.

(Video) Computer: A young boy is holding a baseball bat. (Laughter)

(Video) Computadora: Un niño tiene un bate de béisbol. (Risas)

FFL: Or, if it hasn't seen a toothbrush, it confuses it with a baseball bat.

FFL: O si nunca ha visto un cepillo de dientes,

(Video) Computer: A man riding a horse down a street next to a building. (Laughter)

lo confunde con un bate de béisbol. (Video) Computadora: Un hombre montando un caballo junto a un edificio.

FFL: We haven't taught Art 101 to the computers.

(Risas)

FFL: No le hemos enseñado arte elemental a las computadoras.

(Video) Computer: A zebra standing in a field of grass.

(Video) Computadora: Una cebra en un campo de hierba.

FFL: And it hasn't learned to appreciate the stunning beauty of nature like you and I do.

FFL: Y no ha aprendido a apreciar la belleza deslumbrante de la naturaleza, como lo hacemos nosotros.

So it has been a long journey. To get from age zero to three was hard. The real challenge is to go from three to 13 and far beyond. Let me remind you with this picture of the boy and the cake again. So far, we have taught the computer to see objects or even tell us a simple story when seeing a picture.

Así que ha sido un largo camino. Pasar de los 0 a los 3 años fue difícil. El verdadero reto es llegar a los 13 y mucho más todavía. Recordemos nuevamente esta foto del niño y el pastel. Hasta ahora, le hemos enseñado a la computadora a ver objetos o incluso darnos una pequeña historia cuando ve la foto.

(Video) Computer: A person sitting at a table with a cake.

(Video) Computadora: Una persona sentada a la mesa con un pastel.

FFL: But there's so much more to this picture than just a person and a cake. What the computer doesn't see is that this is a special Italian cake that's only served during Easter time. The boy is wearing his favorite t-shirt given to him as a gift by his father after a trip to Sydney, and you and I can all tell how happy he is and what's exactly on his mind at that moment.

FFL: Pero hay mucho más en esta fotografía que simplemente una persona y un pastel. Lo que la computadora no ve es que este es un pastel especial italiano exclusivo de Pascua. El niño viste su camiseta favorita, que le regaló su papá tras un viaje a Sídney, y nosotros podemos decir qué tan feliz está y qué pasa por su mente en ese momento.

This is my son Leo. On my quest for visual intelligence, I think of Leo constantly and the future world he will live in. When machines can see, doctors and nurses will have extra pairs of tireless eyes to help them to diagnose and take care of patients. Cars will run smarter and safer on the road. Robots, not just humans, will help us to brave the disaster zones to save the trapped and wounded. We will discover new species, better materials, and explore unseen frontiers with the help of the machines.

Ese es mi hijo Leo. En mi búsqueda de inteligencia visual, pienso constantemente en él y en el futuro en que va a vivir. Cuando las máquinas puedan ver, los médicos y enfermeras tendrán un par extra de ojos incansables para ayudarlos a diagnosticar y cuidar de los pacientes. Los autos andarán de forma inteligente y segura en los caminos. Robots, y no solo humanos, nos ayudarán a desafiar zonas de desastre para salvar heridos y atrapados. Descubriremos nuevas especies, mejores materiales, y exploraremos fronteras nunca vistas con ayuda de las máquinas.

Little by little, we're giving sight to the machines. First, we teach them to see. Then, they help us to see better. For the first time, human eyes won't be the only ones pondering and exploring our world. We will not only use the machines for their intelligence, we will also collaborate with them in ways that we cannot even imagine.

Poco a poco, damos a las máquinas el don de la vista. Primero les enseñamos a ver. Luego ellas nos ayudarán a ver mejor. Por primera vez, los ojos humanos no serán los únicos que exploren nuestro mundo. No solo usaremos máquinas por su inteligencia, también colaboraremos con ellas de formas que ni siquiera imaginamos.

This is my quest: to give computers visual intelligence and to create a better future for Leo and for the world.

Esta es mi misión: dar a las computadoras inteligencia visual y crear un mejor futuro para Leo y para el mundo.

Thank you.

Gracias.

(Applause)

(Aplausos)