Θέλω να σας δείξω κάτι.

Let me show you something.

(Βίντεο) Κορίτσι: ΟΚ, μια γάτα που κάθεται στο κρεβάτι. Το αγόρι χαϊδεύει τον ελέφαντα. Οι άνθρωποι ανεβαίνουν στο αεροπλάνο. Είναι ένα μεγάλο αεροπλάνο.

(Video) Girl: Okay, that's a cat sitting in a bed. The boy is petting the elephant. Those are people that are going on an airplane. That's a big airplane.

Φέι Φέι Λι: Αυτό είναι ένα τρίχρονο κορίτσι που περιγράφει τι βλέπει σε μια σειρά από φωτογραφίες. Μπορεί να έχει να μάθει πολλά ακόμα για τον κόσμο, αλλά είναι ήδη ειδική σε μια πολύ σημαντική εργασία: να καταλαβαίνει τι βλέπει. Η κοινωνία μας τεχνολογικά είναι πιο προηγμένη από ποτέ. Στέλνουμε ανθρώπους στο φεγγάρι, έχουμε τηλέφωνα που μας μιλάνε ή ρυθμίζουμε ραδιοφωνικούς σταθμούς να παίζουν μόνο τη μουσική που μας αρέσει. Κι όμως, οι πιο προηγμένες μηχανές και υπολογιστές μας δυσκολεύονται ακόμα σε αυτή την εργασία. Έτσι λοιπόν, είμαι εδώ σήμερα για να σας δώσω μια αναφορά προόδου σχετικά με τις πρόσφατες εξελίξεις στον τομέα της μηχανικής όρασης, μια από τις πιο σημαντικές και πιθανότατα επαναστατικές τεχνολογίες της πληροφορικής.

Fei-Fei Li: This is a three-year-old child describing what she sees in a series of photos. She might still have a lot to learn about this world, but she's already an expert at one very important task: to make sense of what she sees. Our society is more technologically advanced than ever. We send people to the moon, we make phones that talk to us or customize radio stations that can play only music we like. Yet, our most advanced machines and computers still struggle at this task. So I'm here today to give you a progress report on the latest advances in our research in computer vision, one of the most frontier and potentially revolutionary technologies in computer science.

Ναι, έχουμε πρωτότυπα αυτοκίνητα που οδηγούν αυτόνομα, αλλά χωρίς «έξυπνη» όραση δεν μπορούν να καταλάβουν τη διαφορά μεταξύ μιας τσαλακωμένης σακούλας στο δρόμο, που μπορούν να «πατήσουν», και μιας πέτρας με το ίδιο μέγεθος, που πρέπει να αποφύγουν. Έχουμε εκπληκτικές κάμερες με ανάλυση μεγαπίξελ, αλλά δεν έχουμε δώσει όραση στους τυφλούς. Τηλεκατευθυνόμενα αεροσκάφη μπορούν να πετάξουν πάνω από τεράστια εδάφη αλλά δεν έχουν αρκετή τεχνολογία όρασης για να μας βοηθήσουν να παρακολουθήσουμε τις αλλαγές στα τροπικά δάση. Κάμερες ασφαλείας είναι παντού, αλλά δεν μας προειδοποιούν όταν ένα παιδί πνίγεται στην πισίνα. Φωτογραφίες και βίντεο γίνονται ολοένα πιο σημαντικό κομμάτι της παγκόσμιας ζωής. Δημιουργούνται με τέτοιο ρυθμό που είναι πέρα απ' ότι ένας άνθρωπος ή μια ομάδα ανθρώπων μπορούν να δουν, και εσείς και εγώ συνεισφέρουμε σε αυτό, εδώ στο TED. Κι όμως, το πιο προηγμένο λογισμικό μας δυσκολεύεται ακόμα να καταλάβει και να διαχειριστεί αυτές τις τεράστιες ποσότητες περιεχομένου. Με άλλα λόγια, συλλογικά σαν κοινωνία, είμαστε βασικά τυφλοί, γιατί οι πιο «έξυπνες» μηχανές μας είναι ακόμα τυφλές.

Yes, we have prototyped cars that can drive by themselves, but without smart vision, they cannot really tell the difference between a crumpled paper bag on the road, which can be run over, and a rock that size, which should be avoided. We have made fabulous megapixel cameras, but we have not delivered sight to the blind. Drones can fly over massive land, but don't have enough vision technology to help us to track the changes of the rainforests. Security cameras are everywhere, but they do not alert us when a child is drowning in a swimming pool. Photos and videos are becoming an integral part of global life. They're being generated at a pace that's far beyond what any human, or teams of humans, could hope to view, and you and I are contributing to that at this TED. Yet our most advanced software is still struggling at understanding and managing this enormous content. So in other words, collectively as a society, we're very much blind, because our smartest machines are still blind.

«Γιατί είναι τόσο δύσκολο;» μπορεί να ρωτήσετε. Οι κάμερες μπορούν να τραβήξουν φωτογραφίες όπως αυτή μετατρέποντας το φως σε δισδιάστατους πίνακες αριθμών που λέγονται πίξελ, αλλά αυτοί είναι άψυχοι αριθμοί. Δεν έχουν νόημα από μόνοι τους. Όπως το να αντιλαμβάνεσαι έναν ήχο δεν είναι σαν να τον καταλαβαίνεις, το να βγάζεις φωτογραφίες δεν είναι το ίδιο με το να βλέπεις, και λέγοντας «βλέπω» εννοούμε «καταλαβαίνω». Πράγματι, η Φύση χρειάστηκε 540 εκατομμύρια χρόνια σκληρής δουλειάς για να καταφέρει αυτό το έργο, και η περισσότερη προσπάθεια αφιερώθηκε στην ανάπτυξη του οπτικού μηχανισμού του εγκεφάλου μας και όχι στα ίδια τα μάτια. Η όραση λοιπόν ξεκινάει με τα μάτια, αλλά πραγματικά λαμβάνει χώρα στον εγκέφαλο.

"Why is this so hard?" you may ask. Cameras can take pictures like this one by converting lights into a two-dimensional array of numbers known as pixels, but these are just lifeless numbers. They do not carry meaning in themselves. Just like to hear is not the same as to listen, to take pictures is not the same as to see, and by seeing, we really mean understanding. In fact, it took Mother Nature 540 million years of hard work to do this task, and much of that effort went into developing the visual processing apparatus of our brains, not the eyes themselves. So vision begins with the eyes, but it truly takes place in the brain.

Εδώ και 15 χρόνια, από το διδακτορικό μου στο Πανεπιστήμιο της Καλιφόρνια και ύστερα ως επικεφαλής του κέντρου όρασης του Στάνφορντ, δουλεύω με τους μέντορες, συνεργάτες και φοιτητές μου προσπαθώντας να μάθω τους υπολογιστές να βλέπουν. Το ερευνητικό μας πεδίο λέγεται υπολογιστική όραση και μηχανική μάθηση. Είναι κομμάτι του γενικότερου πεδίου της τεχνητής νοημοσύνης. Τελικά, θέλουμε να διδάξουμε τις μηχανές να δουν ακριβώς όπως εμείς: να ονομάζουν αντικείμενα, να αναγνωρίζουν ανθρώπους και αντικείμενα στον χώρο, να καταλαβαίνουν σχέσεις, συναισθήματα, δράσεις και προθέσεις. Εσείς και εγώ συνυφαίνουμε ολόκληρες ιστορίες ανθρώπων, τόπων και πραγμάτων τη στιγμή που τα πρωτοβλέπουμε.

So for 15 years now, starting from my Ph.D. at Caltech and then leading Stanford's Vision Lab, I've been working with my mentors, collaborators and students to teach computers to see. Our research field is called computer vision and machine learning. It's part of the general field of artificial intelligence. So ultimately, we want to teach the machines to see just like we do: naming objects, identifying people, inferring 3D geometry of things, understanding relations, emotions, actions and intentions. You and I weave together entire stories of people, places and things the moment we lay our gaze on them.

Το πρώτο βήμα προς αυτό το στόχο είναι να μάθουμε τον υπολογιστή να δει πράγματα, τα δομικά στοιχεία του οπτικού μας κόσμου. Στην πιο απλή της εκδοχή, φανταστείτε την εκπαιδευτική διαδικασία ως εξής: δείχνουμε στον υπολογιστή μερικές εικόνες εκμάθησης ενός συγκεκριμένου αντικειμένου, ας πούμε γάτες, και σχεδιάζουμε ένα μοντέλο που μαθαίνει από αυτές τις εικόνες. Πόσο δύσκολο μπορεί να είναι; Στο κάτω κάτω, μια γάτα είναι απλά μια συλλογή από σχήματα και χρώματα, και αυτό ακριβώς κάναμε τα πρώτα χρόνια της μοντελοποίησης αντικειμένων. Λέγαμε στον αλγόριθμο του υπολογιστή, σε μαθηματική γλώσσα, ότι η γάτα έχει ένα στρογγυλό πρόσωπο, ένα παχουλό σώμα, δύο μυτερά αυτιά και μια μακριά ουρά, και αυτό έμοιαζε μια χαρά. Αλλά αυτή η γάτα; (Γέλια) Είναι κουλουριασμένη. Τώρα πρέπει να προσθέσουμε άλλο ένα σχήμα και άλλη μια άποψη στο μοντέλο μας. Κι αν η γάτα κρύβεται; Και αυτές οι χαζούλες γάτες; Βλέπετε το πρόβλημα. Ακόμα και κάτι τόσο απλό όσο ένα κατοικίδιο μπορεί να παρουσιάσει έναν άπειρο αριθμό παραλλαγών στο μοντέλο, και αυτό είναι μόνο ένα αντικείμενο.

The first step towards this goal is to teach a computer to see objects, the building block of the visual world. In its simplest terms, imagine this teaching process as showing the computers some training images of a particular object, let's say cats, and designing a model that learns from these training images. How hard can this be? After all, a cat is just a collection of shapes and colors, and this is what we did in the early days of object modeling. We'd tell the computer algorithm in a mathematical language that a cat has a round face, a chubby body, two pointy ears, and a long tail, and that looked all fine. But what about this cat? (Laughter) It's all curled up. Now you have to add another shape and viewpoint to the object model. But what if cats are hidden? What about these silly cats? Now you get my point. Even something as simple as a household pet can present an infinite number of variations to the object model, and that's just one object.

Πριν από οκτώ χρόνια, μια πολύ απλή και βαθιά παρατήρηση άλλαξε τον τρόπο σκέψης μου. Κανένας δεν λέει σε ένα παιδί πώς να δει, κυριώς τα πρώτα χρόνια. Μαθαίνουν μέσα από εμπειρίες και παραδείγματα του πραγματικού κόσμου. Αν σκεφτούμε τα μάτια του παιδιού σαν ένα ζευγάρι από βιολογικές κάμερες, βγάζουν περίπου μία φωτογραφία κάθε 200 χιλιοστά του δευτερολέπτου, που είναι ο μέσος χρόνος που χρειάζεται για μια κίνηση του ματιού. Έτσι, ένα παιδί τριών ετών θα έχει δει εκατοντάδες εκατομμύρια φωτογραφίες του πραγματικού κόσμου. Αυτά είναι πολλά παραδείγματα εκμάθησης. Αντί λοιπόν να εστιάζουμε μόνο σε ολοένα και καλύτερους αλγόριθμους, η ιδέα μου ήταν να δώσω στους αλγόριθμους το είδος των εκπαιδευτικών δεδομένων που ένα παιδί αποκτά μέσω εμπειρίας τόσο σε ποσότητα όσο και σε ποιότητα.

So about eight years ago, a very simple and profound observation changed my thinking. No one tells a child how to see, especially in the early years. They learn this through real-world experiences and examples. If you consider a child's eyes as a pair of biological cameras, they take one picture about every 200 milliseconds, the average time an eye movement is made. So by age three, a child would have seen hundreds of millions of pictures of the real world. That's a lot of training examples. So instead of focusing solely on better and better algorithms, my insight was to give the algorithms the kind of training data that a child was given through experiences in both quantity and quality.

Όταν το καταλάβαμε ξέραμε ότι έπρεπε να συλλέξουμε ένα σετ δεδομένων που περιείχε πολύ περισσότερες φωτογραφίες από όσες είχαμε προηγουμένως, ίσως χιλιάδες φορές περισσότερες, και μαζί με τον καθηγητή Κάι Λι στο Πανεπιστήμιο του Πρίνστον ξεκινήσαμε το πρόγραμμα ImageNet το 2007. Ευτυχώς, δε χρειάστηκε να φορέσουμε κάμερες στο κεφάλι μας και να περιμένουμε πολλά χρόνια. Πήγαμε στο Διαδίκτυο, το μεγαλύτερο θησαυροφυλάκιο εικόνων που έχουν ποτέ κατασκευάσει οι άνθρωποι. «Κατεβάσαμε» σχεδόν ένα δισεκατομμύριο εικόνες και χρησιμοποιήσαμε τεχνολογίες «υπηρεσιών πλήθους» όπως η πλατφόρμα της Άμαζον για να μας βοηθήσουν να ονομάσουμε αυτές τις εικόνες. Στην αιχμή του, το ImageNet ήταν ένας από τους μεγαλύτερους εργοδότες της πλατφόρμας της Άμαζον: όλοι μαζί, σχεδόν 50.000 εργαζόμενοι από 167 χώρες από όλο τον κόσμο μας βοήθησαν να καθαρίσουμε, να κατατάξουμε και να ονομάσουμε σχεδόν ένα δισεκατομμύριο υποψήφιες φωτογραφίες. Τόση προσπάθεια χρειάστηκε για να καταγράψουμε ένα ψήγμα των παραστάσεων που προσλαμβάνει το μυαλό ενός παιδιού στα πρώτα χρόνια της ανάπτυξης.

Once we know this, we knew we needed to collect a data set that has far more images than we have ever had before, perhaps thousands of times more, and together with Professor Kai Li at Princeton University, we launched the ImageNet project in 2007. Luckily, we didn't have to mount a camera on our head and wait for many years. We went to the Internet, the biggest treasure trove of pictures that humans have ever created. We downloaded nearly a billion images and used crowdsourcing technology like the Amazon Mechanical Turk platform to help us to label these images. At its peak, ImageNet was one of the biggest employers of the Amazon Mechanical Turk workers: together, almost 50,000 workers from 167 countries around the world helped us to clean, sort and label nearly a billion candidate images. That was how much effort it took to capture even a fraction of the imagery a child's mind takes in in the early developmental years.

Εκ των υστέρων, η ιδέα της χρήσης μαζικών δεδομένων για την εκπαίδευση υπολογιστών μπορεί να μοιάζει προφανής, αλλά το 2007 δεν ήταν τόσο προφανής. Ήμασταν μόνοι μας σε αυτό το ταξίδι για αρκετό καιρό. Μερικοί συνάδελφοι με συμβούλευσαν να κάνω κάτι πιο χρήσιμο για να πάρω μονιμότητα, και είχαμε διαρκώς προβλήματα χρηματοδότησης. Μια φορά, είπα για πλάκα στους μεταπτυχιακούς φοιτητές μου ότι θα άνοιγα ξανά το καθαριστήριό μου για να χρηματοδοτήσω το ImageNet. Στο κάτω κάτω, έτσι χρηματοδότησα τις σπουδές μου.

In hindsight, this idea of using big data to train computer algorithms may seem obvious now, but back in 2007, it was not so obvious. We were fairly alone on this journey for quite a while. Some very friendly colleagues advised me to do something more useful for my tenure, and we were constantly struggling for research funding. Once, I even joked to my graduate students that I would just reopen my dry cleaner's shop to fund ImageNet. After all, that's how I funded my college years.

Έτσι λοιπόν συνεχίσαμε. Το 2009, το ΙmageNet παρέδωσε μια βάση δεδομένων με 15 εκατομμύρια φωτογραφίες που ανήκαν σε 22.000 κατηγορίες αντικειμένων και πραγμάτων οργανωμένες με καθημερινές αγγλικές λέξεις. Τόσο σε ποσότητα όσο και σε ποιότητα, ήταν μια ανεπανάληπτη κλίμακα. Για παράδειγμα, όσον αφορά τις γάτες, έχουμε περισσότερες από 62.000 γάτες με διαφορετικές εμφανίσεις και πόζες και όλα τα είδη, κατοικίδιες και άγριες. Ήμασταν πανευτυχείς που ολοκληρώσαμε το ImageNet, και θέλαμε να επωφεληθεί όλος ο ερευνητικός κόσμος, κι έτσι, σύμφωνα με το πνεύμα του TED, διαθέσαμε ολόκληρη τη βάση δεδομένων στην παγκόσμια ερευνητική κοινότητα, δωρεάν. (Χειροκρότημα)

So we carried on. In 2009, the ImageNet project delivered a database of 15 million images across 22,000 classes of objects and things organized by everyday English words. In both quantity and quality, this was an unprecedented scale. As an example, in the case of cats, we have more than 62,000 cats of all kinds of looks and poses and across all species of domestic and wild cats. We were thrilled to have put together ImageNet, and we wanted the whole research world to benefit from it, so in the TED fashion, we opened up the entire data set to the worldwide research community for free. (Applause)

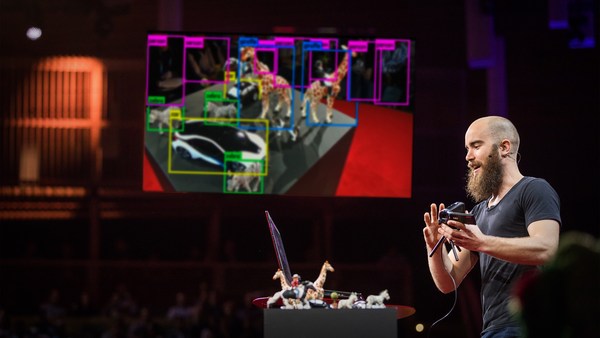

Τώρα που έχουμε τα δεδομένα για να καλλιεργήσουμε το υπολογιστικό μας μυαλό, είμαστε έτοιμοι να ξαναγυρίσουμε στους αλγόριθμους. Όπως αποδείχθηκε, ο πλούτος πληροφορίας που παρέχεται από το ImageNet ήταν το τέλειο ταίρι για μια συγκεκριμένη κλάση αλγόριθμων μηχανικής μάθησης που ονομάζονται συνελικτικά νευρωνικά δίκτυα, που αναπτύχθηκε απ' τους Τζεφ Χίντον, Κουνιχίκο Φουκοσίμα και Γιάν ΛεΚούν στις δεκαετίες του '70 και το '80. Όπως ο εγκέφαλος αποτελείται από δισεκατομμύρια διασυνδεδεμένους νευρώνες, η βασική λειτουργική ενότητα σε ένα νευρωνικό δίκτυο είναι ένας κόμβος-νευρώνας. Δέχεται σήματα εισόδου από άλλους κόμβους και στέλνει σήματα εξόδου σε άλλους. Επιπλέον, αυτοί οι εκατοντάδες χιλιάδες ή εκατομμύρια κόμβοι είναι οργανωμένοι σε ιεραρχικά στρώμματα, επίσης παρόμοια με αυτά του εγκεφάλου. Ένα τυπικό νευρωνικό δίκτυο που χρησιμοποιούμε για να εκπαιδεύσουμε το μοντέλο αναγνώρισης αντικειμένων, έχει 24 εκατομμύρια κόμβους, 140 εκατομμύρια παραμέτρους και 15 δισεκατομμύρια συνδέσεις. Είναι ένα τεράστιο μοντέλο. Ωθούμενο από τα μαζικά δεδομένα του ImageNet και από σύγχρονους μικροεπεξεργαστές για την εκμάθηση αυτού του μοντέλου, το συνελικτικό νευρωνικό δίκτυο «άνθισε» με τρόπο που κανείς δεν περίμενε. Έγινε η νικήτρια αρχιτεκτονική που γέννησε συναρπαστικά αποτελέσματα στην αναγνώριση αντικειμένων. Αυτός είναι ένας υπολογιστής που μας λέει ότι αυτή η εικόνα περιέχει μια γάτα και πού βρίσκεται αυτή η γάτα. Υπάρχουν κι άλλα πράγματα εκτός από γάτες, εδώ ο αλγόριθμος μας λέει ότι η εικόνα περιέχει ένα αγόρι και ένα αρκουδάκι, έναν σκύλο, έναν άνθρωπο και έναν μικρό χαρταετό στο βάθος, ή μια εικόνα με πολλά πράγματα όπως ένας άντρας, ένα σκέιτμπορντ, κάγκελα, μια κολώνα και λοιπά. Μερικές φορές, όταν ο υπολογιστής δεν είναι και τόσο σίγουρος για το τι βλέπει, του μάθαμε να είναι αρκετά έξυπνος ώστε να μας δίνει μια ασφαλή απάντηση αντί να δεσμευτεί σε κάτι συγκεκριμένο, όπως ακριβώς θα κάναμε και εμείς, και άλλες φορές ο αλγόριθμος είναι τόσο ικανός στο να μας λέει ακριβώς τι είναι το κάθε αντικείμενο, όπως τη μάρκα, το μοντέλο και τη χρονιά των αυτοκινήτων.

Now that we have the data to nourish our computer brain, we're ready to come back to the algorithms themselves. As it turned out, the wealth of information provided by ImageNet was a perfect match to a particular class of machine learning algorithms called convolutional neural network, pioneered by Kunihiko Fukushima, Geoff Hinton, and Yann LeCun back in the 1970s and '80s. Just like the brain consists of billions of highly connected neurons, a basic operating unit in a neural network is a neuron-like node. It takes input from other nodes and sends output to others. Moreover, these hundreds of thousands or even millions of nodes are organized in hierarchical layers, also similar to the brain. In a typical neural network we use to train our object recognition model, it has 24 million nodes, 140 million parameters, and 15 billion connections. That's an enormous model. Powered by the massive data from ImageNet and the modern CPUs and GPUs to train such a humongous model, the convolutional neural network blossomed in a way that no one expected. It became the winning architecture to generate exciting new results in object recognition. This is a computer telling us this picture contains a cat and where the cat is. Of course there are more things than cats, so here's a computer algorithm telling us the picture contains a boy and a teddy bear; a dog, a person, and a small kite in the background; or a picture of very busy things like a man, a skateboard, railings, a lampost, and so on. Sometimes, when the computer is not so confident about what it sees, we have taught it to be smart enough to give us a safe answer instead of committing too much, just like we would do, but other times our computer algorithm is remarkable at telling us what exactly the objects are, like the make, model, year of the cars.

Εφαρμόσαμε αυτόν τον αλγόριθμο σε εκατομμύρια εικόνες του Google Street View σε εκατοντάδες πόλεις της Αμερικής, και μάθαμε κάτι πολύ ενδιαφέρον: πρώτον, επιβεβαιώσαμε κάτι που ήταν κοινώς γνωστό ότι οι τιμές αυτοκινήτων συσχετίζονται πολύ καλά με το εισόδημα των νοικοκυριών. Αλλά αναπάντεχα, οι τιμές των αυτοκινήτων επίσης συσχετίζονται καλά με την εγκληματικότητα στις πόλεις, ή με την κατανομή ψήφων ανά ταχυδρομικό κώδικα.

We applied this algorithm to millions of Google Street View images across hundreds of American cities, and we have learned something really interesting: first, it confirmed our common wisdom that car prices correlate very well with household incomes. But surprisingly, car prices also correlate well with crime rates in cities, or voting patterns by zip codes.

Μισό λεπτό. Αυτό είναι; Ο υπολογιστής έφτασε ή ξεπέρασε τις ανθρώπινες δυνατότητες; Όχι τόσο γρήγορα. Μέχρι τώρα, έχουμε μάθει στον υπολογιστή μόνο να βλέπει αντικείμενα. Είναι σαν ένα μικρό παιδί που μαθαίνει να προφέρει μερικά ουσιαστικά. Είναι ένα απίστευτο επίτευγμα, αλλά είναι μόνο το πρώτο βήμα. Σύντομα, θα έρθουμε σε ένα άλλο ορόσημο της ανάπτυξης, και τα παιδιά αρχίζουν να επικοινωνούν με προτάσεις. Αντί να πει ότι στην εικόνα είναι μια γάτα ακούσατε ήδη το κοριτσάκι να μας λέει ότι η γάτα είναι ξαπλωμένη στο κρεβάτι.

So wait a minute. Is that it? Has the computer already matched or even surpassed human capabilities? Not so fast. So far, we have just taught the computer to see objects. This is like a small child learning to utter a few nouns. It's an incredible accomplishment, but it's only the first step. Soon, another developmental milestone will be hit, and children begin to communicate in sentences. So instead of saying this is a cat in the picture, you already heard the little girl telling us this is a cat lying on a bed.

Για να μάθουμε τον υπολογιστή να βλέπει μια εικόνα και να παράγει προτάσεις, ο «γάμος» των μαζικών δεδομένων και των αλγόριθμων μηχανικής μάθησης πρέπει να κάνει ένα ακόμα βήμα. Τώρα, ο υπολογιστής πρέπει να μάθει από εικόνες αλλά και από προτάσεις φυσικού λόγου που έχουν παράγει άνθρωποι. Ακριβώς όπως ο εγκέφαλος ενσωματώνει όραση και γλώσσα, αναπτύξαμε ένα μοντέλο που συνδέει μέρη οπτικών αντικειμένων, σαν οπτικά αποσπάσματα, με λέξεις και φράσεις προτάσεων.

So to teach a computer to see a picture and generate sentences, the marriage between big data and machine learning algorithm has to take another step. Now, the computer has to learn from both pictures as well as natural language sentences generated by humans. Just like the brain integrates vision and language, we developed a model that connects parts of visual things like visual snippets with words and phrases in sentences.

Πριν από περίπου τέσσερις μήνες, συνθέσαμε όλα αυτά τα κομμάτια και δημιουργήσαμε ένα από τα πρώτα μοντέλα υπολογιστικής όρασης ικανό να παράγει φυσικές προτάσεις την πρώτη φορά που βλέπει μια εικόνα. Τώρα, είμαι έτοιμη να σας δείξω τι λέει ο υπολογιστής όταν βλέπει την εικόνα που είδε το κορίτσι στην αρχή της ομιλίας.

About four months ago, we finally tied all this together and produced one of the first computer vision models that is capable of generating a human-like sentence when it sees a picture for the first time. Now, I'm ready to show you what the computer says when it sees the picture that the little girl saw at the beginning of this talk.

(Βίντεο) Υπολογιστής: Ένας άντρας στέκεται δίπλα σε έναν ελέφαντα. Ένα μεγάλο αεροπλάνο βρίσκεται πάνω σε έναν αεροδιάδρομο.

(Video) Computer: A man is standing next to an elephant. A large airplane sitting on top of an airport runway.

Φέι-Φέι Λι: Φυσικά, δουλεύουμε σκληρά για να βελτιώσουμε τον αλγόριθμό μας, και έχει να μάθει ακόμα πολλά. (Χειροκρότημα)

FFL: Of course, we're still working hard to improve our algorithms, and it still has a lot to learn. (Applause)

Και ο υπολογιστής ακόμα κάνει λάθη.

And the computer still makes mistakes.

(Βίντεο) Υπολογιστής: Μια γάτα είναι ξαπλωμένη στο κρεβάτι με μια κουβέρτα.

(Video) Computer: A cat lying on a bed in a blanket.

Φέι-Φέι Λι: Φυσικά, αφού έχει δει τόσες πολλές γάτες, νομίζει ότι τα πάντα μοιάζουν με γάτες.

FFL: So of course, when it sees too many cats, it thinks everything might look like a cat.

(Βίντεο) Υπολογιστής: Ένα αγόρι κρατάει ένα ρόπαλο του μπέιζμπολ. (Γέλια)

(Video) Computer: A young boy is holding a baseball bat. (Laughter)

ΦΦΛ: Ή αν δεν έχει δει οδοντόβουρτσες τις μπερδεύει με ρόπαλα του μπέιζμπολ.

FFL: Or, if it hasn't seen a toothbrush, it confuses it with a baseball bat.

(Βίντεο) Υπολογιστής: Ένας άντρας ιππεύει ένα άλογο στο δρόμο δίπλα σε ένα κτίριο. (Γέλια)

(Video) Computer: A man riding a horse down a street next to a building. (Laughter)

Φέι-Φέι Λι: Δεν έχουμε μάθει στους υπολογιστές τα βασικά για τις τέχνες.

FFL: We haven't taught Art 101 to the computers.

(Βίντεο) Υπολογιστής: Μια ζέβρα στέκεται σε ένα λιβάδι.

(Video) Computer: A zebra standing in a field of grass.

Φέι-Φέι Λι: Δεν έχει μάθει να εκτιμά την εκπληκτική ομορφιά της φύσης όπως εσείς και εγώ.

FFL: And it hasn't learned to appreciate the stunning beauty of nature like you and I do.

Ήταν ένα μεγάλο ταξίδι. Το να πάμε από τις ηλικίες 0 μέχρι 3 ήταν δύσκολο. Η πραγματική πρόκληση είναι να πάμε από τα 3 στα 13 και παραπέρα. Θέλω να σας υπενθυμήσω με αυτή την εικόνα του παιδιού και της τούρτας. Μέχρι τώρα, έχουμε διδάξει τον υπολογιστή να βλέπει αντικείμενα και ακόμα να μπορεί να μας πει μια ιστορία όταν βλέπει μια εικόνα.

So it has been a long journey. To get from age zero to three was hard. The real challenge is to go from three to 13 and far beyond. Let me remind you with this picture of the boy and the cake again. So far, we have taught the computer to see objects or even tell us a simple story when seeing a picture.

(Βίντεο) Υπολογιστής: Κάποιος κάθεται σε ένα τραπέζι με ένα κέικ.

(Video) Computer: A person sitting at a table with a cake.

ΦΦΛ: Άλλα υπάρχουν κι άλλα πράγματα σε αυτή την εικόνα εκτός από τον άνθρωπο και το κέικ. Αυτό που δεν βλέπει ο υπολογιστής είναι ότι αυτό είναι ένα ειδικό ιταλικό κέικ που σερβίρεται μόνο κατά την περίοδο του Πάσχα. Το αγόρι φοράει την αγαπημένη του μπλούζα που του την έφερε ο πατέρας του από ένα ταξίδι στο Σίδνεϊ, και εμείς μπορούμε να δούμε πόσο χαρούμενο είναι και τι ακριβώς σκέφτεται αυτή τη στιγμή.

FFL: But there's so much more to this picture than just a person and a cake. What the computer doesn't see is that this is a special Italian cake that's only served during Easter time. The boy is wearing his favorite t-shirt given to him as a gift by his father after a trip to Sydney, and you and I can all tell how happy he is and what's exactly on his mind at that moment.

Αυτός είναι ο γιος μου, ο Λέο. Στην αναζήτησή μου για οπτική νοημοσύνη σκέφτομαι τον Λέο συνέχεια και τον μελλοντικό κόσμο στον οποίο θα ζήσει. Όταν οι μηχανές θα μπορούν να δουν, οι γιατροί και νοσοκόμοι θα έχουν ένα ζευγάρι ακούραστα μάτια να τους βοηθάνε να διαγνώσουν και να φροντίσουν τους ασθενείς τους. Τα αυτοκίνητα θα οδηγούν πιο έξυπνα και πιο ασφαλή στο δρόμο. Ρομπότ, όχι μόνο άνθρωποι, θα μας βοηθάνε σε ζώνες καταστροφής να σώσουμε εγκλωβισμένους και τραυματίες. Θα ανακαλύψουμε καινούργια είδη, καλύτερα υλικά, και θα εξερευνήσουμε αόρατα σύνορα με τη βοήθεια των μηχανών.

This is my son Leo. On my quest for visual intelligence, I think of Leo constantly and the future world he will live in. When machines can see, doctors and nurses will have extra pairs of tireless eyes to help them to diagnose and take care of patients. Cars will run smarter and safer on the road. Robots, not just humans, will help us to brave the disaster zones to save the trapped and wounded. We will discover new species, better materials, and explore unseen frontiers with the help of the machines.

Σιγά-σιγά δίνουμε όραση στις μηχανές. Πρώτα, θα τους μάθουμε να βλέπουν. Μετά, θα μας βοηθήσουν να δούμε καλύτερα. Για πρώτη φορά, τα ανθρώπινα μάτια δεν θα είναι τα μόνα που μελετούν και εξερευνούν τον κόσμο. Δεν θα χρησιμοποιούμε τις μηχανές μόνο για τη νοημοσύνη τους, θα συνεργαζόμαστε με τρόπους που δεν μπορούμε να φανταστούμε.

Little by little, we're giving sight to the machines. First, we teach them to see. Then, they help us to see better. For the first time, human eyes won't be the only ones pondering and exploring our world. We will not only use the machines for their intelligence, we will also collaborate with them in ways that we cannot even imagine.

Αυτός είναι ο στόχος μου: να δώσω στους υπολογιστές οπτική νοημοσύνη και να φτιάξω ένα καλύτερο μέλλον για τον Λέο και για τον κόσμο.

This is my quest: to give computers visual intelligence and to create a better future for Leo and for the world.

Σας ευχαριστώ.

Thank you.

(Χειροκρότημα)

(Applause)