Ich möchte Ihnen etwas zeigen.

Let me show you something.

(Video) Mädchen: Okay. Das ist eine Katze, die auf einem Bett sitzt. Der Junge streichelt den Elefanten. Das sind Menschen, die ein Flugzeug besteigen. Das ist ein großes Flugzeug.

(Video) Girl: Okay, that's a cat sitting in a bed. The boy is petting the elephant. Those are people that are going on an airplane. That's a big airplane.

Fei-Fei Li: Das ist ein dreijähiges Kind, das beschreibt, was es auf einigen Fotos sieht. Sie muss wahrscheinlich noch viel über diese Welt lernen, aber sie ist bereits Expertin hinsichtlich einer sehr wichtigen Aufgabe: Sie versteht, was sie sieht. Unsere Gesellschaft ist technologisch fortgeschrittener als je zuvor. Wir schicken Menschen zum Mond, stellen Telefone her, die mit uns reden oder stellen Radiosender auf unseren individuellen Musikgeschmack ein. Dennoch haben selbst unsere fortschrittlichsten Maschinen und Computer immer noch Probleme mit dieser Aufgabe. Ich werde Ihnen heute von den Fortschritten erzählen, die wir in unserem Forschungsgebiet der Computer Vision gemacht haben, einer der bahnbrechendsten und vielleicht revolutionärsten Technologien in der Informatik.

Fei-Fei Li: This is a three-year-old child describing what she sees in a series of photos. She might still have a lot to learn about this world, but she's already an expert at one very important task: to make sense of what she sees. Our society is more technologically advanced than ever. We send people to the moon, we make phones that talk to us or customize radio stations that can play only music we like. Yet, our most advanced machines and computers still struggle at this task. So I'm here today to give you a progress report on the latest advances in our research in computer vision, one of the most frontier and potentially revolutionary technologies in computer science.

Wir haben Autos entwickelt, die eigenständig fahren können, aber ohne intelligentes Sehvermögen können sie nicht unterscheiden, ob auf der Straße eine zerknitterte Papiertüte liegt, die man überfahren kann, oder ein Stein von gleicher Größe, dem man ausgeweichen muss. Wir haben sagenhaft hochauflösende Kameras entwickelt, aber wir können Blinde nicht wieder sehen lassen. Drohnen können über riesige Distanzen fliegen, besitzen aber nicht die nötige Sichttechnologie, um die Veränderungen der Regenwälder nachzuverfolgen. Überwachungskameras sind überall, aber warnen uns nicht, wenn ein Kind im Schwimmbad ertrinkt. Bilder und Videos werden immer mehr zu einem festen Bestandteil des Lebens. Sie werden in einer Geschwindigkeit erzeugt, die weit jenseits dessen liegt, was Menschen sich auch nur erhoffen könnten zu sichten. Sie und ich tragen mit diesem TED Talk gerade dazu bei. Unsere fortschrittlichste Software hat noch immer Probleme beim Verstehen und Verwalten dieser enormen Masse an Inhalten. Man kann soweit gehen und sagen, dass wir als Gesellschaft nahezu blind sind, weil unsere klügsten Maschinen immer noch blind sind.

Yes, we have prototyped cars that can drive by themselves, but without smart vision, they cannot really tell the difference between a crumpled paper bag on the road, which can be run over, and a rock that size, which should be avoided. We have made fabulous megapixel cameras, but we have not delivered sight to the blind. Drones can fly over massive land, but don't have enough vision technology to help us to track the changes of the rainforests. Security cameras are everywhere, but they do not alert us when a child is drowning in a swimming pool. Photos and videos are becoming an integral part of global life. They're being generated at a pace that's far beyond what any human, or teams of humans, could hope to view, and you and I are contributing to that at this TED. Yet our most advanced software is still struggling at understanding and managing this enormous content. So in other words, collectively as a society, we're very much blind, because our smartest machines are still blind.

"Warum ist das so schwierig?", fragen Sie sich vielleicht. Kameras können solche Bilder schießen, indem sie Licht in eine zweidimensionale Matrix aus Zahlen umwandeln, besser bekannt als Pixel. Aber das sind nur leblose Zahlen. Sie sind an sich bedeutungslos. Hören ist nicht dasselbe wie Verstehen. Ebenso ist Fotografieren nicht dasselbe wie Sehen. Mit Sehen meinen wir genauer gesagt Verstehen. Tatsächlich hat Mutter Natur 540 Millionen Jahre gebraucht, um diese Aufgabe zu lösen. Ein Großteil des Aufwands war die Entwicklung der visuellen Verarbeitungskapazität unseres Gehirns, gar nicht der Augen an sich. Das Sehen beginnt mit den Augen, geschieht aber eigentlich im Gehirn.

"Why is this so hard?" you may ask. Cameras can take pictures like this one by converting lights into a two-dimensional array of numbers known as pixels, but these are just lifeless numbers. They do not carry meaning in themselves. Just like to hear is not the same as to listen, to take pictures is not the same as to see, and by seeing, we really mean understanding. In fact, it took Mother Nature 540 million years of hard work to do this task, and much of that effort went into developing the visual processing apparatus of our brains, not the eyes themselves. So vision begins with the eyes, but it truly takes place in the brain.

Vor 15 Jahren begann ich meine Doktorarbeit am Caltech, danach leitete ich das Vision Lab in Stanford. Die ganze Zeit arbeitete ich mit Mentoren, Mitarbeitern und Studenten daran, Computern das Sehen beizubringen. Unser Forschungsgebiet nennt sich Computer Vision und Maschinelles Lernen. Es gehört zum allgemeinen Gebiet der Künstlichen Intelligenz. Schlussendlich wollen wir Geräten beibringen, so wie wir zu sehen: Objekte benennen, Menschen erkennen, Dreidimensionalität von Objekten erfassen, Beziehungen, Emotionen, Handlungen und Absichten verstehen. Sie und ich begreifen ganze Geschichten zwischen Menschen, Orten und Dingen in Sekundenschnelle, wenn wir einen Blick darauf werfen.

So for 15 years now, starting from my Ph.D. at Caltech and then leading Stanford's Vision Lab, I've been working with my mentors, collaborators and students to teach computers to see. Our research field is called computer vision and machine learning. It's part of the general field of artificial intelligence. So ultimately, we want to teach the machines to see just like we do: naming objects, identifying people, inferring 3D geometry of things, understanding relations, emotions, actions and intentions. You and I weave together entire stories of people, places and things the moment we lay our gaze on them.

Der erste Schritt ist es, Computern die Objekterkennung beizubringen, einzelne Bausteine der visuellen Welt. Grundsätzlich können Sie sich diesen Lehrprozess so vorstellen, dass wir den Computern einige Trainingsbilder von bestimmten Objekten zeigen, zum Beispiel von Katzen, und ein Modell entwerfen, das von diesen Trainingsbildern lernt. Wie schwer kann das schon sein? Im Grunde besteht eine Katze aus einer Reihe verschiedener Formen und Farben. Genau das waren unsere ersten Schritte in der Objektmodellierung. Wir sagten dem Computeralgorithmus in einer mathematischen Sprache, dass eine Katze ein rundes Gesicht, einen pummeligen Körper, zwei spitze Ohren und einen langen Schwanz hat. Das sah ganz gut aus. Aber wie ist es mit dieser Katze? (Lachen) Sie ist ganz zusammengekuschelt. Jetzt muss man eine andere Form und eine Perspektive zum Objektmodell hinzufügen. Wie sieht es mit versteckten Katzen aus? Was ist mit diesen albernen Katzen? Jetzt verstehen Sie mich sicherlich. Sogar etwas so Einfaches wie ein Haustier kann für das Objektmodell unendlich viele Variationen annehmen. Und das ist nur ein Objekt.

The first step towards this goal is to teach a computer to see objects, the building block of the visual world. In its simplest terms, imagine this teaching process as showing the computers some training images of a particular object, let's say cats, and designing a model that learns from these training images. How hard can this be? After all, a cat is just a collection of shapes and colors, and this is what we did in the early days of object modeling. We'd tell the computer algorithm in a mathematical language that a cat has a round face, a chubby body, two pointy ears, and a long tail, and that looked all fine. But what about this cat? (Laughter) It's all curled up. Now you have to add another shape and viewpoint to the object model. But what if cats are hidden? What about these silly cats? Now you get my point. Even something as simple as a household pet can present an infinite number of variations to the object model, and that's just one object.

Vor etwa acht Jahren veränderte eine sehr einfache und grundlegende Beobachtung mein Denken. Niemand sagt einem Kind, wie es zu sehen hat, erst recht nicht am Anfang. Sie lernen durch eigene Erfahrungen und Beispiele. Wenn man sich die Augen eines Kindes als ein Paar biologischer Kameras vorstellt, schießen diese alle 200 Millisekunden ein Bild. Das ist die durchschnittliche Dauer einer Augenbewegung. Mit drei Jahren hat ein Kind also mehrere hundert Millionen Bilder der realen Welt gesehen. Das sind sehr viel Übungsbeispiele. Ich erkannte, dass der Fokus nicht auf immer besseren Algorithmen liegen muss, sondern dass wir den Algorithmen die Art von Übungsdaten geben müssen, die ein Kind durch seine Erfahrungen sammelt, sowohl quantitativ und qualitativ.

So about eight years ago, a very simple and profound observation changed my thinking. No one tells a child how to see, especially in the early years. They learn this through real-world experiences and examples. If you consider a child's eyes as a pair of biological cameras, they take one picture about every 200 milliseconds, the average time an eye movement is made. So by age three, a child would have seen hundreds of millions of pictures of the real world. That's a lot of training examples. So instead of focusing solely on better and better algorithms, my insight was to give the algorithms the kind of training data that a child was given through experiences in both quantity and quality.

Mit dieser Erkenntnis war es unsere Aufgabe, einen Datensatz zusammenzustellen, der weit mehr Bilder beinhaltete, als alles bisher Dagewesene. Vielleicht tausendfach mehr Bilder. Zusammen mit Professor Kai Li von der Princeton University starteten wir 2007 das ImageNet Projekt. Zum Glück mussten wir keine Kameras an unseren Köpfen anbringen und viele Jahre warten. Wir nutzten das Internet, die größte Fundgrube für Bilder, die die Menschheit erschaffen hat. Wir haben fast eine Milliarde Bilder heruntergeladen und mithilfe von Crowdsourcing wie der Amazon Mechanical Turk Plattform all diese Bilder kategorisiert. Zu Spitzenzeiten war ImageNet einer der größten Arbeitgeber für Amazon Mechanical Turk Mitarbeiter: Insgesamt bekamen wir Hilfe von fast 50.000 Arbeitern aus 167 Ländern weltweit beim Bereinigen, Sortieren und Benennen von fast einer Milliarde Bildern. Das zeigt, wieviel Aufwand nötig war, um auch nur einen Bruchteil der Bilder zu erfassen, die ein Kind in den frühen Jahren seiner Entwicklung verarbeitet.

Once we know this, we knew we needed to collect a data set that has far more images than we have ever had before, perhaps thousands of times more, and together with Professor Kai Li at Princeton University, we launched the ImageNet project in 2007. Luckily, we didn't have to mount a camera on our head and wait for many years. We went to the Internet, the biggest treasure trove of pictures that humans have ever created. We downloaded nearly a billion images and used crowdsourcing technology like the Amazon Mechanical Turk platform to help us to label these images. At its peak, ImageNet was one of the biggest employers of the Amazon Mechanical Turk workers: together, almost 50,000 workers from 167 countries around the world helped us to clean, sort and label nearly a billion candidate images. That was how much effort it took to capture even a fraction of the imagery a child's mind takes in in the early developmental years.

Rückblickend wirkt die Idee, riesengroße Datensätze zu nutzen, um Computeralgorithmen zu trainieren, absolut naheliegend. Doch 2007 war das nicht so offensichtlich. Wir waren auf dieser Reise lange Zeit ziemlich allein. Einige Kollegen rieten mir, mit meiner Anstellung etwas Sinnvolleres zu tun und wir kämpften ständig um die Finanzierung der Forschung. Einmal scherzte ich mit meinen Studenten darüber, meine alte Textilreinigung wieder zu öffnen, um ImageNet zu finanzieren. Immerhin hatte ich so auch mein Studium finanziert.

In hindsight, this idea of using big data to train computer algorithms may seem obvious now, but back in 2007, it was not so obvious. We were fairly alone on this journey for quite a while. Some very friendly colleagues advised me to do something more useful for my tenure, and we were constantly struggling for research funding. Once, I even joked to my graduate students that I would just reopen my dry cleaner's shop to fund ImageNet. After all, that's how I funded my college years.

Also machten wir weiter. 2009 lieferte das ImageNet-Projekt eine Datenbank mit über 15 Millionen Bildern, die 22.000 Objektkategorien umfassten und nach englischen Alltagsbegriffen geordnet waren. Sowohl quantitativ, als auch qualitativ war das ein noch nie dagewesener Umfang. Zurück zum Katzenbeispiel: Wir haben mehr als 62.000 Katzen mit verschiedenstem Aussehen und in allerlei Posen über alle Rassen von Haus- und Wildkatzen hinweg. Wir waren begeistert, ImageNet aufgebaut zu haben, und wollten, dass die ganze Forschungswelt davon profitiert. Ganz nach TED-Art machten wir daher unseren kompletten Datensatz für Wissenschaftler aus aller Welt kostenlos verfügbar. (Applaus)

So we carried on. In 2009, the ImageNet project delivered a database of 15 million images across 22,000 classes of objects and things organized by everyday English words. In both quantity and quality, this was an unprecedented scale. As an example, in the case of cats, we have more than 62,000 cats of all kinds of looks and poses and across all species of domestic and wild cats. We were thrilled to have put together ImageNet, and we wanted the whole research world to benefit from it, so in the TED fashion, we opened up the entire data set to the worldwide research community for free. (Applause)

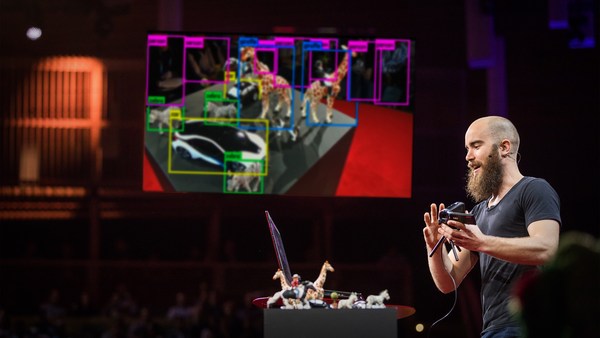

Da wir nun die Daten haben, um unser Computerhirn zu füttern, können wir jetzt zu den Algorithmen zurückkommen. Es stellte sich heraus, dass die Informationsfülle auf ImageNet perfekt zu einer bestimmten Art von Machine Learning-Algorithmen passte, sogenannte "faltende neuronale Netzwerke", entwickelt von Kunihiko Fukushima, Geoff Hinton und Yann LeCun und das schon in den 70er und 80er Jahren. So wie unser Gehirn aus Milliarden von stark vernetzten Neuronen besteht, ist die einfachste Betriebseinheit eines neuronalen Netzwerks ein neuronenähnlicher Knotenpunkt. Er erhält Input von anderen Knotenpunkten und sendet Output an andere. Zusätzlich sind diese hunderttausende oder sogar Millionen von Knotenpunkten in hierarchischen Schichten organisiert, auch das ähnlich wie im Gehirn. Ein typisches Neuronales Netz, das unser Objekterkennungsmodell trainiert, besitzt 24 Millionen Knotenpunkte, 140 Millionen Parameter und 15 Milliarden Verbindungen. Das ist ein riesiges Modell. Dank der immensen Datenmenge von ImageNet und der modernen CPUs und GPUs, auf denen wir dieses gigantische Modell trainieren, blühte das faltende neuronale Netzwerk auf eine Weise auf, die niemand erwartet hatte. Es wurde die erfolgreichste Struktur, um spannende neue Ergebnisse in der Objekterkennung zu generieren. Das ist ein Computer, der uns sagt, dass auf diesem Bild eine Katze zu sehen ist und wo sich diese Katze befindet. Natürlich gibt es noch mehr als nur Katzen. Hier sehen Sie einen Computeralgorithmus, der uns sagt, dass auf dem Bild ein Junge und ein Teddybär sind; hier ein Hund, eine Person und ein kleiner Drachen im Hintergrund; oder dieses sehr überladene Bild: ein Mann, ein Skateboard, Geländer, eine Laterne und so weiter. Manchmal weiß der Computer nicht genau, was er sieht, und wir haben ihm beigebracht, schlau genug zu sein, uns eine sichere Antwort zu geben, statt sich zu sehr festzulegen, genau so wie wir es auch machen würden. Manchmal ist der Algorithmus dagegen bemerkenswert gut darin, uns zu sagen, was genau die Objekte sind, wie die Marke, das Modell und das Baujahr eines Autos.

Now that we have the data to nourish our computer brain, we're ready to come back to the algorithms themselves. As it turned out, the wealth of information provided by ImageNet was a perfect match to a particular class of machine learning algorithms called convolutional neural network, pioneered by Kunihiko Fukushima, Geoff Hinton, and Yann LeCun back in the 1970s and '80s. Just like the brain consists of billions of highly connected neurons, a basic operating unit in a neural network is a neuron-like node. It takes input from other nodes and sends output to others. Moreover, these hundreds of thousands or even millions of nodes are organized in hierarchical layers, also similar to the brain. In a typical neural network we use to train our object recognition model, it has 24 million nodes, 140 million parameters, and 15 billion connections. That's an enormous model. Powered by the massive data from ImageNet and the modern CPUs and GPUs to train such a humongous model, the convolutional neural network blossomed in a way that no one expected. It became the winning architecture to generate exciting new results in object recognition. This is a computer telling us this picture contains a cat and where the cat is. Of course there are more things than cats, so here's a computer algorithm telling us the picture contains a boy and a teddy bear; a dog, a person, and a small kite in the background; or a picture of very busy things like a man, a skateboard, railings, a lampost, and so on. Sometimes, when the computer is not so confident about what it sees, we have taught it to be smart enough to give us a safe answer instead of committing too much, just like we would do, but other times our computer algorithm is remarkable at telling us what exactly the objects are, like the make, model, year of the cars.

Wir haben diesen Algorithmus auf Millionen von Google Street View Bilder angewendet in hunderten amerikanischen Städten und fanden dabei etwas sehr Interessantes heraus: Zunächst bestätigte sich unsere Vermutung, dass Fahrzeugpreise in direktem Bezug zu Haushaltseinkommen stehen. Überraschenderweise korrelieren die Fahrzeugpreise auch stark mit den Kriminalitätsraten einer Stadt oder den Wahlergebnissen nach Postleitzahlen.

We applied this algorithm to millions of Google Street View images across hundreds of American cities, and we have learned something really interesting: first, it confirmed our common wisdom that car prices correlate very well with household incomes. But surprisingly, car prices also correlate well with crime rates in cities, or voting patterns by zip codes.

Aber Moment mal. War es das schon? Sind Computer mit dem Menschen gleich gezogen oder haben ihn sogar übertroffen? Nicht so schnell. Bisher haben wir dem Computer lediglich beigebracht, Objekte zu sehen. Das ist wie ein kleines Kind, das gerade seine ersten Substantive zu sagen lernt. Das ist eine beachtliche Leistung, aber doch nur der erste Schritt. Bald wird das nächste Entwicklungsziel erreicht und Kinder fangen an, in ganzen Sätzen zu kommunizieren. Anstatt zu sagen, dass auf dem Bild eine Katze ist, sagte uns das kleine Mädchen schon, dass die Katze auf einem Bett liegt.

So wait a minute. Is that it? Has the computer already matched or even surpassed human capabilities? Not so fast. So far, we have just taught the computer to see objects. This is like a small child learning to utter a few nouns. It's an incredible accomplishment, but it's only the first step. Soon, another developmental milestone will be hit, and children begin to communicate in sentences. So instead of saying this is a cat in the picture, you already heard the little girl telling us this is a cat lying on a bed.

Um einem Computer beizubringen, ein Bild zu sehen und Sätze zu bilden, muss die Ehe zwischen Big Data und dem Machine Learning-Algorithmus den nächsten Schritt gehen. Nun muss der Computer sowohl von Bildern als auch von natürlichsprachlichen Sätzen lernen, die Menschen erzeugen. Wie auch das Gehirn das Sehen mit der Sprache verbindet, entwickelten wir ein Modell, das einen Teil der visuellen Dinge wie visuelle Ausschnitte mit Wörtern und Ausdrücken in Sätzen vereint.

So to teach a computer to see a picture and generate sentences, the marriage between big data and machine learning algorithm has to take another step. Now, the computer has to learn from both pictures as well as natural language sentences generated by humans. Just like the brain integrates vision and language, we developed a model that connects parts of visual things like visual snippets with words and phrases in sentences.

Vor etwa vier Monaten haben wir das alles endlich miteinander verbunden und eines der ersten Computer Vision-Modelle erzeugt, das in der Lage ist, einen menschenähnlichen Satz zu generieren, wenn es ein Bild zum ersten Mal sieht. Jetzt kann ich Ihnen zeigen, was der Computer sagt, wenn er die Bilder sieht, die das kleine Mädchen am Anfang dieser Präsentation sah.

About four months ago, we finally tied all this together and produced one of the first computer vision models that is capable of generating a human-like sentence when it sees a picture for the first time. Now, I'm ready to show you what the computer says when it sees the picture that the little girl saw at the beginning of this talk.

(Video) Computer: Ein Mann steht neben einem Elefanten. Ein großes Flugzeug steht auf einer Landebahn.

(Video) Computer: A man is standing next to an elephant. A large airplane sitting on top of an airport runway.

FFL: Natürlich arbeiten wir noch eifrig daran, diese Algorithmen zu verbessern und sie müssen noch immer viel lernen. (Applaus)

FFL: Of course, we're still working hard to improve our algorithms, and it still has a lot to learn. (Applause)

Der Computer macht immer noch Fehler.

And the computer still makes mistakes.

(Video) Computer: Eine Katze liegt unter einer Decke auf dem Bett.

(Video) Computer: A cat lying on a bed in a blanket.

FFL: Wenn er zu viele Katzen sieht, denkt er, alles könnte eine Katze sein.

FFL: So of course, when it sees too many cats, it thinks everything might look like a cat.

(Video) Computer: Ein kleiner Junge hält einen Baseballschläger. (Lachen)

(Video) Computer: A young boy is holding a baseball bat. (Laughter)

Wenn er noch nie eine Zahnbürste gesehen hat, ist es für ihn ein Baseballschläger.

FFL: Or, if it hasn't seen a toothbrush, it confuses it with a baseball bat.

(Video) Computer: Ein Mann reitet auf einem Pferd die Straße hinunter. (Lachen)

(Video) Computer: A man riding a horse down a street next to a building. (Laughter)

FFL: Wir haben den Computern das Konzept der Kunst noch nicht beigebracht.

FFL: We haven't taught Art 101 to the computers.

(Video) Computer: Ein Zebra steht auf einer Wiese.

(Video) Computer: A zebra standing in a field of grass.

FFL: Er hat die phantastische Schönheit der Natur noch nicht schätzen gelernt, so wie Sie und ich es tun.

FFL: And it hasn't learned to appreciate the stunning beauty of nature like you and I do.

Wir haben einen langen Weg hinter uns. Es war schwer von null bis zu unserem dritten Lebensjahr zu kommen. Die echte Herausforderung ist es aber, von 3 bis 13 und noch weiter zu kommen. Erinnern Sie sich an das Bild mit dem Jungen und dem Kuchen. Bisher haben wir dem Computer beigebracht, Objekte zu sehen oder uns eine einfache Geschichte zu den Bildern zu erzählen.

So it has been a long journey. To get from age zero to three was hard. The real challenge is to go from three to 13 and far beyond. Let me remind you with this picture of the boy and the cake again. So far, we have taught the computer to see objects or even tell us a simple story when seeing a picture.

(Video) Computer: Eine Person sitzt an einem Tisch mit einem Kuchen.

(Video) Computer: A person sitting at a table with a cake.

FFL: Aber es steckt viel mehr in diesem Bild als nur eine Person und ein Kuchen. Der Computer erkennt nicht, dass es ein spezieller italienischer Kuchen ist, der nur zu Ostern gebacken wird. Der Junge trägt sein Lieblingsshirt, das ihm sein Vater von einer Reise nach Sydney mitgebracht hat. Sie und ich können sehen, wie glücklich er ist und was genau in diesem Moment in seinem Kopf vor sich geht.

FFL: But there's so much more to this picture than just a person and a cake. What the computer doesn't see is that this is a special Italian cake that's only served during Easter time. The boy is wearing his favorite t-shirt given to him as a gift by his father after a trip to Sydney, and you and I can all tell how happy he is and what's exactly on his mind at that moment.

Das ist mein Sohn Leo. Auf meiner Suche nach visueller Intelligenz denke ich ständig an Leo und an die Welt der Zukunft, in der er leben wird. Wenn Maschinen sehen können, werden Ärzte und Krankenschwestern ein zusätzliches Paar unermüdlicher Augen haben, um ihnen bei der Diagnose und Behandlung von Patienten zu helfen. Autos werden klüger und sicherer durch die Straßen fahren. Roboter, nicht nur Menschen, werden uns dabei helfen, in Katastrophengebiete vorzudringen, um Verschüttete und Verwundete zu retten. Wir werden neue Arten und bessere Materialien entdecken und ungesehene Grenzen erkunden, mit Hilfe von Maschinen.

This is my son Leo. On my quest for visual intelligence, I think of Leo constantly and the future world he will live in. When machines can see, doctors and nurses will have extra pairs of tireless eyes to help them to diagnose and take care of patients. Cars will run smarter and safer on the road. Robots, not just humans, will help us to brave the disaster zones to save the trapped and wounded. We will discover new species, better materials, and explore unseen frontiers with the help of the machines.

Schritt für Schritt bringen wir Maschinen das Sehen bei. Erst bringen wir es ihnen bei. Später helfen sie uns dabei, besser zu sehen. Zum ersten Mal werden unsere Augen nicht die einzigen sein, die unsere Welt studieren und erkunden. Wir werden Maschinen nicht nur wegen ihrer Intelligenz nutzen, wir werden mit ihnen zusammenarbeiten, wie es jetzt noch unvorstellbar scheint.

Little by little, we're giving sight to the machines. First, we teach them to see. Then, they help us to see better. For the first time, human eyes won't be the only ones pondering and exploring our world. We will not only use the machines for their intelligence, we will also collaborate with them in ways that we cannot even imagine.

Das ist mein Ziel: Ich möchte Computern visuelle Intelligenz geben und damit eine bessere Zukunft für Leo und die ganze Welt gestalten.

This is my quest: to give computers visual intelligence and to create a better future for Leo and for the world.

Danke.

Thank you.

(Applaus)

(Applause)