Lad mig vise jer noget.

Let me show you something.

(Video) Pige: Ok, det er en kat der sidder i en seng. Drengen klapper elefanten. Det er folk, der går ind i en flymaskine. Det er en stor flymaskine.

(Video) Girl: Okay, that's a cat sitting in a bed. The boy is petting the elephant. Those are people that are going on an airplane. That's a big airplane.

Fei-Fei Li: Det her er et treårigt barn der beskriver hvad hun ser i en række billeder. Hun har endnu masser at lære om verden men hun er allerede ekspert i en meget vigtig ting: at få mening ud af det hun ser. Vort samfund er mere teknologisk avanceret end nogensinde. Vi sender folk til månen, vi laver telefoner der taler til os eller tilpasser radio stationer der kan spille musik som kun vi kan lide. Alligevel har de mest avancerede maskiner og computere stadig problemer med dette. Jeg er her idag for at give jer en statusrapport på de nyeste fremskridt i forskningen af computer vision en af de mest banebrydende og muligvis revolutionære teknologier i computer videnskab.

Fei-Fei Li: This is a three-year-old child describing what she sees in a series of photos. She might still have a lot to learn about this world, but she's already an expert at one very important task: to make sense of what she sees. Our society is more technologically advanced than ever. We send people to the moon, we make phones that talk to us or customize radio stations that can play only music we like. Yet, our most advanced machines and computers still struggle at this task. So I'm here today to give you a progress report on the latest advances in our research in computer vision, one of the most frontier and potentially revolutionary technologies in computer science.

Ja, vi har prototyper af biler, der er selvkørende men uden intelligent vision kan de ikke se forskel mellem en krøllet pose på vejen, der kan køres over og en sten af samme størrelse, der skal undgås. Vi har lavet fabelagtige megapixel kameraer men vi har ikke givet blinde syn. Droner kan flyve over store landområder men vi har ikke nok vision teknologi til at følge forandringerne i regnskoven. Sikkerhedskameraer er allevegne men de advarer os ikke, når et barn drukner i en svømmepøl. Foto og video er blevet en integreret del af det globale liv. De bliver fremstillet hurtigere end noget menneske eller hold af folk kan nå at se og du og jeg bidrager til det ved denne TED. Vor mest avancerede software kæmper stadig med at forstå og administrere dette enorme indhold. Med andre ord er vi kollektivt som samfund stadig meget blinde, for vor klogeste maskiner er stadig blinde.

Yes, we have prototyped cars that can drive by themselves, but without smart vision, they cannot really tell the difference between a crumpled paper bag on the road, which can be run over, and a rock that size, which should be avoided. We have made fabulous megapixel cameras, but we have not delivered sight to the blind. Drones can fly over massive land, but don't have enough vision technology to help us to track the changes of the rainforests. Security cameras are everywhere, but they do not alert us when a child is drowning in a swimming pool. Photos and videos are becoming an integral part of global life. They're being generated at a pace that's far beyond what any human, or teams of humans, could hope to view, and you and I are contributing to that at this TED. Yet our most advanced software is still struggling at understanding and managing this enormous content. So in other words, collectively as a society, we're very much blind, because our smartest machines are still blind.

"Hvorfor er det så svært?" spørger du måske. Kameraer tager billeder som dette ved at konvertere lys til en to-dimensionel række af tal kendt som pixler men de er kun livløse tal. De har ingen mening i sig selv. Ligesom at høre ikke er det samme som at lytte er det at tage billeder ikke det samme som at se og ved at se mener vi at forstå. Faktisk tog det Moder Natur 540 mio. års hårdt arbejde at løse denne opgave og megen af den indsats gik til at udvikle det visuelle apparat i vor hjerner og ikke selve øjnene. Vision starter med øjnene men foregår virkelig i hjernen.

"Why is this so hard?" you may ask. Cameras can take pictures like this one by converting lights into a two-dimensional array of numbers known as pixels, but these are just lifeless numbers. They do not carry meaning in themselves. Just like to hear is not the same as to listen, to take pictures is not the same as to see, and by seeing, we really mean understanding. In fact, it took Mother Nature 540 million years of hard work to do this task, and much of that effort went into developing the visual processing apparatus of our brains, not the eyes themselves. So vision begins with the eyes, but it truly takes place in the brain.

I 15 år nu, fra min Ph.D. i Caltech og bagefter da jeg førte Stanford´s Vision Lab, har jeg arbejdet med mine mentorer, kolleger og elever med at lære computere at se. Vort forskningsfelt kaldes computer vision og maskinlærdom. Det er en del af det generelle felt af kunstig intelligens. Vi vil lære maskiner at se ligesom os: identificere objekter, mennesker og udlede 3D geometrien af ting at forstå relationer, følelser handlinger og intentioner. Du og jeg udleder hele historier af folk, steder og ting i det sekund vi kigger på dem.

So for 15 years now, starting from my Ph.D. at Caltech and then leading Stanford's Vision Lab, I've been working with my mentors, collaborators and students to teach computers to see. Our research field is called computer vision and machine learning. It's part of the general field of artificial intelligence. So ultimately, we want to teach the machines to see just like we do: naming objects, identifying people, inferring 3D geometry of things, understanding relations, emotions, actions and intentions. You and I weave together entire stories of people, places and things the moment we lay our gaze on them.

Første skridt mod dette mål er at lære computere at se objekter, byggestenene i den visuelle verden. Enklest sagt, kan du forestille dig denne lærdomsproces som at vise computere nogle træningsbilleder af et bestemt objekt, f.eks. katte og designe en model der lærer af disse træningsbilleder. Hvor svært kan det være? En kat er jo en samling af former og farver, og dét er hvad vi gjorde i starten af objekt modelleringen. Vi fortalte computer algoritmen i et matematisk sprog at en kat har et rundt ansigt, en fyldig krop, to spidse ører og en lang hale og det virkede fint. Men hvad med denne kat? (Latter) Den er helt sammenfoldet. Nu bliver du nødt til at tilføje en ny form og udsigtspunkt til objektet. Men hvad hvis katten er gemt? Hvad med disse fjollede katte? Nu ser I problemet. Selv noget så simpelt som et husdyr kan lave uendelige variationer til objekt modelleringen, og det er kun ét objekt.

The first step towards this goal is to teach a computer to see objects, the building block of the visual world. In its simplest terms, imagine this teaching process as showing the computers some training images of a particular object, let's say cats, and designing a model that learns from these training images. How hard can this be? After all, a cat is just a collection of shapes and colors, and this is what we did in the early days of object modeling. We'd tell the computer algorithm in a mathematical language that a cat has a round face, a chubby body, two pointy ears, and a long tail, and that looked all fine. But what about this cat? (Laughter) It's all curled up. Now you have to add another shape and viewpoint to the object model. But what if cats are hidden? What about these silly cats? Now you get my point. Even something as simple as a household pet can present an infinite number of variations to the object model, and that's just one object.

For omkring otte år siden forandrede en meget simpel og dyb observering min tænkemåde. Ingen fortæller et barn hvordan det ser, særlig i de tidligste år. De lærer dette gennem virkelige erfaringer og eksempler. Hvis man ser et barns øjne som et par biologiske kameraer tager de et billede ca. hver 200 millisekunder, gennemsnitstiden for hver bevægelse i øjnene. Ved tre-årstiden vil et barn have set hundrede mio. billeder af den virkelige verden. Det er mange træningseksempler. Istedet for kun at fokusere på bedre og bedre algoritmer var min indsigt at give algoritmerne den slags træningsdata som et barn får gennem erfaringer både i kvalitet og kvantitet.

So about eight years ago, a very simple and profound observation changed my thinking. No one tells a child how to see, especially in the early years. They learn this through real-world experiences and examples. If you consider a child's eyes as a pair of biological cameras, they take one picture about every 200 milliseconds, the average time an eye movement is made. So by age three, a child would have seen hundreds of millions of pictures of the real world. That's a lot of training examples. So instead of focusing solely on better and better algorithms, my insight was to give the algorithms the kind of training data that a child was given through experiences in both quantity and quality.

Når vi ved dette, kan vi begynde at samle et data sæt som har langt flere billeder end vi før har haft, måske tusindvis af gange mere, og sammen med professor Kai Li i Princeton University startede vi ImageNet projektet i 2007. Heldigvis behøvede vi ikke at sætte et kamera på hovedet og vente i mange år. Vi tog på Internettet, den største samling af billeder som mennesket nogensinde har lavet. Vi downloadede næsten en milliard billeder og brugte crowdsource teknologier såsom Amazon Mechanical Turk platformen til at hjælpe med at sortere billederne. På sit højeste var ImageNet en af de største arbejdsgivere af alle Amazon Mechanical Turk ansatte: tilsammen hjalp næsten 50,000 ansatte fra 167 lande rundt omkring i verden os med at rense, sortere og rubricere næsten en milliard kandidat-billeder. Så megen indsats tog det at fange selv en brøkdel af alle de billeder som et barns hjerne bearbejder i de første leveår.

Once we know this, we knew we needed to collect a data set that has far more images than we have ever had before, perhaps thousands of times more, and together with Professor Kai Li at Princeton University, we launched the ImageNet project in 2007. Luckily, we didn't have to mount a camera on our head and wait for many years. We went to the Internet, the biggest treasure trove of pictures that humans have ever created. We downloaded nearly a billion images and used crowdsourcing technology like the Amazon Mechanical Turk platform to help us to label these images. At its peak, ImageNet was one of the biggest employers of the Amazon Mechanical Turk workers: together, almost 50,000 workers from 167 countries around the world helped us to clean, sort and label nearly a billion candidate images. That was how much effort it took to capture even a fraction of the imagery a child's mind takes in in the early developmental years.

Set i bakspejlet er denne idé med at bruge massive data til at træne computer algoritmer måske indlysende, men i 2007 var det ikke så enkelt. Vi var ret alene på denne rejse i et godt stykke tid. Nogle venlige kolleger gav mig det råd at bruge arbejdstiden mere effektivt og vi arbejdede hårdt for at skaffe forskningsmidler. Jeg jokede også med mine kandidatstuderende at jeg ville genåbne mit renseri for at skaffe penge til ImageNet. Det er jo hvordan jeg finansierede mine universitetsår.

In hindsight, this idea of using big data to train computer algorithms may seem obvious now, but back in 2007, it was not so obvious. We were fairly alone on this journey for quite a while. Some very friendly colleagues advised me to do something more useful for my tenure, and we were constantly struggling for research funding. Once, I even joked to my graduate students that I would just reopen my dry cleaner's shop to fund ImageNet. After all, that's how I funded my college years.

Så vi fortsatte. I 2009 leverede ImageNet projektet en database på 15 millioner billeder bestående af 22,000 klasser af objekter og ting organiseret af engelske dagligdags-ord. I både kvalitet og kvantitet var dette aldrig set før. F.eks. i eksemplet med katte har vi nu mere end 62,000 katte af alle slags udseender og positioner og af alle racer af både hus- og vilde katte. Vi var utrolig glade for at have sammensat ImageNet, og vi ville, at hele forskningsverdenen ville få gavn af dette, så på ren TED-manér åbnede vi for hele data-sættet gratis til hele forsknings-fællesskabet. (Bifald)

So we carried on. In 2009, the ImageNet project delivered a database of 15 million images across 22,000 classes of objects and things organized by everyday English words. In both quantity and quality, this was an unprecedented scale. As an example, in the case of cats, we have more than 62,000 cats of all kinds of looks and poses and across all species of domestic and wild cats. We were thrilled to have put together ImageNet, and we wanted the whole research world to benefit from it, so in the TED fashion, we opened up the entire data set to the worldwide research community for free. (Applause)

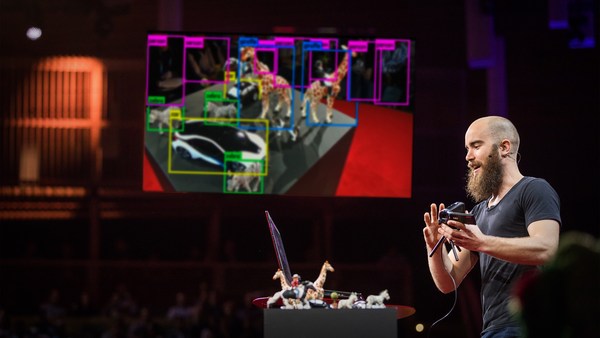

Nu, da vi har data til at nære vor computer-hjerne er vi klar til at tage fat på selve algoritmerne. Det viste sig at overfloden af information som ImageNet gav passede perfekt til en særlig klasse af maskinlærings-algoritmer kaldet sammenfoldede neurale netværk, udviklet af Kunihiko Fukushima, Geoff Hinton og Yann LeCun i 1970´erne og 80´erne. Ligesom hjernen består af milliarder af sammenkædede neuroner, er et grundlæggende armatur i et neuralt netværk som en neuron-lignende node. Det tager input fra andre noder og sender output til andre. Disse hundrede tusinder eller endda millioner af noder er organiseret i hierarkiske lag, ligesom i hjernen. I et typisk neuralt netværk vi bruger til at træne vor objekt-genkendelsesmodel, er der 24 millioner knuder, 140 millioner parametre, og 15 milliarder tilslutninger. Det er en enorm model. Drevet af de massive data fra ImageNet, og de moderne CPU´er og GPU´er brugt til at træne en så stor model, begyndte det sammenfoldede neurale netværk at blomstre på en måde ingen forventede. Det blev den førende arkitektur til at genere spændende nye resultater i objekt-genkendelse. Dét her er en computer, der fortæller os at dette billede indeholder en kat og hvor katten er. Der er selvfølgelig andre ting end katte så her er en computer algoritme der fortæller at dette billede indeholder en dreng og en bamse; en hund, en person og en lille drage i baggrunden; eller et billede af meget travle ting som en mand, et skateboard, rækværk, en lygtepæl, og så videre. Sommetider, når computeren ikke er så sikker på hvad den ser, har den lært at være klog nok til at give os et sikkert svar i stedet for at være for skråsikker sig, ligesom vi ville, men som regel er algoritmen utrolig god til at fortælle os præcis hvad objekterne er, som fremstillingen, modellen og årgangen af bilerne.

Now that we have the data to nourish our computer brain, we're ready to come back to the algorithms themselves. As it turned out, the wealth of information provided by ImageNet was a perfect match to a particular class of machine learning algorithms called convolutional neural network, pioneered by Kunihiko Fukushima, Geoff Hinton, and Yann LeCun back in the 1970s and '80s. Just like the brain consists of billions of highly connected neurons, a basic operating unit in a neural network is a neuron-like node. It takes input from other nodes and sends output to others. Moreover, these hundreds of thousands or even millions of nodes are organized in hierarchical layers, also similar to the brain. In a typical neural network we use to train our object recognition model, it has 24 million nodes, 140 million parameters, and 15 billion connections. That's an enormous model. Powered by the massive data from ImageNet and the modern CPUs and GPUs to train such a humongous model, the convolutional neural network blossomed in a way that no one expected. It became the winning architecture to generate exciting new results in object recognition. This is a computer telling us this picture contains a cat and where the cat is. Of course there are more things than cats, so here's a computer algorithm telling us the picture contains a boy and a teddy bear; a dog, a person, and a small kite in the background; or a picture of very busy things like a man, a skateboard, railings, a lampost, and so on. Sometimes, when the computer is not so confident about what it sees, we have taught it to be smart enough to give us a safe answer instead of committing too much, just like we would do, but other times our computer algorithm is remarkable at telling us what exactly the objects are, like the make, model, year of the cars.

Vi anvendte algoritmerne i mio. af Google Street View billeder i hundreder af amerikanske byer, og vi har lært noget meget interessant: vi fik bekræftet den gængse viden at bilpriser korrelerer meget godt med husholdningsindtægter. Men overraskende nok korrelerer bilpriser godt med kriminalitet i byer, eller stemmemønstre ved postnumre.

We applied this algorithm to millions of Google Street View images across hundreds of American cities, and we have learned something really interesting: first, it confirmed our common wisdom that car prices correlate very well with household incomes. But surprisingly, car prices also correlate well with crime rates in cities, or voting patterns by zip codes.

Vent lidt. Er dét alt? Har computeren allerede nået eller endda overhalet menneskelige evner? Øjeblik. Indtil videre har vi kun lært computeren at se objekter. Det er ligesom et barn, der lærer at udtale nogle få navneord. Det er en utrolig stor udrettelse, men det er kun første skridt. Snart vil en ny udviklingsmæssig milepæl blive nået, og barnet begynder at kommunikere i sætninger. Istedet for at sige at dette er en kat på billedet, har vi allerede hørt pigen sige, at dette er en kat der ligger på en seng.

So wait a minute. Is that it? Has the computer already matched or even surpassed human capabilities? Not so fast. So far, we have just taught the computer to see objects. This is like a small child learning to utter a few nouns. It's an incredible accomplishment, but it's only the first step. Soon, another developmental milestone will be hit, and children begin to communicate in sentences. So instead of saying this is a cat in the picture, you already heard the little girl telling us this is a cat lying on a bed.

For at lære en computer at se et billede og lave sætninger, må sammenføringen af massive data og maskinlærings-algoritmer tages til et nyt niveau. Nu må computeren lære fra både billeder og naturlige sprog-sætninger fra mennesker. Ligesom hjernen integrerer vision og sprog har vi udviklet en model, der sammenfører dele af visuelle ting, eller visuelle klip, med ord og fraser i sætninger.

So to teach a computer to see a picture and generate sentences, the marriage between big data and machine learning algorithm has to take another step. Now, the computer has to learn from both pictures as well as natural language sentences generated by humans. Just like the brain integrates vision and language, we developed a model that connects parts of visual things like visual snippets with words and phrases in sentences.

For fire måneder siden fik vi endelig sammensat alt dette og producerede en af de første computervision modeller der er i stand til at lave en menneskelignende sætning når den ser et billede for første gang. Nu er jeg klar til at vise jer hvad computeren siger, når den ser billedet af hvad den lille pige så i starten af dette foredrag.

About four months ago, we finally tied all this together and produced one of the first computer vision models that is capable of generating a human-like sentence when it sees a picture for the first time. Now, I'm ready to show you what the computer says when it sees the picture that the little girl saw at the beginning of this talk.

(Video) Computer: En mand står ved siden af en elefant. Et stort fly står på en landingsbane i en lufthavn.

(Video) Computer: A man is standing next to an elephant. A large airplane sitting on top of an airport runway.

FFL: Selvfølgelig arbejder vi stadig hårdt med at forbedre vor algoritmer, og den har stadig meget at lære. (Bifald)

FFL: Of course, we're still working hard to improve our algorithms, and it still has a lot to learn. (Applause)

Og computeren laver stadig fejl.

And the computer still makes mistakes.

(Video) Computer: En kat ligger i et tæppe på en seng.

(Video) Computer: A cat lying on a bed in a blanket.

FFL: Så selvfølgelig, når den ser for mange katte, tror den at alt ligner en kat.

FFL: So of course, when it sees too many cats, it thinks everything might look like a cat.

(Video) Comp.: En lille dreng holder et baseball bat. (Latter)

(Video) Computer: A young boy is holding a baseball bat. (Laughter)

FFL: Eller hvis den ikke har set en tand- børste før, tror den at det er et bat.

FFL: Or, if it hasn't seen a toothbrush, it confuses it with a baseball bat.

(Video) Comp.: En mand rider en hest på en vej ved siden af en bygning. (Latter)

(Video) Computer: A man riding a horse down a street next to a building. (Laughter)

FFL: Vi har ikke lært computere kunst.

FFL: We haven't taught Art 101 to the computers.

(Video) Comp.: En zebra står på en eng.

(Video) Computer: A zebra standing in a field of grass.

FFL: Og den har ikke lært at værdsætte naturens utrolige skønhed som du og jeg.

FFL: And it hasn't learned to appreciate the stunning beauty of nature like you and I do.

Så det har været en lang rejse. Det var svært at nå treårsalderen. Udfordringen ligger i at nå 13-årsstadiet og endnu længere frem. Lad mig minde jer om billedet af drengen og kagen igen. Indtil videre har vi lært computere at se objekter eller endda fortælle en simpel historie når den ser et billede.

So it has been a long journey. To get from age zero to three was hard. The real challenge is to go from three to 13 and far beyond. Let me remind you with this picture of the boy and the cake again. So far, we have taught the computer to see objects or even tell us a simple story when seeing a picture.

(Video) Computer.: En person sidder ved et bord med en kage.

(Video) Computer: A person sitting at a table with a cake.

FFL: Men der er så meget mere ved dette billede end kun en person og en kage. Hvad computeren ikke ser, er at dette er en speciel italiensk kage som kun bliver serveret ved påske. Drengen er i sin yndlings t-shirt som hans far gav ham efter en tur til Sydney, og vi kan se hvor glad han er og præcis hvad han tænker i dette øjeblik.

FFL: But there's so much more to this picture than just a person and a cake. What the computer doesn't see is that this is a special Italian cake that's only served during Easter time. The boy is wearing his favorite t-shirt given to him as a gift by his father after a trip to Sydney, and you and I can all tell how happy he is and what's exactly on his mind at that moment.

Dette er min søn Leo. På min mission for visuel intelligens tænker jeg konstant på Leo og fremtidens verden han vil leve i. Når maskiner kan se vil læger og sygeplejersker have ekstra utrættelige øjne til at hjælpe med at diagnosticere og pleje patienter. Biler vil være klogere og sikrere på vejene. Robotter, ikke kun mennesker, vil hjælpe med at redde sårede mennesker på ulykkessteder. Vi vil opdage nye arter, bedre materialer, og udforske nye territorier ved hjælp af maskiner.

This is my son Leo. On my quest for visual intelligence, I think of Leo constantly and the future world he will live in. When machines can see, doctors and nurses will have extra pairs of tireless eyes to help them to diagnose and take care of patients. Cars will run smarter and safer on the road. Robots, not just humans, will help us to brave the disaster zones to save the trapped and wounded. We will discover new species, better materials, and explore unseen frontiers with the help of the machines.

Vi lærer maskiner at se med tiden. Først lærer vi dem at se. Så lærer de os at se bedre. For første gang vil menneskelige øjne ikke være de eneste som iagttager og udforsker vor verden. Vi vil ikke blot bruge maskiner for deres intelligens, vi vil også samarbejde med dem på måder vi end ikke kan forestille os.

Little by little, we're giving sight to the machines. First, we teach them to see. Then, they help us to see better. For the first time, human eyes won't be the only ones pondering and exploring our world. We will not only use the machines for their intelligence, we will also collaborate with them in ways that we cannot even imagine.

Dette er min mission: at give computere visuel intelligens og at skabe en bedre fremtid for Leo og for verden.

This is my quest: to give computers visual intelligence and to create a better future for Leo and for the world.

Tak skal I have.

Thank you.

(Bifald)

(Applause)