Něco vám ukážu.

Let me show you something.

(Video) Holčička: Dobře, to je kočka sedící na posteli. Kluk si hladí slona. To jsou lidi, co nastupují do letadla. Je to velké letadlo.

(Video) Girl: Okay, that's a cat sitting in a bed. The boy is petting the elephant. Those are people that are going on an airplane. That's a big airplane.

Fei-Fei Li: Toto je tříleté dítě popisující, co vidí na sérii fotek. Ještě se má hodně co učit o světě, ale už teď je expert na jednu velmi důležitou věc: dávat smysl tomu, co vidí. Naše společnost je více technologicky vyvinutá než kdy předtím. Posíláme lidi na měsíc, vyrábíme telefony, co na nás mluví, nebo si můžeme upravit radio, aby hrálo jenom hudbu, kterou chceme. Přesto naše nejvyvinutější stroje a počítače tenhle úkol nezvládají. Já jsem tu dnes, abych vám dala hlášení o vývoji posledních pokroků v našem výzkumu počítačového zraku, jedné z nejhraničnějších a potencionálně revolučních technologiích v počítačové vědě.

Fei-Fei Li: This is a three-year-old child describing what she sees in a series of photos. She might still have a lot to learn about this world, but she's already an expert at one very important task: to make sense of what she sees. Our society is more technologically advanced than ever. We send people to the moon, we make phones that talk to us or customize radio stations that can play only music we like. Yet, our most advanced machines and computers still struggle at this task. So I'm here today to give you a progress report on the latest advances in our research in computer vision, one of the most frontier and potentially revolutionary technologies in computer science.

Ano, navrhli jsme auta, která sama řídí, ale bez chytrého zraku, nerozeznají zmuchlaný papírový sáček na silnici, který se může přejet, od kamenu stejné velikosti, který by bylo lepší objet. Vytvořili jsme úžasné megapixelové foťáky, ale neumíme slepým vrátit zrak. Drony mohou létat po rozsáhlé krajině, ale nemají dostatečnou vizuální technologie, aby nám pomohly mapovat změny v deštných pralesech. Kamerové systémy jsou všude, ale neupozorní nás, když se dítě topí v bazénu. Fotky a videa se stávají nezbytnou součástí života. Jsou vytvářeny rychlostí, která je mnohem vyšší než jsme si dokázali představit, a já zde na TEDu k tomu přispívám. Přesto všechno naše nejdokonalejší programy stále zápasí s porozuměním a ovládáním tohoto ohromného obsahu. Jiný slovy, dohromady jako společnost jsme prakticky slepí, protože naše nejchytřejší stroje jsou slepé.

Yes, we have prototyped cars that can drive by themselves, but without smart vision, they cannot really tell the difference between a crumpled paper bag on the road, which can be run over, and a rock that size, which should be avoided. We have made fabulous megapixel cameras, but we have not delivered sight to the blind. Drones can fly over massive land, but don't have enough vision technology to help us to track the changes of the rainforests. Security cameras are everywhere, but they do not alert us when a child is drowning in a swimming pool. Photos and videos are becoming an integral part of global life. They're being generated at a pace that's far beyond what any human, or teams of humans, could hope to view, and you and I are contributing to that at this TED. Yet our most advanced software is still struggling at understanding and managing this enormous content. So in other words, collectively as a society, we're very much blind, because our smartest machines are still blind.

"Proč je to tak těžké?" ptáte se. Foťáky mohou vyfotit obrázek jako tento převedením světel do dvoudimenzionální soustavy známé jako pixely, ale to jsou jenom neživá čísla. Sama o sobě nemají smysl. Stejně jako slyšet není to samé jako poslouchat, fotit není to samé jako vidět, a viděním myslíme chápaní. Ve skutečnosti, Matce Zemi trvalo 540 milionů let tvrdé práce, aby tohoto dosáhla a velká část této snahy padla na vývoj zrakové procesního aparátu v našem mozku, nejen na oči samotné. Takže zrak začíná očima, ale odehrává se v mozku.

"Why is this so hard?" you may ask. Cameras can take pictures like this one by converting lights into a two-dimensional array of numbers known as pixels, but these are just lifeless numbers. They do not carry meaning in themselves. Just like to hear is not the same as to listen, to take pictures is not the same as to see, and by seeing, we really mean understanding. In fact, it took Mother Nature 540 million years of hard work to do this task, and much of that effort went into developing the visual processing apparatus of our brains, not the eyes themselves. So vision begins with the eyes, but it truly takes place in the brain.

Již po 15 let od mého doktorátu na Caltechu a vedení laboratoře Stanford's Vision, pracuji se svými mentory, spolupracovníky a studenty na tom, abychom naučili počítače vidět. Náš výzkum se jmenuje počítačový zrak a učení strojů. Je to součástí obecného oboru o umělé inteligenci. Chceme naučit stroje, aby viděly jako my: pojmenovávat objekty, identifikovat lidi, odvozovat 3D geometrii věcí, pochopení vztahů, emocí, akcí a úmyslů. Vy a já dohromady splétáme celé příběhy lidí, míst a věcí v okamžik, kdy je spatříme.

So for 15 years now, starting from my Ph.D. at Caltech and then leading Stanford's Vision Lab, I've been working with my mentors, collaborators and students to teach computers to see. Our research field is called computer vision and machine learning. It's part of the general field of artificial intelligence. So ultimately, we want to teach the machines to see just like we do: naming objects, identifying people, inferring 3D geometry of things, understanding relations, emotions, actions and intentions. You and I weave together entire stories of people, places and things the moment we lay our gaze on them.

Prvním krokem k dosažení tohoto cíle je naučit počítače vidět objekty, základní kameny světa vidění. Jednoduše řečeno, představte si tento proces učení jako ukazování počítačům tréninkové obrázky konkrétního objektu, například koček, a vytváření modelu, který se učí z těchto tréninkových obrázků. Jak těžké to může být? Vždyť kočka je jen sbírka tvarů a barev a to je přesně to, co jsme udělali v začátcích objektového modelování. Naučili jsme počítače algoritmus v matematickém jazyce, že kočka má kulatý obličej, zaoblené tělo, dvě špičaté uši, a dlouhý ocas, a všechno vypadalo dobře. Ale co třeba tahle kočka? (Smích) Je celá pokřivená. Nyní musíte tedy přidat další tvar a pohled danému modelu. Ale co když jsou kočky schované? Co tyhle pošetilé kočky? Teď už mě chápete. Tak jednoduchá věc jako je domácí mazlíček může mít nekonečné množství variací objektovému modelu, a to je to jenom jeden objekt.

The first step towards this goal is to teach a computer to see objects, the building block of the visual world. In its simplest terms, imagine this teaching process as showing the computers some training images of a particular object, let's say cats, and designing a model that learns from these training images. How hard can this be? After all, a cat is just a collection of shapes and colors, and this is what we did in the early days of object modeling. We'd tell the computer algorithm in a mathematical language that a cat has a round face, a chubby body, two pointy ears, and a long tail, and that looked all fine. But what about this cat? (Laughter) It's all curled up. Now you have to add another shape and viewpoint to the object model. But what if cats are hidden? What about these silly cats? Now you get my point. Even something as simple as a household pet can present an infinite number of variations to the object model, and that's just one object.

Takže před zhruba osmi lety, jeden prostý, ale pronikavý prostřeh změnil mé myšlení. Nikdo neříká dítěti jak má vidět, obzvláště v raném věku. Naučí se to pomocí skutečných životních zkušeností a příkladů. Když si představíte dětské oči jako pár biologických foťáků, vyfotí jeden obrázek každých 200 milisekund, což je průměrný čas, za který se oko pohne. Takže ve třetím roce dítě vidělo stovky milionů obrázků skutečného světa. To je celkem hodně tréninkových příkladů. Místo cílení na lepší algoritmy, můj nápad byl dát algoritmům taková tréninková data, jaká byla dána dítěti skrze zkušenosti jak množstevně, tak kvalitou.

So about eight years ago, a very simple and profound observation changed my thinking. No one tells a child how to see, especially in the early years. They learn this through real-world experiences and examples. If you consider a child's eyes as a pair of biological cameras, they take one picture about every 200 milliseconds, the average time an eye movement is made. So by age three, a child would have seen hundreds of millions of pictures of the real world. That's a lot of training examples. So instead of focusing solely on better and better algorithms, my insight was to give the algorithms the kind of training data that a child was given through experiences in both quantity and quality.

Jakmile jsme toto pochopili, věděli jsme, že potřebujeme sehnat sadu dat, která má v sobě mnohem více obrázků, než jsme kdy měli, možná i tisíckrát více, a společně s profesorem Kai Li na Princetonské univerzitě, jsme v roce 2007 spustili projekt ImageNet. Naštěstí jsme si nemuseli namontovat kameru na hlavu a čekat mnoho let. Šli jsme na internet, největší pokladnice obrázků, kterou jsme jako lidé vytvořili. Stáhli jsme téměř miliardu obrázků a využili crowdsourcingové technologie jako Amazon Mechanical Turk, aby nám pomohly pojmenovat tyto obrázky. Na svém vrcholu, ImageNet byl jedním z největších zaměstnavatelů pracovníků Amazon Mechanical Turk: celkem téměř 50 tisíc pracovníků, ze 167 zemí světa, nám pomohlo vyčistit, utřídit a označit téměř miliardu potencionálních obrázků. Přesně tolik úsilí nás stálo zachytili pouze zlomek obrázků, které dětská mysl přijímá během svých počátečních vývojových let.

Once we know this, we knew we needed to collect a data set that has far more images than we have ever had before, perhaps thousands of times more, and together with Professor Kai Li at Princeton University, we launched the ImageNet project in 2007. Luckily, we didn't have to mount a camera on our head and wait for many years. We went to the Internet, the biggest treasure trove of pictures that humans have ever created. We downloaded nearly a billion images and used crowdsourcing technology like the Amazon Mechanical Turk platform to help us to label these images. At its peak, ImageNet was one of the biggest employers of the Amazon Mechanical Turk workers: together, almost 50,000 workers from 167 countries around the world helped us to clean, sort and label nearly a billion candidate images. That was how much effort it took to capture even a fraction of the imagery a child's mind takes in in the early developmental years.

Při pohledu zpět, nápad používání velkého množství dat pro učení počítačových algoritmů se nyní může zdát samozřejmý, ale v roce 2007 tomu tak nebylo. Byli jsme po docela dlouhou dobu na této cestě sami. Někteří mí kolegové mi doporučovali, abych dělala něco užitečnějšího, a neustále jsme sháněli finance pro náš výzkum. Jednou jsem dokonce vtipkovala se svými studenty, že si znovu otevřu svoji čistírnu, abych zaplatila ImageNet. Přece jen, tak jsem financovala svoje studia na univerzitě.

In hindsight, this idea of using big data to train computer algorithms may seem obvious now, but back in 2007, it was not so obvious. We were fairly alone on this journey for quite a while. Some very friendly colleagues advised me to do something more useful for my tenure, and we were constantly struggling for research funding. Once, I even joked to my graduate students that I would just reopen my dry cleaner's shop to fund ImageNet. After all, that's how I funded my college years.

Tak jsme pokračovali. V roce 2009 projekt ImageNet vytvořil databázi 15 milionů obrázků napříč 22 000 tříd objektů a věcí organizovaných podle každodenních anglických slov. V obou - kvantitě i kvalitě, v nevídaném množství. Uvedu příklad na zmiňovaných kočkách, měli jsme více než 62 tisíc koček různého vzhledu, v různých pózách a všechny druhy domácích i divokých koček. Byli jsme nadšení, že jsme mohli dát ImageNet dohromady a chtěli jsme, aby toho mohl využívat celý výzkumný svět, takže podle TEDu, jsme celý náš data set otevřeli pro celosvětovou výzkumnou komunitu zadarmo. (Potlesk)

So we carried on. In 2009, the ImageNet project delivered a database of 15 million images across 22,000 classes of objects and things organized by everyday English words. In both quantity and quality, this was an unprecedented scale. As an example, in the case of cats, we have more than 62,000 cats of all kinds of looks and poses and across all species of domestic and wild cats. We were thrilled to have put together ImageNet, and we wanted the whole research world to benefit from it, so in the TED fashion, we opened up the entire data set to the worldwide research community for free. (Applause)

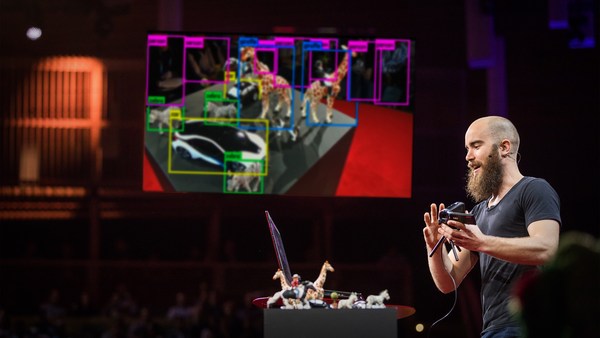

Když teď máme data, kterými můžeme krmit náš počítačový mozek, jsme připraveni se vrátit zpět k algoritmům jako takovým. Jak se pak ukázalo, hojnost informací z ImageNetu byla perfektní pro konkrétní třídu algoritmů pro učení strojů, které se nazývaly konvoluční neuronová síť, vytvořené Kunihikem Fukushimou, Geoffem Hintonem a Yannem LeCunem během 70. a 80. let 20. století. Stejně jako se mozek skládá z miliard vzájemně propojených neuronů, základní operační jednotkou v neuronové síti je uzel podobný neuronu. Vstup si vezme od jiných uzlů a pošle výstup dalším. Navíc tyto stovky tisíc či dokonce miliony uzlů jsou organizovány v hierarchistických vrstvách, podobně jako v mozku. V klasické neuronové síti, kterou používáme, abychom naučili náš model rozpoznávání objektů je 24 milionů uzlů, 140 milionů parametrů a 15 miliard spojení. To je obrovský model. Poháněný ohromným množstvím dat z ImageNet a moderními CPU a GPU k trénování takto velkého modelu, konvoluční neuronová síť kvete tak, jak by nikdo nečekal. Stala se vítěznou architekturou k vytváření nových úžasných výsledků v rozpoznávání objektů. Toto je počítač, který nám říká, že na obrázku je kočka a kde ta kočka je. Samozřejmě existuje víc věcí než jen kočky, takže tady je algoritmus počítače, který říká, že obrázek obsahuje chlapce a medvídka, psa, osobu a malého draka v pozadí, nebo velice chaotický obrázek plný věcí, jako je muž, skateboard, zábradlí, lampa atd. Někdy, když si počítač není jistý, co vidí, naučili jsme ho, aby byl dostatečně chytrý, a aby odpověděl neutrálně, než aby se k něčemu zavázal, stejně jako bychom to udělali my, ale jindy nám náš počítačový algoritmus znamenitě vysvětlí, co přesně dané objekty jsou, jako například značka, model a rok u auta.

Now that we have the data to nourish our computer brain, we're ready to come back to the algorithms themselves. As it turned out, the wealth of information provided by ImageNet was a perfect match to a particular class of machine learning algorithms called convolutional neural network, pioneered by Kunihiko Fukushima, Geoff Hinton, and Yann LeCun back in the 1970s and '80s. Just like the brain consists of billions of highly connected neurons, a basic operating unit in a neural network is a neuron-like node. It takes input from other nodes and sends output to others. Moreover, these hundreds of thousands or even millions of nodes are organized in hierarchical layers, also similar to the brain. In a typical neural network we use to train our object recognition model, it has 24 million nodes, 140 million parameters, and 15 billion connections. That's an enormous model. Powered by the massive data from ImageNet and the modern CPUs and GPUs to train such a humongous model, the convolutional neural network blossomed in a way that no one expected. It became the winning architecture to generate exciting new results in object recognition. This is a computer telling us this picture contains a cat and where the cat is. Of course there are more things than cats, so here's a computer algorithm telling us the picture contains a boy and a teddy bear; a dog, a person, and a small kite in the background; or a picture of very busy things like a man, a skateboard, railings, a lampost, and so on. Sometimes, when the computer is not so confident about what it sees, we have taught it to be smart enough to give us a safe answer instead of committing too much, just like we would do, but other times our computer algorithm is remarkable at telling us what exactly the objects are, like the make, model, year of the cars.

Aplikovali jsme tento algoritmus na miliony obrázků z Google Street View napříč stovkami amerických měst, a zjistili jsme něco velice zajímavého: zaprvé, to potvrdilo známou pravdu, že ceny aut jsou přímo úměrné příjmům domácností. A překvapivě, ceny aut jsou také závislé na kriminalitě v daných městech, a nebo volební názory na PSČ.

We applied this algorithm to millions of Google Street View images across hundreds of American cities, and we have learned something really interesting: first, it confirmed our common wisdom that car prices correlate very well with household incomes. But surprisingly, car prices also correlate well with crime rates in cities, or voting patterns by zip codes.

Takže, to je ono? Dosáhly počítače lidských schopností, nebo je snad dokonce přesáhly? Ne tak rychle. Zatím jsme počítač naučili jenom vidět věci. Je to jako malé dítě, které se učí vyslovit pár slov. Je to neuvěřitelný úspěch, ale je to teprve první krok. Brzy, další vývojový mezník bude dosažen, a děti se naučí mluvit ve větách. Takže místo tvrzení - to je kočka, slyšeli jsme holčičku říct, že kočka leží na posteli.

So wait a minute. Is that it? Has the computer already matched or even surpassed human capabilities? Not so fast. So far, we have just taught the computer to see objects. This is like a small child learning to utter a few nouns. It's an incredible accomplishment, but it's only the first step. Soon, another developmental milestone will be hit, and children begin to communicate in sentences. So instead of saying this is a cat in the picture, you already heard the little girl telling us this is a cat lying on a bed.

Abychom naučili počítač vidět obrázek a vytořit věty, vztah mezi velkým množstvím dat a algoritmem učení strojů musí dosáhnout další fáze. Nyní se počítač musí učit z obou částí, stejně tak jako jsou věty vytvářené lidmi. Stejně jako mozek spojuje zrak a jazyk, vytvořili jsme model, který spojuje části zraku, jako vizuální ústřižky se slovy a frázemi ve větách.

So to teach a computer to see a picture and generate sentences, the marriage between big data and machine learning algorithm has to take another step. Now, the computer has to learn from both pictures as well as natural language sentences generated by humans. Just like the brain integrates vision and language, we developed a model that connects parts of visual things like visual snippets with words and phrases in sentences.

Zhruba před čtyřmi měsíci, jsme to konečně spojili a vytvořili jeden z prvních modelů počítačového zraku, který je schopen vytvářet lidskou větu, když vidí daný obrázek poprvé. Nyní vám ukážu, co počítač řekne, když vidí obrázek, který viděla holčička na začátku.

About four months ago, we finally tied all this together and produced one of the first computer vision models that is capable of generating a human-like sentence when it sees a picture for the first time. Now, I'm ready to show you what the computer says when it sees the picture that the little girl saw at the beginning of this talk.

(Video) Počítač: Muž stojí vedle slona. Velké letadlo sedí na letištní runwayi.

(Video) Computer: A man is standing next to an elephant. A large airplane sitting on top of an airport runway.

FFL: Samozřejmě, stále pracujeme na zlepšení našich algoritmů a stále je toho hodně, co se učit. (Potlesk)

FFL: Of course, we're still working hard to improve our algorithms, and it still has a lot to learn. (Applause)

A počítač dělá i chyby.

And the computer still makes mistakes.

(Video) Počítač: Kočka ležící na posteli pod dekou.

(Video) Computer: A cat lying on a bed in a blanket.

FFL: samozřejmě, že když vidí tolik koček, myslí si, že všechno může vypadat jako kočka.

FFL: So of course, when it sees too many cats, it thinks everything might look like a cat.

(Video) Počítač: Mladý chlapec drží baseballovou pálku. (Smích)

(Video) Computer: A young boy is holding a baseball bat. (Laughter)

FFL: Nebo pokud ještě neviděl kartáček, splete si ho s basebalkou.

FFL: Or, if it hasn't seen a toothbrush, it confuses it with a baseball bat.

(Video) Počítač: Muž jede na koni po ulici vedle budovy. (Smích)

(Video) Computer: A man riding a horse down a street next to a building. (Laughter)

FFL: Nenaučili jsme naše počítače základy umění.

FFL: We haven't taught Art 101 to the computers.

(Video) Počítač: Zebra stojí na poli trávy.

(Video) Computer: A zebra standing in a field of grass.

FFL: A ještě neumí ocenit krásu přírody jako vy a já.

FFL: And it hasn't learned to appreciate the stunning beauty of nature like you and I do.

Je to dlouhá cesta. Dostat se od věku 0 do 3 let bylo těžké. Opravdová výzva je dostat se od 3 let ke 13 a dál. Dovolte mi ukázat ještě jednou obrázek chlapce s dortem. Zatím jsme počítač naučili vidět objekty, či dokonce říct krátce co vidí na obrázku.

So it has been a long journey. To get from age zero to three was hard. The real challenge is to go from three to 13 and far beyond. Let me remind you with this picture of the boy and the cake again. So far, we have taught the computer to see objects or even tell us a simple story when seeing a picture.

(Video) Počítač: Člověk sedí u stolu s dortem.

(Video) Computer: A person sitting at a table with a cake.

FFL: Ale na tom obrázku je toho o tolik více než jen člověk a dort. Co počítač nevidí, je, že je to speciální italský dort, který se podává pouze při Velikonocích. Chlapec má na sobě své nejoblíbenější tričko, které mu dal jeho otec po cestě do Sydney, a vy i já dokážeme říct, jak je šťastný a co si právě myslí.

FFL: But there's so much more to this picture than just a person and a cake. What the computer doesn't see is that this is a special Italian cake that's only served during Easter time. The boy is wearing his favorite t-shirt given to him as a gift by his father after a trip to Sydney, and you and I can all tell how happy he is and what's exactly on his mind at that moment.

Toto je můj syn Leo. Při řešení zrakové inteligence, myslím na Lea neustále, a na svět, ve kterém bude žít. Když stroje mohou vidět, doktoři a sestry budou mít navíc pár neúnavných očí, které jim pomohou diagnostikovat a starat se o pacienty. Auta budou jezdit chytřeji a bezpečněji. Roboti, nejen lidé, nám pomohou prozkoumat místa neštěstí, aby zachránili uvězněné a zraněné. Objevíme nové druhy, lepší materiály, a prozkoumáme neznámé hranice, když nám stroje pomohou.

This is my son Leo. On my quest for visual intelligence, I think of Leo constantly and the future world he will live in. When machines can see, doctors and nurses will have extra pairs of tireless eyes to help them to diagnose and take care of patients. Cars will run smarter and safer on the road. Robots, not just humans, will help us to brave the disaster zones to save the trapped and wounded. We will discover new species, better materials, and explore unseen frontiers with the help of the machines.

Postupně dáváme zrak strojům. Nejdřív je učíme vidět. Pak nám pomohou pomoci vidět lépe. Poprvé, lidské oči nebudou jediné, které zkoumají a objevují náš svět. Nebudeme stroje používat jenom kvůli jejich inteligenci, ale můžeme spolupracovat způsoby, které si ani neumíme představit.

Little by little, we're giving sight to the machines. First, we teach them to see. Then, they help us to see better. For the first time, human eyes won't be the only ones pondering and exploring our world. We will not only use the machines for their intelligence, we will also collaborate with them in ways that we cannot even imagine.

Toto je můj úkol: dát počítačům zrakovou inteligenci, a vytvořit tak lepší budoucnost pro Lea a svět.

This is my quest: to give computers visual intelligence and to create a better future for Leo and for the world.

Děkuji

Thank you.

(Potlesk)

(Applause)