Mark Zuckerberg, a journalist was asking him a question about the news feed. And the journalist was asking him, "Why is this so important?" And Zuckerberg said, "A squirrel dying in your front yard may be more relevant to your interests right now than people dying in Africa." And I want to talk about what a Web based on that idea of relevance might look like.

Mark Zuckerberg, een journalist stelde hem een vraag over de nieuwsfeed. De journalist vroeg hem, "Waarom is dit zo belangrijk?" Zuckerberg zei, "Een stervende eekhoorn in je voortuin is voor jou op dit moment soms meer relevant dan mensen die sterven in Afrika." Ik wil het hebben over hoe een Web gebaseerd op dat idee over relevantie eruit zou kunnen zien.

So when I was growing up in a really rural area in Maine, the Internet meant something very different to me. It meant a connection to the world. It meant something that would connect us all together. And I was sure that it was going to be great for democracy and for our society. But there's this shift in how information is flowing online, and it's invisible. And if we don't pay attention to it, it could be a real problem. So I first noticed this in a place I spend a lot of time -- my Facebook page. I'm progressive, politically -- big surprise -- but I've always gone out of my way to meet conservatives. I like hearing what they're thinking about; I like seeing what they link to; I like learning a thing or two. And so I was surprised when I noticed one day that the conservatives had disappeared from my Facebook feed. And what it turned out was going on was that Facebook was looking at which links I clicked on, and it was noticing that, actually, I was clicking more on my liberal friends' links than on my conservative friends' links. And without consulting me about it, it had edited them out. They disappeared.

Toen ik opgroeide in een zeer landelijk gebied in Maine, betekende het internet iets heel anders voor mij. Het betekende een verbinding met de wereld. Het betekende iets dat ons allemaal zou verbinden. Ik was ervan overtuigd dat het geweldig zou zijn voor de democratie en voor onze samenleving. Maar er is een verschuiving in de manier waarop informatie online stroomt en het is onzichtbaar. En als we niet opletten, kan het een echt probleem worden. Ik merkte het voor het eerst op in een plaats waar ik veel tijd besteed -- mijn Facebook-pagina. Ik ben progressief, politiek - grote verrassing - maar ik heb er altijd alles aan gedaan om ook conservatieven te ontmoeten. Ik wil horen waaraan ze denken; Ik wil zien waarnaar ze verwijzen; Ik leer graag een paar dingen bij. Dus was ik verrast toen ik op een dag merkte dat de conservatieven verdwenen waren uit mijn Facebookfeed. Wat er aan de hand bleek te zijn was dat Facebook bijhield op welke links ik klikte, en het merkte op dat ik meer op de links van mijn liberale vrienden klikte dan op die van mijn conservatieve vrienden. En zonder mij te raadplegen werden deze links gewist. Ze verdwenen.

So Facebook isn't the only place that's doing this kind of invisible, algorithmic editing of the Web. Google's doing it too. If I search for something, and you search for something, even right now at the very same time, we may get very different search results. Even if you're logged out, one engineer told me, there are 57 signals that Google looks at -- everything from what kind of computer you're on to what kind of browser you're using to where you're located -- that it uses to personally tailor your query results. Think about it for a second: there is no standard Google anymore. And you know, the funny thing about this is that it's hard to see. You can't see how different your search results are from anyone else's.

Facebook is niet de enige plek die dit soort onzichtbare, algoritmische bewerking doet op het Web. Google doet het ook. Als ik naar iets zoek en jij zoekt iets, zelfs nu, op precies hetzelfde moment, krijgen we waarschijnlijk heel andere resultaten. Zelfs als je uitgelogd bent, vertelde een ingenieur me, zijn er 57 signalen waar Google naar kijkt - alles van wat voor soort computer je op werkt tot welke browser je gebruikt tot de plaats waar je je bevindt - gebruikt het om persoonlijke zoekresultaten weer te geven. Denk er eens een moment over na: er is geen standaard Google meer. En weet je, het grappige hiervan is dat het moeilijk te zien is. Je kunt niet zien hoeveel jouw zoekresultaten verschillen van die van iemand anders.

But a couple of weeks ago, I asked a bunch of friends to Google "Egypt" and to send me screen shots of what they got. So here's my friend Scott's screen shot. And here's my friend Daniel's screen shot. When you put them side-by-side, you don't even have to read the links to see how different these two pages are. But when you do read the links, it's really quite remarkable. Daniel didn't get anything about the protests in Egypt at all in his first page of Google results. Scott's results were full of them. And this was the big story of the day at that time. That's how different these results are becoming.

Een paar weken geleden, vroeg ik een stel vrienden "Egypte" te googelen en mij screenshots te sturen van wat ze kregen. Dus hier is de screenshot van mijn vriend Scott. En hier die van mijn vriend Daniel. Als je ze naast elkaar zet, hoef je niet eens de links te lezen om te zien hoe verschillend deze twee pagina's zijn. Maar als je de links leest, is het echt heel opmerkelijk. Daniel kreeg helemaal niets over de protesten in Egypte in zijn eerste pagina met Google resultaten. Scotts resultaten stonden er vol van. En dit was het grote nieuws van de dag op dat moment. Dat is hoe verschillend de resultaten kunnen worden.

So it's not just Google and Facebook either. This is something that's sweeping the Web. There are a whole host of companies that are doing this kind of personalization. Yahoo News, the biggest news site on the Internet, is now personalized -- different people get different things. Huffington Post, the Washington Post, the New York Times -- all flirting with personalization in various ways. And this moves us very quickly toward a world in which the Internet is showing us what it thinks we want to see, but not necessarily what we need to see. As Eric Schmidt said, "It will be very hard for people to watch or consume something that has not in some sense been tailored for them."

Het is niet alleen Google of Facebook. Dit is iets dat rondgaat op het Web. Er zijn een hele reeks bedrijven die aan dit soort van personalisatie doen. Yahoo News, de grootste nieuwssite op het internet, is nu gepersonaliseerd - verschillende mensen krijgen verschillende dingen. Huffington Post, de Washington Post, de New York Times - allen flirten ze met personalisatie op verschillende manieren. En dit brengt ons zeer snel naar een wereld waarin het internet ons toont wat het denkt dat we willen zien, maar niet noodzakelijkerwijs wat we nodig hebben. Zoals Eric Schmidt zei, "Het zal heel moeilijk worden voor mensen om naar iets te kijken of te consumeren dat niet op een bepaalde manier op maat gemaakt is voor hen."

So I do think this is a problem. And I think, if you take all of these filters together, you take all these algorithms, you get what I call a filter bubble. And your filter bubble is your own personal, unique universe of information that you live in online. And what's in your filter bubble depends on who you are, and it depends on what you do. But the thing is that you don't decide what gets in. And more importantly, you don't actually see what gets edited out. So one of the problems with the filter bubble was discovered by some researchers at Netflix. And they were looking at the Netflix queues, and they noticed something kind of funny that a lot of us probably have noticed, which is there are some movies that just sort of zip right up and out to our houses. They enter the queue, they just zip right out. So "Iron Man" zips right out, and "Waiting for Superman" can wait for a really long time.

Ik denk dat dit een probleem is. En ik denk dat, als je al deze filters samenvoegt, al deze algoritmen, je iets krijgt wat ik een filterbubble noem. En je filterbubble is je eigen persoonlijke unieke universum aan informatie waarin je online leeft. En wat er in jouw filterbubble zit hangt af van wie je bent en wat je doet. Maar zelf kan je niet bepalen wat er in komt. En nog belangrijker, je ziet niet echt wat er eruit wordt geknipt. Een van de problemen van de filterbubble werd ontdekt door enkele onderzoekers bij Netflix. Ze keken naar de Netflix wachtrijen en ze merkten iets grappigs op dat velen van ons waarschijnlijk al opgemerkt hadden, dat er een aantal films zijn die gewoon opduiken en in onze huizen terecht komen. Ze komen in de wachtrij en ritsen er weer onmiddellijk uit. "Iron Man" ritst er onmiddellijk uit, en "Waiting for Superman" kan een hele lange tijd wachten.

What they discovered was that in our Netflix queues there's this epic struggle going on between our future aspirational selves and our more impulsive present selves. You know we all want to be someone who has watched "Rashomon," but right now we want to watch "Ace Ventura" for the fourth time. (Laughter) So the best editing gives us a bit of both. It gives us a little bit of Justin Bieber and a little bit of Afghanistan. It gives us some information vegetables; it gives us some information dessert. And the challenge with these kinds of algorithmic filters, these personalized filters, is that, because they're mainly looking at what you click on first, it can throw off that balance. And instead of a balanced information diet, you can end up surrounded by information junk food.

Wat ze ontdekten was dat in onze Netflix wachtrijen een epische strijd gaande is tussen ons toekomstige te bereiken zelf en ons meer impulsieve huidige zelf. We willen allemaal iemand zijn die "Rashomon" gezien heeft maar nu willen we voor de vierde keer naar "Ace Ventura" kijken. (Gelach) De beste editing geeft ons een beetje van beide. Het geeft ons een beetje Justin Bieber en een beetje Afghanistan. Het geeft ons wat informatie als groenten, het geeft ons wat informatie als dessert. En de uitdaging aan deze vormen van algoritmische filters, deze gepersonaliseerde filters, omdat ze vooral op zoek zijn naar waar je het eerst op klikt, is dat er geen evenwicht meer is. In plaats van een evenwichtig informatiedieet, eindig je omgeven door informatie junkfood.

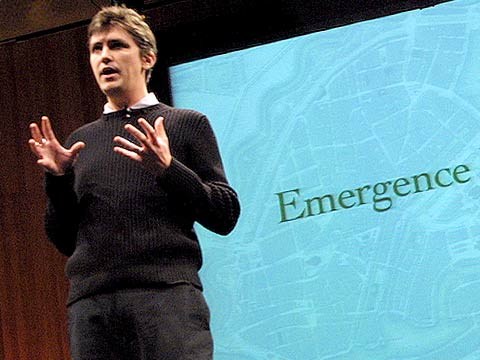

What this suggests is actually that we may have the story about the Internet wrong. In a broadcast society -- this is how the founding mythology goes -- in a broadcast society, there were these gatekeepers, the editors, and they controlled the flows of information. And along came the Internet and it swept them out of the way, and it allowed all of us to connect together, and it was awesome. But that's not actually what's happening right now. What we're seeing is more of a passing of the torch from human gatekeepers to algorithmic ones. And the thing is that the algorithms don't yet have the kind of embedded ethics that the editors did. So if algorithms are going to curate the world for us, if they're going to decide what we get to see and what we don't get to see, then we need to make sure that they're not just keyed to relevance. We need to make sure that they also show us things that are uncomfortable or challenging or important -- this is what TED does -- other points of view.

Wat dit suggereert is eigenlijk dat we het internetverhaal verkeerd hebben begrepen. In een televisie samenleving - is dit hoe de oprichters mythologie klinkt - In een televisie samenleving - waren er poortwachters, de redactie, en ze beheersten de stromen van informatie. Toen kwam het internet en veegde ze uit de weg, en liet ons toe met elkaar te verbinden, en het was geweldig. Maar dat is eigenlijk niet wat er nu gebeurt. Wat we zien is meer een doorgeven van de fakkel van menselijke poortwachters naar algoritmische. En deze algoritmes hebben nog niet de geïntegreerde ethiek dat de redactie had. Dus als algoritmes de wereld voor ons gaan indelen, als ze gaan beslissen wat we wel of niet te zien krijgen, dan moeten we ervoor zorgen dat ze niet alleen ingesteld zijn op relevantie. We moeten ervoor zorgen dat zij ons ook dingen laten zien die ongemakkelijk of uitdagend of belangrijk zijn - dit is wat TED doet - andere standpunten.

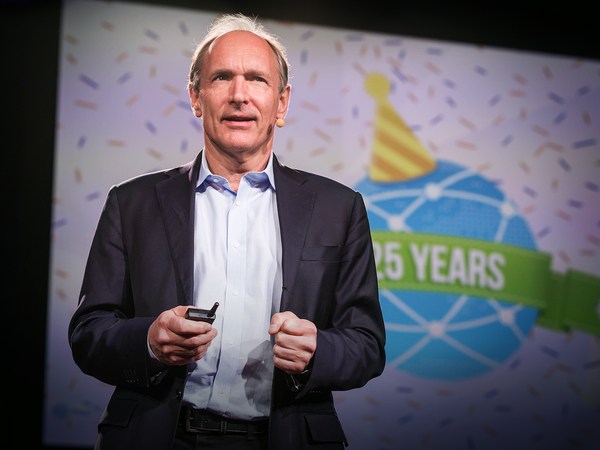

And the thing is, we've actually been here before as a society. In 1915, it's not like newspapers were sweating a lot about their civic responsibilities. Then people noticed that they were doing something really important. That, in fact, you couldn't have a functioning democracy if citizens didn't get a good flow of information, that the newspapers were critical because they were acting as the filter, and then journalistic ethics developed. It wasn't perfect, but it got us through the last century. And so now, we're kind of back in 1915 on the Web. And we need the new gatekeepers to encode that kind of responsibility into the code that they're writing.

We waren hier al eerder als samenleving. In 1915, het is niet alsof kranten veel zweet lieten over hun maatschappelijke verantwoordelijkheden. Dan viel het mensen op dat ze iets echt belangrijks deden. Dat je in feite geen functionerende democratie kon hebben als burgers geen goede doorstroming van informatie krijgen. Dat de kranten kritisch waren omdat zij functioneerden als filter, en dan ontwikkelde de journalistieke ethiek zich. Het was niet perfect, maar we kwamen er de vorige eeuw mee door. En dus nu, zijn we terug in 1915 op het web. De nieuwe poortwachters moeten dat soort van verantwoordelijkheid coderen in de code die ze schrijven.

I know that there are a lot of people here from Facebook and from Google -- Larry and Sergey -- people who have helped build the Web as it is, and I'm grateful for that. But we really need you to make sure that these algorithms have encoded in them a sense of the public life, a sense of civic responsibility. We need you to make sure that they're transparent enough that we can see what the rules are that determine what gets through our filters. And we need you to give us some control so that we can decide what gets through and what doesn't. Because I think we really need the Internet to be that thing that we all dreamed of it being. We need it to connect us all together. We need it to introduce us to new ideas and new people and different perspectives. And it's not going to do that if it leaves us all isolated in a Web of one.

Ik weet dat er hier een heleboel mensen zijn van Facebook en van Google - Larry en Sergey -- mensen die hebben geholpen het Web op te bouwen zoals het is, en ik ben er dankbaar voor. Maar het is nodig dat jullie ervoor zorgen dat in deze algoritmen een gevoel voor het openbare leven en maatschappelijke verantwoordelijkheid wordt gecodeerd. We hebben het nodig dat jullie ervoor zorgen dat ze transparant genoeg zijn dat we kunnen zien wat de regels zijn die bepalen wat er door onze filters komt. We hebben het nodig dat jullie ons enige controle geven, zodat we kunnen beslissen wat erdoor komt en wat niet. Omdat ik denk dat we het nodig hebben dat het internet dat wordt waar we allemaal van gedroomd hebben. We hebben het nodig om ons allemaal te verbinden. We hebben het nodig om ons nieuwe ideeën te introduceren en nieuwe mensen en verschillende perspectieven. Dat zal niet gebeuren als het ons isoleert in een Web van één.

Thank you.

Dank je wel

(Applause)

(Applaus)