Mark Zuckerberg, un periodista li feia una pregunta referent al "mur de notícies". El periodista li estava preguntant: "Per què és el "mur" tan important?" I Zuckerberg va dir, "Un esquirol morint davant de ta casa pot ser més rellevant per al teu interès en aquest moment que gent morint a l'Àfrica." I vull parlar sobre com seria una Web basada en eixa idea de rellevància.

Mark Zuckerberg, a journalist was asking him a question about the news feed. And the journalist was asking him, "Why is this so important?" And Zuckerberg said, "A squirrel dying in your front yard may be more relevant to your interests right now than people dying in Africa." And I want to talk about what a Web based on that idea of relevance might look like.

Quan estava creixent en una àrea rural a Maine, 'Internet' significava una cosa molt diferent per mi. Significava una connexió amb el món. Significava quelcom per connectar-nos a tots. I estava segur que anava a ser quelcom molt bo per a la democràcia i per a la nostra societat. Però ha aparegut aquest desplaçament respecte a com circula la informació a la xarxa, i que és invisible. I que si no hi estem atents podria ser un problema real. El primer lloc on em vaig adonar d'això va ser en un lloc on passe molt de temps -- la meva pàgina a Facebook. Sóc progressista, ideològicament -- gran sorpresa -- però sempre m'he preocupat per trobar-me amb conservadors. M'agrada escoltar de què parlem; m'agrada veure què enllancen; m'agrada aprendre coses d'ells. I per això em vaig sorprendre el dia que em vaig adonar que els conservadors havien desaparegut del meu mur de Facebook. I el què havia ocorregut era que Facebook estava controlant sobre quins enllaços feia clic, i estava descobrint que, de fet, feia més clics als enllaços dels meus amics progressistes que als enllaços dels meus amics conservadors. I sense preguntar-m'ho, els havia eliminat. Havien desaparegut.

So when I was growing up in a really rural area in Maine, the Internet meant something very different to me. It meant a connection to the world. It meant something that would connect us all together. And I was sure that it was going to be great for democracy and for our society. But there's this shift in how information is flowing online, and it's invisible. And if we don't pay attention to it, it could be a real problem. So I first noticed this in a place I spend a lot of time -- my Facebook page. I'm progressive, politically -- big surprise -- but I've always gone out of my way to meet conservatives. I like hearing what they're thinking about; I like seeing what they link to; I like learning a thing or two. And so I was surprised when I noticed one day that the conservatives had disappeared from my Facebook feed. And what it turned out was going on was that Facebook was looking at which links I clicked on, and it was noticing that, actually, I was clicking more on my liberal friends' links than on my conservative friends' links. And without consulting me about it, it had edited them out. They disappeared.

Però Facebook no és l'únic lloc que està fent aquesta mena d'edició algorítmica invisible de la Web. Google també ho està fent. Si jo cerque alguna cosa, i vosaltres cerqueu el mateix, fins i tot ara mateix, simultàniament, podríem obtenir resultats molt diferents. Fins i tot amb la sessió tancada, segons em va dir un enginyer, hi ha 57 senyals que Google té en compte -- des d'allò relacionat amb el tipus d'ordinador en el què esteu fins al tipus de navegador que utilitzeu o on esteu físicament -- i utilitza aquesta informació per confeccionar els resultats de la vostra cerca. Penseu-ho un moment: ja no hi ha un Google estàndar. I el pitjor d'això és que és complicat de veure. No podeu veure la diferència entre els vostres resultats i els de qualsevol altra persona.

So Facebook isn't the only place that's doing this kind of invisible, algorithmic editing of the Web. Google's doing it too. If I search for something, and you search for something, even right now at the very same time, we may get very different search results. Even if you're logged out, one engineer told me, there are 57 signals that Google looks at -- everything from what kind of computer you're on to what kind of browser you're using to where you're located -- that it uses to personally tailor your query results. Think about it for a second: there is no standard Google anymore. And you know, the funny thing about this is that it's hard to see. You can't see how different your search results are from anyone else's.

Però fa un parell de setmanes, els vaig demanar a un grapat d'amics que cercaren "Egipte" al Google i que m'enviaren en una captura de pantalla del què havien obtingut. Ací podeu veure la captura del meu amic Scott. I aci la del meu amic Daniel. Si les poseu una al costat de l'altra no cal ni que llegiu els enllaços per a observar com de diferents són ambdues pàgines. Però si llegiu els enllaços és realment molt gran la diferència. Daniel no va rebre res relatiu a les protestes d'Egipte en la primera pàgina de resultats de Google. Els resultats de Scott n'estaven plens. I aquesta era la història del dia en aquell moment. Així és com de diferents s'estan convertint aquestos resultats.

But a couple of weeks ago, I asked a bunch of friends to Google "Egypt" and to send me screen shots of what they got. So here's my friend Scott's screen shot. And here's my friend Daniel's screen shot. When you put them side-by-side, you don't even have to read the links to see how different these two pages are. But when you do read the links, it's really quite remarkable. Daniel didn't get anything about the protests in Egypt at all in his first page of Google results. Scott's results were full of them. And this was the big story of the day at that time. That's how different these results are becoming.

I tampoc passa només amb Google i Facebook. Açò és una cosa que està arrasant la web. Hi ha tot un munt d'empreses que estan fent aquest tipus de personalització. Yahoo News, la major web de notícies a Internet, és ara personalitzada -- diferents persones reben diferents notícies. Huffington Post, el Washington Post, el New York Times -- tots juguen amb la personalització d'alguna manera. I açó ens duu molt ràpidament cap a un mon en què Internet ens mostra el que creu que volem veure, però no necessàriament el que necessitem veure. Tal i com va dir Eric Schmidt, "Serà molt complicat per a la gent veure o consumir alguna cosa que no ha estat, d'alguna manera, preparat per a ells."

So it's not just Google and Facebook either. This is something that's sweeping the Web. There are a whole host of companies that are doing this kind of personalization. Yahoo News, the biggest news site on the Internet, is now personalized -- different people get different things. Huffington Post, the Washington Post, the New York Times -- all flirting with personalization in various ways. And this moves us very quickly toward a world in which the Internet is showing us what it thinks we want to see, but not necessarily what we need to see. As Eric Schmidt said, "It will be very hard for people to watch or consume something that has not in some sense been tailored for them."

I jo crec que açò és un problema. I pense que, si unim tots aquestos filtres, si agafem tots aquestos algoritmes, aconseguim el que jo anomene "bombolla de filtres". I la vostra "bombolla de filtres" és el vostre personal i únic univers d'informació en el què viviu en la xarxa. I el que hi ha en la vostra bombolla de filtres depén de qui sou, i depén de què feu. Però la cosa més important és que no decidiu que entra. I més important, no veieu què es queda fora. Un dels problemes de la bombolla de filtres va ser descobert per uns investigadors a Netflix. I quan estaven mirant les cues a Netflix, es van adonar d'una cosa graciosa que probablement molts ja havíem notat, i és que hi ha algunes pel·lícules que entren i de seguida ixen de les nostres cases. Entren a la cua, i ixen de seguida. Per exemple, "Iron Man" ix de seguida i "Esperant a Superman" pot estar esperant molt de temps.

So I do think this is a problem. And I think, if you take all of these filters together, you take all these algorithms, you get what I call a filter bubble. And your filter bubble is your own personal, unique universe of information that you live in online. And what's in your filter bubble depends on who you are, and it depends on what you do. But the thing is that you don't decide what gets in. And more importantly, you don't actually see what gets edited out. So one of the problems with the filter bubble was discovered by some researchers at Netflix. And they were looking at the Netflix queues, and they noticed something kind of funny that a lot of us probably have noticed, which is there are some movies that just sort of zip right up and out to our houses. They enter the queue, they just zip right out. So "Iron Man" zips right out, and "Waiting for Superman" can wait for a really long time.

El que han descobert és que a les cues de Netflix hi ha aquesta batalla èpica entre les nostres aspiracions futures i els nostres impulsos presents. Tots volem ser algú que ha vist "Rashomon", però ara mateix volem veure per quarta vegada "Ace Ventura". (Rises) La millor edició ens dóna una mica de cada. Ens dona un poc de Justin Bieber i una miqueta d'Afganistan. Ens dóna certa informació sobre verdures; ens dona també informació sobre les postres. I la part complicada d'aquest tipus de filtres algorítmics, d'aquestos filtres personalitzats, és que, degut a que principalment es fixen en què cliqueu primer, poden trencar aquest equilibri. I en lloc d'informació per a una dieta equilibrada, podeu acabar rodejats d'informació de menjar escombraria.

What they discovered was that in our Netflix queues there's this epic struggle going on between our future aspirational selves and our more impulsive present selves. You know we all want to be someone who has watched "Rashomon," but right now we want to watch "Ace Ventura" for the fourth time. (Laughter) So the best editing gives us a bit of both. It gives us a little bit of Justin Bieber and a little bit of Afghanistan. It gives us some information vegetables; it gives us some information dessert. And the challenge with these kinds of algorithmic filters, these personalized filters, is that, because they're mainly looking at what you click on first, it can throw off that balance. And instead of a balanced information diet, you can end up surrounded by information junk food.

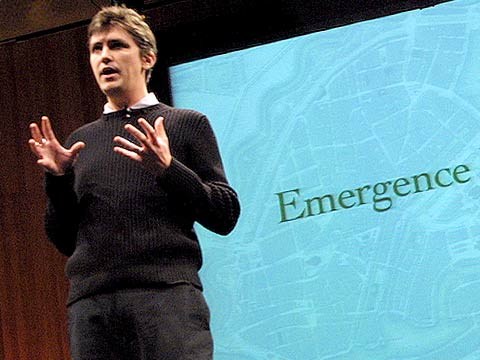

El que açò suggereix és que potser ens hem equivocat en la història sobre Internet. En una societat de la transmissió -- així és com es funda una mitologia -- en una societat de la transmissió, hi havia aquestos guardians, els editors, i ells controlaven els fluxes d'informació. I quan va arribar Internet i els va apartar, i ens va permetre connectar-nos junts, va ser increïble. Però no és el que està passant ara mateixa. El que estem veient és més una substitució dels guardians humans a guardians algorítmics. I el que passa és que els algorítmics encara no tenen integrats els conceptes ètics que si que tenien els editors. De manera que si els algoritmes van a administrar-nos el món, si van a decidir que anem a veure i què no, hem d'estar segurs que no són programats només per a la rellevància. Hem d'estar segurs que també ens mostren coses que són incòmodes o qüestionables o importants -- açò és el que fa TED -- altres punts de vista.

What this suggests is actually that we may have the story about the Internet wrong. In a broadcast society -- this is how the founding mythology goes -- in a broadcast society, there were these gatekeepers, the editors, and they controlled the flows of information. And along came the Internet and it swept them out of the way, and it allowed all of us to connect together, and it was awesome. But that's not actually what's happening right now. What we're seeing is more of a passing of the torch from human gatekeepers to algorithmic ones. And the thing is that the algorithms don't yet have the kind of embedded ethics that the editors did. So if algorithms are going to curate the world for us, if they're going to decide what we get to see and what we don't get to see, then we need to make sure that they're not just keyed to relevance. We need to make sure that they also show us things that are uncomfortable or challenging or important -- this is what TED does -- other points of view.

I, a més, resulta que ja hem estat ací com a societat. El 1915 els periòdics no estaven massa implicats amb les seues responsabilitats cíviques. Aleshores la gent es va adonar que feien una cosa realment important. Que, de fet, no podia existir una democràcia que funcionara si els ciutadans no rebien un bon fluxe d'informació, i que els periòdics eren crucials degut a que actuaven com a filtre, i l'ètica periodística es va desenvolupar. No era perfecte, però ens va acompanyar tot el segle passat. I ara, tornem a estar al 1915 a la xarxa. I necessitem els guardians amb aquesta responsabilitat dins del codi que estan escrivint.

And the thing is, we've actually been here before as a society. In 1915, it's not like newspapers were sweating a lot about their civic responsibilities. Then people noticed that they were doing something really important. That, in fact, you couldn't have a functioning democracy if citizens didn't get a good flow of information, that the newspapers were critical because they were acting as the filter, and then journalistic ethics developed. It wasn't perfect, but it got us through the last century. And so now, we're kind of back in 1915 on the Web. And we need the new gatekeepers to encode that kind of responsibility into the code that they're writing.

Sé que hi ha molta gent ací de Facebook i de Google -- Larry i Sergey -- gent que ha ajudat a construir la Web com és ara, i els estic agraït. Però realment necessitem assegurar-nos que aquests algoritmes contenen un sentit de la vida pública, un sentit de la reponsabilitat cívica. Necessitem que ens assegurem que són suficientment transparents que podem veure quines regles són les que determinen què passa a través dels filtres. I necessitem que ens doneu una mica de control per a que puguem decidir què passa i què no. Perquè crec que necessitem que Internet siga allò que tots hem somniat que siga. Necessitem connectar-nos tots junts. Necessitem que ens presente noves idees i nova gent i perspectives diferents. I açò no passarà si ens deixa sols en una web d'un.

I know that there are a lot of people here from Facebook and from Google -- Larry and Sergey -- people who have helped build the Web as it is, and I'm grateful for that. But we really need you to make sure that these algorithms have encoded in them a sense of the public life, a sense of civic responsibility. We need you to make sure that they're transparent enough that we can see what the rules are that determine what gets through our filters. And we need you to give us some control so that we can decide what gets through and what doesn't. Because I think we really need the Internet to be that thing that we all dreamed of it being. We need it to connect us all together. We need it to introduce us to new ideas and new people and different perspectives. And it's not going to do that if it leaves us all isolated in a Web of one.

Gràcies

Thank you.

(Aplaudiments)

(Applause)