I'm here today representing a team of artists and technologists and filmmakers that worked together on a remarkable film project for the last four years. And along the way they created a breakthrough in computer visualization.

저는 지난 4년간 한 경이로운 영화의 프로젝트를 함께 진행한 예술가와 기술자가 모인 팀을 대표하여 이 자리에 나왔습니다 그리고 그 과정에서 우리 팀은 컴퓨터 시각화(visualization)에서 진일보를 이루었습니다.

So I want to show you a clip of the film now. Hopefully it won't stutter. And if we did our jobs well, you won't know that we were even involved.

그 영화의 한 장면을 우선 보여드리죠. 제대로 보였으면 좋겠네요. 저희의 작업이 성공적이라면, 저희가 작업을 했다는 것 자체가 티가 안 나겠죠.

Voice (Video): I don't know how it's possible ... but you seem to have more hair.

영화: 어찌된 일인지 모르겠지만... 머리카락이 많아진 것 같아요.

Brad Pitt: What if I told you that I wasn't getting older ... but I was getting younger than everybody else?

벤자민 버튼: 만약에... 사실 나는 나이를 먹을 수록 늙어가는 게 아니라... 반대로 어려지고 있다고 한다면, 믿을 수 있겠어요?

I was born with some form of disease.

저는 태어날 무렵부터 어떤 질환을 갖고 태어났어요.

Voice: What kind of disease?

목소리: 어떤 질환이죠?

BP: I was born old.

버튼: 날 때부터 늙게 태어났죠.

Man: I'm sorry.

남자: 그것 참 안됐구려.

BP: No need to be. There's nothing wrong with old age.

버튼: 그렇게 느낄 것 없어요. 늙은 것이 죄는 아니니까

Girl: Are you sick?

소녀: 어디 아파요?

BP: I heard momma and Tizzy whisper, and they said I was gonna die soon. But ... maybe not.

버튼: 엄마와 팃지(Tizzy)가 속삭이는 걸 들었는데, 내가 곧 죽을 거라고 말하더라고. 그런데 ... 아닌 거 같아.

Girl: You're different than anybody I've ever met.

소녀: 할아버지는 여태까지 만나 본 사람들과는 달라요.

BB: There were many changes ... some you could see, some you couldn't. Hair started growing in all sorts of places, along with other things. I felt pretty good, considering.

버튼: 많은 변화가 있었다 어떤 건 눈에 띄고, 어떤 건 보이지 않았다. 몸의 온갖 곳에서 털이 자라나고 있었다. 털 이외에 다른 것도 자라났다. 참 기분이 좋았다, 왜냐하면...

Ed Ulbrich: That was a clip from "The Curious Case of Benjamin Button." Many of you, maybe you've seen it or you've heard of the story, but what you might not know is that for nearly the first hour of the film, the main character, Benjamin Button, who's played by Brad Pitt, is completely computer-generated from the neck up. Now, there's no use of prosthetic makeup or photography of Brad superimposed over another actor's body. We've created a completely digital human head.

Ed Ulbrich: 지금 보신 영상은 "벤자민 버튼의 시계는 거꾸로 간다"의 한 장면입니다. 많은 분들이 아마 이 영화를 보셨거나, 또는 그 줄거리를 이미 들으셨을 겁니다. 하지만, 이 영화의 처음 거의 한 시간은 브래드 피트가 분한 주인공 벤자민 버튼이 목 위로는 완전히 컴퓨터로 만들어낸 영상이었다는 사실은 아마 모르셨을 겁니다. 자, 다른 배우의 몸 위로 브래드 피트의 특수분장을 하거나 사진을 덧씌우는 작업을 한 건 아닙니다. 저희는 사람 얼굴을 온전히 디지털로 만들었습니다.

So I'd like to start with a little bit of history on the project. This is based on an F. Scott Fitzgerald short story. It's about a man who's born old and lives his life in reverse. Now, this movie has floated around Hollywood for well over half a century, and we first got involved with the project in the early '90s, with Ron Howard as the director. We took a lot of meetings and we seriously considered it. But at the time we had to throw in the towel. It was deemed impossible. It was beyond the technology of the day to depict a man aging backwards. The human form, in particular the human head, has been considered the Holy Grail of our industry.

그러면, 이 프로젝트의 진행과정에 대해서 설명을 하며 시작하겠습니다. 이 영화는 F. Scott Fitzgerald 의 단편 소설을 바탕으로 했습니다. 그 소설은 늙게 태어나서는, 점차 젊어지는 한 남자에 대한 이야기입니다. 이 시나리오는 50년이 넘게 헐리우드 내에서 떠돌고 있었고, 저희는 저희는 Ron Howard 를 감독으로 하여, 90년대 초반에 이 프로젝트에 참여하게 되었습니다. 여러 차례의 미팅을 가졌고, 심각하게 착수하는 것을 고려했습니다. 그렇지만, 결국은 포기하고 말았지요. 거의 불가능해 보였거든요. 그 당시의 기술로는, 사람이 거꾸로 나이를 먹어가는 걸 표현하는 게 불가능했어요. 인체의 표현은, 특히나 얼굴 부분은, 영화계에서는 성배 (the Holy Grail) 처럼 여겨져 왔지요.

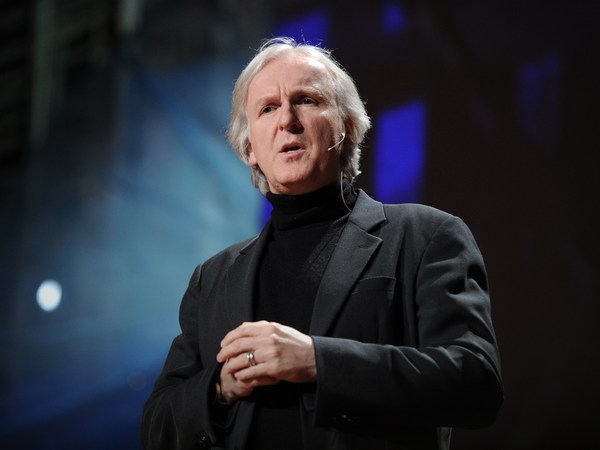

The project came back to us about a decade later, and this time with a director named David Fincher. Now, Fincher is an interesting guy. David is fearless of technology, and he is absolutely tenacious. And David won't take "no." And David believed, like we do in the visual effects industry, that anything is possible as long as you have enough time, resources and, of course, money. And so David had an interesting take on the film, and he threw a challenge at us. He wanted the main character of the film to be played from the cradle to the grave by one actor. It happened to be this guy.

이 프로젝트는 근 10년이 지난 후에, David Fincher 라는 감독과 함께 저희에게 다시 돌아왔지요. 이, Fincher 라는 감독은 참 재미있는 사람이에요. David (Fincher) 는 신기술을 사용하는 걸 무서워하지 않아요 그리고 대단한 끈기를 가진 사람이죠. '못하겠다'는 말을 용납하지 않죠. 그리고 우리 시각 효과 팀(visual effect) 사람들처럼, 시간, 자원 그리고 (가장 중요한) 돈만 있다면, 무엇이든 가능하다고 믿는 사람이죠. 이 Fincher 감독은 이 영화에 대한 재미있는 접근 방법을 취하여 우리에게 숙제를 던졌지요. 그는 이 영화의 주인공이 요람에서 무덤까지, 한 배우에 의해서 촬영이 되기를 원했죠. 바로 이 사람이 그 주인공이었죠

We went through a process of elimination and a process of discovery with David, and we ruled out, of course, swapping actors. That was one idea: that we would have different actors, and we would hand off from actor to actor.

우리는 David와 한 차례의 제거과정과 발굴 과정을 거쳤고, 당연하게도, 배우를 바꿔가며 촬영하는 것은 배제하기로 했습니다. 사실 그 것도 하나의 아이디어 였어요: 여러 명의 배우를 두고 한 배우에서 다른 배우로 전달하는 과정을 갖는 것.

We even ruled out the idea of using makeup. We realized that prosthetic makeup just wouldn't hold up, particularly in close-up. And makeup is an additive process. You have to build the face up. And David wanted to carve deeply into Brad's face to bring the aging to this character. He needed to be a very sympathetic character. So we decided to cast a series of little people that would play the different bodies of Benjamin at the different increments of his life and that we would in fact create a computer-generated version of Brad's head, aged to appear as Benjamin, and attach that to the body of the real actor. Sounded great.

심지어는 분장을 이용하는 아이디어도 배제 했지요. 특수분장이 결국은 이상하게 보일 것이라는 것을 깨달았거든요. 특히나 클로즈업 장면에서 말이죠. 그리고 분장은 덧대는 작업이에요. 얼굴 위로 살을 덧대게 되죠. 그렇지만 David 는 브래드 피트의 얼굴을 더 파내어서 이 캐릭터의 나이 든 모습을 표현하고자 했어요. 관객이 동화할 수 있는 캐릭터로 만들었어야만 했거든요. 그래서 우선 우리는 벤자민 버튼의 인생의 각기 다른 시기를 연기해 줄 '체구가 작은' 연기자들을 여러 명 섭외하기로 했습니다. 그리고 우리는 실제 벤자민 버튼처럼 보일 브래드 피트의 얼굴을 컴퓨터로 합성하여, 실제 배우의 몸 위에 얹기로 했지요. 아주 그럴 듯한 계획이죠.

Of course, this was the Holy Grail of our industry, and the fact that this guy is a global icon didn't help either, because I'm sure if any of you ever stand in line at the grocery store, you know -- we see his face constantly. So there really was no tolerable margin of error. There were two studios involved: Warner Brothers and Paramount. And they both believed this would make an amazing film, of course, but it was a very high-risk proposition. There was lots of money and reputations at stake. But we believed that we had a very solid methodology that might work ...

물론, 이러한 작업은 이 바닥에서 '성배'와 다름 없고, 브래드 피트가 전세계적으로 너무 유명하다는 것도 문제였어요. 왜냐하면, 아마 여러분들이 아무 가게에나 들러서 계산대 앞에 서 있기만 해도, 저 얼굴을 볼 수 있을만큼 익숙한 얼굴이에요. 그래서, 정말로 조금의 오차도 허용되지 않는 상황이었죠. 이 영화에는 두 개의 스튜디오가 참여했습니다. 워너 브라더스, 파라마운트 그리고 물론 양사 모두 이것이 대단한 영화가 될 것이라고 믿었습니다. 그렇지만 대단히 손실위험이 큰 계획이기도 했죠 정말 많은 부와 명예가 걸려 있는 모험이었죠. 그리고 우리는 매우 확실한 방법론을 확보했고, 통할 것이라 확신했습니다.

But despite our verbal assurances, they wanted some proof. And so, in 2004, they commissioned us to do a screen test of Benjamin. And we did it in about five weeks. But we used lots of cheats and shortcuts. We basically put something together to get through the meeting. I'll roll that for you now. This was the first test for Benjamin Button. And in here, you can see, that's a computer-generated head -- pretty good -- attached to the body of an actor. And it worked. And it gave the studio great relief. After many years of starts and stops on this project, and making that tough decision, they finally decided to greenlight the movie. And I can remember, actually, when I got the phone call to congratulate us, to say the movie was a go, I actually threw up. (Laughter) You know, this is some tough stuff.

우리의 그러한 설득에도 불구하고, 두 스튜디오는 눈에 보이는 확신을 요구했습니다. 결국 양 사는 2004년에 우리에게 벤자민의 스크린 테스트를 허락했습니다. 저희는 약 5주간에 걸쳐서 그 작업을 해내었습니다. 하지만 어느 정도의 요령과, 사기도 쳤지요. 기본적으로 일단 그 결과보고를 통과하기 위해서 모든 노력을 다 쏟은 겁니다. 여러분들게 보여드리겠습니다. 이게 벤자민 버튼의 첫번째 테스트였죠. 그리고 여기, 보시다시피, 컴퓨터로 만든 얼굴입니다. 상당히 괜찮죠. 연기자의 몸에 붙어서... 그리고 성공했습니다. 스튜디오를 안심할 수 있게 만들었죠. 몇 년간 이 프로젝트는 수 많은 착수와 중단을 겪고, 이 어려운 결정을 내리고 나서야, 우리에게 영화로 제작할 수 있는 허가가 떨어진겁니다. 전 아직도 "영화 촬영을 허락한다며, 축하한다"는 전화를 받았을 때를 기억합니다. 전 진짜로 토할 지경이었어요. (웃음) 아시다시피, 이건 정말 어려운 작업입니다.

So we started to have early team meetings, and we got everybody together, and it was really more like therapy in the beginning, convincing each other and reassuring each other that we could actually undertake this. We had to hold up an hour of a movie with a character. And it's not a special effects film; it has to be a man. We really felt like we were in a -- kind of a 12-step program. And of course, the first step is: admit you've got a problem. (Laughter) So we had a big problem: we didn't know how we were going to do this. But we did know one thing. Being from the visual effects industry, we, with David, believed that we now had enough time, enough resources, and, God, we hoped we had enough money. And we had enough passion to will the processes and technology into existence.

그래서 우리는 빨리 팀 회의를 소집하여, 모든 사람들을 불러모았습니다. 그 회의는 서로가 서로에게 안심을 시키며, 우리는 이 작업을 해낼 수 있다고 얼르는 테라피(therapy) 작업이나 마찬가지였죠. 우리는 가공의 캐릭터로 영화의 한시간 분량을 책임져야 했어요. 그리고 이건 단순한 특수효과가 아니라 사람을 만드는 작업이었죠. 우리는 마치 우리가 12단계 프로그램 (문제가 있는 사람들을 위한 도움 프로그램) 을 시작한 것 같더군요, 첫번째 스텝: 문제가 있음을 인정한다. 우리는 매우 큰 문제가 있었죠. 우리는 이걸 어떻게 해결할 수 있는지 조차 몰랐습니다. 그렇지만 적어도 한가지는 분명했어요. 시각효과 출신으로써, David 감독과 우리는 우리에게 충분한 시간, 충분한 자원, 그리고 .. 하느님 제발, 충분한 돈을 확보했다고 확신했습니다. 그리고 우리는 프로세스와 테크놀로지를 현실로 만들어낼 열정도 있었습니다.

So, when you're faced with something like that, of course you've got to break it down. You take the big problem and you break it down into smaller pieces and you start to attack that. So we had three main areas that we had to focus on. We needed to make Brad look a lot older -- needed to age him 45 years or so. And we also needed to make sure that we could take Brad's idiosyncrasies, his little tics, the little subtleties that make him who he is and have that translate through our process so that it appears in Benjamin on the screen.

우선 큰 문제에 봉착했을 때에는, 당연히 그걸 나누어야 합니다. 큰 문제를 가져다가, 작은 문제 조각들로 쪼개는 거죠. 그리고는 하나씩 해결하는 겁니다. 저희는 집중해야할 분야가 크게 세 가지가 있었습니다. 먼저 브래드피트를 지금보다 훨씬 늙게 만들었어야 했습니다. 약 45년은 더 늙게 만들었어야 했죠. 그러면서도 우리는 브래드의 얼굴의 작은 움직임, 브래드를 브래드이게 하는 미묘함 등 브래드 피트의 특징또한 살려내야 했습니다. 그렇게 살려낸 특징들이 우리의 프로세스를 통해서 영화속 벤자민 얼굴에 나타났어야 했죠.

And we also needed to create a character that could hold up under, really, all conditions. He needed to be able to walk in broad daylight, at nighttime, under candlelight, he had to hold an extreme close-up, he had to deliver dialogue, he had to be able to run, he had to be able to sweat, he had to be able to take a bath, to cry, he even had to throw up. Not all at the same time -- but he had to, you know, do all of those things.

그리고 우리는, 어떠한, 정말 모든 조건에서도 그럴듯하게 보이는 사람을 하나 만들었어야 했습니다. 그 사람은, 훤한 대낮에도 걸어다닐 수 있어야 하고, 밤에도, 촛불 아래에서도, 매우 클로즈업을 했을 때에도 그럴듯 해야했고, 대화를 나눌 수 있어야 하고, 뛸 수도 있어야 하며, 땀도 흘리고, 목욕도 하고, 울고, 심지어는 구토까지 할 수 있었어야 했습니다. 그 모든 게 동시에 일어나는 건 아니지만, 그래도 언급한 행동을 수행할 수 있어야 했죠.

And the work had to hold up for almost the first hour of the movie. We did about 325 shots. So we needed a system that would allow Benjamin to do everything a human being can do. And we realized that there was a giant chasm between the state of the art of technology in 2004 and where we needed it to be.

그리고 그 작업은 영화의 첫 한 시간 분량을 책임져야 했습니다. 우리는 325 샷 정도 촬영했습니다. 그래서 우리는 벤자민이 사람이 할 수 있는 건 다 할 수 있는 시스템을 필요로 했습니다. 그리고 우리는 2004년 현재의 최신 기술과, 우리가 이루어야 하는 것에는 큰 차이가 존재한다는 걸 깨달았습니다.

So we focused on motion capture. I'm sure many of you have seen motion capture. The state of the art at the time was something called marker-based motion capture. I'll give you an example here. It's basically the idea of, you wear a leotard, and they put some reflective markers on your body, and instead of using cameras, there're infrared sensors around a volume, and those infrared sensors track the three-dimensional position of those markers in real time. And then animators can take the data of the motion of those markers and apply them to a computer-generated character. You can see the computer characters on the right are having the same complex motion as the dancers.

그래서 우리는 모션캡쳐(motion capture) 기술에 관심을 가졌습니다. 아마 여기 계신분중에 많은 분들이 모션 캡쳐를 보신적이 있을겁니다. 당시의 최신 모션 캡쳐 기술은 마커 기반 모션 캡쳐라는 기술이었습니다. 여기에 그 예를 보여드리지요. 기본적인 동작은, 몸에 쫙 붙는 옷을 입은 다음, 반사하는 재질의 마커를 몸에 잔뜩 붙이는 겁니다. 그리고 일반 카메라를 쓰는 대신에 적외선 센서를 주변에 잔뜩 설치하고 그 센서들은 마커들을 실시간으로 3차원 공간내에서 추적하고 기록하는 겁니다. 그러면 애니메이터들은 그 마커들의 움직임을 데이터로 모아서, 컴퓨터로 만든 캐릭터에게 그 데이터를 적용합니다. 보시다시피, 우측에 있는 캐릭터가 실제 댄서의 움직임과 똑같은 복잡한 동작을 수행하고 있습니다.

But we also looked at numbers of other films at the time that were using facial marker tracking, and that's the idea of putting markers on the human face and doing the same process. And as you can see, it gives you a pretty crappy performance. That's not terribly compelling. And what we realized was that what we needed was the information that was going on between the markers. We needed the subtleties of the skin. We needed to see skin moving over muscle moving over bone. We needed creases and dimples and wrinkles and all of those things.

또한 저희는 그 당시의 다른 많은 영화에서 이용 중이던 얼굴 마커 트래킹 또한 살펴보았습니다. 얼굴 마커 트래킹은 좀 전의 모션 캡쳐기술을 사람의 얼굴에 붙이고 똑같은 작업을 수행하는 겁니다. 그리고 보시다시피, 매우 조잡스런 결과가 나오죠. 이런 방식은 통하지 않을 것 같았습니다. 그리고 우리는 우리에게 필요한 것이 그 마커들 사이에 존재하는 정보라는 것을 깨달았습니다. 피부에 드러나는 미묘함이 필요했죠. 우리는 뼈 위를 움직이는 근육, 또 근육위를 움직이는 피부가 필요했습니다. 주름, 보조개 등 그러한 것들을 표현해야 했습니다.

Our first revelation was to completely abort and walk away from the technology of the day, the status quo, the state of the art. So we aborted using motion capture. And we were now well out of our comfort zone, and in uncharted territory. So we were left with this idea that we ended up calling "technology stew." We started to look out in other fields. The idea was that we were going to find nuggets or gems of technology that come from other industries like medical imaging, the video game space, and re-appropriate them. And we had to create kind of a sauce. And the sauce was code in software that we'd written to allow these disparate pieces of technology to come together and work as one.

우리의 첫 발견은 당시의 최신, 표준이라 불리우는 기술로부터 빠져나와야 한다는 것을 깨달은 것입니다. 그래서 우리는 모션 캡쳐 작업을 중단했습니다 이제 우리는 쾌적지대(편안함을 느끼는 공간)를 벗어나, 미지의 세계로 들어갔습니다. 우리는 결국 "기술 스튜(찌개같은 음식)"라고 부르게 된 아이디어로 접근하게 됐습니다. 그래서 우리는 의료용기기 이미지 기술, 비디오 게임 등과 같은 영역에서 마치 보석을 발견하듯이 찾아낸 기술들을 우리의 상황에 적합하게 맞추어서 조합할 수 있을 거라는 기대를 가지고 다른 기술 영역들을 살펴보았습니다. 그리고 우리는 일종의 소스를 만들었습니다. 소스란 소프트웨어 코드로, 우리가 얻은 제각각의 기술 조각들을 하나로 묶어서 작동할 수 있도록 만들 수 있도록 만든 것을 소스라고 할 수 있겠습니다.

Initially, we came across some remarkable research done by a gentleman named Dr. Paul Ekman in the early '70s. He believed that he could, in fact, catalog the human face. And he came up with this idea of Facial Action Coding System, or FACS. He believed that there were 70 basic poses or shapes of the human face, and that those basic poses or shapes of the face can be combined to create infinite possibilities of everything the human face is capable of doing. And of course, these transcend age, race, culture, gender. So this became the foundation of our research as we went forward.

작업을 착수하고 나서, 우리는 폴 에크만(Paul Ekman) 박사가 70년대초에 진행한 매우 주목할만한 연구를 알게 되었습니다. 에크만 박사는 사람의 얼굴을 카탈로그처럼 기록할 수 있다고 주장했지요. 그리고 FACS( Facial Action Coding System, 얼굴 표정 기록 시스템) 이란 것을 만들었습니다. 에크만 박사는 사람의 얼굴에는 70가지의 기본적인 포즈 또는 형태가 있다고 믿었고, 그 기본적인 포즈나 형태를 조합하면, 사람의 얼굴이 표현할 수 있는 얼굴을 무한대에 가까운 종류로 만들어낼 수 있다고 생각했습니다. 물론, 그건 남녀노소, 인종에 무관하게 가능한 일이라는 거죠. 이 연구가 우리의 작업의 토대가 되었습니다.

And then we came across some remarkable technology called Contour. And here you can see a subject having phosphorus makeup stippled on her face. And now what we're looking at is really creating a surface capture as opposed to a marker capture. The subject stands in front of a computer array of cameras, and those cameras can, frame-by-frame, reconstruct the geometry of exactly what the subject's doing at the moment. So, effectively, you get 3D data in real time of the subject. And if you look in a comparison, on the left, we see what volumetric data gives us and on the right you see what markers give us. So, clearly, we were in a substantially better place for this. But these were the early days of this technology, and it wasn't really proven yet. We measure complexity and fidelity of data in terms of polygonal count. And so, on the left, we were seeing 100,000 polygons. We could go up into the millions of polygons. It seemed to be infinite.

그리곤 우리는 곧이어 Contour (윤곽) 이라고 불리우는 대단한 기술을 알게 되었습니다. 화면에는 지금 특수 분장을 한 여자배우의 모습을 보실 수 있습니다. 그리고 이것은 아까의 마커 캡춰보다 훨씬 상세한 표면 캡춰라는 걸 만들어낼 수 있습니다. 캡쳐의 대상이 되는 배우는 컴퓨터와 연결된 카메라들 앞에 서 있고, 해당 카메라들은 프레임단위로 대상을 잡아내어, 대상의 모습을 기하학적으로 재구성합니다. 결과적으로, 대상의 3D 데이터를 얻어낼 수 있는 겁니다. 한번 비교해서 보자면, 왼편에는 컨투어가 주는 정교한 입체데이터가 있고, 우측에는 마커 방식으로 얻은 결과를 보실 수 있습니다. 자, 이제 분명하게도, 효과를 얻기에 더 좋은 기술을 확보했죠. 하지만, 당시는 이 기술의 초창기였기 때문에, 아직 충분히 검증되지 않았죠. 그래서 우리는 모델의 폴리곤의 숫자를 바탕으로 복잡도와 품질을 측정했습니다. 그래서, 왼편의 영상은 10만개의 폴리곤을 갖고 있었습니다. 그리고 수백만개 이상의 폴리곤을 얻어낼 수도 있었죠. 거의 무한대에 가까운 가능성이었습니다

This was when we had our "Aha!" This was the breakthrough. This is when we're like, "OK, we're going to be OK, This is actually going to work." And the "Aha!" was, what if we could take Brad Pitt, and we could put Brad in this device, and use this Contour process, and we could stipple on this phosphorescent makeup and put him under the black lights, and we could, in fact, scan him in real time performing Ekman's FACS poses. Right? So, effectively, we ended up with a 3D database of everything Brad Pitt's face is capable of doing. (Laughter)

그 때, 우리는 "아 하!" 하는 느낌이었죠. 이건 완전히 새로운 발전이었습니다. 이제서야 우리는, "그래, 이거 괜찮겠다. 실제로 사용할 수 있겠어" 라고 생각했죠. 그리고 "아 하!" 하는 느낌이라는 것은, 브래드 피트를 데려다가 얼굴에 발광물질을 바르고 다른 빛은 차단한 어두운 암실에서 이 컨투어(Contour: 윤곽)라는 작업을 수행하면. 브래드 피트가 에크만(Ekman)의 FACS 포즈를 취하는 것을 실시간으로 잡아낼 수 있겠다. 라는 거였죠 그렇죠? 그래서 결과적으로 우리는 브래드 피트의 얼굴이 만들 수 있는 가능한 모든 것을 담은 3D 데이타베이스를 얻게 됩니다 (웃음)

From there, we actually carved up those faces into smaller pieces and components of his face. So we ended up with literally thousands and thousands and thousands of shapes, a complete database of all possibilities that his face is capable of doing.

그것을 시작으로, 우리는 그 얼굴들을 깎아내어, 더 작은 얼굴의 조각과 컴포넌트를 얻게 됩니다. 그래서 수 천개의 이러한 형태를 얻게 됩니다. 이 얼굴이 표현 가능한 모든 가능성 을 가진 완벽한 데이타베이스를 말이죠.

Now, that's great, except we had him at age 44. We need to put another 40 years on him at this point. We brought in Rick Baker, and Rick is one of the great makeup and special effects gurus of our industry. And we also brought in a gentleman named Kazu Tsuji, and Kazu Tsuji is one of the great photorealist sculptors of our time. And we commissioned them to make a maquette, or a bust, of Benjamin. So, in the spirit of "The Great Unveiling" -- I had to do this -- I had to unveil something. So this is Ben 80. We created three of these: there's Ben 80, there's Ben 70, there's Ben 60. And this really became the template for moving forward.

아주 대단하죠. 단지 브래드 피트가 44세라는 것만 빼면요. 우리는 브래드의 얼굴에 40년의 세월을 더 넣어야 했죠. 그래서 우리는 메이크업과 특수효과의 최고 전문가로 손꼽히는 Rick Baker 라는 분을 모셔왔습니다. 그리고 우리는 또한 Kazu Tsuji 라는 분도 모셔왔지요. Kazu Tsuji 는 이 시대 최고의 실물 조각가(sculptor) 입니다. 저희는 이들에게 벤자민의 모형 혹은 흉상 제작을 부탁하였습니다. "The Great Unveiling" 이란 주제에 맞추어 (이 회차 TED의 부제), 베일을 좀 벗겨야 겠습니다. 이것이 바로 80세의 벤자민입니다. 우리는 이런걸 세 가지 만들었습니다: 80세의 벤자민, 70세의 벤자민, 60세의 벤자민 그리고 이것이 향후 작업의 근간이 되었죠.

Now, this was made from a life cast of Brad. So, in fact, anatomically, it is correct. The eyes, the jaw, the teeth: everything is in perfect alignment with what the real guy has. We have these maquettes scanned into the computer at very high resolution -- enormous polygonal count. And so now we had three age increments of Benjamin in the computer.

이건 실제 브래드 피트의 본을 떠서 만들었습니다. 그래서, 실제로 해부학적으로, 정확한 모형을 얻었죠. 눈, 턱, 치아... 모든 것이 실제 인물과 완벽하게 맞추어져 있습니다. 그래서 우리는 이 모형을 매우 고해상도로 컴퓨터를 이용해 스캔했습니다. 어마어마한 숫자의 폴리곤을 이용했죠. 자 이제, 우리는 3단계의 나이 차이를 갖는 벤자민을 컴퓨터에 저장했습니다.

But we needed to get a database of him doing more than that. We went through this process, then, called retargeting. This is Brad doing one of the Ekman FACS poses. And here's the resulting data that comes from that, the model that comes from that. Retargeting is the process of transposing that data onto another model. And because the life cast, or the bust -- the maquette -- of Benjamin was made from Brad, we could transpose the data of Brad at 44 onto Brad at 87. So now, we had a 3D database of everything Brad Pitt's face can do at age 87, in his 70s and in his 60s.

그렇지만 정적인 모델이 아닌, 그 이상의 데이타 베이스가 필요했죠. 그래서 우리는 리타겟팅(retargeting)이라는 작업을 수행했습니다. 이건 브래드 피트가 에크만(Ekman) FACS 포즈를 취하는 모습입니다. 그 옆에는 브래드가 포즈를 취함으로써 얻게된 데이터가 보여지고 있습니다. 리타겟팅이라는 작업은 이 데이터를 다른 모델에 맵핑을 시키는 작업입니다 벤자민 버튼의 실물 본, 또는 흉상 - 또는 인형이 브래드 피트를 기반해서 만들어졌기 때문에, 44 세의 브래드 피트의 데이터를 87 세의 브래드에 입힐 수가 있었죠 그래서 이제, 우리는 87세, 70세, 그리고 60세 등 각 나이대의 브래드 피트가 할 수 있는 모든 표정의 3D 데이터베이스를 모았습니다.

Next we had to go into the shooting process. So while all that's going on, we're down in New Orleans and locations around the world. And we shot our body actors, and we shot them wearing blue hoods. So these are the gentleman who played Benjamin. And the blue hoods helped us with two things: one, we could easily erase their heads; and we also put tracking markers on their heads so we could recreate the camera motion and the lens optics from the set.

다음은 촬영 과정에 착수했습니다. 그리고 그것과 더불어, 우리는 뉴올리언즈 및 세계 각국을 돌아다녔습니다. 그리고 우리는 몸통 대역 배우들에게 파란 모자를 씌우고 촬영을 했습니다. 이 분이 작은 벤자민 역할을 맡은 분입니다 저 푸른 모자는 두 가지의 기능을 합니다. 먼저, 그 안의 얼굴을 쉽게 지울 수 있게 합니다. 그리고 그 얼굴 주변에 추적표시의 역할을 하게 되어 촬영 현장의 카메라 움직임과 렌즈의 광학 효과를 재현하여 낼 수 있죠.

But now we needed to get Brad's performance to drive our virtual Benjamin. And so we edited the footage that was shot on location with the rest of the cast and the body actors and about six months later we brought Brad onto a sound stage in Los Angeles and he watched on the screen. His job, then, was to become Benjamin. And so we looped the scenes. He watched again and again. We encouraged him to improvise. And he took Benjamin into interesting and unusual places that we didn't think he was going to go. We shot him with four HD cameras so we'd get multiple views of him and then David would choose the take of Brad being Benjamin that he thought best matched the footage with the rest of the cast.

이제부터는 브래드가 이 가상의 벤자민을 연기로 조정하는 겁니다. 그래서 우리는 몸통 대역 배우와 나머지 배우들을 함께 우선 촬영해서 필요한 장면을 얻어내고, 한 6개월쯤 지나서, 로스 엔젤레스에 위치한 음향 녹음실에 브래드를 데려왔습니다 그는 영화를 지켜봤고 그의 일은 진짜 벤자민이 되는 것이었습니다. 우리는 그 장면을 계속 반복하고, 브래드는 계속 그걸 반복시청하죠. 우리는 브래드에게 내키는 대로 연기를 하도록 요구했고 그 결과 브래드는 벤자민을 우리가 예상하지 못했던 흥미롭고 색다른 캐릭터로 이끌어 갔습니다. 우리는 브래드를 4 대의 HD 카메라로 촬영하여 다양한 각도의 브래드를 촬영했고, 감독인 데이비드는 나머지 배우들과 가장 잘 어우러지는 벤자민의 모습을 이끌어낸 브래드 피트의 모습을 골랐습니다.

From there we went into a process called image analysis. And so here, you can see again, the chosen take. And you are seeing, now, that data being transposed on to Ben 87. And so, what's interesting about this is we used something called image analysis, which is taking timings from different components of Benjamin's face. And so we could choose, say, his left eyebrow. And the software would tell us that, well, in frame 14 the left eyebrow begins to move from here to here, and it concludes moving in frame 32. And so we could choose numbers of positions on the face to pull that data from.

거기에서부터 우리는 이미지 분석(image analysis) 이라는 프로세스를 시작했습니다. 여기에, 그렇게 만들어진 장면이 나옵니다. 이건 데이터가 87세의 벤자민의 얼굴로 입혀지는 모습을 보고 계십니다. 여기서 참 재미있는 것은, 벤자민 얼굴의 각 부분에서 타이밍 정보를 받아들이는 이미지 분석이라는 기법을 사용했다는 겁니다. 우리가 벤자민의 왼쪽 눈썹을 선택하면, 이 소프트웨어는 우리에게 "프레임 14에서 선택된 왼쪽 눈썹이 여기에서 여기로 움직였고, 프레임 32에서 움직임을 멈추었다" 라고 알려주는 거죠 그래서 우리는 브래드의 얼굴에서 정보를 뽑아낼 곳들을 정해놓을 수 있게 됩니다.

And then, the sauce I talked about with our technology stew -- that secret sauce was, effectively, software that allowed us to match the performance footage of Brad in live action with our database of aged Benjamin, the FACS shapes that we had. On a frame-by-frame basis, we could actually reconstruct a 3D head that exactly matched the performance of Brad.

그리고 아까 기술 스튜의 소스라고 제가 말했던, 그 비밀의 소스란 브래드의 연기모습을 실시간으로 검색하여 우리가 가진 FACS 형태와 일치하는 정보를 DB 에서 찾아내주는 소프트웨어를 말하는 것이었습니다. 매 프레임마다, 우리는 브래드의 연기와 정확하게 일치하는 3D 얼굴 모형을 재구성 할 수가 있었지요.

So this was how the finished shot appeared in the film. And here you can see the body actor. And then this is what we called the "dead head," no reference to Jerry Garcia.

이것이 영화속의 완성 장면이지요. 여기 몸통 연기 배우를 보실 수 있습니다. 저희가 "죽은 얼굴" 이라고 부르는 것이죠. 제리 가르시아(grateful dead 음악가) 랑은 상관없고요.

And then here's the reconstructed performance now with the timings of the performance. And then, again, the final shot. It was a long process. (Applause)

그리고 이것이 실제 연기의 타이밍과 함께 얼굴이 재구성된 모습입니다. 그리고, 이것이 완성본입니다. 아주 긴 작업이었습니다. (박수)

The next section here, I'm going to just blast through this, because we could do a whole TEDTalk on the next several slides.

다음 섹션은, 빨리 빨리 진행하도록 하겠습니다. 앞으로 보실 슬라이드만으로도 TED 강연을 하나 더 할수도 있거든요.

We had to create a lighting system. So really, a big part of our processes was creating a lighting environment for every single location that Benjamin had to appear so that we could put Ben's head into any scene and it would exactly match the lighting that's on the other actors in the real world.

저희는 조명 시스템 또한 만들어야 했습니다. 조명 시스템의 가장 큰 작업은, 실제로 벤자민이 등장하는 모든 장소와 일치하는 조명 시스템을 만들어 내어서 벤자민의 만들어진 얼굴이 실제 세계에서 촬영한 다른 배우들이 받는 조명과 일치하도록 일치하게 만들어 주는 일이었습니다.

We also had to create an eye system. We found the old adage, you know, "The eyes are the window to the soul," absolutely true. So the key here was to keep everybody looking in Ben's eyes. And if you could feel the warmth, and feel the humanity, and feel his intent coming through the eyes, then we would succeed. So we had one person focused on the eye system for almost two full years.

눈동자 재연 시스템도 필요했습니다. 우리는 "눈은 마음을 보는 창이다" 라는 옛 말이 하나 틀리지 않다는 걸 알게 됐습니다. 이 작업에서 가장 중요한 건, 모든 이들이 벤자민의 눈을 보게 만드는 거였죠. 그래서 만약에 보는 사람으로 하여금, 벤자민의 따스함과, 인간미, 그리고 그의 눈동자로부터 보이는 의도를 알 수 있다면, 성공하는 거였습니다. 그래서 이 눈동자 시스템에만 한 명이 전담으로 2년간 붙어서 도맡았습니다.

We also had to create a mouth system. We worked from dental molds of Brad. We had to age the teeth over time.

입의 움직임에 관한 시스템 역시 구축해야했습니다. 우선 브래드의 치아 모형을 얻어 시작했습니다.. 그리고 치아가 시간에 따라 노화되게 했죠.

We also had to create an articulating tongue that allowed him to enunciate his words. There was a whole system written in software to articulate the tongue. We had one person devoted to the tongue for about nine months. He was very popular.

그리고 우리는 벤자민이 말을 할 때 또박또박 발음할 수 있하는 혀를 만들어야 했습니다. 그 혀를 소프트웨어로 구현하는 데만에도 커다란 시스템 하나가 투입되죠. 혀에는 한 명이 9개월간 전담으로 맡아서 일을 처리했습니다. 그 친구 인기가 참 좋았죠.

Skin displacement: another big deal. The skin had to be absolutely accurate. He's also in an old age home, he's in a nursing home around other old people, so he had to look exactly the same as the others. So, lots of work on skin deformation, you can see in some of these cases it works, in some cases it looks bad. This is a very, very, very early test in our process. So, effectively we created a digital puppet that Brad Pitt could operate with his own face. There were no animators necessary to come in and interpret behavior or enhance his performance.

피부 교체: 이것 역시 큰 작업이었습니다. 벤자민의 피부는 매우 정교하게 나와야 했습니다. 벤자민은 양로원, 요양원에서 다른 노인들과 함께 생활하고 있기 때문에, 다른 노인들과 똑같이 보여야만 했죠 그래서 피부에 많은 변형이 가해졌습니다. 보시다시피 어떤 경우에는 괜찮았고, 어떤 경우에는 결과가 안 좋았습니다. 저희 작업의 매우 매우 매우 초창기의 결과를 보고 계십니다. 그래서 결과적으로 우리는 브래드 피트가 그의 얼굴을 이용해서 조종이 가능한 디지털 꼭두각시 인형을 만든 겁니다. 브래드 피트의 행동을 분석하고 그의 연기를 개선시킬 애니메이터가 아예 필요 없는거죠.

There was something that we encountered, though, that we ended up calling "the digital Botox effect." So, as things went through this process, Fincher would always say, "It sandblasts the edges off of the performance." And thing our process and the technology couldn't do, is they couldn't understand intent, the intent of the actor. So it sees a smile as a smile. It doesn't recognize an ironic smile, or a happy smile, or a frustrated smile. So it did take humans to kind of push it one way or another.

그렇지만, 저희가 "디지털 보톡스 효과"라고 부르게 되는 난관에 부딪히게 되었습니다. 전체적인 제작과정을 거치면서 Fincher 감독은 "연기의 엣지가 가려져 버리는구만" 이라고 말하곤 했죠. 우리의 기술과 제작 시스템이 해낼 수 없었던 것은 연기를 하는 배우의 의도를 이해하는 것이었습니다. 웃음은 그냥 웃음으로 이해할 뿐 이게 진짜 행복한 미소인지, 썩소인지, 당황스런 미소인지 알수가 없다는 거죠. 그래서 이 시스템은 사람을 모 아니면 도 방식으로 해석하는 거였죠.

But we ended up calling the entire process and all the technology "emotion capture," as opposed to just motion capture. Take another look.

그렇지만, 우리는 우리의 기술들과 전체적인 시스템을 "모션(움직임) 캡쳐" 가 아닌 "이모션(감성 캡쳐)" 라고 부를 수 있게 되었습니다. 화면을 보시죠

Brad Pitt: Well, I heard momma and Tizzy whisper, and they said I was gonna die soon, but ... maybe not.

브래드 피트: 글세.. 엄마와 티지가 속삭이는 걸 들었는데 내가 곧 죽을 거라고 말하더라고 그런데... 아마 아닌 거 같아

EU: That's how to create a digital human in 18 minutes. (Applause)

여기까지가 18분 내에 설명하는 디지털 인간 만들기 였습니다. (박수)

A couple of quick factoids; it really took 155 people over two years, and we didn't even talk about 60 hairstyles and an all-digital haircut. But, that is Benjamin. Thank you.

재미난 사실 좀 알려드리자면 이 작업에는 2년간 총 155 명이 필요했습니다. 한 60개의 헤어스타일에 디지털 이발작업을 한 것도 아닌데 말입니다. 어쨌건, 그렇게 완성된 것이 바로 벤자민입니다. 감사합니다.