Many believe driving is an activity solely reserved for those who can see. A blind person driving a vehicle safely and independently was thought to be an impossible task, until now. Hello, my name is Dennis Hong, and we're bringing freedom and independence to the blind by building a vehicle for the visually impaired.

Muitos acreditam que dirigir é uma atividade reservada exclusivamente para aqueles que podem enxergar. Uma pessoa cega dirigindo um veículo de modo seguro e independente era tido como uma tarefa impossível, até agora. Olá, meu nome é Dennis Hong, e nós estamos trazendo liberdade e independência para os cegos através da criação de um veículo para os deficientes visuais.

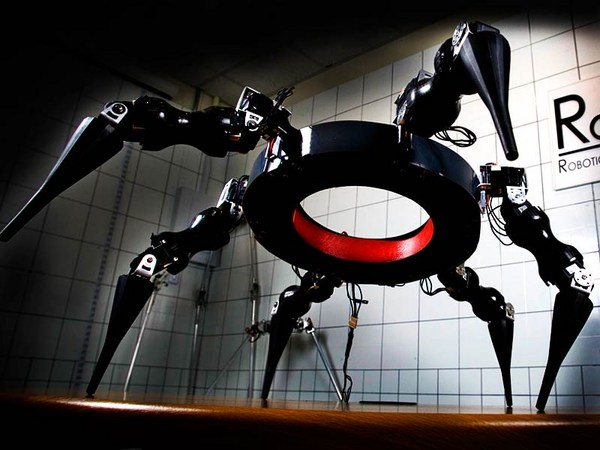

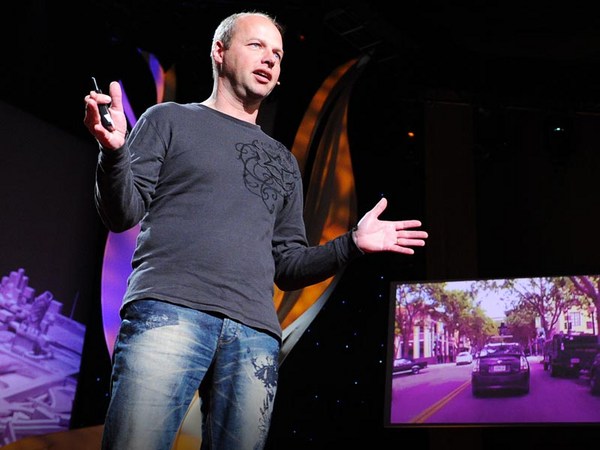

So before I talk about this car for the blind, let me briefly tell you about another project that I worked on called the DARPA Urban Challenge. Now this was about building a robotic car that can drive itself. You press start, nobody touches anything, and it can reach its destination fully autonomously. So in 2007, our team won half a million dollars by placing third place in this competition. So about that time, the National Federation of the Blind, or NFB, challenged the research committee about who can develop a car that lets a blind person drive safely and independently. We decided to give it a try, because we thought, "Hey, how hard could it be?" We have already an autonomous vehicle. We just put a blind person in it and we're done, right? (Laughter) We couldn't have been more wrong. What NFB wanted was not a vehicle that can drive a blind person around, but a vehicle where a blind person can make active decisions and drive. So we had to throw everything out the window and start from scratch.

Mas antes de falar sobre este carro para cegos, deixem-me rapidamente contar-lhes sobre outro projeto no qual trabalhei chamado 'O Desafio Urbano DARPA'. Pois bem, isto foi sobre a criação de um carro robótico que pode dirigir a si mesmo. Você aperta a ignição, ninguém encosta em nada, e ele pode chegar ao seu destino de modo totalmente autônomo. Então, em 2007, nosso grupo ganhou meio milhão de dólares ao ficar em terceiro lugar nesta competição. Então, naquela época, a Federação Nacional dos Cegos, ou NFB (sigla em inglês), desafiou o comitê de pesquisa sobre quem poderia desenvolver um carro que permitisse uma pessoa cega a dirigir segura e independentemente. Nós decidimos fazer uma tentativa, pois pensamos, ei, isso não deve ser tão difícil. Nós já temos um veículo autônomo. Nós apenas colocaremos um cego dentro dele e está pronto, correto? (Risos) Não poderíamos estar mais enganados. O que a NFB queria não era um veículo que poderia levar um cego por aí, mas um veículo no qual um cego pudesse tomar decisões ativas e dirigir. Então, tivemos que jogar tudo pela janela e começar do zero.

So to test this crazy idea, we developed a small dune buggy prototype vehicle to test the feasibility. And in the summer of 2009, we invited dozens of blind youth from all over the country and gave them a chance to take it for a spin. It was an absolutely amazing experience. But the problem with this car was it was designed to only be driven in a very controlled environment, in a flat, closed-off parking lot -- even the lanes defined by red traffic cones.

Então, para testar esta ideia maluca, desenvolvemos um pequeno buggy como protótipo para testar a viabilidade. E no verão de 2009, convidamos dúzias de jovens cegos de todo o país e lhes demos a chance de entrar nele e dar uma volta. Foi uma experiência absolutamente fantástica. Mas o problema com este carro era que ele foi projetado para ser guiado apenas em um ambiente muito específico, em um estacionamento plano e interditado -- e até mesmo com as guias definidas por cones vermelhos.

So with this success, we decided to take the next big step, to develop a real car that can be driven on real roads. So how does it work? Well, it's a rather complex system, but let me try to explain it, maybe simplify it. So we have three steps. We have perception, computation and non-visual interfaces. Now obviously the driver cannot see, so the system needs to perceive the environment and gather information for the driver. For that, we use an initial measurement unit. So it measures acceleration, angular acceleration -- like a human ear, inner ear. We fuse that information with a GPS unit to get an estimate of the location of the car. We also use two cameras to detect the lanes of the road. And we also use three laser range finders. The lasers scan the environment to detect obstacles -- a car approaching from the front, the back and also any obstacles that run into the roads, any obstacles around the vehicle.

Então, com este sucesso, decidimos assumir o próximo grande passo, desenvolver um carro de verdade, que pudesse ser guiado em estradas de verdade. Então, como que ele funciona? Bem, é um sistema algo complexo, mas deixem-me tentar explicá-lo, talvez simplificá-lo. Então, nós temos três passos. Nós temos a percepção, a computação e as interfaces não-visuais. Agora, obviamente que o motorista não pode enxergar, então, o sistema precisa perceber o ambiente e reunir a informação para o motorista. Para isso, usamos uma primeira unidade de medida. Ou seja, ele mede a aceleração, a aceleração angular -- como o ouvido humano, o ouvido interno. Nós fundimos essa informação com uma unidade de GPS para ter uma estimativa da localização do carro. Nós também usamos duas câmeras para detectar as faixas das estradas. E também usamos três telêmetros à laser. Estes lasers escaneiam o ambiente para detectarem obstáculos -- um carro se aproximando pela frente, por trás e ainda quaisquer obstáculos que apareçam na estrada, quaisquer obstáculos ao redor do veículo.

So all this vast amount of information is then fed into the computer, and the computer can do two things. One is, first of all, process this information to have an understanding of the environment -- these are the lanes of the road, there's the obstacles -- and convey this information to the driver. The system is also smart enough to figure out the safest way to operate the car. So we can also generate instructions on how to operate the controls of the vehicle. But the problem is this: How do we convey this information and instructions to a person who cannot see fast enough and accurate enough so he can drive? So for this, we developed many different types of non-visual user interface technology. So starting from a three-dimensional ping sound system, a vibrating vest, a click wheel with voice commands, a leg strip, even a shoe that applies pressure to the foot. But today we're going to talk about three of these non-visual user interfaces.

Então, toda esta grande quantidade de informação é introduzida em um computador, e o computador pode fazer duas coisas. Uma é, a primeira delas, processar esta informação para ter um entendimento do ambiente -- essas são as faixas da estrada, existem os obstáculos -- e levar esta informação para o motorista. O sistema ainda é inteligente o bastante para calcular o modo mais seguro de conduzir o carro. Então, nós podemos também gerar instruções sobre como operar os controles do veículo. Mas o problema é este: Como é que nós levaremos estas informações e instruções para uma pessoa que não pode enxergar rápida e acuradamente o bastante para que ele possa dirigir? Então, para isto, nós desenvolvemos vários e diferentes tipos de tecnologias não-visuais de interface com o usuário. Então, começando por um sistema de alarme sonoro tridimensional, uma roupa que vibra, um botão de comando acionado por voz, uma alça para a perna, até mesmo um calçado que faz pressão sobre os pés. Mas hoje falaremos sobre três destas interfaces não-visuais para o usuário.

Now the first interface is called a DriveGrip. So these are a pair of gloves, and it has vibrating elements on the knuckle part so you can convey instructions about how to steer -- the direction and the intensity. Another device is called SpeedStrip. So this is a chair -- as a matter of fact, it's actually a massage chair. We gut it out, and we rearrange the vibrating elements in different patterns, and we actuate them to convey information about the speed, and also instructions how to use the gas and the brake pedal. So over here, you can see how the computer understands the environment, and because you cannot see the vibration, we actually put red LED's on the driver so that you can see what's happening. This is the sensory data, and that data is transferred to the devices through the computer.

Agora, a primeira interface é chamada de DriveGrip. Então, tem-se um par de luvas, e elas possuem elementos vibratórios junto às articulações, assim, você pode transmitir instruções sobre como conduzir -- a direção e a intensidade. Um outro aparelho é chamado de SpeedStrip. Então, este é um assento -- para falar a verdade, é uma cadeira de massagem. Nós a desmontamos e reposicionamos os elementos vibratórios em diferentes padrões. E os reprogramamos para transmitir informação sobre velocidade, e também informações sobre como usar o acelerador e o freio. Então, aqui, vocês podem ver como o computador entende o ambiente. E como vocês não podem ver a vibração, instalamos, neste caso, LED's nas luvas, assim pode-se ver exatamente o que está acontecendo. Estes são os dados sensoriais, e esses dados são transferidos para os aparelhos através do computador.

So these two devices, DriveGrip and SpeedStrip, are very effective. But the problem is these are instructional cue devices. So this is not really freedom, right? The computer tells you how to drive -- turn left, turn right, speed up, stop. We call this the "backseat-driver problem." So we're moving away from the instructional cue devices, and we're now focusing more on the informational devices. A good example for this informational non-visual user interface is called AirPix. So think of it as a monitor for the blind. So it's a small tablet, has many holes in it, and compressed air comes out, so it can actually draw images. So even though you are blind, you can put your hand over it, you can see the lanes of the road and obstacles. Actually, you can also change the frequency of the air coming out and possibly the temperature. So it's actually a multi-dimensional user interface. So here you can see the left camera, the right camera from the vehicle and how the computer interprets that and sends that information to the AirPix. For this, we're showing a simulator, a blind person driving using the AirPix. This simulator was also very useful for training the blind drivers and also quickly testing different types of ideas for different types of non-visual user interfaces. So basically that's how it works.

Então, estes dois aparelhos, o DriveGrip e o SpeedStrip, são bem eficientes. Mas o problema é estes são aparelhos de sinais instrutivos. Assim, isto não é realmente liberdade, correto? O computador diz a você como dirigir -- vire à esquerda, vire à direita, acelere, pare. Nós chamamos isto de ' o problema do motorista do banco traseiro'. Então, estamos nos afastando dos aparelhos de dicas instrucionais e estamos nos concentrando mais em aparelhos que fornecem informações. Um bom exemplo deste tipo de interface informativa não-visual é chamado de AirPix. Pense nele como uma tela para cegos. Ou seja, ele é uma pequena prancha que tem vários furos pelos quais sai ar comprimido, assim, ele pode, na verdade, delinear imagens. Então, mesmo que você seja cego, você pode colocar sua mão sobre ele, você pode ver as faixas da estrada e os obstáculos. Na verdade, você pode mudar também a frequência do ar que sai e possivelmente a temperatura. Então, ele é, na verdade, uma interface de usuário multi-dimensional. Pois bem, aqui vocês podem ver a câmera esquerda e direita do veículo e como o computador interpreta isso e envia essa informação para o AirPix. Para isto, estamos mostrando um simulador, uma pessoa cega dirigindo usando o AirPix. Este simulador foi também muito útil para o treinamento dos motoristas cegos e para também testar rapidamente diferentes tipos de ideias para diferentes tipos de interfaces não-visuais com o usuário. Então, basicamente é assim que ele funciona.

So just a month ago, on January 29th, we unveiled this vehicle for the very first time to the public at the world-famous Daytona International Speedway during the Rolex 24 racing event. We also had some surprises. Let's take a look.

Cerca de um mês atrás, em 29 de janeiro, nós divulgamos este veículo pela primeira vez junto ao público, na mundialmente famosa corrida Internacional de Daytona, durante o evento da corrida 'Rolex 24'. Nós também tivemos algumas surpresas. Vamos dar uma olhada.

(Music)

(Música)

(Video) Announcer: This is an historic day in January. He's coming up to the grandstand, fellow Federationists.

(Vídeo) Locutor: Este é um dia histórico [inaudível]. Ele se aproxima da tribuna, companheiros Federistas.

(Cheering)

(Aclamação)

(Honking)

(Buzinando)

There's the grandstand now. And he's [unclear] following that van that's out in front of him. Well there comes the first box. Now let's see if Mark avoids it. He does. He passes it on the right. Third box is out. The fourth box is out. And he's perfectly making his way between the two. He's closing in on the van to make the moving pass. Well this is what it's all about, this kind of dynamic display of audacity and ingenuity. He's approaching the end of the run, makes his way between the barrels that are set up there.

Eis a tribuna agora. E ele está [inaudível] seguindo aquela van logo à sua frente. Bem, lá vai a primeira caixa. Agora, vejamos se Mark desviará dela. Ele desvia. Ele a ultrapassa pela direita. A terceira caixa foi lançada. A quarta caixa foi lançada. E ele está percorrendo perfeitamente seu caminho entre as duas. Ele está se aproximando da van para fazer a ultrapassagem. Bem, é sobre isto que é tudo, este tipo de exibição de audácia e engenhosidade. Ele está se aproximando do final da volta, traça seu caminho entre os barris que foram colocados lá.

(Honking)

(Buzinando)

(Applause)

(Aplausos)

Dennis Hong: I'm so happy for you. Mark's going to give me a ride back to the hotel.

Dennis Hong: Eu estou muito feliz por você. O Mark me dará uma carona de volta para o hotel.

Mark Riccobono: Yes.

Mark Riccobono: Vou sim.

(Applause)

(Aplausos)

DH: So since we started this project, we've been getting hundreds of letters, emails, phone calls from people from all around the world. Letters thanking us, but sometimes you also get funny letters like this one: "Now I understand why there is Braille on a drive-up ATM machine." (Laughter) But sometimes -- (Laughter) But sometimes I also do get -- I wouldn't call it hate mail -- but letters of really strong concern: "Dr. Hong, are you insane, trying to put blind people on the road? You must be out of your mind." But this vehicle is a prototype vehicle, and it's not going to be on the road until it's proven as safe as, or safer than, today's vehicle. And I truly believe that this can happen.

DH: Então, desde que iniciamos este projeto, temos recebido centenas de cartas, emails, telefonemas de pessoas do mundo todo. Cartas nos agradecendo, mas algumas vêzes você também recebe cartas engraçadas como esta: "Agora eu entendo porque tem Braille nas guias dos caixas eletrônicos." (Risos) Mas de vez em quando -- (Risos) Mas de vez em quando eu também recebo -- Eu não a chamaria de odiosa correspondência -- mas cartas com uma preocupação realmente forte: "Dr. Hong, você é louco, tentando colocar pessoas cegas na estrada? Você deve estar fora do seu juízo." Mas este veículo é um veículo-protótipo, e ele não estará nas ruas até que se prove tão seguro, ou mais seguro do que os veículos atuais. E eu realmente acredito que isto pode acontecer.

But still, will the society, would they accept such a radical idea? How are we going to handle insurance? How are we going to issue driver's licenses? There's many of these different kinds of hurdles besides technology challenges that we need to address before this becomes a reality. Of course, the main goal of this project is to develop a car for the blind. But potentially more important than this is the tremendous value of the spin-off technology that can come from this project. The sensors that are used can see through the dark, the fog and rain. And together with this new type of interfaces, we can use these technologies and apply them to safer cars for sighted people. Or for the blind, everyday home appliances -- in the educational setting, in the office setting. Just imagine, in a classroom a teacher writes on the blackboard and a blind student can see what's written and read using these non-visual interfaces. This is priceless. So today, the things I've showed you today, is just the beginning.

Mas ainda assim, a sociedade irá, (a sociedade) aceitaria uma ideia tão radical? Como que manejaríamos o seguro? Como emitiríamos as carteiras de motoristas? Exsitem muitos destes diferentes tipos de obstáculos, além dos desafios tecnológicos que precisamos avaliar antes disto tornar-se uma realidade. É claro, o principal objetivo deste projeto é desenvolver um carro para os cegos. Mas potencialmente mais importante do que isto é o tremendo valor da tecnologia derivada que pode vir deste projeto. Os sensores que são usados podem "enxergar" na escuridão, sob neblina e na chuva. E junto com este novo tipo de interface, nós podemos usar estas tecnologias e aplicá-las em carros mais seguros para pessoas que enxergam. Ou para os cegos, nas atividades domésticas cotidianas -- no cenário educacional, no ambiente do escritório. Imagine apenas, numa sala de aula um professor escreve no quadro-negro e um estudante cego pode ver o que está escrito e ler usando estas interfaces não-visuais. Isto não tem preço. Então hoje, as coisas que mostrei-lhes hoje, são apenas o começo.

Thank you very much.

Muito obrigado.

(Applause)

(Aplausos)