Many believe driving is an activity solely reserved for those who can see. A blind person driving a vehicle safely and independently was thought to be an impossible task, until now. Hello, my name is Dennis Hong, and we're bringing freedom and independence to the blind by building a vehicle for the visually impaired.

Muchos piensan que conducir es una actividad reservada exclusivamente para los que pueden ver. Que un ciego manejara un vehículo con seguridad y con independencia era considerado imposible, hasta ahora. Hola, mi nombre es Dennis Hong y le estamos trayendo libertad e independencia a los ciegos con un vehículo para discapacitados visuales.

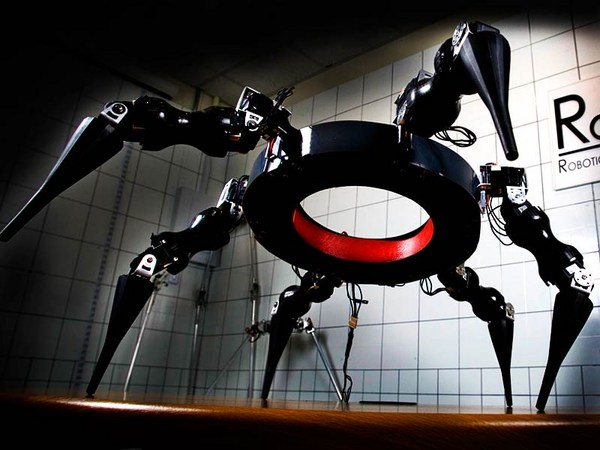

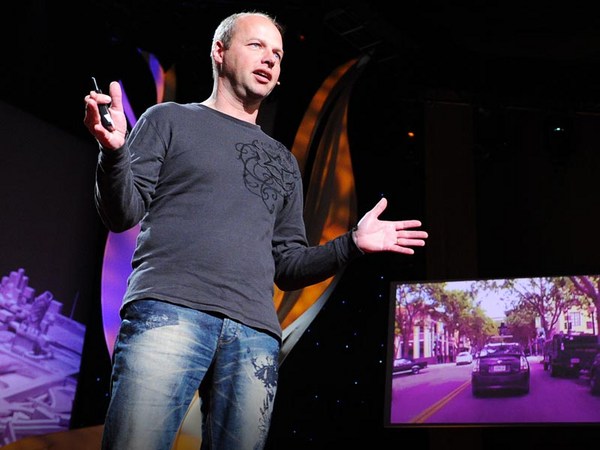

So before I talk about this car for the blind, let me briefly tell you about another project that I worked on called the DARPA Urban Challenge. Now this was about building a robotic car that can drive itself. You press start, nobody touches anything, and it can reach its destination fully autonomously. So in 2007, our team won half a million dollars by placing third place in this competition. So about that time, the National Federation of the Blind, or NFB, challenged the research committee about who can develop a car that lets a blind person drive safely and independently. We decided to give it a try, because we thought, "Hey, how hard could it be?" We have already an autonomous vehicle. We just put a blind person in it and we're done, right? (Laughter) We couldn't have been more wrong. What NFB wanted was not a vehicle that can drive a blind person around, but a vehicle where a blind person can make active decisions and drive. So we had to throw everything out the window and start from scratch.

Pero antes de hablar de esto, permítanme referirme a otro proyecto en el que estuve trabajando llamado Desafío Urbano DARPA. Era para hacer un auto robótico que se maneja por sí mismo. Se oprime el botón de encendido, nadie toca nada, y llega a su destino de manera totalmente autónoma. En 2007, nuestro grupo se ganó un millón de dólares por el tercer puesto en esta competencia. Por ese tiempo, la Federación Nacional de Ciegos, NFB, propuso un reto al comité de investigación, para quien desarrollara un automóvil que un ciego pudiera manejar con seguridad e independencia. Decidimos intentarlo, pensando: "¿Qué tan difícil puede ser?" Ya teníamos un vehículo autónomo. Sólo se pone ahí un ciego, y ¡listo! ¿no? (Risas) No podíamos estar más equivocados. Lo que quería la NFB no era un vehículo que pudiera llevar a un ciego a cualquier parte, sino uno en el que un ciego pudiera tomar sus propias decisiones, y conducirlo. Así que tuvimos que arrojar todo por la ventana y empezar todo de nuevo.

So to test this crazy idea, we developed a small dune buggy prototype vehicle to test the feasibility. And in the summer of 2009, we invited dozens of blind youth from all over the country and gave them a chance to take it for a spin. It was an absolutely amazing experience. But the problem with this car was it was designed to only be driven in a very controlled environment, in a flat, closed-off parking lot -- even the lanes defined by red traffic cones.

Para ensayar esta loca idea, desarrollamos un prototipo de carrito para arena y así probar la factibilidad. En el verano de 2009, invitamos a docenas de jóvenes ciegos de todas partes del país y los dejamos dar una vuelta con ese prototipo. Fue una experiencia maravillosa. Pero el problema con este modelo, era que fue diseñado sólo para un ambiente controlado, en un espacio cerrado, hasta con calzadas definidas con conos de tráfico.

So with this success, we decided to take the next big step, to develop a real car that can be driven on real roads. So how does it work? Well, it's a rather complex system, but let me try to explain it, maybe simplify it. So we have three steps. We have perception, computation and non-visual interfaces. Now obviously the driver cannot see, so the system needs to perceive the environment and gather information for the driver. For that, we use an initial measurement unit. So it measures acceleration, angular acceleration -- like a human ear, inner ear. We fuse that information with a GPS unit to get an estimate of the location of the car. We also use two cameras to detect the lanes of the road. And we also use three laser range finders. The lasers scan the environment to detect obstacles -- a car approaching from the front, the back and also any obstacles that run into the roads, any obstacles around the vehicle.

Con este logro, decidimos dar el siguiente paso y desarrollar un coche de verdad que pudiera ser conducido por carreteras de verdad. Y ¿cómo funciona? Bueno, es un sistema bastante complejo, pero voy a tratar de explicarlo de manera simple. Tenemos tres etapas: percepción, computación e interfaces no visuales Obviamente, como el conductor no puede ver, el sistema tiene que percibir el ambiente y transmitirle la información. Para eso usamos una unidad inicial que mide la aceleración, la aceleración angular, igual que el oído humano, el oído interno. Esa información se combina con la del GPS para calcular la localización del auto. Se usan también dos cámaras para detectar las líneas del pavimento. Y también tres medidores de distancia láser; con los que se examina el ambiente en busca de obstáculos: otro coche que se aproxima de frente o por detrás, o posibles obstáculos que aparecen en el camino; cualquier inconveniente en los alrededores del auto.

So all this vast amount of information is then fed into the computer, and the computer can do two things. One is, first of all, process this information to have an understanding of the environment -- these are the lanes of the road, there's the obstacles -- and convey this information to the driver. The system is also smart enough to figure out the safest way to operate the car. So we can also generate instructions on how to operate the controls of the vehicle. But the problem is this: How do we convey this information and instructions to a person who cannot see fast enough and accurate enough so he can drive? So for this, we developed many different types of non-visual user interface technology. So starting from a three-dimensional ping sound system, a vibrating vest, a click wheel with voice commands, a leg strip, even a shoe that applies pressure to the foot. But today we're going to talk about three of these non-visual user interfaces.

Toda esta cantidad de información se lleva al computador que puede hacer dos cosas. La primera es, ante todo, procesar la información para entender el ambiente; dónde están las líneas del camino, dónde hay obstáculos, y transmitirla al conductor. El sistema es suficientemente inteligente como para definir cuál es la forma más segura de manejar. Así que también puede generar instrucciones para operar los controles. El problema es: ¿Cómo se puede transmitir esta información y estas instrucciones a una persona que no puede ver con suficiente precisión y rapidez, para que pueda conducir? Para esto diseñamos varias interfaces diferentes de tecnología no visual. Comenzando con un sistema de sonido tridimensional de campanas, un chaleco vibrador, una rueda con comando por voz, una cinta para la pierna y hasta un zapato que aplica presión al pie. Hoy vamos a hablar de tres de estas interfaces no visuales.

Now the first interface is called a DriveGrip. So these are a pair of gloves, and it has vibrating elements on the knuckle part so you can convey instructions about how to steer -- the direction and the intensity. Another device is called SpeedStrip. So this is a chair -- as a matter of fact, it's actually a massage chair. We gut it out, and we rearrange the vibrating elements in different patterns, and we actuate them to convey information about the speed, and also instructions how to use the gas and the brake pedal. So over here, you can see how the computer understands the environment, and because you cannot see the vibration, we actually put red LED's on the driver so that you can see what's happening. This is the sensory data, and that data is transferred to the devices through the computer.

La primera se llama DriveGrip («control de conducción»). Son un par de guantes, con elementos vibradores en la sección de los nudillos, que transmiten información sobre el control de la dirección y su intensidad. Otro dispositivo es la llamada SpeedStrip («cinta de velocidad»). Es un sillón; un sillón para masajes. Lo abrimos y acondicionamos los elementos vibradores. Hicimos que transmitieran información sobre la velocidad así como instrucciones sobre el manejo del acelerador y el freno. Aquí se puede ver cómo es que el computador comprende el ambiente. Y como no se puede ver la vibración, pusimos LEDs sobre el conductor, para ver lo que está pasando. Estos son los datos sensoriales que se transfieren a los aparatos a través del computador.

So these two devices, DriveGrip and SpeedStrip, are very effective. But the problem is these are instructional cue devices. So this is not really freedom, right? The computer tells you how to drive -- turn left, turn right, speed up, stop. We call this the "backseat-driver problem." So we're moving away from the instructional cue devices, and we're now focusing more on the informational devices. A good example for this informational non-visual user interface is called AirPix. So think of it as a monitor for the blind. So it's a small tablet, has many holes in it, and compressed air comes out, so it can actually draw images. So even though you are blind, you can put your hand over it, you can see the lanes of the road and obstacles. Actually, you can also change the frequency of the air coming out and possibly the temperature. So it's actually a multi-dimensional user interface. So here you can see the left camera, the right camera from the vehicle and how the computer interprets that and sends that information to the AirPix. For this, we're showing a simulator, a blind person driving using the AirPix. This simulator was also very useful for training the blind drivers and also quickly testing different types of ideas for different types of non-visual user interfaces. So basically that's how it works.

Los dos dispositivos, el control de conducción y la cinta de velocidad, son muy efectivos. Pero el problema es que se trata de dispositivos de localización. Y esto no da total libertad, ¿no? El computador te dice cómo conducir; gire a la izquierda, a la derecha, acelere o frene. A esto lo llamamos el problema del pasajero que hace de conductor. Dejamos los medios de localización y nos concentramos más en dispositivos de información. Un buen ejemplo de interfaz de información no visual es el llamado AirPix («fotos de aire»). Imaginen un monitor para ciegos. Una pequeña tableta con mucho agujeros por donde sale aire comprimido, en la que se puede dibujar. Así, un ciego puede colocar su mano encima y ver las líneas del camino y los obstáculos. Es posible inclusive variar la frecuencia del aire al salir así como la temperatura. Es en realidad una interfaz multi-dimensional. Aquí se pueden ver las cámaras izquierda y derecha del vehículo y la forma cómo el computador procesa la información y la envía a los chorros de aire. Se muestra con un simulador a un ciego conduciendo con este aparato. El simulador ha sido muy útil para entrenar a los conductores invidentes y también para ensayar diferentes ideas para varios tipos distintos de interfaces no visuales. En esencia, así es cómo funciona.

So just a month ago, on January 29th, we unveiled this vehicle for the very first time to the public at the world-famous Daytona International Speedway during the Rolex 24 racing event. We also had some surprises. Let's take a look.

Hace sólo un mes, el 29 de enero, pusimos el vehículo en exhibición, por primera vez ante el público en la famosa pista de carreras de Daytona, en el evento Rolex 24. Tuvimos algunas sorpresas. Veamos.

(Music)

(Música)

(Video) Announcer: This is an historic day in January. He's coming up to the grandstand, fellow Federationists.

(Video) Anunciador: Este es un día histórico [confuso]. Aquí viene a la tribuna, amigos espectadores.

(Cheering)

(Vítores)

(Honking)

(Bocinas)

There's the grandstand now. And he's [unclear] following that van that's out in front of him. Well there comes the first box. Now let's see if Mark avoids it. He does. He passes it on the right. Third box is out. The fourth box is out. And he's perfectly making his way between the two. He's closing in on the van to make the moving pass. Well this is what it's all about, this kind of dynamic display of audacity and ingenuity. He's approaching the end of the run, makes his way between the barrels that are set up there.

Aquí está ahora en la tribuna. Está [confuso] siguiendo la camioneta que va al frente. Y aquí viene la primera caja. Veamos si Mark la evita. Lo hace. Pasa por la derecha. Pasa la tercera caja. Y pasa la cuarta. Y ahí va andando entre las dos. Se acerca a la camioneta para pasar. Bueno, así fue esta exhibición dinámica de audacia e ingenio. Se aproxima al fin del recorrido y sortea los barriles que están ahí colocados.

(Honking)

[¡Éxito!] (Bocinas)

(Applause)

(Aplausos)

Dennis Hong: I'm so happy for you. Mark's going to give me a ride back to the hotel.

Dennis Hong: Estoy muy feliz con Uds. Voy a regresar al hotel, con Mark como chofer.

Mark Riccobono: Yes.

Mark Riccobono: Sí.

(Applause)

(Aplausos)

DH: So since we started this project, we've been getting hundreds of letters, emails, phone calls from people from all around the world. Letters thanking us, but sometimes you also get funny letters like this one: "Now I understand why there is Braille on a drive-up ATM machine." (Laughter) But sometimes -- (Laughter) But sometimes I also do get -- I wouldn't call it hate mail -- but letters of really strong concern: "Dr. Hong, are you insane, trying to put blind people on the road? You must be out of your mind." But this vehicle is a prototype vehicle, and it's not going to be on the road until it's proven as safe as, or safer than, today's vehicle. And I truly believe that this can happen.

DH: Es muy bueno haber trabajado en este proyecto. Recibimos centenares de cartas, mensajes de internet y llamadas telefónicas de personas de todo el mundo. Cartas agradecidas, pero también algunas cartas con humor como ésta: "Ahora entiendo por qué hay instrucciones en Braille en ciertos cajeros automáticos para conductores". (Risas) Pero algunas veces (Risas) Pero algunas veces también me llegan; no las llamaría cartas con odio, pero cartas preocupantes: "Dr. Hong: ¿Está Ud. chiflado tratando de poner ciegos al volante? Debe estar loco". Este vehículo es un prototipo que no va a ir a las carreteras hasta que sea tan seguro, o más, que cualquier otro auto actual. Estoy convencido que así puede ser.

But still, will the society, would they accept such a radical idea? How are we going to handle insurance? How are we going to issue driver's licenses? There's many of these different kinds of hurdles besides technology challenges that we need to address before this becomes a reality. Of course, the main goal of this project is to develop a car for the blind. But potentially more important than this is the tremendous value of the spin-off technology that can come from this project. The sensors that are used can see through the dark, the fog and rain. And together with this new type of interfaces, we can use these technologies and apply them to safer cars for sighted people. Or for the blind, everyday home appliances -- in the educational setting, in the office setting. Just imagine, in a classroom a teacher writes on the blackboard and a blind student can see what's written and read using these non-visual interfaces. This is priceless. So today, the things I've showed you today, is just the beginning.

Pero aún así; ¿aceptará la sociedad esta idea tan radical? ¿Cómo se van a manejar los seguros? ¿Cómo se van a expedir licencias de conducción? Existen muchísimos obstáculos, además de los problemas técnicos que hay que resolver, antes de que sea una realidad. Desde luego, el principal objetivo del proyecto es desarrollar un auto para ciegos. Pero más importante que esto es el inmenso valor de los subproductos tecnológicos que se han logrado. Los sensores que se usan, pueden ver en la oscuridad, en la niebla y bajo la lluvia. Y con estas nuevas interfaces, podemos usar estas tecnologías para aplicarlas en coches para videntes que sean más seguros. O para ciegos, en aparatos cotidianos del hogar, en establecimientos educativos, en oficinas. Piensen en un maestro que escribe en la pizarra y un estudiante ciego que puede ver lo que se ha escrito usando estas interfaces no visuales. Esto no tiene precio. Por ahora, lo que les he mostrado hoy, es sólo el comienzo.

Thank you very much.

Muchas gracias.

(Applause)

(Aplausos)