[This talk contains mature content]

[Questo discorso contiene materiale per adulti]

Rana Ayyub is a journalist in India whose work has exposed government corruption and human rights violations. And over the years, she's gotten used to vitriol and controversy around her work. But none of it could have prepared her for what she faced in April 2018.

Rana Ayyub è un giornalista indiana che, grazie alle sue inchieste, ha svelato la corruzione del governo e le violazioni dei diritti umani. Con il tempo, si è abituata alle aspre critiche e alle polemiche sul suo lavoro. Ma niente di tutto ciò poteva prepararla a ciò che successe nell'aprile del 2018.

She was sitting in a café with a friend when she first saw it: a two-minute, 20-second video of her engaged in a sex act. And she couldn't believe her eyes. She had never made a sex video. But unfortunately, thousands upon thousands of people would believe it was her.

Era seduta al bar con un'amica, quando lo vide per la prima volta: un video di due minuti e 20 secondi dove era protagonista di un atto sessuale. Non poteva credere ai suoi occhi. Non aveva mai fatto un video a sfondo sessuale. Sfortunatamente, però, migliaia e migliaia di persone credevano che fosse lei.

I interviewed Ms. Ayyub about three months ago, in connection with my book on sexual privacy. I'm a law professor, lawyer and civil rights advocate. So it's incredibly frustrating knowing that right now, law could do very little to help her. And as we talked, she explained that she should have seen the fake sex video coming. She said, "After all, sex is so often used to demean and to shame women, especially minority women, and especially minority women who dare to challenge powerful men," as she had in her work. The fake sex video went viral in 48 hours. All of her online accounts were flooded with screenshots of the video, with graphic rape and death threats and with slurs about her Muslim faith. Online posts suggested that she was "available" for sex. And she was doxed, which means that her home address and her cell phone number were spread across the internet. The video was shared more than 40,000 times.

Ho intervistato Ayyub circa tre mesi fa, in tema con il mio libro sulla privacy sessuale. Sono una docente di legge, avvocato e sostenitrice dei diritti civili. È incredibilmente frustante sapere che al momento la legge può fare ben poco per aiutarla. Mentre parlavamo, mi spiegò che si sarebbe dovuta aspettare un finto video a sfondo sessuale. Mi disse: "Si sa, il sesso è spesso usato per umiliare e infamare le donne, specialmente donne della minoranza, e soprattutto donne della minoranza che osano sfidare uomini di potere”, come aveva fatto lei nel suo lavoro. Il finto video sessuale è diventato virale in 48 ore. Tutti i suoi account online erano invasi da screenshot del video, da minacce di stupro e di morte descritte nel dettaglio e da offese circa la sua fede islamica. I post online suggerivano che fosse "disponibile" al sesso. Fu vittima di "doxing", ovvero il suo indirizzo di casa e il suo numero di telefono furono diffusi sul web. Il video fu condiviso più di 40.000 volte.

Now, when someone is targeted with this kind of cybermob attack, the harm is profound. Rana Ayyub's life was turned upside down. For weeks, she could hardly eat or speak. She stopped writing and closed all of her social media accounts, which is, you know, a tough thing to do when you're a journalist. And she was afraid to go outside her family's home. What if the posters made good on their threats? The UN Council on Human Rights confirmed that she wasn't being crazy. It issued a public statement saying that they were worried about her safety.

Quando qualcuno è preso di mira da questo tipo di attacco virtuale, il danno è profondo. La vita di Rana Ayyub è stata stravolta. Per settimane, riuscì a malapena a mangiare o a parlare. Smise di scrivere e chiuse tutti i suoi account social, cosa molto difficile per una giornalista. Aveva paura di uscire di casa. E se gli utenti fossero seri nelle loro minacce? Il Consiglio dei diritti umani ONU confermò che non era pazza. Si dichiararono pubblicamente preoccupati per la sua incolumità.

What Rana Ayyub faced was a deepfake: machine-learning technology that manipulates or fabricates audio and video recordings to show people doing and saying things that they never did or said. Deepfakes appear authentic and realistic, but they're not; they're total falsehoods. Although the technology is still developing in its sophistication, it is widely available.

Rana Ayyub ha subito un deepfake: un sistema di intelligenza artificiale che manipola o fabbrica registrazioni audio e video per mostrare persone che fanno o dicono cose che non hanno mai fatto o detto. I deepfake sembrano autentici e realistici, ma non lo sono: sono dei clamorosi falsi. Anche se questa tecnologia è ancora in fase di perfezionamento, è largamente disponibile.

Now, the most recent attention to deepfakes arose, as so many things do online, with pornography.

La più recente attenzione ai deepfake è scaturita, così come fanno molte cose online, dalla pornografia.

In early 2018, someone posted a tool on Reddit to allow users to insert faces into porn videos. And what followed was a cascade of fake porn videos featuring people's favorite female celebrities. And today, you can go on YouTube and pull up countless tutorials with step-by-step instructions on how to make a deepfake on your desktop application. And soon we may be even able to make them on our cell phones. Now, it's the interaction of some of our most basic human frailties and network tools that can turn deepfakes into weapons. So let me explain.

All'inizio del 2018 qualcuno rese disponibile su Reddit uno strumento che permetteva agli utenti di inserire volti all'interno di video porno. Ne seguì una valanga di finti video porno con le celebrità femminili più amate dal pubblico. Oggi su YouTube si possono trovare tantissimi tutorial con precise istruzioni su come creare un deepfake dalla propria applicazione desktop. Presto sarà forse possibile farli anche dai nostri telefoni. È l'interazione tra alcune delle nostre più intime fragilità umane e gli strumenti della rete che può trasformare i deepfake in armi. Lasciatemi spiegare.

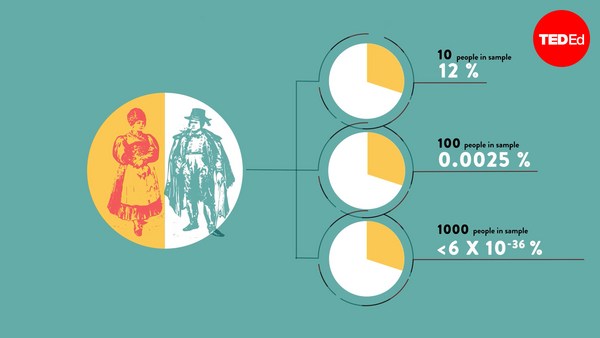

As human beings, we have a visceral reaction to audio and video. We believe they're true, on the notion that of course you can believe what your eyes and ears are telling you. And it's that mechanism that might undermine our shared sense of reality. Although we believe deepfakes to be true, they're not. And we're attracted to the salacious, the provocative. We tend to believe and to share information that's negative and novel. And researchers have found that online hoaxes spread 10 times faster than accurate stories. Now, we're also drawn to information that aligns with our viewpoints. Psychologists call that tendency "confirmation bias." And social media platforms supercharge that tendency, by allowing us to instantly and widely share information that accords with our viewpoints.

In quanto essere umani, si scatena in noi una reazione viscerale ad audio e video. Crediamo siano veri, partendo dal presupposto che puoi fidarti di ciò che i tuoi occhi e le tue orecchie ti stanno dicendo. Questo è il meccanismo che potrebbe minare il nostro comune senso della realtà. Nonostante giudichiamo i deepfake come reali, non lo sono. Siamo attratti dal volgare e dal provocante. Tendiamo a credere e a condividere informazioni che sono negative e romanzate. Alcuni ricercatori hanno scoperto che le bufale online si diffondono 10 volte più velocemente delle storie vere. Inoltre, siamo attirati verso informazioni che si allineano ai nostri punti di vista. Gli psicologi chiamano questa propensione il "bias di conferma". Le piattaforme social amplificano questa tendenza, consentendoci di condividere notizie in modo istantaneo e su scala globale, che sono fedeli alle nostre opinioni.

Now, deepfakes have the potential to cause grave individual and societal harm. So, imagine a deepfake that shows American soldiers in Afganistan burning a Koran. You can imagine that that deepfake would provoke violence against those soldiers. And what if the very next day there's another deepfake that drops, that shows a well-known imam based in London praising the attack on those soldiers? We might see violence and civil unrest, not only in Afganistan and the United Kingdom, but across the globe.

I deepfake hanno il potenziale di causare gravi danni individuali e comunitari. Immaginatevi un deepfake che mostri dei soldati Americani, in Afghanistan, bruciare il Corano. Viene immediato pensare che quel video possa provocare violenza contro quei soldati. E cosa succederebbe se, il giorno immediatamente successivo, arrivasse un nuovo deepfake che mostrasse un famoso imam di Londra elogiare l'attacco a quei soldati? Il risultato potrebbe sfociare in violenza e malcontento civile, non solo in Afghanistan o nel Regno Unito, ma in tutto il mondo.

And you might say to me, "Come on, Danielle, that's far-fetched." But it's not. We've seen falsehoods spread on WhatsApp and other online message services lead to violence against ethnic minorities. And that was just text -- imagine if it were video.

E voi potreste dirmi: "Dai, Danielle, è impossibile". Ma non lo è. Abbiamo visto che il diffondersi di bufale su WhatsApp e su altri servizi di messaggistica online ha portato all'accanimento contro le minoranze etniche. E si trattava solo di messaggi. Pensate se fossero stati video.

Now, deepfakes have the potential to corrode the trust that we have in democratic institutions. So, imagine the night before an election. There's a deepfake showing one of the major party candidates gravely sick. The deepfake could tip the election and shake our sense that elections are legitimate. Imagine if the night before an initial public offering of a major global bank, there was a deepfake showing the bank's CEO drunkenly spouting conspiracy theories. The deepfake could tank the IPO, and worse, shake our sense that financial markets are stable.

I deepfake hanno il potenziale di distruggere la fiducia che riponiamo nelle istituzioni democratiche. Immaginatevi la sera prima di un'elezione. C'è un deepfake che mostra uno dei principali candidati gravemente malato. Il deepfake potrebbe rovesciare le elezioni e scuotere la nostra convinzione per cui le elezioni siano legittime. Immaginate che la sera prima di un'offerta pubblica iniziale di un'importante banca internazionale ci fosse un deepfake che rappresenta l'amministratore delegato che declama teorie complottistiche mentre è ubriaco. Quel deepfake potrebbe far perdere l'offerta e, ancora peggio, far vacillare la nostra percezione sulla stabilità dei mercati.

So deepfakes can exploit and magnify the deep distrust that we already have in politicians, business leaders and other influential leaders. They find an audience primed to believe them. And the pursuit of truth is on the line as well. Technologists expect that with advances in AI, soon it may be difficult if not impossible to tell the difference between a real video and a fake one.

I deepfake sono in grado di sfruttare e amplificare la sfiducia che già proviamo nei confronti dei politici, dei leader economici e di altri leader influenti. Trovano un pubblico propenso a crederci. La ricerca della verità è messa a rischio. Gli esperti prevedono che con i progressi nell'intelligenza artificiale presto sarà difficile, se non impossibile, distinguere un video autentico da uno falso.

So how can the truth emerge in a deepfake-ridden marketplace of ideas? Will we just proceed along the path of least resistance and believe what we want to believe, truth be damned? And not only might we believe the fakery, we might start disbelieving the truth. We've already seen people invoke the phenomenon of deepfakes to cast doubt on real evidence of their wrongdoing. We've heard politicians say of audio of their disturbing comments, "Come on, that's fake news. You can't believe what your eyes and ears are telling you." And it's that risk that professor Robert Chesney and I call the "liar's dividend": the risk that liars will invoke deepfakes to escape accountability for their wrongdoing.

Come può, quindi, emergere la verità in un mondo oppresso dai deepfake? Continueremo a procedere lungo la strada della minima resistenza e a credere quello che vogliamo, a sfavore della verità? E non solo potremmo credere al falso, ma potremmo iniziare a dubitare della realtà. Abbiamo già visto persone appellarsi al fenomeno dei deepfake per gettare dubbi sulle evidenti prove delle loro colpe. Abbiamo sentito i politici negare gli audio dei propri spiacevoli commenti: "Dai, sono fake news. Non potete credere a ciò che i vostri occhi ed orecchie vi dicono". Questa è la minaccia che io e il professor Robert Chasney chiamiamo "il dividendo del bugiardo": è il rischio che i bugiardi si appellino ai deepfake per non assumersi la responsabilità delle proprie azioni.

So we've got our work cut out for us, there's no doubt about it. And we're going to need a proactive solution from tech companies, from lawmakers, law enforcers and the media. And we're going to need a healthy dose of societal resilience. So now, we're right now engaged in a very public conversation about the responsibility of tech companies. And my advice to social media platforms has been to change their terms of service and community guidelines to ban deepfakes that cause harm. That determination, that's going to require human judgment, and it's expensive. But we need human beings to look at the content and context of a deepfake to figure out if it is a harmful impersonation or instead, if it's valuable satire, art or education.

È indubbio il fatto che ci sia moltissimo lavoro da fare. Abbiamo bisogno di una soluzione proattiva da aziende tecnologiche, da legislatori, dagli organi di polizia e dai media. Abbiamo anche bisogno di una sana dose di resilienza sociale. Oggi, proprio adesso, siamo coinvolti in un dibattito molto aperto sulle responsabilità dell'industria tecnologica. Il mio consiglio per le piattaforme social è stato di modificare i termini d'uso e le linee guida comunitarie, al fine di bandire i deepfake pericolosi. Questa soluzione richiederà il giudizio umano ed è costosa. Ma abbiamo bisogno di esseri umani che guardino il contenuto e il contesto di un deepfake per capire se si tratti di un'imitazione dannosa o se, al contrario, si tratti di satira, arte o informazioni valide.

So now, what about the law? Law is our educator. It teaches us about what's harmful and what's wrong. And it shapes behavior it deters by punishing perpetrators and securing remedies for victims. Right now, law is not up to the challenge of deepfakes. Across the globe, we lack well-tailored laws that would be designed to tackle digital impersonations that invade sexual privacy, that damage reputations and that cause emotional distress. What happened to Rana Ayyub is increasingly commonplace. Yet, when she went to law enforcement in Delhi, she was told nothing could be done. And the sad truth is that the same would be true in the United States and in Europe.

Ma cosa ci dice la legge? La legge è maestra. Ci insegna cos'è dannoso e cos'è sbagliato. Determina il comportamento, scoraggia i responsabili punendoli e garantendo tutele alle vittime. Ad oggi, la legge non è pronta a fronteggiare la sfida dei deepfake. In tutto il mondo mancano leggi studiate su misura che sarebbero deputate a combattere le imitazioni digitali che invadono la privacy sessuale, danneggiano la reputazione e provocano squilibri emotivi. Quello che è capitato a Rana Ayyub sta diventando sempre più comune. Ma quando lei è andata dalla polizia a Delhi, le hanno detto che non si poteva fare nulla. La triste verità è che ciò potrebbe valere anche negli Stati Uniti e in Europa.

So we have a legal vacuum that needs to be filled. My colleague Dr. Mary Anne Franks and I are working with US lawmakers to devise legislation that would ban harmful digital impersonations that are tantamount to identity theft. And we've seen similar moves in Iceland, the UK and Australia. But of course, that's just a small piece of the regulatory puzzle.

Abbiamo un vuoto legale che dobbiamo colmare. Io e la dottoressa Mary Anne Franks lavoriamo con legislatori americani allo scopo di concepire una legislazione che vieti imitazioni digitali dannose, equivalenti al furto d'identità. Abbiamo riscontrato azioni simili in Islanda, Regno Unito e Australia. Ma questo è solo un piccolo pezzo nel puzzle normativo.

Now, I know law is not a cure-all. Right? It's a blunt instrument. And we've got to use it wisely. It also has some practical impediments. You can't leverage law against people you can't identify and find. And if a perpetrator lives outside the country where a victim lives, then you may not be able to insist that the perpetrator come into local courts to face justice. And so we're going to need a coordinated international response. Education has to be part of our response as well. Law enforcers are not going to enforce laws they don't know about and proffer problems they don't understand. In my research on cyberstalking, I found that law enforcement lacked the training to understand the laws available to them and the problem of online abuse. And so often they told victims, "Just turn your computer off. Ignore it. It'll go away." And we saw that in Rana Ayyub's case. She was told, "Come on, you're making such a big deal about this. It's boys being boys." And so we need to pair new legislation with efforts at training.

Sono consapevole che la legge non sia una panacea, giusto? È uno strumento poco affilato. Dobbiamo usarlo saggiamente. Ha anche alcuni impedimenti pratici. Non è possibile usare la legge contro chi non si può identificare e trovare. E se il colpevole vive fuori dallo Stato in cui vive la vittima, potrebbe non essere possibile esigere che il responsabile si presenti ai tribunali locali per l'udienza. Ci servirà una reazione condivisa a livello internazionale. L'informazione deve essere parte integrante di questo processo. Gli organi di polizia non possono far rispettare le leggi se non le conoscono e non possono gestire problemi che non comprendono. Durante le mie ricerche sul cyberstalking ho appreso che agli organi di polizia mancava la formazione adeguata per capire le leggi di quel settore e i pericoli dell'abuso di internet. Per questo spesso dicevano alle vittime: "Spegnete il computer. Ignorateli. Spariranno". Nel caso di Rana Ayyub è successo così. Le fu detto: "Forza, ne stai facendo una tragedia. Sono semplicemente maschi che si comportano da maschi". Alla legislazione dobbiamo abbinare l'impegno nella formazione.

And education has to be aimed on the media as well. Journalists need educating about the phenomenon of deepfakes so they don't amplify and spread them. And this is the part where we're all involved. Each and every one of us needs educating. We click, we share, we like, and we don't even think about it. We need to do better. We need far better radar for fakery.

La conoscenza deve essere un obiettivo anche per i media. I giornalisti necessitano di istruzione sul fenomeno dei deepfake affinché non lo intensifichino o lo diffondano. Qui è dove entriamo in gioco tutti quanti. Ciascuno di noi ha bisogno di istruzione. Clicchiamo, condividiamo, mettiamo "mi piace" senza nemmeno pensarci. Dobbiamo fare di meglio. Ci serve un radar più sofisticato per rilevare le bufale.

So as we're working through these solutions, there's going to be a lot of suffering to go around. Rana Ayyub is still wrestling with the fallout. She still doesn't feel free to express herself on- and offline. And as she told me, she still feels like there are thousands of eyes on her naked body, even though, intellectually, she knows it wasn't her body. And she has frequent panic attacks, especially when someone she doesn't know tries to take her picture. "What if they're going to make another deepfake?" she thinks to herself. And so for the sake of individuals like Rana Ayyub and the sake of our democracy, we need to do something right now.

Mentre ci occupiamo delle possibili soluzioni, dovremo superare innumerevoli difficoltà. Rana Ayyub sta tutt'ora lottando contro i risvolti del fatto. Non si sente ancora libera di esprimersi online e offline. Mi ha detto che avverte ancora la sensazione di avere mille occhi puntati sul suo corpo nudo, anche se, razionalmente, sa che non era il suo vero corpo. Ha frequenti attacchi di panico specialmente quando uno sconosciuto tenta di fotografarla. "E se faranno un altro deepfake?" pensa fra sé e sé. Per il bene di persone come Rana Ayyub e per il bene della nostra democrazia, dobbiamo agire immediatamente.

Thank you.

Grazie.

(Applause)

(Applausi)