[This talk contains mature content]

(این سخنرانی محتوایی بالغانه دارد)

Rana Ayyub is a journalist in India whose work has exposed government corruption and human rights violations. And over the years, she's gotten used to vitriol and controversy around her work. But none of it could have prepared her for what she faced in April 2018.

رانا ایوب خبرنگار هندی است که فعالیتهایش، فساد حکومتی و نقض حقوق بشر را افشا کرده است. و طی سالها، به هجمه و جدال پیرامون کار خود عادت کرده بود. اما هیچ کدام، او را برای آنچه که در آوریل ۲۰۱۸ با آن روبهرو شد، آماده نکرده بود.

She was sitting in a café with a friend when she first saw it: a two-minute, 20-second video of her engaged in a sex act. And she couldn't believe her eyes. She had never made a sex video. But unfortunately, thousands upon thousands of people would believe it was her.

وقتی برای بار اول آن را مشاهده کرد با دوستی در یک کافه نشسته بود: فیلم دو دقیقه و ۲۰ ثانیهای از رابطهایی جنسی با حضور خودش. نمیتوانست به چشمانش اعتماد کند. او هرگز یک فیلم سکسی نساخته بود. اما متاسفانه هزاران هزار نفر باور داشتند که خودش بوده است.

I interviewed Ms. Ayyub about three months ago, in connection with my book on sexual privacy. I'm a law professor, lawyer and civil rights advocate. So it's incredibly frustrating knowing that right now, law could do very little to help her. And as we talked, she explained that she should have seen the fake sex video coming. She said, "After all, sex is so often used to demean and to shame women, especially minority women, and especially minority women who dare to challenge powerful men," as she had in her work. The fake sex video went viral in 48 hours. All of her online accounts were flooded with screenshots of the video, with graphic rape and death threats and with slurs about her Muslim faith. Online posts suggested that she was "available" for sex. And she was doxed, which means that her home address and her cell phone number were spread across the internet. The video was shared more than 40,000 times.

من با خانم ایوب سه ماه پیش در رابطه با کتابم، با موضوع حریم جنسی، مصاحبه کردم. من استاد حقوق، وکیل و طرفدار حقوق مدنی هستم. بنابراین برای من بیاندازه مایوسکننده است که میدانم در حال حاضر قانون کمک خاصی به او نمیکند. و وقتی صحبت میکردیم، او توضیح داد که باید فکر انتشار فیلم تقلبی از رابطه جنسی را میکرد. او گفت، <<در واقع سکس اغلب برای تحقیر کردن و خجالتزده کردن زنان استفاده میشود، خصوصا زنان اقلیت، و خصوصا زنان اقلیتی که جرات مبارزه با مردان قدرتمند را دارند.>> چیزی که او در کارش داشت. فیلم سکس جعلی در عرض ۴۸ ساعت پخش (وایرال) شد. تمام حسابهای آنلاین او غرق اسکرینشاتها از آن فیلم، و تهدیدهای گرافیکیِ تجاوز و قتل شده بود. به همراه لکه دار کردن اعتقادات اسلامی او. در مطالب اینترنتی او را برای رابطه جنسی پیشنهاد میکردند. و او dox شده بود، به این معنی که آدرس خانه و شماره تلفن او در سراسر اینترنت پخش شده بود. فیلم بیش از ۴۰,۰۰۰ بار به اشتراک گذاشته شده بود.

Now, when someone is targeted with this kind of cybermob attack, the harm is profound. Rana Ayyub's life was turned upside down. For weeks, she could hardly eat or speak. She stopped writing and closed all of her social media accounts, which is, you know, a tough thing to do when you're a journalist. And she was afraid to go outside her family's home. What if the posters made good on their threats? The UN Council on Human Rights confirmed that she wasn't being crazy. It issued a public statement saying that they were worried about her safety.

وقتی یک نفر با چنین حمله سایبری مورد هدف قرار میگیرد، ضربهای اساسی به او وارد شده است. زندگی رانا ایوب وارونه شد. او برای هفتهها به سختی غذا میخورد و صحبت میکرد. او از نوشتن دست کشید و تمام حسابهای شبکههای آنلاین خود را بست، مسئلهای که میدانید چقدر مشکل است وقتی که یک خبرنگار باشید. او از اینکه از خانه خودشان خارج شود میترسید. اگر افرادی که مطلب گذاشته بودند، تهدیدشان را عملی میکردند، چه اتفاقی میافتاد؟ شورای حقوق بشر سازمان ملل متحد تایید کرد که او دیوانه نشده است. یک بیانیه عمومی منتشر کرد که میگفت که آنها نگران امنیت او هستند.

What Rana Ayyub faced was a deepfake: machine-learning technology that manipulates or fabricates audio and video recordings to show people doing and saying things that they never did or said. Deepfakes appear authentic and realistic, but they're not; they're total falsehoods. Although the technology is still developing in its sophistication, it is widely available.

رانا ایوب با یک جعلعمیق مواجه شده بود: فناوری یادگیری-ماشین که صوتها و فیلمها را دستکاری و جعل میکند تا نشان دهد مردم چیزهایی میگویند و یا انجام میدهند که هرگز نگفته و نکردهاند. جعلعمیقها به صورت موثق و واقعی ظاهر میشوند اما چنین نیستند، آنها به کلی کذب هستند. فناوری هنوز با تمام پیچیدگیهایش در حال توسعه است، و بطور گسترده در دسترس است.

Now, the most recent attention to deepfakes arose, as so many things do online, with pornography.

اخیرا توجه به جعلعمیق افزایش یافته است، به طوری که میشود به صورت آنلاین خیلی از کارها در رابطه با پرنوگرافی انجام داد.

In early 2018, someone posted a tool on Reddit to allow users to insert faces into porn videos. And what followed was a cascade of fake porn videos featuring people's favorite female celebrities. And today, you can go on YouTube and pull up countless tutorials with step-by-step instructions on how to make a deepfake on your desktop application. And soon we may be even able to make them on our cell phones. Now, it's the interaction of some of our most basic human frailties and network tools that can turn deepfakes into weapons. So let me explain.

اوایل سال ۲۰۱۸، یک نفر ابزاری را در Reddit منتشرکرد که به کاربر امکان اضافه کردن چهره به فیلمهای سکسی را میداد. و چیزی که به دنبالش بود سرازیر شدن فیلمهای سکسی جعلی با چهرهی زنان مشهور و محبوب مردم بود. و امروز، میتوانید وارد سایت یوتیوب شده و تمرینهای بیشماری را با دستورالعملهای گامبهگام برای درست کردن یک جعلعمیق بر روی کامیپوتر خود، بیابید. و به زودی شاید امکان آن را داشته باشیم تا با گوشیهایمان آنها را درست کنیم. اکنون این برهم کنش بعضی از ضعفهای اساسی بشر و ابزارهای شبکهاست که میتواند جعلعمیق را به سلاح تبدیل کند. اجازه دهید توضیح دهم.

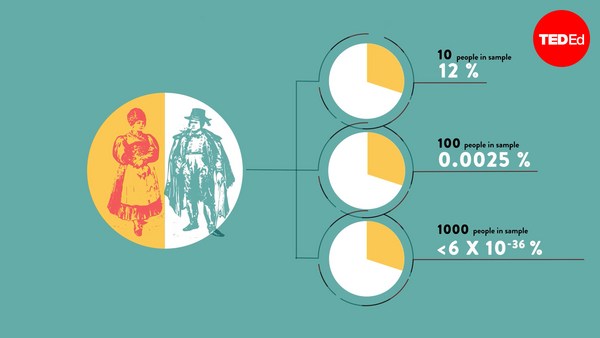

As human beings, we have a visceral reaction to audio and video. We believe they're true, on the notion that of course you can believe what your eyes and ears are telling you. And it's that mechanism that might undermine our shared sense of reality. Although we believe deepfakes to be true, they're not. And we're attracted to the salacious, the provocative. We tend to believe and to share information that's negative and novel. And researchers have found that online hoaxes spread 10 times faster than accurate stories. Now, we're also drawn to information that aligns with our viewpoints. Psychologists call that tendency "confirmation bias." And social media platforms supercharge that tendency, by allowing us to instantly and widely share information that accords with our viewpoints.

به عنوان انسان، ما واکنشی غریزی نسبت به فیلم وصوت داریم. ما باور داریم آنها حقیقی هستند، البته با این تصور که شما میتوانید هر آنچه که چشمها و گوشهایتان میگوید باور کنید. و این همان سازوکاری است که ممکن است حس واقعگرایی ما را سست کند. و باور کنیم که جعلهای عمیق درست هستند در حالی که نیستند. و ما به محتوی جنسی و بحثبرانگیز جذب میشویم. تمایل داریم اطلاعاتی که منفی و جدید هستند را باور کنیم و به اشتراک بگذاریم. تحقیقات نشان داده است که حقههای آنلاین ده برابر داستانهای دقیق منتشر میشوند. حال ما به اطلاعاتی که در راستای دیدگاههایمان است کشیده میشویم. روانشناسان این تمایل را <<سوگیری تاییدی>> مینامند. و شبکههای اجتماعی به شدت این گرایش را با امکان اشتراک گذاری سریع و گسترده اطلاعاتی که با نقطه نظرات ما همخوانی دارد، تقویت میکنند.

Now, deepfakes have the potential to cause grave individual and societal harm. So, imagine a deepfake that shows American soldiers in Afganistan burning a Koran. You can imagine that that deepfake would provoke violence against those soldiers. And what if the very next day there's another deepfake that drops, that shows a well-known imam based in London praising the attack on those soldiers? We might see violence and civil unrest, not only in Afganistan and the United Kingdom, but across the globe.

اکنون جعلعمیق پتانسیل این را دارد تا موجب یک صدمهی شخصی و اجتماعی جدی شود. جعلعمیقی را تصور کنید که نشان میدهد که یک سرباز آمریکایی در افغانستان قرآن را میسوزاند. میتوانید تصور کنید که جعلعمیق میتواند به خشونت علیه آن سربازان دامن بزند. و چه اتفاقی خواهد افتاد، اگر در روز بعد یک جعلعمیق دیگر به راه بیافتد، که نشان میدهد یک شیخ مشهور ساکن لندن، حمله به آن سربازان را ستایش میکند؟ و شاید شاهد خشونت و ناآرامیهای مدنی، نه تنها در افغانستان و بریتانیا بلکه در سرتاسر جهان باشیم.

And you might say to me, "Come on, Danielle, that's far-fetched." But it's not. We've seen falsehoods spread on WhatsApp and other online message services lead to violence against ethnic minorities. And that was just text -- imagine if it were video.

ممکن است بگویید، <<بیخیال دنیل، خیلی بعید است.>> ولی نیست. مشاهده کردهایم که انتشار دروغها بر روی واتسآپ و دیگر سرویسهای پیامرسان آنلاین منجر به خشونت علیه اقلیتهای قومی میشود. و این فقط متن است -- تصور کنید فیلم باشد.

Now, deepfakes have the potential to corrode the trust that we have in democratic institutions. So, imagine the night before an election. There's a deepfake showing one of the major party candidates gravely sick. The deepfake could tip the election and shake our sense that elections are legitimate. Imagine if the night before an initial public offering of a major global bank, there was a deepfake showing the bank's CEO drunkenly spouting conspiracy theories. The deepfake could tank the IPO, and worse, shake our sense that financial markets are stable.

اکنون جعلعمیق پتانسیل این را دارد که اعتمادی که به نهادهای دموکراتیک داریم ذره ذره نابود کند. شب قبل انتخابات را تصور کنید. یک جعلعمیق نشان میدهد که یکی از کاندیداهای حزب اصلی به شدت مریض است. جعلعمیق میتواند انتخابات را از مسیر خود خارج کند و احساس ما نسبت به انتخابات قانونی را تکان دهد. تصور کنید شب قبل از عرضه اولیه یک سهام، توسط یک بانک بزرگ جهانی، جعلعمیقی نشان میدهد مدیرعامل آن بانک در حالت مستی حرفهای بیجایی درباره تئوری توطئه میزند. جعلعمیق میتواند عرضه سهام را به ورطه نابودی بکشاند. و بدتر، احساس ما درباره اینکه بازارهای مالی باثبات هستند را تکان دهد.

So deepfakes can exploit and magnify the deep distrust that we already have in politicians, business leaders and other influential leaders. They find an audience primed to believe them. And the pursuit of truth is on the line as well. Technologists expect that with advances in AI, soon it may be difficult if not impossible to tell the difference between a real video and a fake one.

بنابراین جعلهایعمیق میتوانند بیاعتمادی زیادی که همین الان هم به سیاستمداران، رهبران اقتصادی و دیگر رهبران بانفوذ داریم بزرگتر کرده و از آن سواستقاده کنند. آنها مخاطب بالقوه برای باور کردن را پیدا میکنند. و همچنین دنبال کردن حقیقت هم در خطر است. اهل فن منتظر پیشرفت در هوش مصنوعی هستند، بزودی به سختی و حتی غیرممکن است که تفاوت بین یک فیلم واقعی و تقلبی را بگوییم.

So how can the truth emerge in a deepfake-ridden marketplace of ideas? Will we just proceed along the path of least resistance and believe what we want to believe, truth be damned? And not only might we believe the fakery, we might start disbelieving the truth. We've already seen people invoke the phenomenon of deepfakes to cast doubt on real evidence of their wrongdoing. We've heard politicians say of audio of their disturbing comments, "Come on, that's fake news. You can't believe what your eyes and ears are telling you." And it's that risk that professor Robert Chesney and I call the "liar's dividend": the risk that liars will invoke deepfakes to escape accountability for their wrongdoing.

پس حقیقت چگونه میتواند در بازار داغ ایدههای جعلیعمیق نمایان شود؟ به مسیر خود بدون هیچ مقاومتی ادامه میدهیم و چیزی که میخواهیم باور کنیم را باور میکنیم، و حقیقت را نادیده میگیریم؟ و نه تنها ممکن است جعلیات را باور کنیم، ممکن است باورنکردن حقیقت را هم شروع کنیم. اخیرا دیدهایم که مردم به جعلهای عمیق متوسل میشوند تا بر روی مدارک واقعی تخلفاتشان شبه افکنی کنند. شنیدهایم که سیاستمداران درباره صوت نظرات آزاردهندهشان گفتهاند، <<بیخیال، آنها خبرهای جعلی هستند. شما نمیتوانید به آنچه که گوشها و چشمهایتان میگوید، اعتماد کنید.>> و این همان خطری است که پرفسور روبرت چسنی و من آن را "منفعت دروغگوها" مینامیم. خطر اینکه دروغگوها با توسل به جعلهایعمیق از مسئولیت تخلفاتشان فرار کنند.

So we've got our work cut out for us, there's no doubt about it. And we're going to need a proactive solution from tech companies, from lawmakers, law enforcers and the media. And we're going to need a healthy dose of societal resilience. So now, we're right now engaged in a very public conversation about the responsibility of tech companies. And my advice to social media platforms has been to change their terms of service and community guidelines to ban deepfakes that cause harm. That determination, that's going to require human judgment, and it's expensive. But we need human beings to look at the content and context of a deepfake to figure out if it is a harmful impersonation or instead, if it's valuable satire, art or education.

پس ما کار بسیار سختی در پیش داریم، هیج شکی در آن نیست. ما به یک راه حل پیشگیرانه از شرکتهای فناوری از قانونگذارن، از حکمفرمایان و رسانهها نیاز داریم. ما به دُز سالمی از مقاومت اجتماعی احتیاح داریم. امروزه، در بسیاری از بحثهای عمومی درباره مسئولیت شرکتهای فناوری شرکت میکنیم. و پیشنهاد من به پایگاه شبکههای اجتماعی این بوده است که شرایط استفاده از خدمات و دستورالعملهای عمومی خود را طوری تغییر دهند که جعلهایعمیقی که صدمه میزنند را ممنوع کند. این اقدام، به یک داوری انسانی نیاز خواهد داشت، و بسیار پرهزینه است. اما ما به انسانهایی نیاز داریم که محتوی و متن یک جعلعمیق را بررسی کنند تا تشخیص دهند که پشت آن یک هویت جعلی مخرب قرار دارد یا اینکه یک طنز، هنر و یا دانش ارزشمند است.

So now, what about the law? Law is our educator. It teaches us about what's harmful and what's wrong. And it shapes behavior it deters by punishing perpetrators and securing remedies for victims. Right now, law is not up to the challenge of deepfakes. Across the globe, we lack well-tailored laws that would be designed to tackle digital impersonations that invade sexual privacy, that damage reputations and that cause emotional distress. What happened to Rana Ayyub is increasingly commonplace. Yet, when she went to law enforcement in Delhi, she was told nothing could be done. And the sad truth is that the same would be true in the United States and in Europe.

حالا قانون چه کار میکند؟ قانون مربی ماست. او به ما درباره آنچه که مضر و آنچه که اشتباه است، درس میدهد. و با مجازات افراد خاطی، رفتارهای بازدارنده را شکل میدهد و برای قربانیان راه چاره مییابد. در حال حاضر قانون مناسب برای جعلعمیق وجود ندارد. در سرتاسر جهان، با کمبود قوانین مناسب و طراحی شده برای برخورد با هویتهای جعلی دیجیتالی مواجهه هستیم، کسانی که نقضکننده حریم جنسی هستند، و اعتبار افراد را خدشه دار میکنند، و آنهایی که مسبب مشکلات روحی هستند. اتفاقی که برای رانا ایوب افتاد به سرعت در حال عادی شدن است. در عین حال وقتی که به نهاد مجری قانون در دهلی رفت، به او گفتند که هیج کاری نمیشود انجام داد. و حقیقت تلخ آن است که در اروپا و ایالات متحده هم همینطور است.

So we have a legal vacuum that needs to be filled. My colleague Dr. Mary Anne Franks and I are working with US lawmakers to devise legislation that would ban harmful digital impersonations that are tantamount to identity theft. And we've seen similar moves in Iceland, the UK and Australia. But of course, that's just a small piece of the regulatory puzzle.

بنابراین یک خلا قانونی داریم که لازم است پر شود. همکارم، دکتر مری آن فرنکس و من با قانونگذاران ایالات متحده همکاری می کنم تا قانونی را تدوین کنیم که مانع هویتهای جعلی دیجیتال شوند، کسانی که تفاوتی با سارقین هویت ندارند. و ما شاهد اقدامات مشابهی در ایسلند، بریتانیا و استرالیا هستیم. و البته این فقط یک تکه کوچک از پازل نظارت است.

Now, I know law is not a cure-all. Right? It's a blunt instrument. And we've got to use it wisely. It also has some practical impediments. You can't leverage law against people you can't identify and find. And if a perpetrator lives outside the country where a victim lives, then you may not be able to insist that the perpetrator come into local courts to face justice. And so we're going to need a coordinated international response. Education has to be part of our response as well. Law enforcers are not going to enforce laws they don't know about and proffer problems they don't understand. In my research on cyberstalking, I found that law enforcement lacked the training to understand the laws available to them and the problem of online abuse. And so often they told victims, "Just turn your computer off. Ignore it. It'll go away." And we saw that in Rana Ayyub's case. She was told, "Come on, you're making such a big deal about this. It's boys being boys." And so we need to pair new legislation with efforts at training.

من میدانم که قانون علاج همه دردها نیست. درست است؟ یک ابزار کند است. و باید از آن هوشمندانه استفاده کنیم. و همجنین موانع عملی بسیاری دارد. شما نمیتوانید قانون را علیه کسانی که نمیشناسید و پیدا نمیکنید اعمال کنید. اگر فرد خاطی خارج از کشوری باشد که قربانی در آن زندگی کند، امکان ندارید بتوانید پافشاری کنید که آن فرد خاطی به دادگاههای محلی بیاید تا با عدالت روبهرو شود. بنابراین به یک واکنش بینالمللی هماهنگ نیاز خواهیم داشت. آموزش هم باید بخشی از واکنش ما باشد. قانونگذاران درباره چیزی که نمیدانند چیست و چه مشکلاتی بوجود میآورد، قانون وضع نمیکنند. در تحقیقاتم در مورد آزار و اذیتهای سایبری متوجه شدم مجریان قانون آموزش کافی برای فهمیدن قوانینی که در اختیار دارند و معضل توهینهای آنلاین، ندیدهاند. و خیلی اوقات به قربانیان گفتهاند، <<رایانه را خاموش کن. محل نگذار. خود به خود ناپدید میشود.>> این را در مورد رانا ایوب مشاهده کردیم. به او گفته شد، <<بیخیال، بیخود بزرگش کردی. پسرها همیناند دیگه.>> بنابراین باید قانون جدید را با تلاشهای در زمینه آموزش همگام کنیم.

And education has to be aimed on the media as well. Journalists need educating about the phenomenon of deepfakes so they don't amplify and spread them. And this is the part where we're all involved. Each and every one of us needs educating. We click, we share, we like, and we don't even think about it. We need to do better. We need far better radar for fakery.

و آموزش در رسانهها نیز باید هدفمند باشد. لازم است خبرنگاران در مورد پدیده جعلعمیق آموزش ببینند بنابراین آنها را تقویت و منتشر نمیکنند. و این جاییست که همه ما باید در آن درگیر شویم. همه ما نیازمند آموزش هستیم. ما هستیم که کلیک میکنیم، به اشتراک میگذاریم، میپسندیم و حتی فکر هم نمیکنیم. باید بهتر عمل کنیم. به رادارهای بهتری برای جعلیات نیاز داریم.

So as we're working through these solutions, there's going to be a lot of suffering to go around. Rana Ayyub is still wrestling with the fallout. She still doesn't feel free to express herself on- and offline. And as she told me, she still feels like there are thousands of eyes on her naked body, even though, intellectually, she knows it wasn't her body. And she has frequent panic attacks, especially when someone she doesn't know tries to take her picture. "What if they're going to make another deepfake?" she thinks to herself. And so for the sake of individuals like Rana Ayyub and the sake of our democracy, we need to do something right now.

همان زمانی که بر روی این راهحلها کار میکنیم، رنج زیادی در حال پخش شدن است. رانا ایوب هنوز با پیامدهای آن اتفاق کلنجار میرود. هنوز برای بیان خودش آنلاین و آفلاین احساس راحتی نمیکند. و همانطور که به من گفت، کماکان احساس میکند هزاران نگاه به بدن لخت اوست، اگرچه به صورت منطقی میداند که آن بدن او نبوده است. و به او مرتب حملههای عصبی میشود، خصوصا زمانی که کسی که نمیشناسد، تلاش میکند از او عکس بگیرد. با خودش فکر میکند: << اگر بخواهند یک جعل عمیق دیگر بسازند، چه؟>> پس بخاطر افرادی مثل رانا ایوب و بخاطر دموکراسی لازم است که همین الان کاری بکنیم.

Thank you.

متشکرم.

(Applause)

(تشویق)