Intelligens -- hvad er det? Hvis vi tager et kig tilbage i historien over hvordan intelligens er blevet opfattet, har et skelsættende eksempel været Edsger Dijkstras kendte citat at "Spørgsmålet om hvorvidt en maskine kan tænke er omtrent så interessant, som spørgsmålet om hvorvidt en ubåd kan svømme." Da Edsger Dijkstra skrev dette, mente han det som en kritik af de tidlige pionerer i computervidenskab, som Alan Turing. Men hvis du tager et kig tilbage, og tænker over hvad der har været de mest kraftfulde opfindelser som har sat os i stand til at bygge kunstige maskiner der kan svømme og kunstige maskiner som flyver, så vil du se, at det kun var gennem en forståelse af de underliggende fysiske mekanismer af svømning og flyvning at vi var i stand til at bygge disse maskiner. Og så for flere år siden,, satte jeg et forskningsprogram i værks for at forstå de fundamentale fysiske mekanismer der lå bag intelligens.

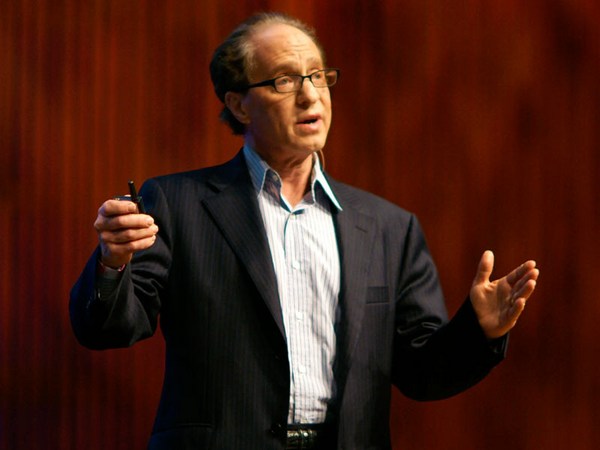

Intelligence -- what is it? If we take a look back at the history of how intelligence has been viewed, one seminal example has been Edsger Dijkstra's famous quote that "the question of whether a machine can think is about as interesting as the question of whether a submarine can swim." Now, Edsger Dijkstra, when he wrote this, intended it as a criticism of the early pioneers of computer science, like Alan Turing. However, if you take a look back and think about what have been the most empowering innovations that enabled us to build artificial machines that swim and artificial machines that [fly], you find that it was only through understanding the underlying physical mechanisms of swimming and flight that we were able to build these machines. And so, several years ago, I undertook a program to try to understand the fundamental physical mechanisms underlying intelligence.

Lad os tage et skridt tilbage. Lad os først begynde med et tankeeksperiment. Forestil dig at du er en fremmed race, som ikke kender noget til jordens biologi eller jordens neurovidenskab eller jordens intelligens, men du har fantastiske teleskoper, og du er i stand til at overvåge jorden, og du har fantastisk lange liv, så du er i stand til at overvåge jorden over millioner eller endda milliarder af år. Og du observerer en meget underlig effekt. Du observerer at over tusindvis af år, er jorden konstant under bombardement af asteroider indtil et tidspunkt, og ved det tidspunkt, omtrent svarende til vores år 2000, asteroider som er på en kollisions kurs med jorden. som ellers ville have kollideret på mystisk vis bliver afbøjet, eller de detonerer før de kan ramme jorden. Selvfølgelig som jordboere ved vi, at grunden er at vi prøver at redde os selv. Vi prøver at forhindre et sammenstød. Men hvis du er en fremmed race, som ikke ved dette, som ikke har noget koncept af jordintelligens, ville du være nødsaget til at sammenstrikke en fysisk teori som forklarer hvorledes op til et vist tidspunkt, asteroider som ville ødelægge overfladen af en planet på mystisk vis stopper med at gøre det. Og så forelægger jeg, at dette er det samme spørgsmål som at forstå den fysiske natur af intelligens.

Let's take a step back. Let's first begin with a thought experiment. Pretend that you're an alien race that doesn't know anything about Earth biology or Earth neuroscience or Earth intelligence, but you have amazing telescopes and you're able to watch the Earth, and you have amazingly long lives, so you're able to watch the Earth over millions, even billions of years. And you observe a really strange effect. You observe that, over the course of the millennia, Earth is continually bombarded with asteroids up until a point, and that at some point, corresponding roughly to our year, 2000 AD, asteroids that are on a collision course with the Earth that otherwise would have collided mysteriously get deflected or they detonate before they can hit the Earth. Now of course, as earthlings, we know the reason would be that we're trying to save ourselves. We're trying to prevent an impact. But if you're an alien race who doesn't know any of this, doesn't have any concept of Earth intelligence, you'd be forced to put together a physical theory that explains how, up until a certain point in time, asteroids that would demolish the surface of a planet mysteriously stop doing that. And so I claim that this is the same question as understanding the physical nature of intelligence.

Så i det forskningsprogram jeg startede for mange år tilbage, kiggede jeg på en række af forskellige tråde over videnskab, over en række forskellige discipliner, som pegede på, tror jeg, en underliggende mekaniske for intelligens. I kosmologi for eksempel har der været en række af forskellige tråde af beviser at vores univers synes at være fin tunet til udviklingen af intelligens, og i særdeleshed for udviklingen af universelle stadier som maksimere udvalget af mulige fremtider. I spil, foreksempel i 'Go' .. alle kan huske i 1997, hvor IBM's 'Deep Blue' slog Garry Kasparov i skak -- færre folk er opmærksomme på at i de sidste 10 år eller der omkring, er spillet Go velsagtens et langt mere udfordrende spil, fordi det har et meget højere forgrenings faktor, også begyndt at bukke under for computerspillere af den samme grund: de bedste teknikker lige nu for computere, som spiller Go er teknikker som prøver på at maksimere fremtidige muligheder under spillet. Til slut, i robotbevægelses planlægning har der været en række af nye teknikker som har prøvet på at drage fordel af robotters evner til at maksimere fremtidig handlerum med henblik på at gennemføre komplekse opgaver. Og så tog jeg alle disse forskellige tråde og satte dem sammen, og spurgte, startende for flere år siden, er der en underliggende mekanisme for intelligens som vi kan ekstrapolere ud af alle disse forskellige tråde? Er der en enlig ligning for intelligens?

So in this program that I undertook several years ago, I looked at a variety of different threads across science, across a variety of disciplines, that were pointing, I think, towards a single, underlying mechanism for intelligence. In cosmology, for example, there have been a variety of different threads of evidence that our universe appears to be finely tuned for the development of intelligence, and, in particular, for the development of universal states that maximize the diversity of possible futures. In game play, for example, in Go -- everyone remembers in 1997 when IBM's Deep Blue beat Garry Kasparov at chess -- fewer people are aware that in the past 10 years or so, the game of Go, arguably a much more challenging game because it has a much higher branching factor, has also started to succumb to computer game players for the same reason: the best techniques right now for computers playing Go are techniques that try to maximize future options during game play. Finally, in robotic motion planning, there have been a variety of recent techniques that have tried to take advantage of abilities of robots to maximize future freedom of action in order to accomplish complex tasks. And so, taking all of these different threads and putting them together, I asked, starting several years ago, is there an underlying mechanism for intelligence that we can factor out of all of these different threads? Is there a single equation for intelligence?

Og svaret, tror jeg, er ja. ["F = T ∇ Sτ"] Hvad du ser er formentlig den tætteste ligning på en E = mc² for intelligens, som jeg har set. Så hvad du ser her er en erklæring om korrespondance at intelligens er en kraft, F, som handler for at maksimere fremtidig handlefrihed. Den handler for at maksimere handlefrihed, eller holde muligheder åbne, med en styrke T, med mangfoldigheden af mulige tilgængelige fremtider, S, op til en vis fremtidig tidshorisont, tau. Kort sagt, intelligens kan ikke lide at blive fanget. Intelligens prøver på at maksimere fremtidig handlefrihed og holde muligheder åbne. Og så givet denne ligning, er det naturligt at spørge, hvad kan du gøre med den? Hvor forudsigelig er den? Forudser den intelligens på menneske niveau? Forudser den kunstig intelligens? Nu vil jeg vise jer en video som vil, tror jeg, demonstrere noget af det fantastiske potentiale af denne ene ligning.

And the answer, I believe, is yes. ["F = T ∇ Sτ"] What you're seeing is probably the closest equivalent to an E = mc² for intelligence that I've seen. So what you're seeing here is a statement of correspondence that intelligence is a force, F, that acts so as to maximize future freedom of action. It acts to maximize future freedom of action, or keep options open, with some strength T, with the diversity of possible accessible futures, S, up to some future time horizon, tau. In short, intelligence doesn't like to get trapped. Intelligence tries to maximize future freedom of action and keep options open. And so, given this one equation, it's natural to ask, so what can you do with this? How predictive is it? Does it predict human-level intelligence? Does it predict artificial intelligence? So I'm going to show you now a video that will, I think, demonstrate some of the amazing applications of just this single equation.

(Video) Fortæller: Nylig forskning i kosmologi har antydet at universer, som producerer mere uorden eller "entropi", over deres livstid burde være tilbøjelige til at have mere favorable vilkår for eksistens af intelligente væsner som os selv. Men hvad hvis det tentative kosmologiske forbindelse mellem entropi og intelligens antyder et dybere forhold? Men hvad hvis intelligent opførsel ikke bare korrelerer med produktionen af langvarig entropi, men faktisk stammer direkte fra det? For at finde ud af det, udviklede vi en software engine kaldet Entropica, designet til at maksimere produktionen af langvarig entropi i hvilket som helst system det befinder sig i. Utroligt nok, var Entropica i stand til at bestå adskillige intelligenstest for dyr, spille menneske spil og endda tjene penge ved at handle aktier, alt sammen uden at blive instrueret til det. Her er nogle eksempler på Entropica i aktion.

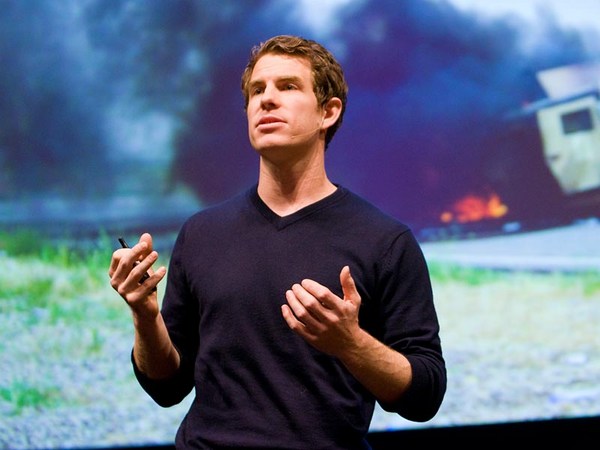

(Video) Narrator: Recent research in cosmology has suggested that universes that produce more disorder, or "entropy," over their lifetimes should tend to have more favorable conditions for the existence of intelligent beings such as ourselves. But what if that tentative cosmological connection between entropy and intelligence hints at a deeper relationship? What if intelligent behavior doesn't just correlate with the production of long-term entropy, but actually emerges directly from it? To find out, we developed a software engine called Entropica, designed to maximize the production of long-term entropy of any system that it finds itself in. Amazingly, Entropica was able to pass multiple animal intelligence tests, play human games, and even earn money trading stocks, all without being instructed to do so. Here are some examples of Entropica in action.

Ligesom et menneske står oprejst uden at vælte ser vi her Entropica. automatisk balancere en pæl ved hjælp af en vogn. Denne opførsel er bemærkelsesværdig til dels fordi vi aldrig gav Entropica et mål. Det besluttede simpelthen på egen vis at balancere pælen. Denne balanceringsevne vil have applikationer for humanoid robotteknologi og teknologiske hjælpemidler til mennesker. Lige som nogle dyr kan benytte objekter i deres miljø som værktøjer for at nå ind i snævre rum, ser vi her Entropica igen på eget initiativ, være i stand til at bevæge en stor disk repræsenterende et dyr omkring med det formål at en smal disk, repræsenterende et værktøj, at nå ind i et afgrænset rum holdende en tredje disk og frigive den tredje disk fra dens oprindelige fastlåste position. Denne evne til at benytte værktøjer vil have applikationer for smart produktion og landbrug. Ydermere, ligesom nogle andre dyr er i stand til at samarbejde ved at hive i modsat ende af et reb på samme tid for at frigive mad, ser vi her at Entropica er i stand til at opnå en model version af den opgave. Denne koorporationsevne har interessante implikationer for økonomiskplanlægning og en række af andre områder.

Just like a human standing upright without falling over, here we see Entropica automatically balancing a pole using a cart. This behavior is remarkable in part because we never gave Entropica a goal. It simply decided on its own to balance the pole. This balancing ability will have appliactions for humanoid robotics and human assistive technologies. Just as some animals can use objects in their environments as tools to reach into narrow spaces, here we see that Entropica, again on its own initiative, was able to move a large disk representing an animal around so as to cause a small disk, representing a tool, to reach into a confined space holding a third disk and release the third disk from its initially fixed position. This tool use ability will have applications for smart manufacturing and agriculture. In addition, just as some other animals are able to cooperate by pulling opposite ends of a rope at the same time to release food, here we see that Entropica is able to accomplish a model version of that task. This cooperative ability has interesting implications for economic planning and a variety of other fields.

Entropica er bredt anvendelig for en række af områder. For eksempel, ser vi det her succesfuldt spille et spil 'Pong' mod sig selv, illustrerende dets potentiale for spil. Her ser vi Entropica orkestrere nye forbindelser på et socialt netværk, hvor venner konstant falder ud af kontakt, og succesfyldt holde netværket forbundet. Denne samme netværks orkestreringsevne har også applikationer i sundhedssektoren, energi og efterretning. Her ser vi Entropica dirigere vejene for en flåde af skibe, succesfuldt opdage og benytte Panama kanalen til globalt at udvide dets rækkevidde fra Atlanten til Stillehavet. Af samme grund, er Entropica bredt anvendelig til problemer i autonomt forsvar, logistik og transport.

Entropica is broadly applicable to a variety of domains. For example, here we see it successfully playing a game of pong against itself, illustrating its potential for gaming. Here we see Entropica orchestrating new connections on a social network where friends are constantly falling out of touch and successfully keeping the network well connected. This same network orchestration ability also has applications in health care, energy, and intelligence. Here we see Entropica directing the paths of a fleet of ships, successfully discovering and utilizing the Panama Canal to globally extend its reach from the Atlantic to the Pacific. By the same token, Entropica is broadly applicable to problems in autonomous defense, logistics and transportation.

Til slut ser vi her Entropica spontant opdage og eksekvere en køb-lavt, sælg-højt strategi på en simuleret række af handlede aktier succesfyldt udvide antallet af aktiver under forvaltning eksponentiel. Denne risikostyringsevne vil have brede anvendelsesområder inden for finans og forsikring.

Finally, here we see Entropica spontaneously discovering and executing a buy-low, sell-high strategy on a simulated range traded stock, successfully growing assets under management exponentially. This risk management ability will have broad applications in finance and insurance.

Alex Wissner-Gross: Så hvad I lige har set er at et udpluk af menneskelig intelligent kognitivt opførsel som at benytte værktøjer gå oprejst og social koorporation alle stammer fra en enkelt ligning, som driver et system til at maksimere sin fremtidige handlefrihed.

Alex Wissner-Gross: So what you've just seen is that a variety of signature human intelligent cognitive behaviors such as tool use and walking upright and social cooperation all follow from a single equation, which drives a system to maximize its future freedom of action.

Der er en dybtgående ironi her. Gående tilbage til begyndelsen af benyttelsen af begrebet robot, spillet "RUR" var der altid et koncept, at hvis vi udviklede kunstig intelligens ville der opstå en kybernetisk oprør. Maskinerne ville rejse se op imod os. En væsentlig konsekvens af dette arbejde er at vi måske alle disse årtider har haft konceptet af kybernetisk oprør omvendt. Det er ikke at maskiner først bliver intelligente og derefter får storhedsvanvid og forsøger at overtage verden. Det er præcist det modsatte, at trangen til at tage kontrol af alle mulige fremtider er et mere fundamentalt princip end det af vores intelligens, at general intelligens muligvis kan opstå direkte fra denne form af forsøg på at opnå kontrol snarere end omvendt.

Now, there's a profound irony here. Going back to the beginning of the usage of the term robot, the play "RUR," there was always a concept that if we developed machine intelligence, there would be a cybernetic revolt. The machines would rise up against us. One major consequence of this work is that maybe all of these decades, we've had the whole concept of cybernetic revolt in reverse. It's not that machines first become intelligent and then megalomaniacal and try to take over the world. It's quite the opposite, that the urge to take control of all possible futures is a more fundamental principle than that of intelligence, that general intelligence may in fact emerge directly from this sort of control-grabbing, rather than vice versa.

En anden vigtig konsekvens er målsøgning. Jeg bliver ofte spurgt, hvordan evnen til at søge mål følger denne form for ramme? Og svaret er, evnen til at søge mål vil følge direkte fra dette i den følgende mening: præcist ligesom du ville rejse gennem en tunnel, en flaskehals i dit fremtidige vej rum for at opnå mange andre forskelligartede objektiver senere, eller præcist som du ville investere i en finansiel sikkerhed for at reducere din kortsigtede likviditet for at øge din velstand på lang sigt, målsøgning opstår direkte fra en langsigtet lyst til at øge fremtidig handlefrihed.

Another important consequence is goal seeking. I'm often asked, how does the ability to seek goals follow from this sort of framework? And the answer is, the ability to seek goals will follow directly from this in the following sense: just like you would travel through a tunnel, a bottleneck in your future path space, in order to achieve many other diverse objectives later on, or just like you would invest in a financial security, reducing your short-term liquidity in order to increase your wealth over the long term, goal seeking emerges directly from a long-term drive to increase future freedom of action.

Til slut, Richard Feynman, kendt fysiker, skrev engang at hvis den menneskelige civilisation blev tilintetgjort og du kun kunne videregive et enkelt koncept til vores efterkommere for at hjælpe dem med at opbygge civilisationen, burde det koncept være, at all materiale omkring os er laver ud af små elementer, som tiltrækker hinanden, når de er langt fra hinanden, men frastøder hinanden når de er tæt. Min ækvivalent af denne erklæring, at videregive til efterkommere, for at hjælpe dem med at bygge kunstig intelligens, eller hjælpe dem med at forstå menneskelig intelligens, er det følgende: Intelligens burde blive opfattet som en fysisk proces som prøver at maksimere fremtidig handlefrihed og undgå hindringer i sin egen fremtid.

Finally, Richard Feynman, famous physicist, once wrote that if human civilization were destroyed and you could pass only a single concept on to our descendants to help them rebuild civilization, that concept should be that all matter around us is made out of tiny elements that attract each other when they're far apart but repel each other when they're close together. My equivalent of that statement to pass on to descendants to help them build artificial intelligences or to help them understand human intelligence, is the following: Intelligence should be viewed as a physical process that tries to maximize future freedom of action and avoid constraints in its own future.

Mange tak.

Thank you very much.

(Bifald)

(Applause)