I work with children with autism. Specifically, I make technologies to help them communicate.

من با کودکان اوتیسمی کار می کنم. تخصصم، ساخت فناوری برای کمک به اونها در ایجاد ارتباطه.

Now, many of the problems that children with autism face, they have a common source, and that source is that they find it difficult to understand abstraction, symbolism. And because of this, they have a lot of difficulty with language.

امروز، بیشتر مشکلاتی که بچه های اوتیسمی از اون رنج می برن، منبع مشترکی داره، و اون منبع، سختیِ فهم و درک علایم و انتزاعه. و به این دلیل، اون ها مشکلاتِ بسیاری با زبان دارند.

Let me tell you a little bit about why this is. You see that this is a picture of a bowl of soup. All of us can see it. All of us understand this. These are two other pictures of soup, but you can see that these are more abstract These are not quite as concrete. And when you get to language, you see that it becomes a word whose look, the way it looks and the way it sounds, has absolutely nothing to do with what it started with, or what it represents, which is the bowl of soup. So it's essentially a completely abstract, a completely arbitrary representation of something which is in the real world, and this is something that children with autism have an incredible amount of difficulty with. Now that's why most of the people that work with children with autism -- speech therapists, educators -- what they do is, they try to help children with autism communicate not with words, but with pictures. So if a child with autism wanted to say, "I want soup," that child would pick three different pictures, "I," "want," and "soup," and they would put these together, and then the therapist or the parent would understand that this is what the kid wants to say. And this has been incredibly effective; for the last 30, 40 years people have been doing this. In fact, a few years back, I developed an app for the iPad which does exactly this. It's called Avaz, and the way it works is that kids select different pictures. These pictures are sequenced together to form sentences, and these sentences are spoken out. So Avaz is essentially converting pictures, it's a translator, it converts pictures into speech.

بذارید کمی براتون توضیح بدم. این تصویر یک کاسه سوپ است. ما همه این رو می بینیم. ما همه این رو فهمیم. دو تصویر دیگه از سوپ هم هست، اما می بینید که انتزاعی ترند خیلی ملموس نیستند. و وقتی به زبان برگردیم، به یک کلمه می رسیم که نه ظاهرش و نه صداش هیچ ربطی به خودش، یا چیزی که معرفشه نداره: یک کاسه سوپ! بنابرین، این فقط یک معرفیِ کاملن انتزاعی و کاملن قراردادی از چیزی در دنیای واقعیه، و چیزیی هست که بچه های اوتیسمی مشکلات بسیار زیادی با اون دارند. به همین دلیل، بیشتر کسانی که با بچه های اوتیسمی کار می کنند - گفتار درمانان، مربی ها - به اون ها کمک می کنن تا به جای کلمات از تصاویر برای ارتباط استفاده کنند. بنابرین اگه یک کودک اوتیسمی بخواد بگه: "سوپ می خوام"، می تونه سه تصویر مختلف برداره: "من"، "می خوام"، "سوپ" و با کنار هم چیدن اون ها، درمان گر یا والدین، می تونن بفهمن کودک چی می خواد بگه. این کار خیلی موثر بوده. برای ۳۰-۴۰ سال گذشته مردم از این روش استفاده می کردند. در واقع، چند سال پیش، من یک برنامه برای آی پد نوشتم که دقیقن همین کار رو انجام می ده. اسمش هست "آواز" بچه ها تصویری رو که می خوان انتخاب می کنن؛ این تصاویر برای ساخت جمله، دنبال هم قرار می گیرند، و جملات با صدا پخش می شن. بنابراین "آواز" اساسا مبدل تصاویره. مترجمی که تصاویر رو به گفتار تبدیل می کنه.

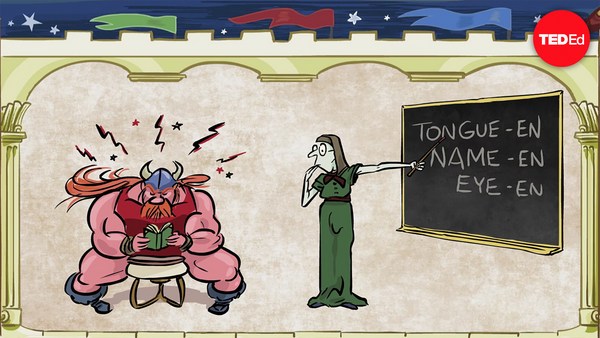

Now, this was very effective. There are thousands of children using this, you know, all over the world, and I started thinking about what it does and what it doesn't do. And I realized something interesting: Avaz helps children with autism learn words. What it doesn't help them do is to learn word patterns. Let me explain this in a little more detail. Take this sentence: "I want soup tonight." Now it's not just the words here that convey the meaning. It's also the way in which these words are arranged, the way these words are modified and arranged. And that's why a sentence like "I want soup tonight" is different from a sentence like "Soup want I tonight," which is completely meaningless. So there is another hidden abstraction here which children with autism find a lot of difficulty coping with, and that's the fact that you can modify words and you can arrange them to have different meanings, to convey different ideas. Now, this is what we call grammar. And grammar is incredibly powerful, because grammar is this one component of language which takes this finite vocabulary that all of us have and allows us to convey an infinite amount of information, an infinite amount of ideas. It's the way in which you can put things together in order to convey anything you want to.

خب، این خیلی موثر بود. هزاران کودک از اون استفاده می کنند، در سرتاسر دنیا. به این فکر کردم که چه کاری انجام می ده، و چه کاری نه. و به یک چیز جالب رسیدم: "آواز" به بچه های اوتیسمی کمک می کنه کلمات رو یاد بگیرند. چیزی رو که کمکی به انجامش نمی کنه: یادگیریِ الگوی کلماته. بذارید کمی وارد جزییات شم. برای مثال: "من امشب سوپ می خوام." در این مورد، تنها کلمات نیستند که معنا را انتقال می دهند. نحوه ی چیدمان این کلمات هم هست، نحوه ی تطبیق و چیدمانِ این کلمات. و به همین دلیل جمله ای مثل "من امشب سوپ می خوام" متفاوته از جمله ای مثل " سوپ امشب من می خوام"، که کاملن بی معنیه. بنابراین، حالت انتزاعیِ پنهانِ دیگری هم هست که کنار اومدن باهاش، برای بچه های اوتیسمی خیلی سخته: این واقعیت که می شه کلمات رو تغییر داد و برای انتقال معناهای مختلف چیدمان اون ها رو عوض کرد. این همون چیزیه که بهش"دستور زبان" می گیم. و "دستور زبان" واقعن قدرت مند است، چراکه این مؤلفه از زبان، به ما اجازه می ده تا با داشتن واژگان محدود که همگی می دونیم مقدار نامحدودی از اطلاعات رو انتقال بدیم. حجم بی نهایتی از ایده ها. با این شیوه می تونیم چیزها رو کنار هم بگذاریم، تا هر چیزی رو که می خوایم، منتقل کنیم.

And so after I developed Avaz, I worried for a very long time about how I could give grammar to children with autism. The solution came to me from a very interesting perspective. I happened to chance upon a child with autism conversing with her mom, and this is what happened. Completely out of the blue, very spontaneously, the child got up and said, "Eat." Now what was interesting was the way in which the mom was trying to tease out the meaning of what the child wanted to say by talking to her in questions. So she asked, "Eat what? Do you want to eat ice cream? You want to eat? Somebody else wants to eat? You want to eat cream now? You want to eat ice cream in the evening?" And then it struck me that what the mother had done was something incredible. She had been able to get that child to communicate an idea to her without grammar. And it struck me that maybe this is what I was looking for. Instead of arranging words in an order, in sequence, as a sentence, you arrange them in this map, where they're all linked together not by placing them one after the other but in questions, in question-answer pairs. And so if you do this, then what you're conveying is not a sentence in English, but what you're conveying is really a meaning, the meaning of a sentence in English. Now, meaning is really the underbelly, in some sense, of language. It's what comes after thought but before language. And the idea was that this particular representation might convey meaning in its raw form.

بعد از نوشتنِ "آواز"، این موضوع برای مدت طولانی نگرانم می کرد که چطور می تونم به بچه های اوتیسمی دستور زبان یاد بدم. این ایده از یه دیدگاه خیلی جالب سراغم اومد. تصادفن با یک کودک اوتیسمی برخورد کردم که با مادرش حرف می زد... این اتفاق افتاد: کاملن ناگهانی و خود به خود، بچه بلند شد و گفت" "بخور." حالا نکته ی جالب، تلاشی بود که مادر می کرد تا منظور بچه رو از حرفی که زده بفهمه در حالی که ازش سوال می پرسید. اون پرسید: "چی بخوری؟ می خوای بستنی بخوری؟ تو می خوای بخوری؟ یکی دیگه می خواد بخوره؟ الان می خوای بستنی بخوری؟ غروب می خوای بستنی بخوری؟ ناگهان ندایی بهم گفت کاری که مادر می کنه فوق العاده س. اون می تونست کاری کنه که بچه، بدون دستور زبان ایده ش رو منتقل کنه. و با خودم گفتم شاید این همون چیزیه که دنبالش می گشتم. به جای قرار دادن واژگان در یک توالی مشخص، برای تشکیل جمله، اونهارو جوری بچینی که همه به هم مربوط باشن نه با چیدن شون پشت سر هم بلکه به صورت سوال، در جفتهای سوال و جوابی. در این صورت، چیزی که منتقل می کنیم یک جمله ی انگلیسی نیست، بلکه واقعن یک معناست. معنای جمله ای در انگلیسی. اما معنای زبان -یه جورایی- پنهان است. چیزیه که بعد از فکر و قبل از زبان می آد. ایده به این صورت بود که این روشِ خاصِ ارائه ممکن بود بتونه معنا رو به صورت خام انتقال بده.

So I was very excited by this, you know, hopping around all over the place, trying to figure out if I can convert all possible sentences that I hear into this. And I found that this is not enough. Why is this not enough? This is not enough because if you wanted to convey something like negation, you want to say, "I don't want soup," then you can't do that by asking a question. You do that by changing the word "want." Again, if you wanted to say, "I wanted soup yesterday," you do that by converting the word "want" into "wanted." It's a past tense. So this is a flourish which I added to make the system complete. This is a map of words joined together as questions and answers, and with these filters applied on top of them in order to modify them to represent certain nuances. Let me show you this with a different example.

می دونید، من خیلی هیجان زده بودم از این طرف به اون طرف می پریدم، تا بتونم مطمئن بشم آیا می شه همه جمله های ممکن رو که می شنوم، به این روش تبدیل کنم. و فهمیدم که این کافی نیست. چرا این کافی نیست؟ کافی نیست چون اگر بخوای چیزی رو به صورت منفی انتقال بدی، مثلا: "من سوپ نمی خوام"، نمی شه در موردش سوال بپرسی. این کار رو با تغییر واژه ی "می خوام" انجام می دی. مثلن اگه بخوای بگی: "دیروز سوپ می خواستم" "می خوام" رو به "می خواستم" تغیر می دی. یک فعلِ گذشته. بنابراین، برای تکمیل سیستم، این رو بهش اضافه کردم. این یک نقشه از واژگان متصل به هم به صورتِ پرسش و پاسخ و یک سری فیلتر در قسمت بالایی برای اعمال تغییر در زمان و تفاوت های ظریف است. بگذارید مثال دیگه ای بزنم.

Let's take this sentence: "I told the carpenter I could not pay him." It's a fairly complicated sentence. The way that this particular system works, you can start with any part of this sentence. I'm going to start with the word "tell." So this is the word "tell." Now this happened in the past, so I'm going to make that "told." Now, what I'm going to do is, I'm going to ask questions. So, who told? I told. I told whom? I told the carpenter. Now we start with a different part of the sentence. We start with the word "pay," and we add the ability filter to it to make it "can pay." Then we make it "can't pay," and we can make it "couldn't pay" by making it the past tense. So who couldn't pay? I couldn't pay. Couldn't pay whom? I couldn't pay the carpenter. And then you join these two together by asking this question: What did I tell the carpenter? I told the carpenter I could not pay him.

مثل این جمله: "به نجار گفتم که نمی تونم پولش رو بپردازم." که انصافا یک جمله ی پیچیده است. این طور که این سیستم کار می کنه، می تونید از هرجای جمله شروع کنید. من با "گفتن" شروع می کنم. خُب این واژه ی "گفتن" این اتفاق در گذشته رخ داده، پس به "گفتم" تغییرش می دم. حالا کاری که باید انجام بدم، سوال پرسیدن است. خُب... کی گفت؟ من گفتم. به کی گفتم؟ به نجار گفتم. حالا با یه قسمتِ دیگه ی جمله شروع می کنیم با "پرداختن" مثلا. از فیلتر توانایی استفاده می کنیم تا توانایی در پرداخت رو نشون بدیم. بعد به "نمی تونه بپردازه" تغییرش می دیم. و با اضافه کردن این فیلتر به گذشته تغییرش می دیم. بنابراین کی نمی تونست بپردازه؟ من. به کی نمی تونستم بپردازم؟ به نجار. و بعد این دو تا رو به هم وصل می کنید با پرسیدن یک سوال: به نجار چی گفتم؟ "به نجار گفتم که نمی تونم پولش رو بپردازم."

Now think about this. This is —(Applause)— this is a representation of this sentence without language. And there are two or three interesting things about this. First of all, I could have started anywhere. I didn't have to start with the word "tell." I could have started anywhere in the sentence, and I could have made this entire thing. The second thing is, if I wasn't an English speaker, if I was speaking in some other language, this map would actually hold true in any language. So long as the questions are standardized, the map is actually independent of language. So I call this FreeSpeech, and I was playing with this for many, many months. I was trying out so many different combinations of this.

حالا به این فکر کنید. این... (تشویق حضار) این یک ارائه از این جمله است، بدون زبان. دو سه نکته ی جالب وجود داره اول این که: می تونستم از هرجا می خوام شروع کنم. مجبور نبودم با واژه ی "گفتن" شروع کنم. از هر جای جمله می شد شروع کنم، و به همین جمله برسم. نکته ی دوم: اگر من انگلیسی زبان نبودم، اگر به زبان دیگری حرف می زدم، این روش برای هر زبان دیگری جواب می داد. بنابرین تا زمانی که پرسش ها استاندار باشند، این روش از زبان مستقل است. بنابراین بهش می گم: "گفتارِ مستقل ( فری اسپیچ)" ماه های زیادی با این برنامه کار کردم. تا انواع مختلف ترکیبات رو امتحان کنم.

And then I noticed something very interesting about FreeSpeech. I was trying to convert language, convert sentences in English into sentences in FreeSpeech, and vice versa, and back and forth. And I realized that this particular configuration, this particular way of representing language, it allowed me to actually create very concise rules that go between FreeSpeech on one side and English on the other. So I could actually write this set of rules that translates from this particular representation into English. And so I developed this thing. I developed this thing called the FreeSpeech Engine which takes any FreeSpeech sentence as the input and gives out perfectly grammatical English text. And by putting these two pieces together, the representation and the engine, I was able to create an app, a technology for children with autism, that not only gives them words but also gives them grammar.

تا به چیز خیلی جالبی در مورد "گفتار مستقل" برخوردم! من داشتم تلاش می کردم زبان رو تبدیل کنم؛ تبدیل جملات انگلیسی به جملات "گفتار مستقل،" و برعکس... و من متوجه شدم که این تنظیمات خاص، این روش ویژه ارائه ی زبان، به من اجازه داده تا قوانین خیلی موجزی بسازم که مابین "گفتار مستقل" از یه سو و انگلیسی از سوی دیگه قرار دارند. بنابراین می تونستم مجموعه ای ازقوانینی رو بنویسم، که این نحوه خاص از ارائه را به انگلیسی ترجمه کنند. و در نتیجه این برنامه رو نوشتم. برنامه ای به اسم موتور "گفتار مستقل" که هر نوع جمله "گفتار مستقل" رو به عنوان ورودی می گیره و از نظر دستوری، جمله ی درستِ انگلیسی می ده. و با کنار هم گذاشتن این دو در کنار هم، برنامه ی "گفتار مستقل" و موتورش، تونستم برنامه ای بنویسم، یک فناوری برای کمک به کودکان اوتیسمی؛ که نه تنها بهشون واژه می ده، که دستور زبان هم می ده.

So I tried this out with kids with autism, and I found that there was an incredible amount of identification. They were able to create sentences in FreeSpeech which were much more complicated but much more effective than equivalent sentences in English, and I started thinking about why that might be the case. And I had an idea, and I want to talk to you about this idea next. In about 1997, about 15 years back, there were a group of scientists that were trying to understand how the brain processes language, and they found something very interesting. They found that when you learn a language as a child, as a two-year-old, you learn it with a certain part of your brain, and when you learn a language as an adult -- for example, if I wanted to learn Japanese right now — a completely different part of my brain is used. Now I don't know why that's the case, but my guess is that that's because when you learn a language as an adult, you almost invariably learn it through your native language, or through your first language. So what's interesting about FreeSpeech is that when you create a sentence or when you create language, a child with autism creates language with FreeSpeech, they're not using this support language, they're not using this bridge language. They're directly constructing the sentence.

بنابراین اون رو با بچه های اوتیسمی امتحان کردم. و متوجه شدم که تطبیق فوق العاده ی داره. اون ها می تونستند با "گفتار مستقل" جمله بسازند، که از معادل انگلیسی اون، خیلی پیچیده تر و خیلی مفیدتر بود! این بود که به فکر فرو رفتم درباره این که چرا باید این طور باشه. و ایده ای به ذهنم اومد که می خوام درباره ش صحبت کنم. حدود ۱۵ سال پیش، سال ۱۹۹۷ گروهی از دانشمندان چگونگی پردازشِ زبان توسط مغر رو بررسی می کردند. و چیز خیلی جالبی کشف کردند. این که وقتی شما به عنوان یک کودک زبان یاد می گیرید، یک کودکِ ۲ ساله، با قسمت مشخصی از مغز این کارُ می کنید. و وقتی به عنوان آدم برزگ زبان یاد می گیرید -مثلن اگر من الان بخوام ژاپنی یاد بگیرم- قسمت کاملن متفاوتی از مغزم استفاده می شه. نمی دونم چرا این طوره، اما حدس می زنم به این دلیل که وقتی به عنوان آدم بزرگ زبان یاد می گیرید، این کار رو از طریق زبان محلی تون انجام می دید، از طریق زبان مادری تون. نکته ی جالب در مورد "گفتار مستقل"، موقع جمله ساختن است یا ایجاد زبان، وقتی یک کودک اوتیسمی با "گفتار مستقل" زبان می سازه، از زبان کمکی استفاده نمی کنه! از یک پل ارتباطی کمک نمی گیره. مستقیم جمله رو می سازه.

And so this gave me this idea. Is it possible to use FreeSpeech not for children with autism but to teach language to people without disabilities? And so I tried a number of experiments. The first thing I did was I built a jigsaw puzzle in which these questions and answers are coded in the form of shapes, in the form of colors, and you have people putting these together and trying to understand how this works. And I built an app out of it, a game out of it, in which children can play with words and with a reinforcement, a sound reinforcement of visual structures, they're able to learn language. And this, this has a lot of potential, a lot of promise, and the government of India recently licensed this technology from us, and they're going to try it out with millions of different children trying to teach them English. And the dream, the hope, the vision, really, is that when they learn English this way, they learn it with the same proficiency as their mother tongue.

به دنبال این نکته، این ایده اومد: آیا می شه از " گفتار مستقل" استفاده کرد نه برای کودکانِ اوتیسمی، که برای آموزش زبان به مردمِ سالم؟ آزمایشات مختلفی انجام دادم. اول یک پازل ساختم که این پرسش و پاسخ ها به صورت اَشکال کدگذاری شده بودند. به صورت رنگ. افراد اون ها رو کنار هم می چیدن و سعی می کردند نحوه ی کارش رو بفهمند. و یک برنامه براش نوشتم، یک بازی، که بچه ها با واژه ها بازی کنند، و با یک کمک، یک کمکِ شنیداری از ساختارهای دیداری، می تونستن زبان یاد بگیرند. و این پتانسیل بالایی داره، و نوید بخش است، اخیرا، دولت هند این فناوری رو از ما خرید. اونا می خوان این رو روی میلیون ها کودک آزمایش کنند بهشون انگلیسی یاد بدهند. رویا، امید و الهام در واقع... هنگامی است که اون ها با این روش انگلیسی یاد بگیرند، این که با همان کیفیتِ زبان مادری انگلیسی یاد بگیرند.

All right, let's talk about something else. Let's talk about speech. This is speech. So speech is the primary mode of communication delivered between all of us. Now what's interesting about speech is that speech is one-dimensional. Why is it one-dimensional? It's one-dimensional because it's sound. It's also one-dimensional because our mouths are built that way. Our mouths are built to create one-dimensional sound. But if you think about the brain, the thoughts that we have in our heads are not one-dimensional. I mean, we have these rich, complicated, multi-dimensional ideas. Now, it seems to me that language is really the brain's invention to convert this rich, multi-dimensional thought on one hand into speech on the other hand. Now what's interesting is that we do a lot of work in information nowadays, and almost all of that is done in the language domain. Take Google, for example. Google trawls all these countless billions of websites, all of which are in English, and when you want to use Google, you go into Google search, and you type in English, and it matches the English with the English. What if we could do this in FreeSpeech instead? I have a suspicion that if we did this, we'd find that algorithms like searching, like retrieval, all of these things, are much simpler and also more effective, because they don't process the data structure of speech. Instead they're processing the data structure of thought. The data structure of thought. That's a provocative idea.

خُب، بیایید در مورد چیز دیگری صحبت کنیم. درباره ی گفتار. این گفتار است. گفتار، اولین حالت ارتباط است، که بین ما رایج شده. حالا چیزِ جالب در مورد گفتار این است که گفتار تک بُعدی است. چرا تک بعدی است؟ تک بعدی است، چون صداست. دلیل دیگر اینه که ساختار دهان به این شکل است. دهان مان برای تولید صدای تک-بعدی ساخته شده. اما اگر به مغز فکر کنید، افکاری که در سر داریم تک-بعدی نیستند. افکار ما غنی، پیچیده، و چند بعدی اند. به نظر می آد که زبان اختراعِ مغز است برای تبدیل این افکار غنی و چند بعدی از یک سو به گفتار در سوی دیگر. نکته ی جالب این است که امروزه ما تلاش زیادی در زمینه اطلاعات انجام می دیم، که تقریبن همه اون ها در دامنه ی زبان قرار می گیرند. برای مثال: گوگل. گوگل تعداد بی شماری وب سایت میاره، که همه انگلیسی ان، و وقتی شما از گوگل استفاده می کنید، به موتور جستجوی گوگل می رید، و به انگلیسی تایپ می کنید، و اون انگلیسی رو با انگلیسی تطبیق می ده. چی می شد اگه ما این کار رو با "گفتار مستقل" انجام می دادیم؟ من فکر می کنم اگر این کار رو می کردیم، الگوریتم هایی مثل جستجو، یا بازیابی، همه شون ساده تر و مفیدتر می شدند، چون نیازی به پردازشِ ساختار گفتار نبود. در ازاش، ساختار داده های تفکر پردازش می شه. ساختار داده های تفکر. ایده محرکی است.

But let's look at this in a little more detail. So this is the FreeSpeech ecosystem. We have the Free Speech representation on one side, and we have the FreeSpeech Engine, which generates English. Now if you think about it, FreeSpeech, I told you, is completely language-independent. It doesn't have any specific information in it which is about English. So everything that this system knows about English is actually encoded into the engine. That's a pretty interesting concept in itself. You've encoded an entire human language into a software program. But if you look at what's inside the engine, it's actually not very complicated. It's not very complicated code. And what's more interesting is the fact that the vast majority of the code in that engine is not really English-specific. And that gives this interesting idea. It might be very easy for us to actually create these engines in many, many different languages, in Hindi, in French, in German, in Swahili. And that gives another interesting idea. For example, supposing I was a writer, say, for a newspaper or for a magazine. I could create content in one language, FreeSpeech, and the person who's consuming that content, the person who's reading that particular information could choose any engine, and they could read it in their own mother tongue, in their native language. I mean, this is an incredibly attractive idea, especially for India. We have so many different languages. There's a song about India, and there's a description of the country as, it says, (in Sanskrit). That means "ever-smiling speaker of beautiful languages."

بیاید کمی وارد جزییات شیم. خُب این اکو سیستمِ "گفتار مستقل" در یک سو ارائه دهنده "گفتار مستقل" رو داریم، و موتورِ "گفتار مستق" که انگلیسی تولید می کند. حالا اگر کمی فکر کنید، "گفتار مستقل" همون طور که گفتم، از زبان مستقل است. هیچ اطلاعات مشخصی در خودش نداره که انگلیسی باشه. بنابرین هرچیزی که این سیستم در مورد انگلیسی می دونه در واقع برای موتور کُد شده. که این خودش مبحثِ خیلی جالبی است. تمام زبان انسان در یک نرم افزار کد گذاری شده. اما اگر به داخل این موتور نگاهی بندازید، می بینید خیلی پیچیده نیست. کدهای پیچیده ای نداره. و چیزی که جالب است این حقیقت است که بیشتر کدهای این موتور در واقع لزوما انگلیسی نیستند. و همین دلیلِ این ایده ی جالب برامون خیلی ساده خواهد بود که این موتورها رو به خیلی از زبان های دیگر هم بنویسیم؛ به هندی، فرانسه، آلمانی و سواحیلی. و ایده جالبِ دیگری می آد. مثلا فکر کنید من نویسنده ام، برای یک روزنامه یا مجله... می تونم مطالب رو فقط به یک زبان بنویسم: گفتار مستقل، و کسی که می خواد مطلب رو بخونه، کسی که می خواد اون مطلب خاص رو بخونه می تونه هر موتوری رو انتخاب کنه، و اون رو به زبان مادریش بخونه. به زبانِ محلیش. این ایده ی بسیار خوبی است، مخصوصا برای هند. ما کلی زبان های مختلف داریم. ترانه ای در مورد هند هست که کشور رو توصیف می کنه: (به زبان سانسکریت) یعنی "متکلم همیشه خندانِ زبان های زیبا."

Language is beautiful. I think it's the most beautiful of human creations. I think it's the loveliest thing that our brains have invented. It entertains, it educates, it enlightens, but what I like the most about language is that it empowers.

زبان زیباست! فکر می کنم زیباترین ابداع بشر باشه. فکر می کنم دوست داشتنی-ترین اختراع مغزمون باشه. سرگرم می کنه، آموزش می ده و آگاه می کنه اما چیزی که بیشتر در موردش دوست دارم، این است که قدرت می ده.

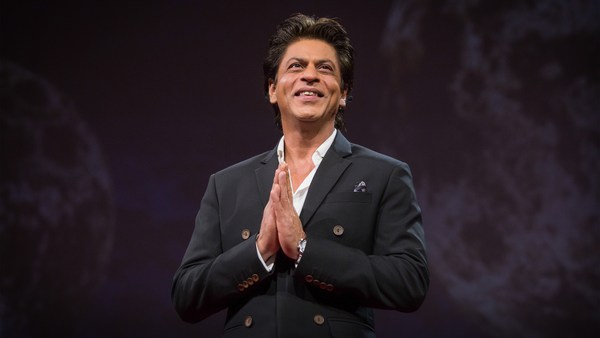

I want to leave you with this. This is a photograph of my collaborators, my earliest collaborators when I started working on language and autism and various other things. The girl's name is Pavna, and that's her mother, Kalpana. And Pavna's an entrepreneur, but her story is much more remarkable than mine, because Pavna is about 23. She has quadriplegic cerebral palsy, so ever since she was born, she could neither move nor talk. And everything that she's accomplished so far, finishing school, going to college, starting a company, collaborating with me to develop Avaz, all of these things she's done with nothing more than moving her eyes.

به عنوان حسن ختام، این عکس همکارانِ من است. اولین همکارام وقتی کار روی زبان، اوتیسم، و خیلی چیزهای دیگر رو شروع کردم. اسم اون دختر "پاونا"ست و اون مادرشه، "کالپانا". "پاونا" مؤسس شرکت است، اما داستانش خیلی قابل توجه تر از مالِ من است؛ چون "پاونا" حدود ۲۳ سال داره. و اون فلجِ مغزی-نخاعی است. از زمان تولدش، نه حرف می زنه، نه حرکت می کنه. و هرچیزی که تا امروز انجام داده، پایان تحصیلات، رفتن به دانشگاه، تآسیس شرکت، همکاری با من برای نوشتن "آواز"، همه کارهایی که انجام داده، تنها با حرکت چشمان اش بوده.

Daniel Webster said this: He said, "If all of my possessions were taken from me with one exception, I would choose to keep the power of communication, for with it, I would regain all the rest." And that's why, of all of these incredible applications of FreeSpeech, the one that's closest to my heart still remains the ability for this to empower children with disabilities to be able to communicate, the power of communication, to get back all the rest.

"دانیل وبستر" می گه: "اگر همه ی دارایی های من را بگیرند، و فقط یک انتخاب داشته باشم، قدرت ارتباط برقرار کردن را انتخاب می کنم، که به وسیله ی آن، مابقی را دوباره کسب می کنم." به همین دلیل... از بین تمام برنامه های "گفتار مستقل"، نزدیک ترین به قلب من، توانایی ی قدرت بخشیدن به بچه های ناتوان است که بتونن حرف بزنند، تا برای کسب مابقی، قدرت ارتباط داشته باشند.

Thank you. (Applause) Thank you. (Applause) Thank you. Thank you. Thank you. (Applause) Thank you. Thank you. Thank you. (Applause)

ممنونم. (تشویق حضار) ممنونم. (تشویق حضار) ممنونم.